摘要:

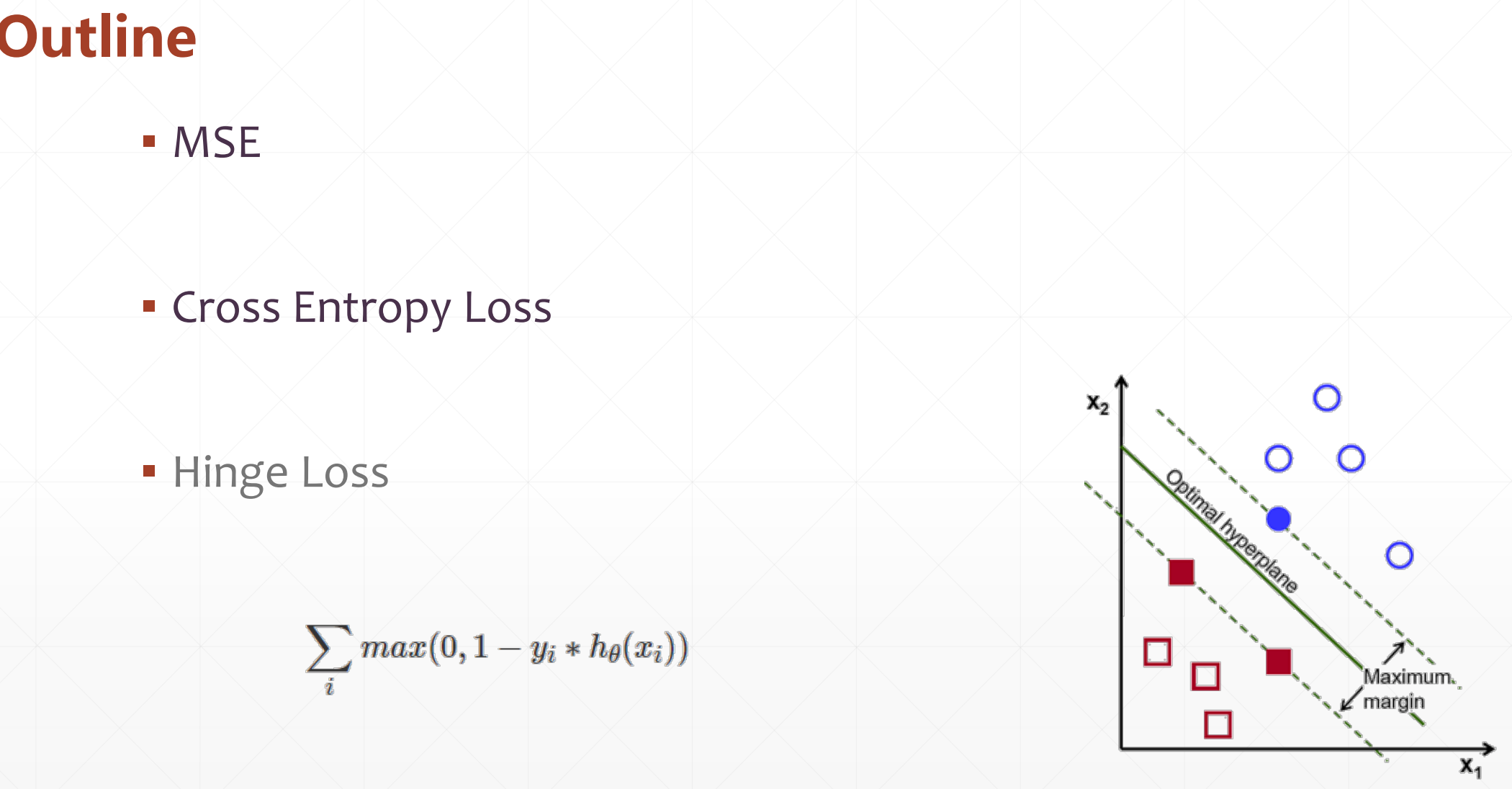

▪ MSE ▪ Cross Entropy Loss(针对分类问题) ▪ Hinge Loss  # 1 阅读全文

摘要:

这里的输出方式有这几种:  # 1 𝑦∈𝑅^d ▪ linear regression(线性回归) 阅读全文

摘要:

▪ Matmul ▪ Neural Network ▪ Deep Learning ▪ Multi-Layer # 1.Matmul - out=f(x@w+b) - out=relu(x@w+b)  2.tf.data.Dataset.from_tensor_slices(加载成tensor) - shuffle - map - batch - repeat # 2 tf.keras.datasets()  >tf.concat([a,b,....],axis=) 这个就是a,b按照第axis维进行合并,注意,比如说在第1维度进行合并的话 阅读全文