机器翻译与数据集

语言模型是自然语言处理的关键,而机器翻译是语言模型最成功的基准测试。因为机器翻译正是将输入序列转换成输出序列的序列转换模型的核心问题。序列转换模型在各类现人工智能

应用中发挥着至关重要的作用。为此,本节将介绍机器翻译

问题及其后文需要使用的数据集。

机器翻译指的是将序列从⼀种语言自动翻译成另⼀种语言。事实上,这个研究领域可以追溯到数字计算机发明后不久的20世纪40年代,特别是在第二次世界大战中使用计算机破解语言编码。几十年来,在使用神经网络进行端到端学习的兴起之前,统计学方法在这⼀领域⼀直占据主导地位。因为统计机器翻译涉及了翻译模型和语言模型等组成部分的统计分析,因此基于神经网络的方法通常被称为神经机器翻译,用于将两种翻译模型区分开来。

机器翻译的数据集是由源语言和目标语言的文本序列对组成的。因此,我们需要⼀种完全不同的方法来预处理机器翻译数据集,而不是复用语言模型的预处理程序。下面,我们看⼀下如何将预处理后的数据加载到小批量中用于训练。

import os

import torch

from d2l import torch as d2l

下载和预处理数据集

首先,下载⼀个由Tatoeba项目的双语句子对组成的"英-法"数据集,数据集中的每一行都是制表符分隔的文本序列对,序列对由英文文本序列和翻译后的法语文本序列组成。请注意,每个文本序列可以是一个句子,也可以是包含多个句子的⼀个段落。在这个将英语翻译成法语的机器翻译问题中,英语是源语言(source language),法语是目标语言(target language)。

d2l.DATA_HUB['fra-eng'] = (d2l.DATA_URL + 'fra-eng.zip',

'94646ad1522d915e7b0f9296181140edcf86a4f5')

def read_data_nmt():

"""载入“英语-法语”数据集。"""

data_dir = d2l.download_extract('fra-eng')

with open(os.path.join(data_dir, 'fra.txt'), 'r',encoding='utf-8') as f:

return f.read()

raw_text = read_data_nmt()

print(raw_text[:75])

Go. Va !

Hi. Salut !

Run! Cours !

Run! Courez !

Who? Qui ?

Wow! Ça alors !

下载数据集后,原始文本数据需要经过几个预处理步骤。例如,我们用空格代替不间断空格,使⽤小写字母替换大写字母,并在单词和标点符号之间插⼊空格。

def preprocess_nmt(text):

"""预处理“英语-法语”数据集。"""

def no_space(char, prev_char):

return char in set(',.!?') and prev_char != ' '

# 使⽤空格替换不间断空格

# 使⽤⼩写字⺟替换⼤写字⺟

text = text.replace('\u202f', ' ').replace('\xa0', ' ').lower()

# 在单词和标点符号之间插⼊空格

out = [

' ' + char if i > 0 and no_space(char, text[i - 1]) else char

for i, char in enumerate(text)]

return ''.join(out)

text = preprocess_nmt(raw_text)

print(text[:80])

go . va !

hi . salut !

run ! cours !

run ! courez !

who ? qui ?

wow ! ça alors !

词元化

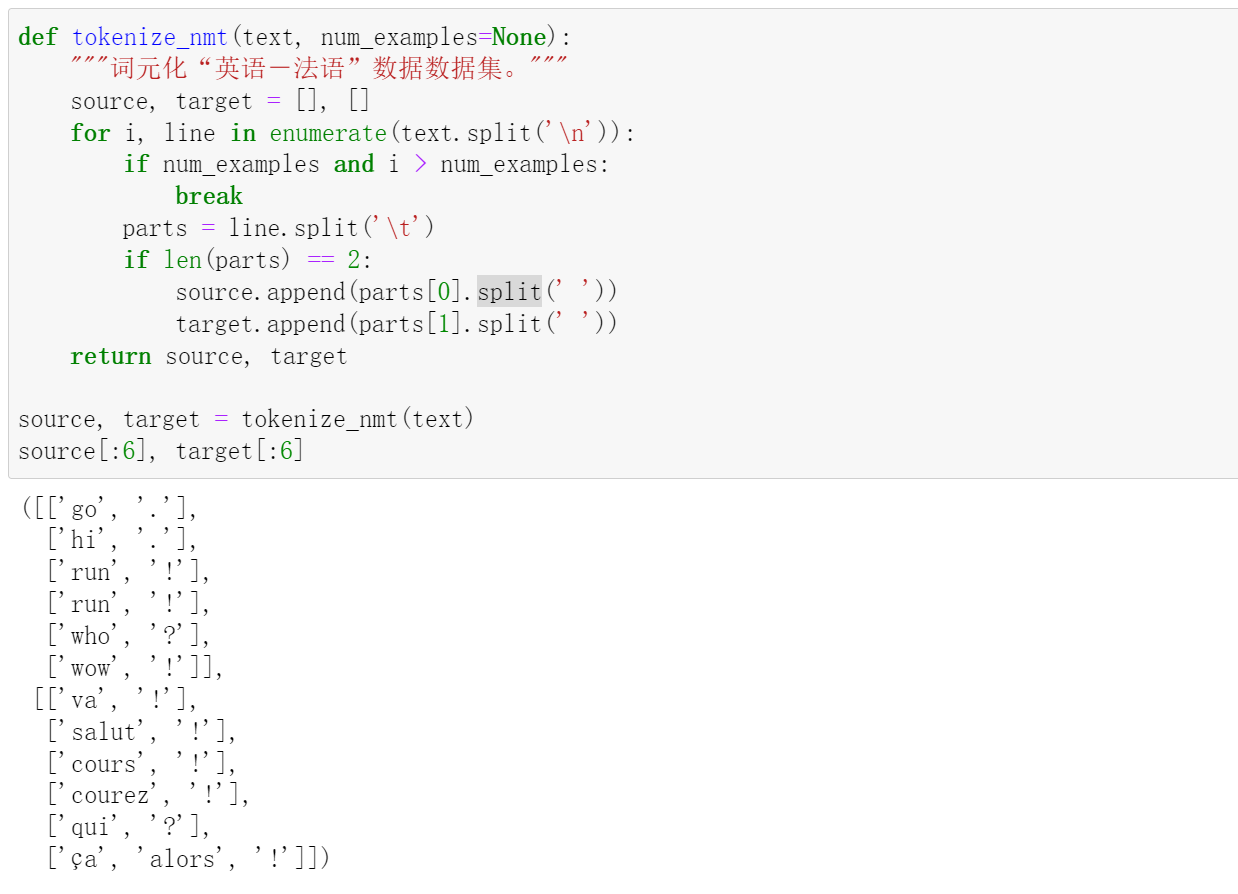

与前面中的字符级词元化不同,在机器翻译中,我们更喜欢单词级词元化(最先进的模型可能使用更高级的词元化技术)。下面的tokenize_nmt函数对前num_examples个文本序列对进行词元,其中每个词元要么是⼀个词,要么是⼀个标点符号。此函数返回两个词元列表:source和target:source[i]是源语言(这里是英语)第i个文本序列的词元列表,target[i]是目标语言(这里是法语)第i个文本序列的词元列表。

def tokenize_nmt(text, num_examples=None):

"""词元化“英语-法语”数据数据集。"""

source, target = [], []

for i, line in enumerate(text.split('\n')):

if num_examples and i > num_examples:

break

parts = line.split('\t')

if len(parts) == 2:

source.append(parts[0].split(' '))

target.append(parts[1].split(' '))

return source, target

source, target = tokenize_nmt(text)

source[:6], target[:6]

([['go', '.'],

['hi', '.'],

['run', '!'],

['run', '!'],

['who', '?'],

['wow', '!']],

[['va', '!'],

['salut', '!'],

['cours', '!'],

['courez', '!'],

['qui', '?'],

['ça', 'alors', '!']])

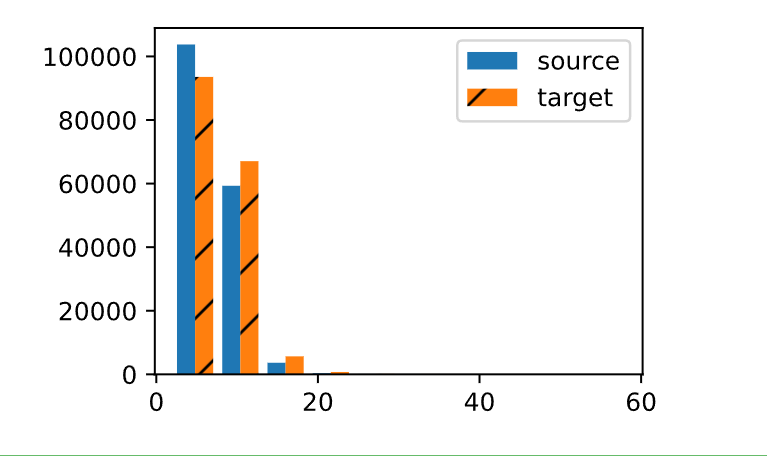

让我们绘制每个文本序列所包含的词元数量的直方图。在这个简单的“英-法”数据集中,大多数文本序列的词元数量少于20个。

d2l.set_figsize()

_, _, patches = d2l.plt.hist([[len(l)

for l in source], [len(l) for l in target]],

label=['source', 'target'])

for patch in patches[1].patches:

patch.set_hatch('/')

d2l.plt.legend(loc='upper right');

词表

由于机器翻译数据集由语言对组成,因此我们可以分别为源语言和目标语言构建两个词表。使⽤单词级词元化时,词表大小将明显大于使用字符级词元化时的词表大小。为了缓解这⼀问题,这里我们将出现次数少于2次的低频率词元视为相同的未知("<unk>")词元。除此之外,我们还指定了额外的特定词元,例如在大批量时⽤于将序列填充到相同⻓度的填充词元("<pad>"),以及序列的开始词元("<bos>")和结束词元("<eos>")。这些特殊词元在自然语言处理任务中比较常用。

src_vocab = d2l.Vocab(source, min_freq=2,

reserved_tokens=['<pad>', '<bos>', '<eos>'])

len(src_vocab)

# 10012

加载数据集

回想⼀下,语言模型中的序列样本都有⼀个固定的长度,无论这个样本是⼀个句子的⼀部分还是跨越了多个句子的⼀个片断。这个固定长度是由 num_steps(时间步数或词元数量)参数指定的。在机器翻译中,每个样本都是由源和目标组成的文本序列对,其中的每个文本序列可能具有不同的长度。为了提⾼计算效率,我们仍然可以通过截断(truncation)和 填充(padding)方式实现⼀次只处理⼀个小批量的文本序列。假设同⼀个小批量中的每个序列都应该具有相同的⻓度num_steps,那么如果文本序列的词元数目少于num_steps时,我们将继续在其末尾添加特定的"<pad>"词元,直到其⻓度达到num_steps;反之,我们将截断文本序列时,只取其前num_steps 个词元,并且丢弃剩余的词元。这样,每个文本序列将具有相同的长度,以便以相同形状的小批量进行加载。如前所述,下⾯的truncate_pad函数将截断或填充文本序列。

这一步就是将句子长度固定,不够就补充空格,够就截断。

ef truncate_pad(line, num_steps, padding_token):

"""截断或填充文本序列。"""

if len(line) > num_steps:

return line[:num_steps]

return line + [padding_token] * (num_steps - len(line))

truncate_pad(src_vocab[source[0]], 10, src_vocab['<pad>'])

# [47, 4, 1, 1, 1, 1, 1, 1, 1, 1]

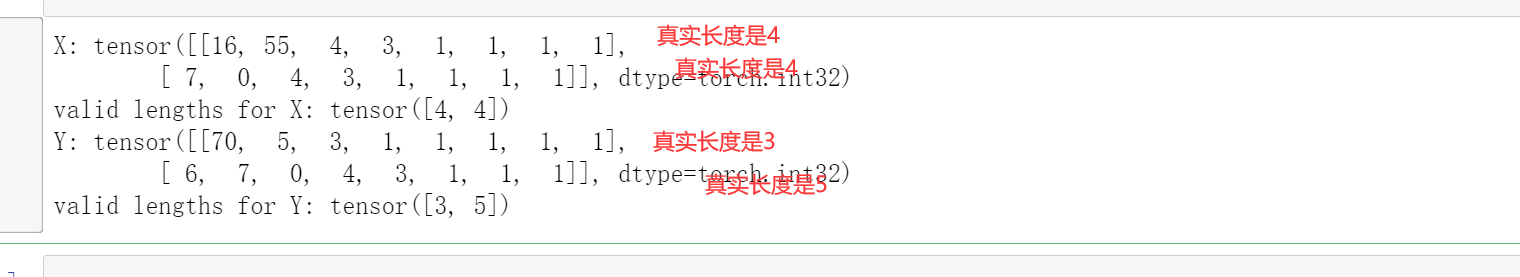

现在我们定义⼀个函数,可以将文本序列转换成小批量数据集用于训练。我们将特定的"<eos>"词元添加到所有序列的末尾,用于表示序列的结束。当模型通过⼀个词元接⼀个词元地生成序列进行预测时,生成的"<eos>"词元说明完成了序列输出工作。此外,我们还记录了每个文本序列的长度,统计长度时排除了填充词元,在稍后将要介绍的⼀些模型会需要这个长度信息。

def build_array_nmt(lines, vocab, num_steps):

"""将机器翻译的文本序列转换成小批量。"""

lines = [vocab[l] for l in lines]

lines = [l + [vocab['<eos>']] for l in lines]

array = torch.tensor([

truncate_pad(l, num_steps, vocab['<pad>']) for l in lines])

valid_len = (array != vocab['<pad>']).type(torch.int32).sum(1)

return array, valid_len #这里的valid_len是句子真实长度

训练模型

def load_data_nmt(batch_size, num_steps, num_examples=600):

"""返回翻译数据集的迭代器和词汇表。"""

text = preprocess_nmt(read_data_nmt())

source, target = tokenize_nmt(text, num_examples)

src_vocab = d2l.Vocab(source, min_freq=2,

reserved_tokens=['<pad>', '<bos>', '<eos>'])

tgt_vocab = d2l.Vocab(target, min_freq=2,

reserved_tokens=['<pad>', '<bos>', '<eos>'])

src_array, src_valid_len = build_array_nmt(source, src_vocab, num_steps)

tgt_array, tgt_valid_len = build_array_nmt(target, tgt_vocab, num_steps)

data_arrays = (src_array, src_valid_len, tgt_array, tgt_valid_len)

data_iter = d2l.load_array(data_arrays, batch_size)

return data_iter, src_vocab, tgt_vocab

train_iter, src_vocab, tgt_vocab = load_data_nmt(batch_size=2, num_steps=8)

for X, X_valid_len, Y, Y_valid_len in train_iter:

print('X:', X.type(torch.int32))

print('valid lengths for X:', X_valid_len)

print('Y:', Y.type(torch.int32))

print('valid lengths for Y:', Y_valid_len)

break

X: tensor([[16, 55, 4, 3, 1, 1, 1, 1],

[ 7, 0, 4, 3, 1, 1, 1, 1]], dtype=torch.int32)

valid lengths for X: tensor([4, 4])

Y: tensor([[70, 5, 3, 1, 1, 1, 1, 1],

[ 6, 7, 0, 4, 3, 1, 1, 1]], dtype=torch.int32)

valid lengths for Y: tensor([3, 5])s

下⾯我们读出“英语-法语”数据集中的第⼀个⼩批量数据。

总结

- 机器翻译指的是将文本序列从⼀种语言自动翻译成另⼀种语言。

- 使用单词级词元化时的词表大小,将明显大于使用字符级词元化时的词表大小。为了缓解这⼀问题,我们可以将低频词元视为相同的未知词元。

- 通过截断和填充文本序列,可以保证所有的⽂本序列都具有相同的⻓度,以便以⼩批量的方式加载。

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 震惊!C++程序真的从main开始吗?99%的程序员都答错了

· 别再用vector<bool>了!Google高级工程师:这可能是STL最大的设计失误

· 单元测试从入门到精通

· 【硬核科普】Trae如何「偷看」你的代码?零基础破解AI编程运行原理

· 上周热点回顾(3.3-3.9)