卷积神经网络-池化层

池化层

在现实生活中,如果我们拍摄黑白之间轮廓清晰的图像X,并将整个图像向右移动一个像素,即\(Z[i, j]=X[i, j + 1]\),则新图像Z的输出可能大不相同。而在现实中,随着拍摄角度的移动,任何物体几乎不可能发生在同一像素上。即使用三脚架拍摄一个静止的物体,由于快门的移动而引起的相机振动,可能会使所有物体左右移动一个像素(除了高端相机配备了特殊功能来解决这个问题)。

本节将介绍汇聚(pooling)层,它具有双重目的:

- 降低卷积层对位置的敏感性

- 同时降低对空间降采样表示的敏感性。

二维最大池化与平均池化层

与卷积层类似,汇聚层运算符由一个固定形状的窗口组成,该窗口根据其步幅大小在输入的所有区域上滑动,为固定形状窗口(有时称为汇聚窗口)遍历的每个位置计算一个输出。

与互相关运算符⼀样,池化窗口从输入张量的左上角开始,从左往右、从上往下的在输入张量内滑动。在汇聚窗口到达的每个位置,它计算该窗口中输入子张量的最大值或平均值。计算最大值或平均值是取决于使用了最大汇聚层还是平均汇聚层。

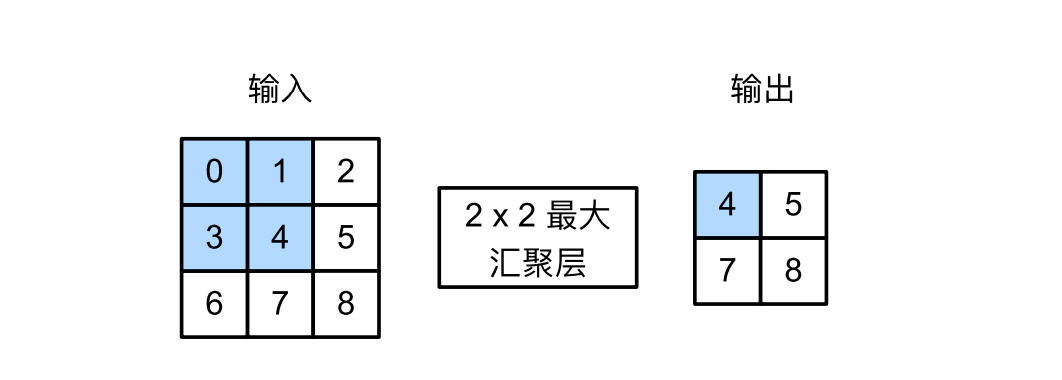

例如:二维最大池化层

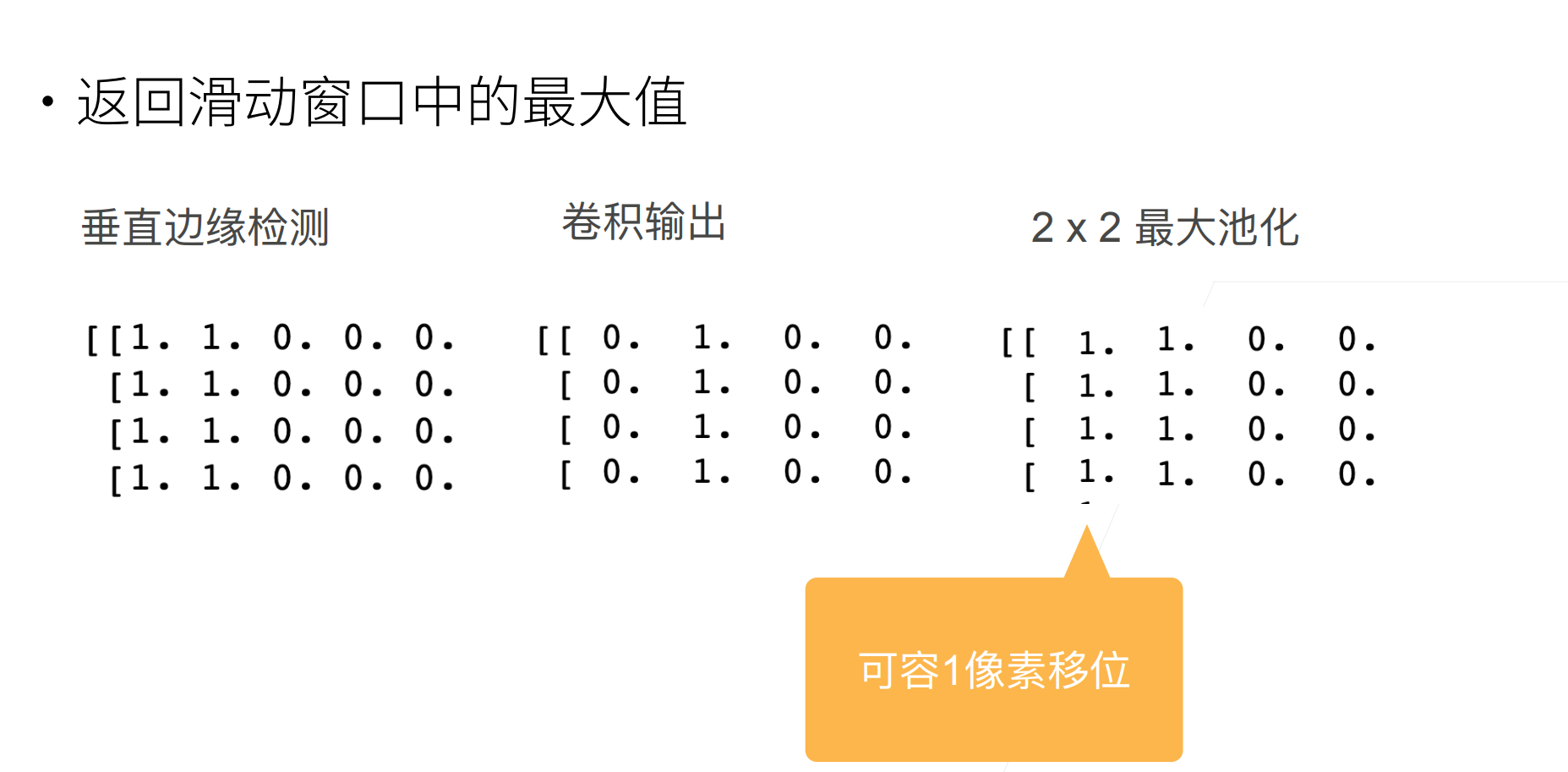

返回滑动窗口中的最大值

的输出张量的高度为2,宽度为2。这四个元素为每个汇聚窗口中的最大值:

现在假设我们使用卷积层的输出作为2 × 2最大汇聚的输入。设置卷积层输入为X,汇聚层输出为Y。无论\(X[i,j]和X[i,j+1]\)的值相同与否,或\(X[i,j+1]\)和\(X[i, j+2]\)的值相同与否,汇聚层始终输出\(Y[i,j] = 1\)。也就是说,使用2 × 2最大汇聚层,即使在高度或宽度上移动⼀个元素,卷积层仍然可以识别到模式。

- 池化层与卷积层类似,都具有填充和步幅

- 没有可学习的参数

- 在每个输入通道应用池化层以获得相应的输出通道

- 输出通道数=输入通道数

代码实现

实现汇聚层的正向传播

import torch

from torch import nn

from d2l import torch as d2l

def pool2d(X, pool_size, mode='max'):

p_h, p_w = pool_size

Y = torch.zeros((X.shape[0] - p_h + 1, X.shape[1] - p_w + 1))

for i in range(Y.shape[0]):

for j in range(Y.shape[1]):

if mode == 'max':

Y[i, j] = X[i:i + p_h, j:j + p_w].max()

elif mode == 'avg':

Y[i, j] = X[i:i + p_h, j:j + p_w].mean()

return Y

验证二维最大汇聚层的输出。

X = torch.tensor([[0.0, 1.0, 2.0], [3.0, 4.0, 5.0], [6.0, 7.0, 8.0]])

pool2d(X, (2, 2))

# tensor([[4., 5.],

# [7., 8.]])

验证平均汇聚层

pool2d(X, (2, 2), 'avg')

# tensor([[2., 3.],

# [5., 6.]])

填充和步幅

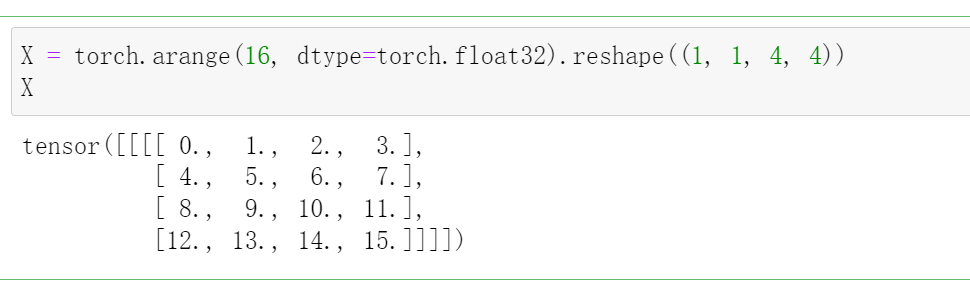

与卷积层一样,汇聚层也可以改变输出形状。和以前⼀样,我们可以通过填充和步幅以获得所需的输出形状。下面,我们用深度学习框架中内置的⼆维最大汇聚层,来演示汇聚层中填充和步幅的使用。我们首先构造了⼀个输入张量X,它有四个维度,其中样本数和通道数都是1。

X = torch.arange(16, dtype=torch.float32).reshape((1, 1, 4, 4))

X

默认情况下,深度学习框架中的步幅与汇聚窗口的大小相同。因此,如果我们使用形状为(3, 3)的汇聚窗口,那么默认情况下,我们得到的步幅形状为(3, 3)。

pool2d = nn.MaxPool2d(3)

pool2d(X)

# tensor([[[[10.]]]])

填充和步幅可以手动设定。

pool2d = nn.MaxPool2d(3, padding=1, stride=2)

pool2d(X)

# tensor([[[[ 5., 7.],

# [13., 15.]]]])

设定一个任意大小的矩形池化窗口,并分别设定填充和步幅的高度和宽度

pool2d = nn.MaxPool2d((2, 3), padding=(1, 1), stride=(2, 3))

pool2d(X)

# tensor([[[[ 1., 3.],

# [ 9., 11.],

# [13., 15.]]]])

这个先是上下后是左右

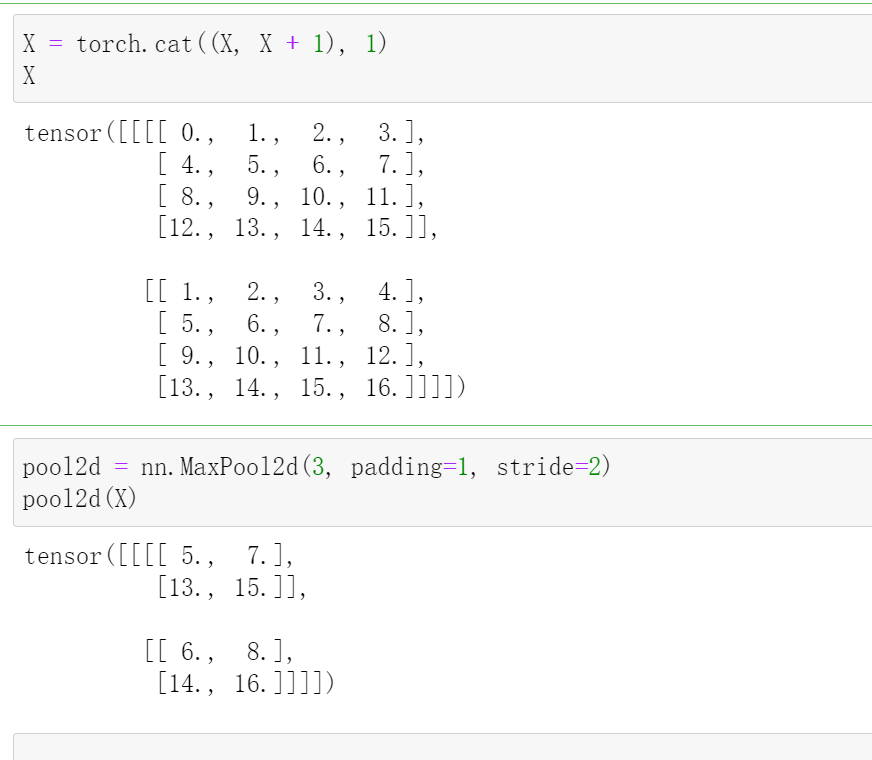

多个通道

在处理多通道输入数据时,汇聚层在每个输入通道上单独运算,而不是像卷积层⼀样在通道上对输入进行汇总。这意味着汇聚层的输出通道数与输⼊通道数相同。下面,我们将在通道维度上连结张量X和X + 1,以构建具有2个通道的输入。

X = torch.cat((X, X + 1), 1)

X

pool2d = nn.MaxPool2d(3, padding=1, stride=2)

pool2d(X)

浙公网安备 33010602011771号

浙公网安备 33010602011771号