在Ubuntu上安装d4rl

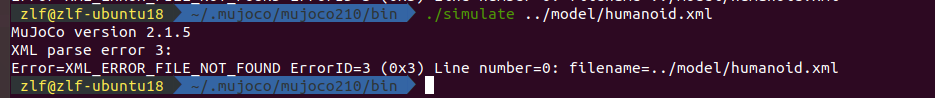

在安装好mujoco,mujoco_py的基础上,安装d4rl,D4RL的github:https://github.com/rail-berkeley/d4rl 有介绍安装方法,但直接安装会报各种错误。

1.先安装两个库文件,避免报错 pip install absl-py pip install matplotlib

2.安装 dm_control pip install dm_control ,如果不先安装dm_control,会报错:

3. 克隆D4RL仓库:

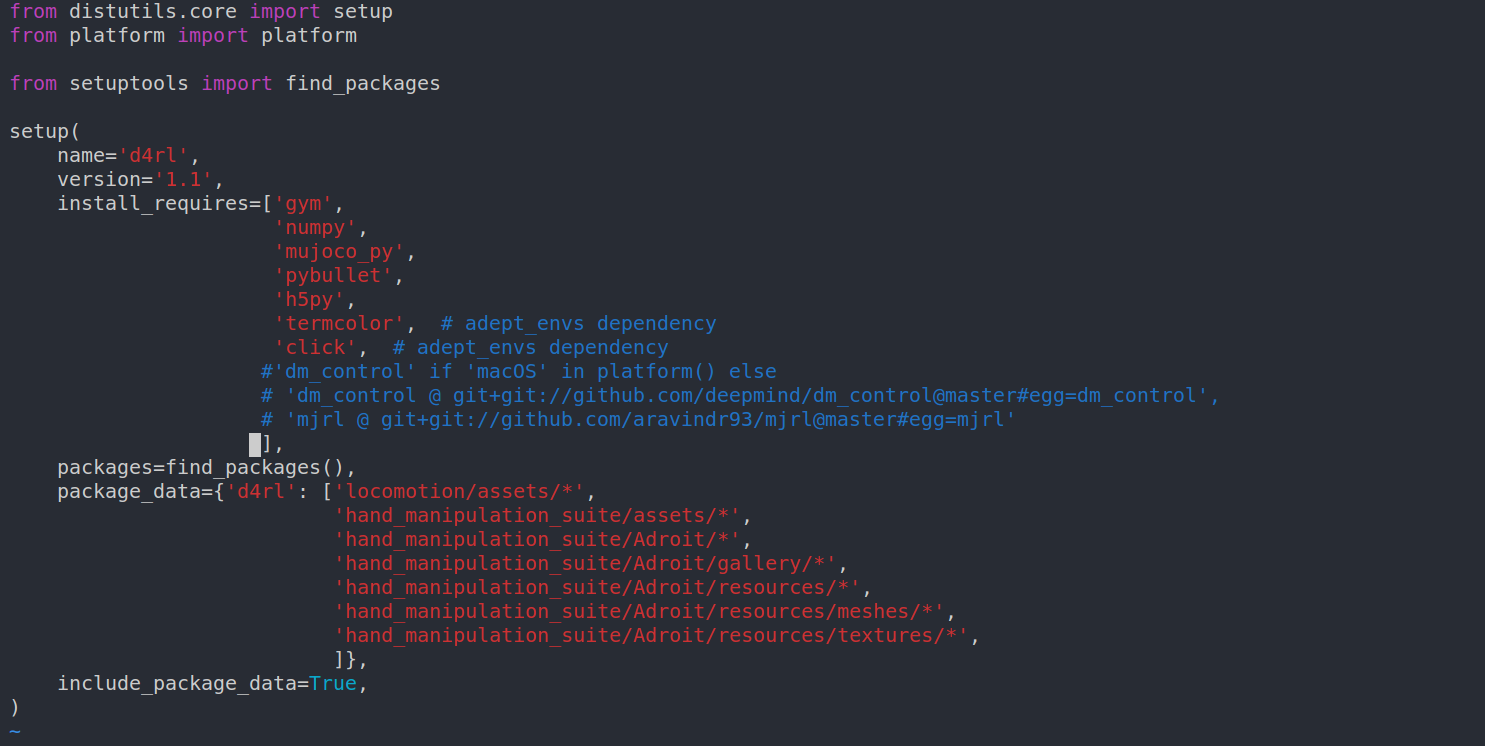

git clone https://github.com/rail-berkeley/d4rl.git4.找到d4rl目录下的setup.py文件,注释mujoco_py, dm_control, mjrl:

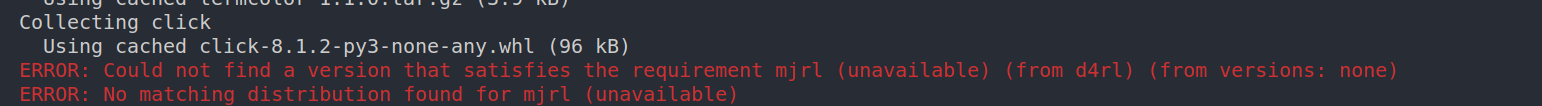

注意一定要注释掉mjrl,否则会报错:

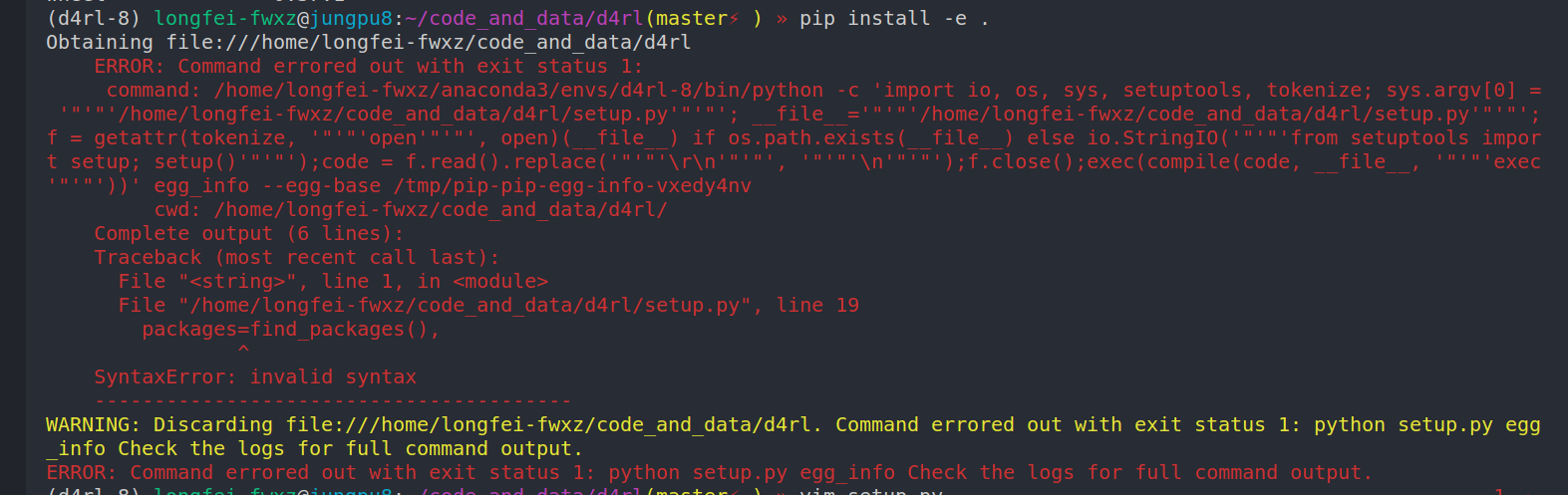

注意注释掉mjrl时要保留 原本的 "]", 否则会报错:

5. 安装:

pip install -e .

6.安装mjrl : pip install git+https://github.com/aravindr93/mjrl@master#egg=mjrl

7. 测试:

import gym

import d4rl # Import required to register environments

# Create the environment

env = gym.make('maze2d-umaze-v1')

# d4rl abides by the OpenAI gym interface

env.reset()

env.step(env.action_space.sample())

# Each task is associated with a dataset

# dataset contains observations, actions, rewards, terminals, and infos

dataset = env.get_dataset()

print(dataset['observations']) # An N x dim_observation Numpy array of observations

# Alternatively, use d4rl.qlearning_dataset which

# also adds next_observations.

dataset = d4rl.qlearning_dataset(env)

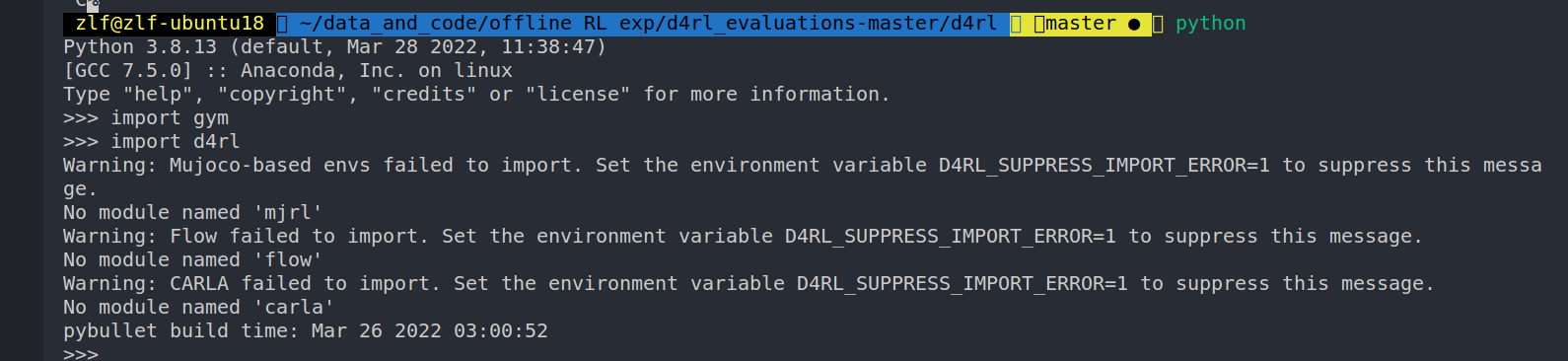

8. 最终效果:

注意:部分博客中指出要继续安装gym,但经测试,我们的方法已安装了gym,无需再安装。

参考文献:

1. 离线强化学习(Offline RL)系列2: (环境篇)D4RL数据集简介、安装及错误解决 ( https://zhuanlan.zhihu.com/p/489475047)

2. 安装Mujoco、Mujoco_py、D4RL、gym、d3rlpy以及Pycharm远程连接服务器问题 (https://zhuanlan.zhihu.com/p/434073300)