深度学习基础(一)神经网络 分类: 深度学习 2015-01-19 21:29 84人阅读 评论(0) 收藏

由生物学基础我们知道,神经网络是有无数个神经元和连接这些神经元的突触构成的,某个神经元接受一系列的电信号刺激,当这个刺激达到一定的阀值后,这个神经元就被激活,通过突触将某些信息传递给下一个神经元。每个神经元可以看成是一个激活函数(activation function),输入值为强度大小不同的电刺激,输出值为传递给下一个神经元的刺激。

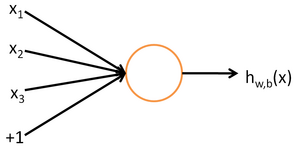

我们先来看神经网络最简单的形式,神经元。

输入:

x1,x2,x3 和 +1

输出:

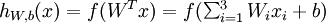

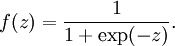

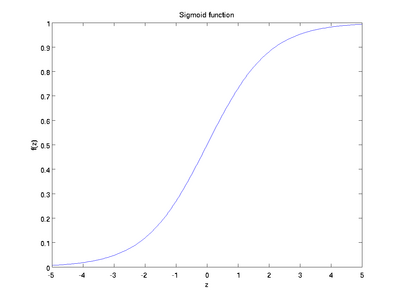

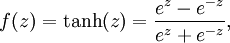

最常见的激活函数形式有:

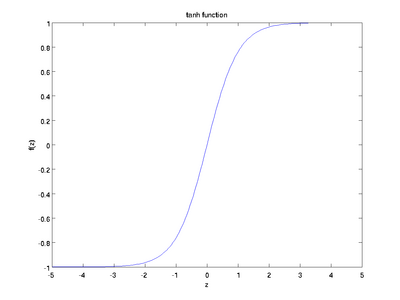

神经网络由多个神经元组成:

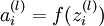

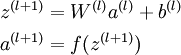

为了方便表示,我们定义一些符号:

nl:神经网络的层数 Ll为输入层

为输出层

为输出层

:是第l层的第j个单元与第l+1层的第i个单元之间的参数

:是第l层的第j个单元与第l+1层的第i个单元之间的参数

:表示的是第l层的第i个单元被激活(激活函数的输出值) l=1时候代表输入值x

:表示的是第l层的第i个单元被激活(激活函数的输出值) l=1时候代表输入值x

:表示的是第l层的第i个单元的所有输入值

:表示的是第l层的第i个单元的所有输入值

.

.

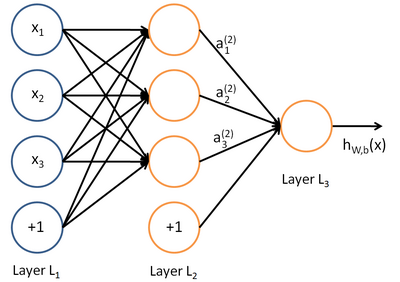

于是我们有:

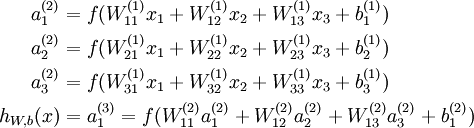

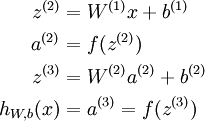

将z向量化表示后:

最后化简得到:

这个就是所谓的向前传导(forward propagation),可以理解为刺激由左往右逐层传递,最后输出一个值。

参考资料http://deeplearning.stanford.edu/wiki/index.php/UFLDL_Tutorial

版权声明:本文为博主原创文章,未经博主允许不得转载。