Redis笔记

Redis

笔记参考:B站,狂神说Java

链接:https://www.bilibili.com/video/BV1S54y1R7SB?p=1

Nosql概述

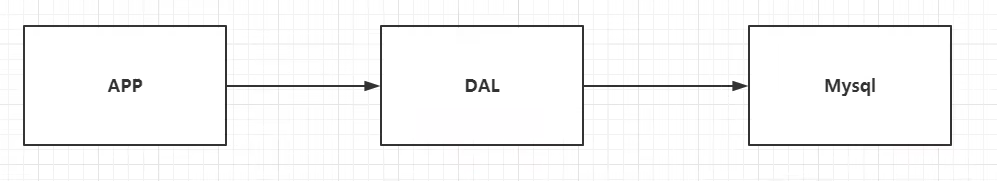

1、单机MySQL的年代

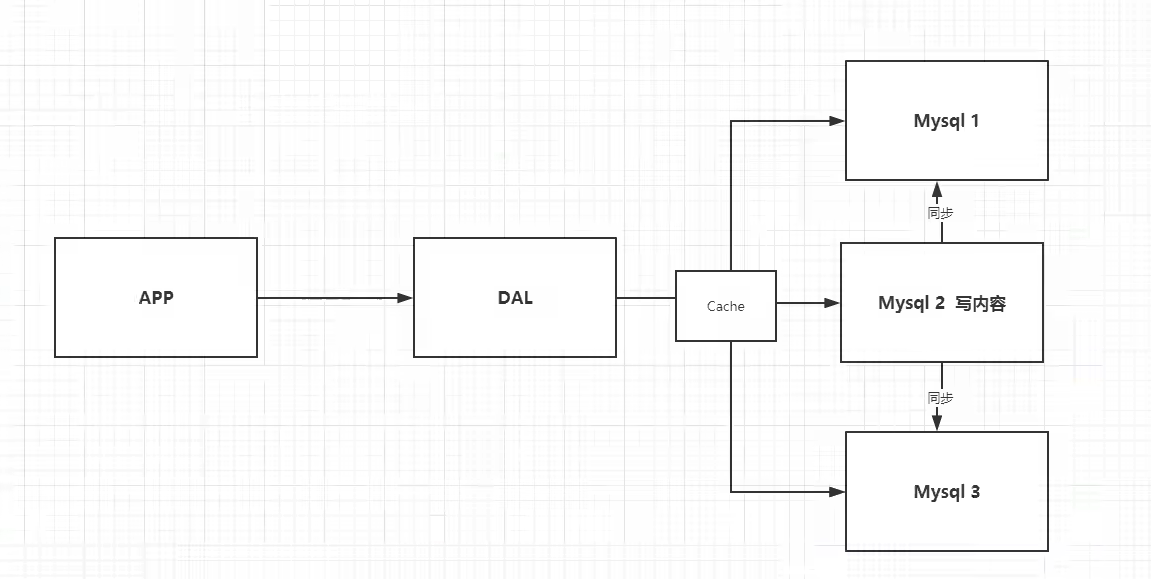

2、Memcached (缓存) + MySQL +垂直拆分

什么是NoSQL

NoSQL

NoSQL=Not Only SQL(不仅仅是SQL)

泛指非关系型数据库的,随着web2.0互联网的诞生!,传统的关系型数据库很难对付web2.0时代!

NoSQL特点

解耦!

1、方便扩展(数据之间没有关系,很好扩展! )

2、大数据量高性能( Redis 一秒写8万次,读取11万,NoSQL的缓存记录级,是一种细粒度的缓存,性能会比较高!)

3、数据类型是多样型的!(不需要事先设计数据库!随取随用!如果是数据量十分大的表,很多人就无法设计了!)

4、传统RDBMS和NoSQL

传统的RDBMS - 结构化组织 - SQL - 数据和关系都存在单独的表中 - 操作操作,数据定义语言 - 严格的一致性 - 基础的事务 - ......

Nosql - 不仅仅是数据 - 没有固定的查询语言 - 键值对存储,列存储,文档存储,图形数据库(社交关系) - 最终一致性 - CAP定理和BASE (异地多活)初级 架构师! - 高性能,高可用,高可扩 -

了解:3V+3高

大数据时代的3V:主要是描述问题的

- 海量Volume

- 多样Variety

- 实时Velocity

大数据时代的3高:主要是对程序的要求

- 高并发

- 高可扩

- 高性能

NoSQL的四大分类

KV键值对

-

新浪:Redis

-

美团:Redis+Tair

-

阿里、百度: Redis + memecache

文档型数据库( bson格式和json一样)

-

MongoDB(一般必须要掌握)

- MongoDB是一个基于分布式文件存储的数据库, C++编写,主要用来处理大量的文档!

- MongoDB是一个介于关系型数据库和非关系型数据中中间的产品!MongoDB是非关系型数据库中功能最丰富,最像关系型数据库的!

-

ConthDB

列存储数据库

- HBase

- 分布式文件系统

图关系数据库

-

他不是存图形,放的是关系,比如:朋友圈社交网络,广告推荐!

-

Neo4j, InfoGrid ;

Redis入门

概述

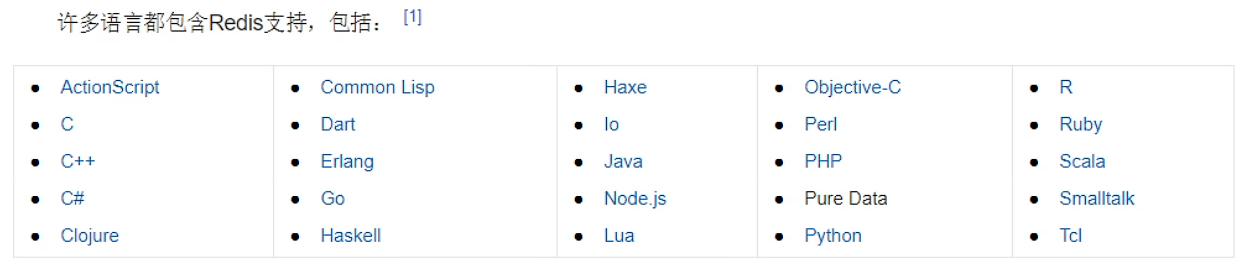

Redis(Remote Dictionary Server ),即远程字典服务,是一个开源的使用ANSI C语言编写、支持网络、可基于内存亦可持久化的日志型、Key-Value数据库,并提供多种语言的API。

Redis能干嘛?

1、内存存储、持久化,内存中是断电即失、所以说持久化很重要( rdb、 aof)

2、效率高,可以用于高速缓存

3、发布订阅系统

4、地图信息分析

5、计时器、计数器(浏览量!)

6、......

特性

1、多样的数据类型

2、持久化

3、集群

4、事务

......

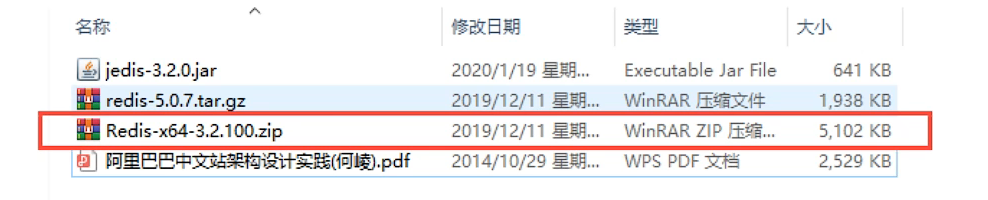

Redis下载

中文网: http://www.redis.cn/

Windows安装

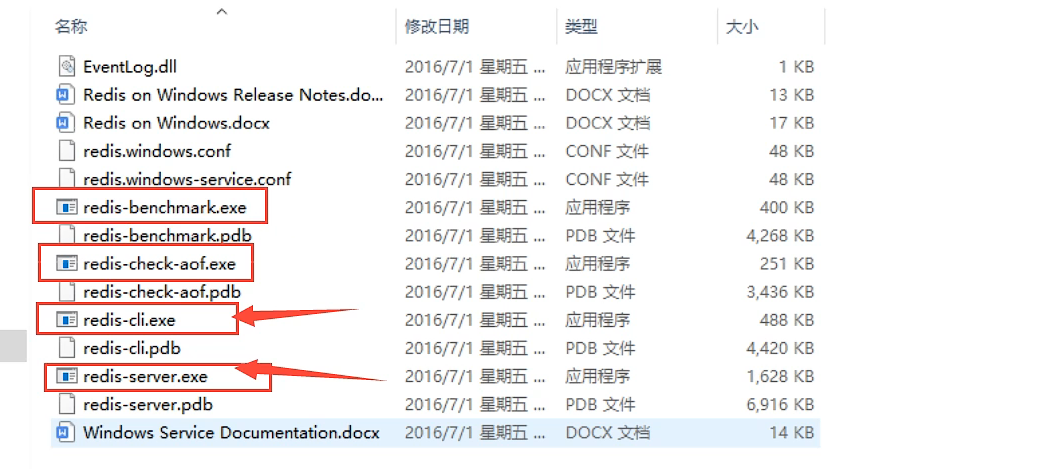

1、下载安装包: https://github.com/dmajkic/redis/releases

2、下载完毕得到压缩包:

3、解压到自己电脑上的环境目录下的就可以的!Redis十分的小,只有5M

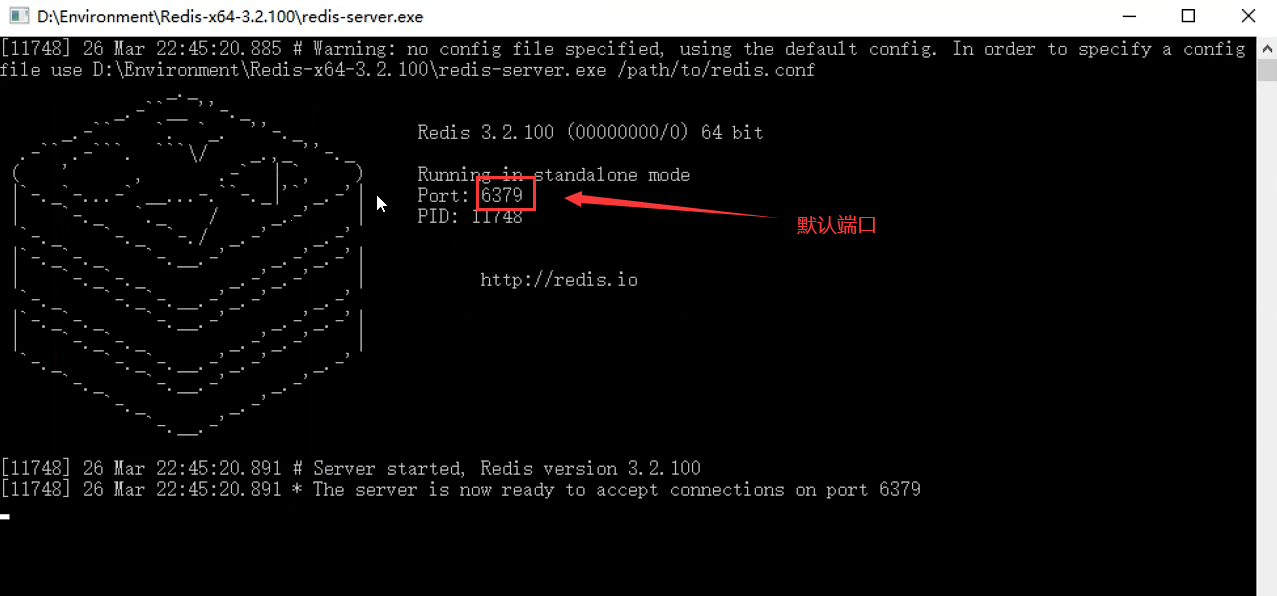

4、开启Redis,双击运行服务(redis-server.exe)即可!

默认端口:6379

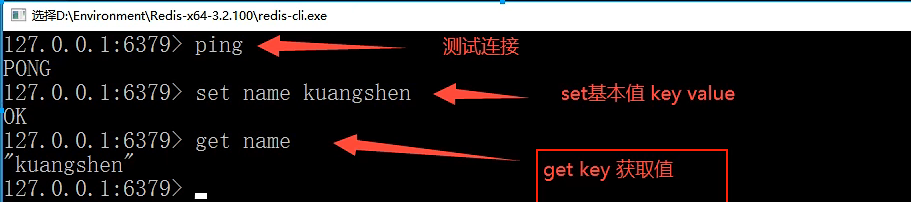

5、使用redis客户端来连接redis(双击redis-cli.exe)

记住一句话,Window下使用确实简单,但是Redis推荐我们使用Linux去开发使用!

Linux安装

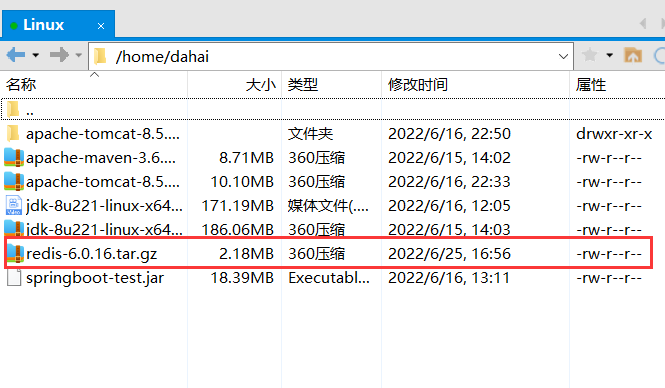

1、下载安装包!

2、上传到云服务器

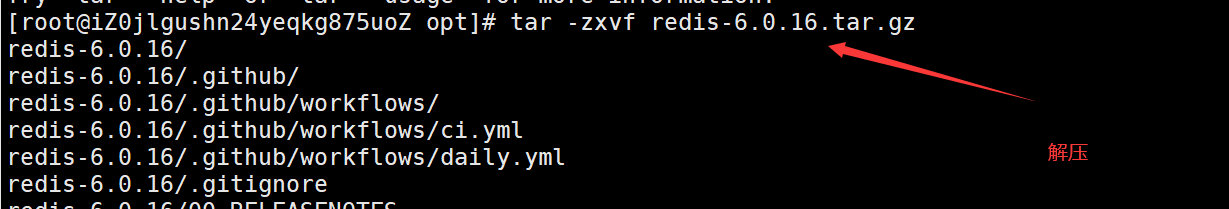

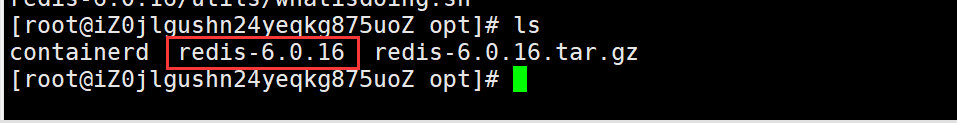

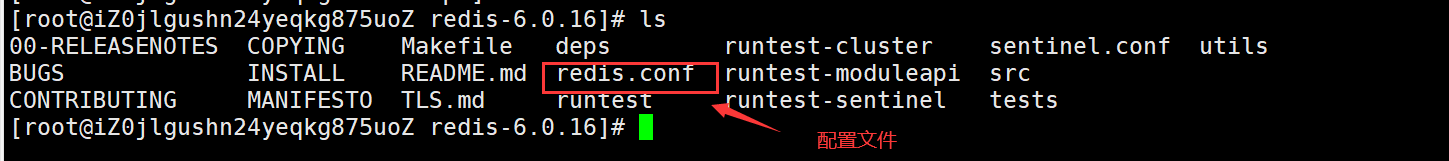

3、进入解压后的文件

可以看到我们redis的配置文件

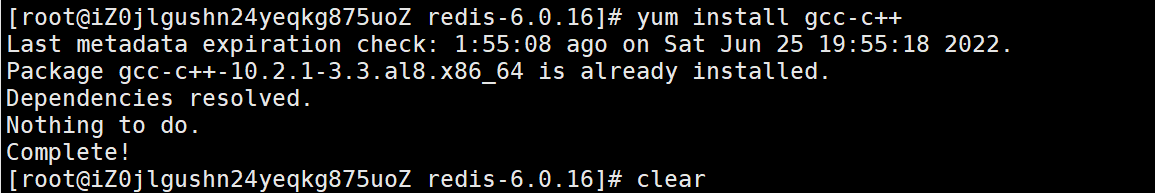

4、基本的环境安装

# 第一步 yum install gcc-c++ # 第二步 make命令 make

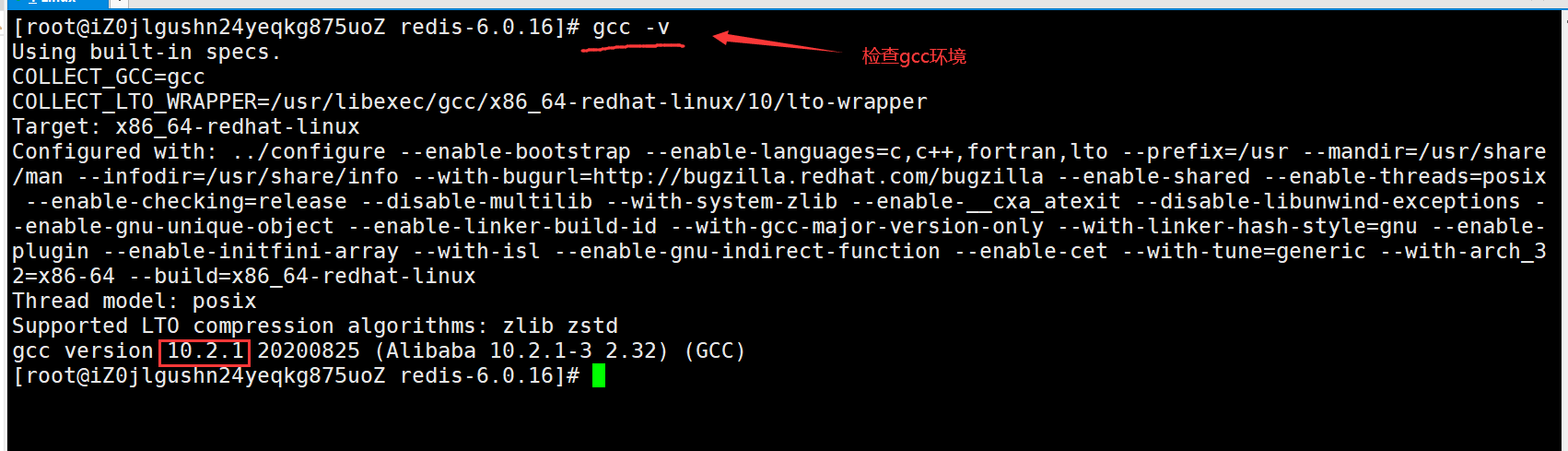

5、检查gcc版本

6、执行make命令

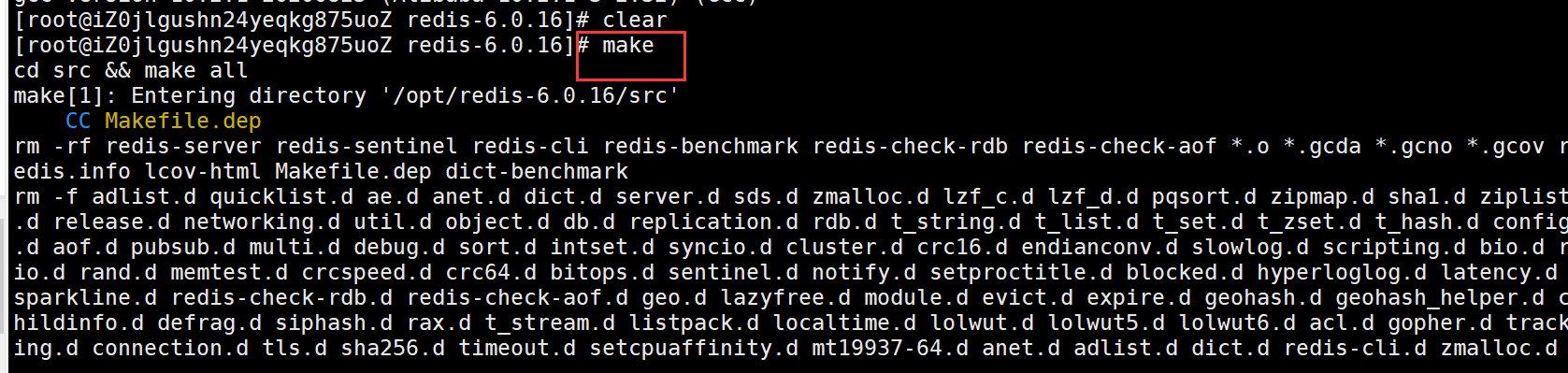

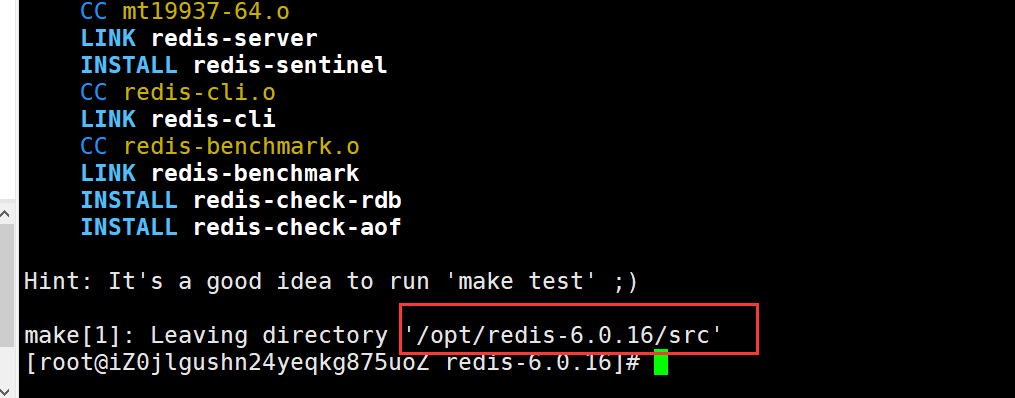

6、执行make命令

执行完毕(需要一点时间进行下载)

执行完毕(需要一点时间进行下载)

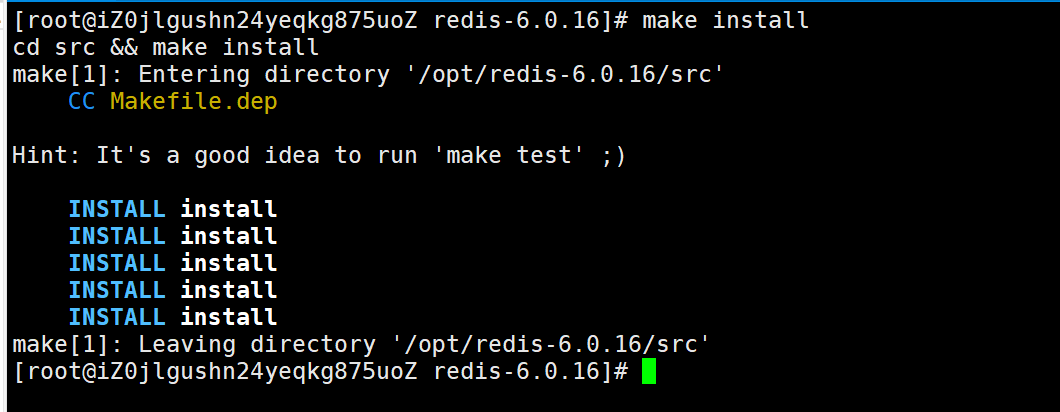

7、然后make install

make install

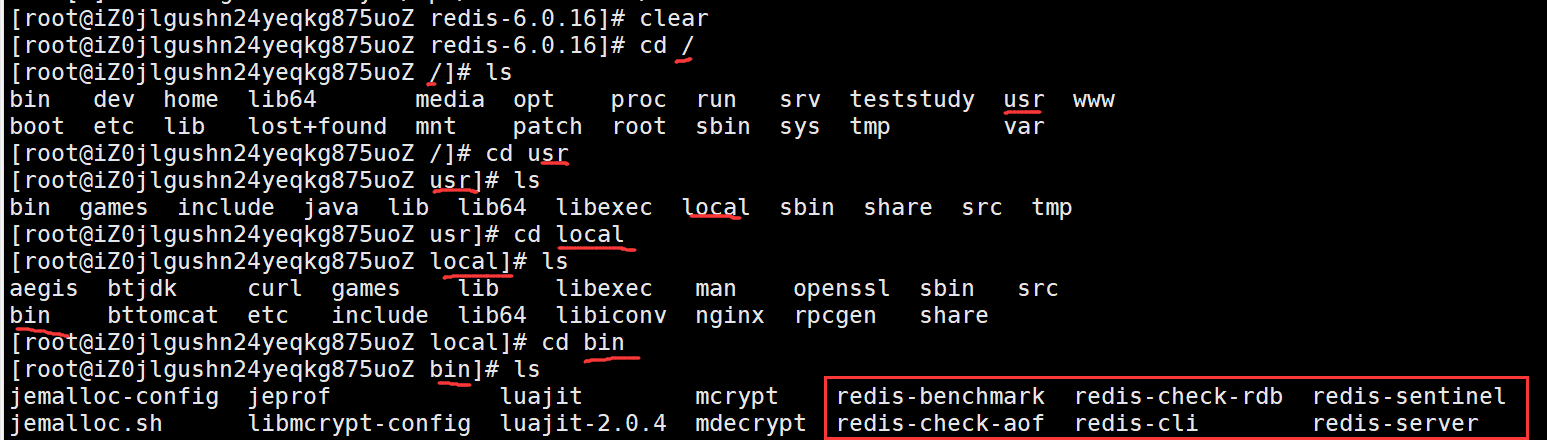

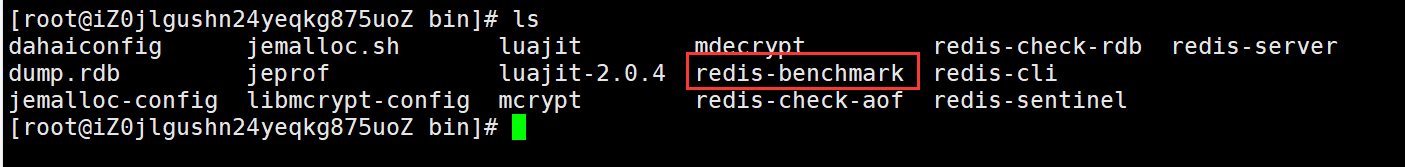

# Redisd在Linux的默认安装路径是:/usr/local/bin

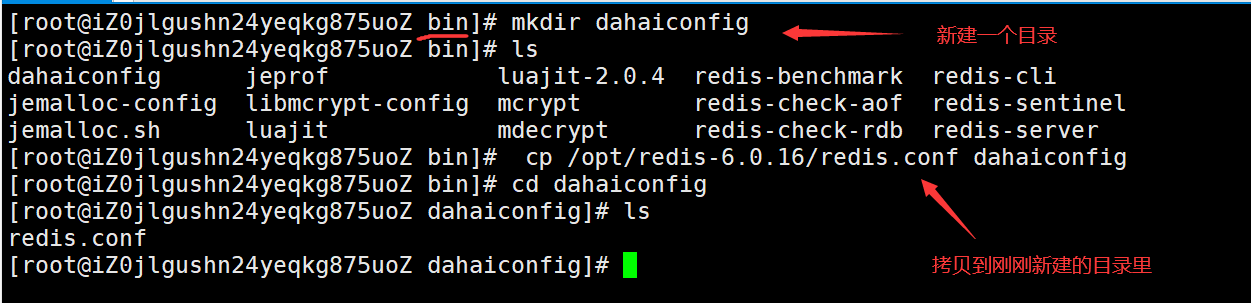

8、将redis配置文件。复制到我们当前目录下

8、将redis配置文件。复制到我们当前目录下

(我们以后就用新建目录下的redis.config的配置文件进行启动)

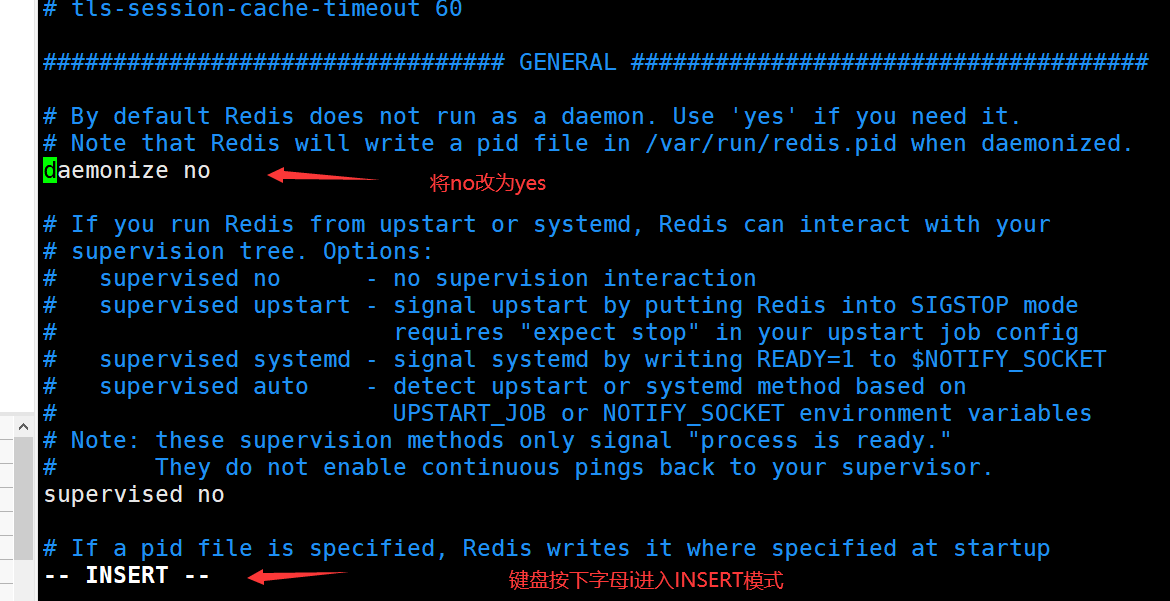

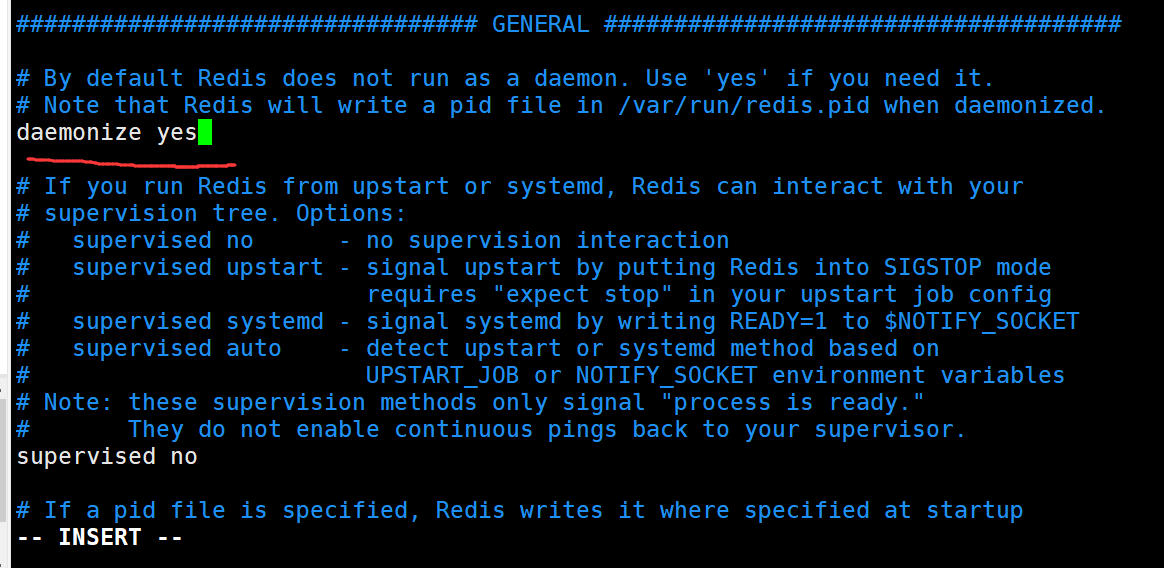

9、修改redis为后台运行

注意:redis默认不是后台启动,我们需要修改配置文件!

按下ESC退出insert模式,输入:wq(保存并退出)

这样redis就会默认在后台运行了

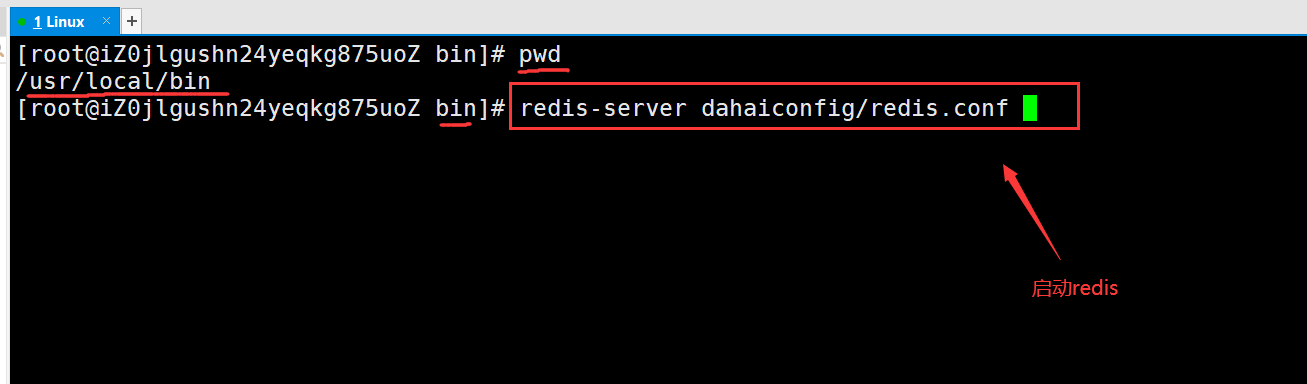

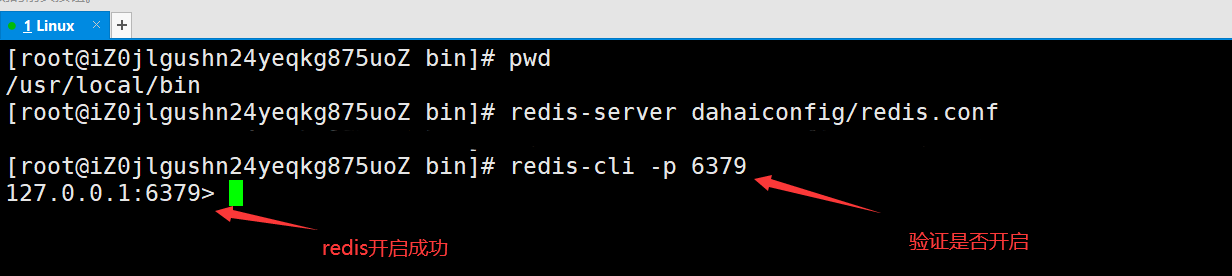

10、启动redis服务

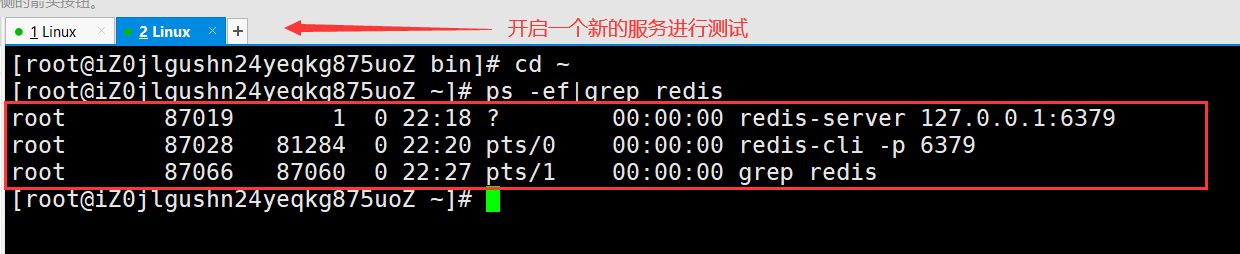

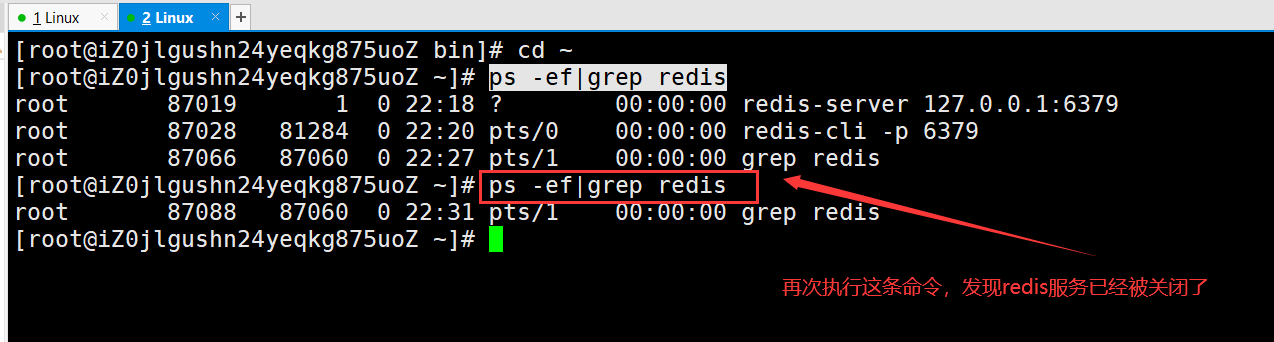

查看redis的进程是否开启!

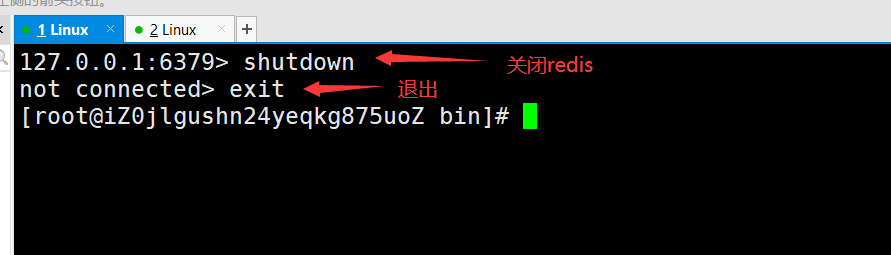

11、关闭redis服务

后面我们会使用单机多Redis启动集群测试!

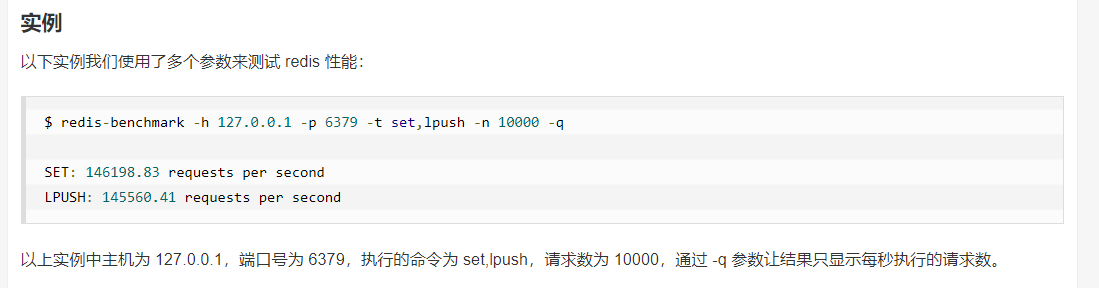

测试性能

redis-benchmark是一个压力测试工具!

官方自带的性能测试工具!

redis 性能测试工具可选参数如下所示:

测试一下

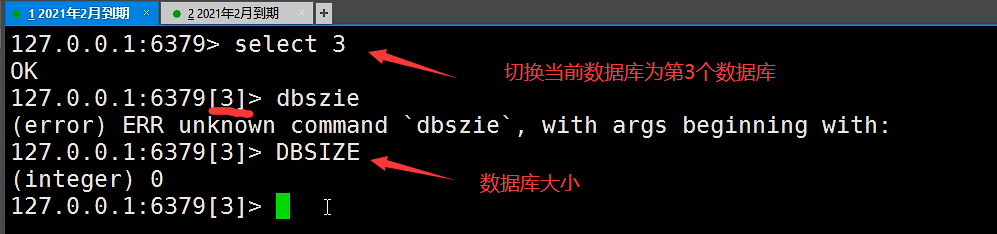

基础知识

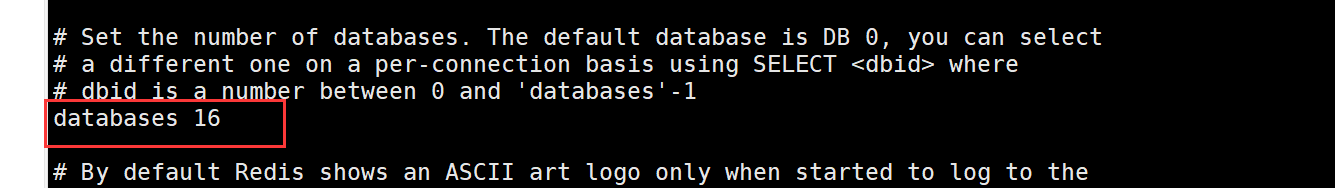

redis默认有16个数据库

默认使用第0号数据库

切换数据库

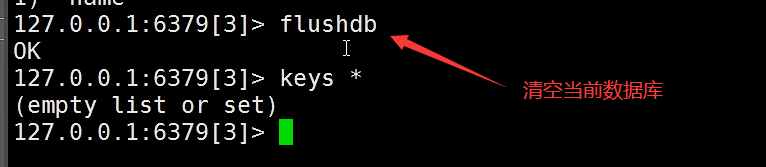

清空当前数据库

flushdb

清空所有数据库

flushall

Redis是单线程的!

明白Redis是很快的,官方表示,Redis是基于内存操作,CPU不是Redis性能瓶颈,Redis的瓶颈是根据机器的内存和网络带宽,既然可以使用单线程来实现,就使用单线程了!

Redis是C语言写的,官方提供的数据为100000+ 的QPS ,这可不比同样使用key-vale的Memecache差!

Redis为什么单线程还这么快?

- 误区1:高性能的服务器一定是多线程的?

- 误区2:多线程( CPU上下文会切换!)一定比单线程效率高?

核心:redis是将所有的数据全部放在内存中的,所以说使用单线程去操作效率就是最高的,多线程(CPU上下文会切换:耗时的操作!!!),对于内存系统来说,如果没有上下文切换效率就是最高的!多次读写都是在一个CPU上的,在内存情况下,这个就是最佳的方案!

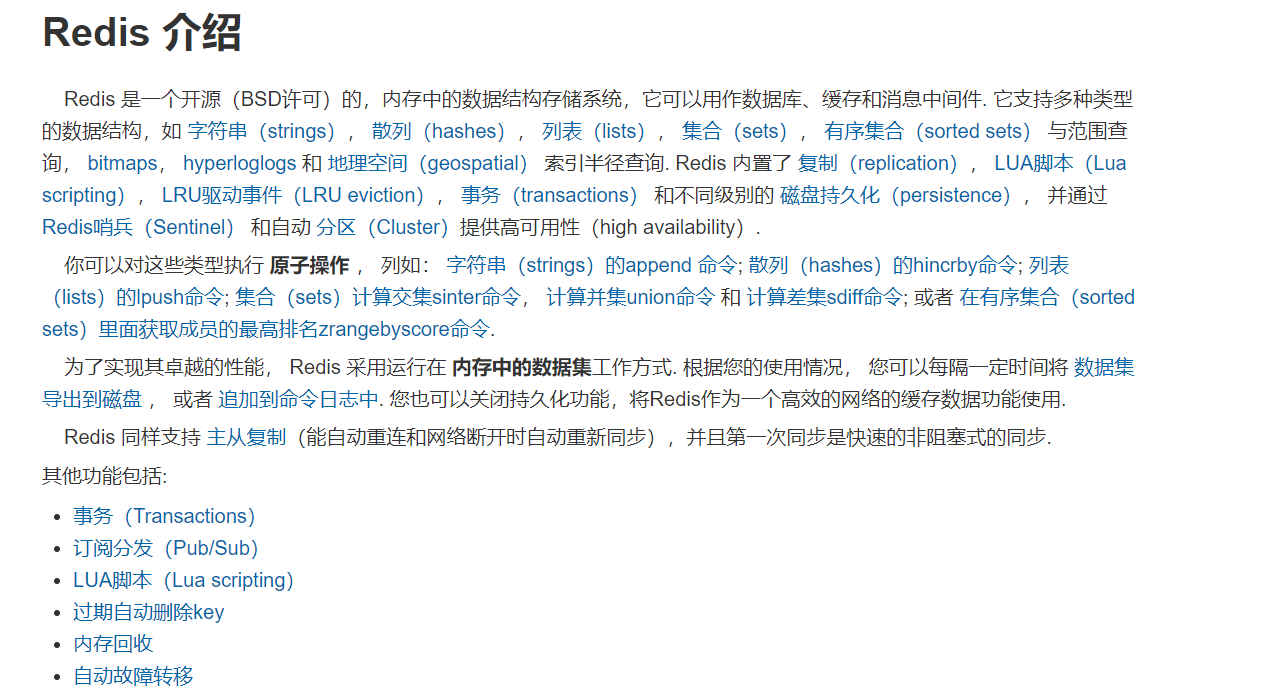

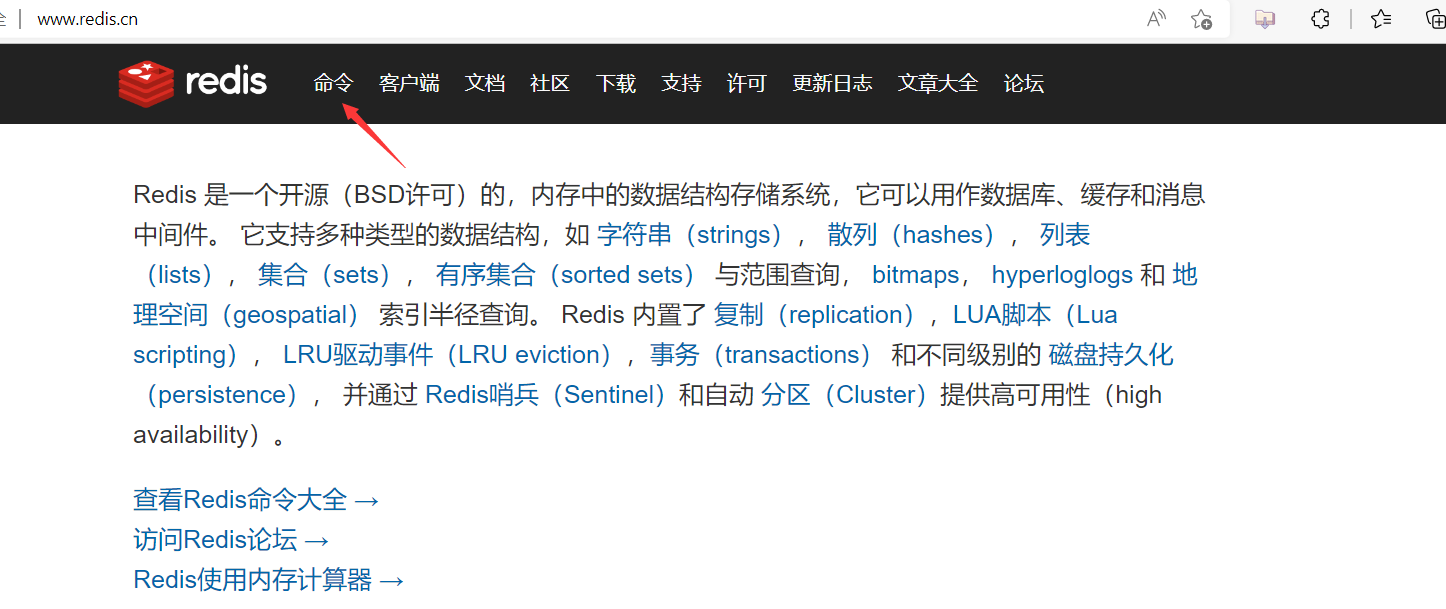

五大数据类型

Redis 是一个开源(BSD许可)的,内存中的数据结构存储系统,它可以用作数据库、缓存和消息中间件。 它支持多种类型的数据结构,如 字符串(strings), 散列(hashes), 列表(lists), 集合(sets), 有序集合(sorted sets) 与范围查询, bitmaps, hyperloglogs 和 地理空间(geospatial) 索引半径查询。 Redis 内置了 复制(replication),LUA脚本(Lua scripting), LRU驱动事件(LRU eviction),事务(transactions) 和不同级别的 磁盘持久化(persistence), 并通过 Redis哨兵(Sentinel)和自动 分区(Cluster)提供高可用性(high availability)。

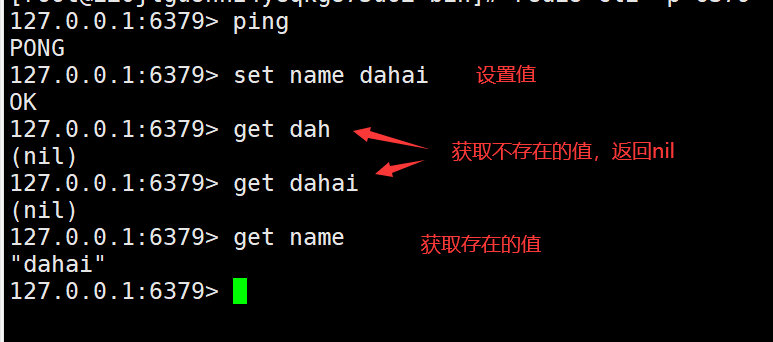

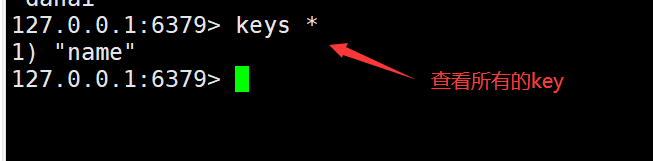

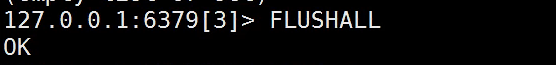

Redis-Key

# 查看所有的key keys * # 检查是否存在[key] exists [key] # 移除[key] move [key]

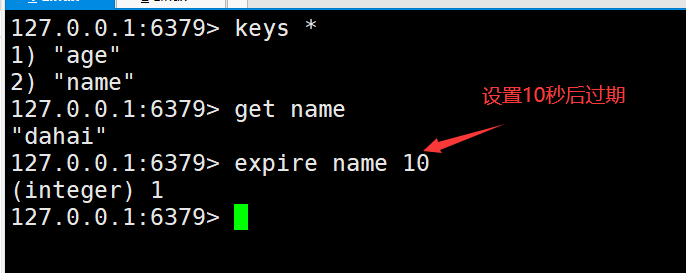

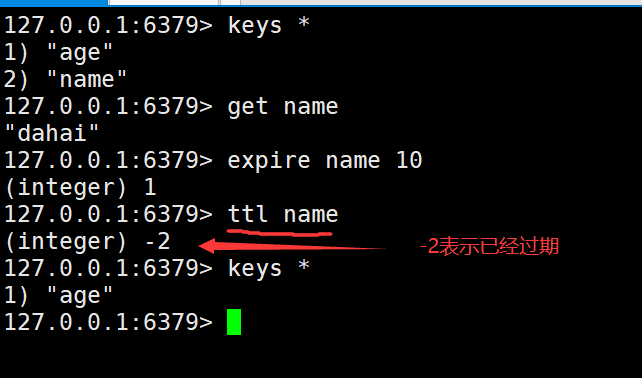

单点登录,设置过期时间

# 为[key]设置过期时间 expire [key] [second] # 查看[key]设置过期时间的倒计时 ttl [key]

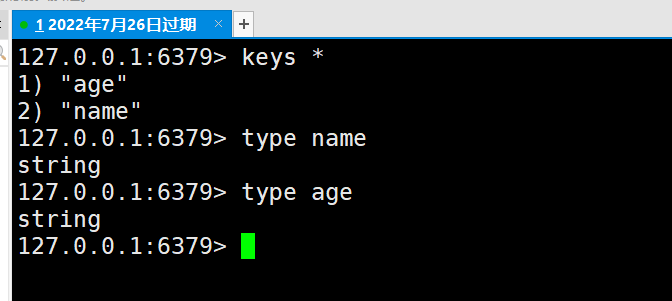

查看当前key类型

127.0.0.1:6379> keys * 1) "age" 2) "name" 127.0.0.1:6379> type name string 127.0.0.1:6379> type age string

后面遇到不会的命令可以在官网上查找帮助文档

中文网: http://www.redis.cn/

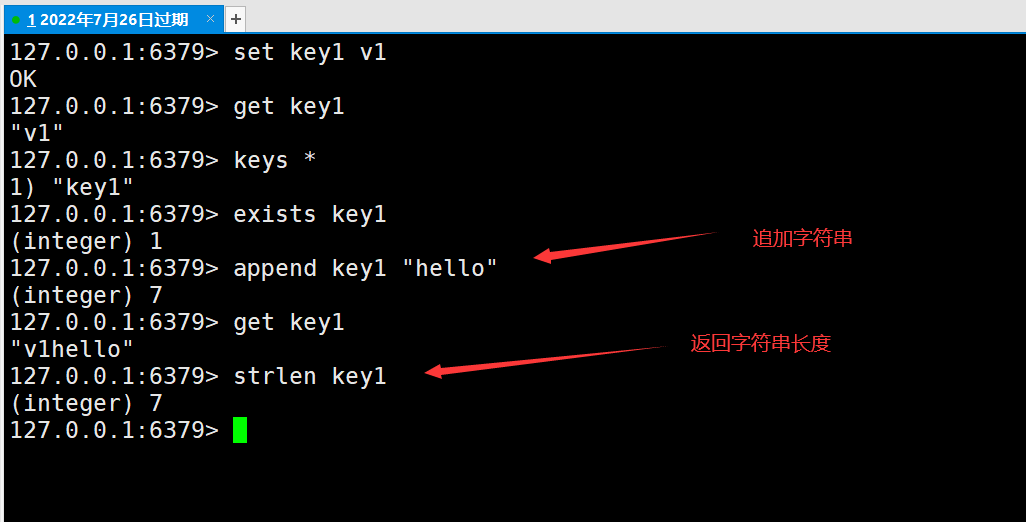

String(字符串)

追加字符串

127.0.0.1:6379> set key1 v1 OK 127.0.0.1:6379> get key1 "v1" 127.0.0.1:6379> keys * 1) "key1" 127.0.0.1:6379> exists key1 (integer) 1 127.0.0.1:6379> append key1 "hello" (integer) 7 127.0.0.1:6379> get key1 "v1hello" 127.0.0.1:6379> strlen key1 (integer) 7

对不存在的字符串,进行追加字符串

127.0.0.1:6379> append name dahai (integer) 5 127.0.0.1:6379> keys * 1) "key1" 2) "name" 127.0.0.1:6379> get name "dahai"

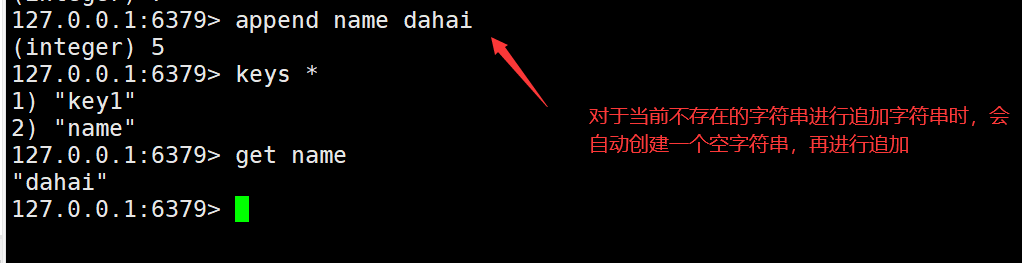

增加,减少操作

和java的i++(自增)有点像

127.0.0.1:6379> set views 0 OK 127.0.0.1:6379> type views string 127.0.0.1:6379> get views "0" 127.0.0.1:6379> incr views (integer) 1 127.0.0.1:6379> get views "1" 127.0.0.1:6379> incr views (integer) 2 127.0.0.1:6379> get views "2" 127.0.0.1:6379> decr views (integer) 1 127.0.0.1:6379> get views "1" 127.0.0.1:6379> incrby views 10 (integer) 11 127.0.0.1:6379> incrby views 5 (integer) 16 127.0.0.1:6379> decrby views 9 (integer) 7 127.0.0.1:6379>

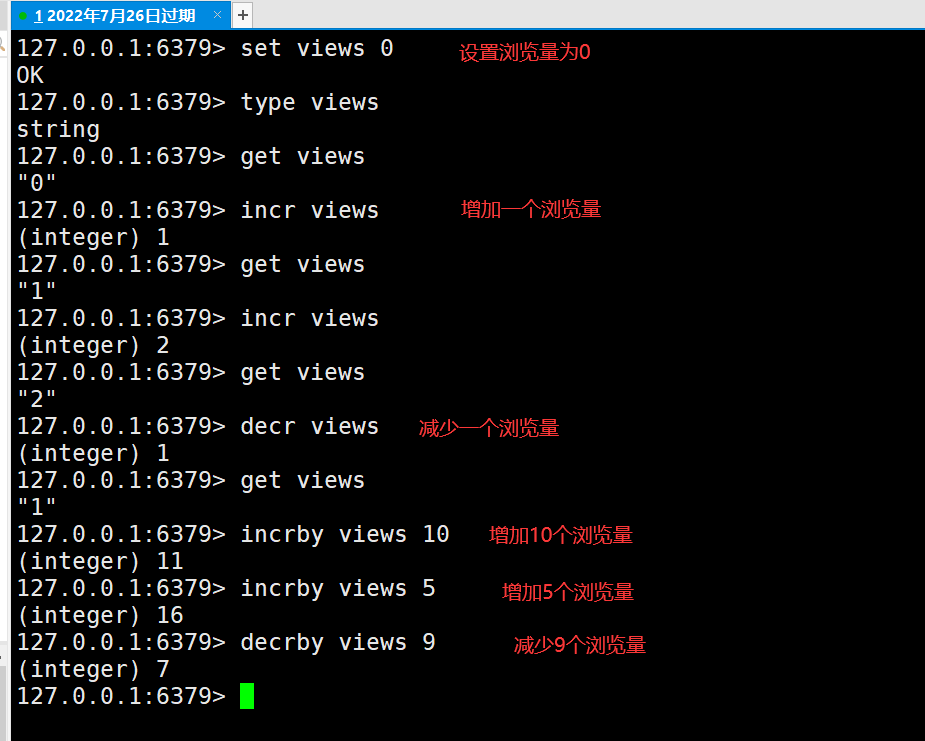

字符串范围

提取

getrang

127.0.0.1:6379> set key1 "hello,world!" OK 127.0.0.1:6379> get key1 "hello,world!" 127.0.0.1:6379> getrange key1 0 4 "hello" 127.0.0.1:6379> getrange key1 0 -1 "hello,world!"

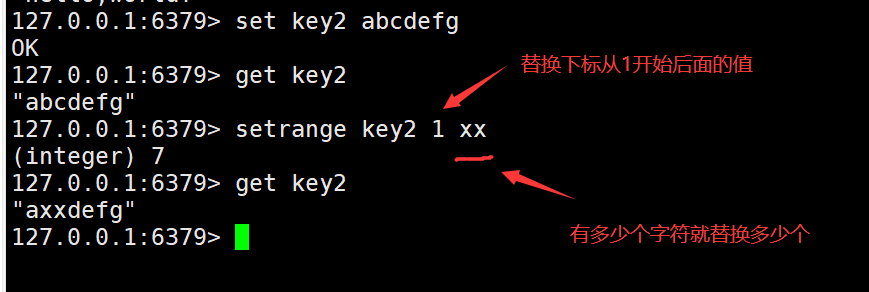

替换

127.0.0.1:6379> set key2 abcdefg OK 127.0.0.1:6379> get key2 "abcdefg" 127.0.0.1:6379> setrange key2 1 xx (integer) 7 127.0.0.1:6379> get key2 "axxdefg"

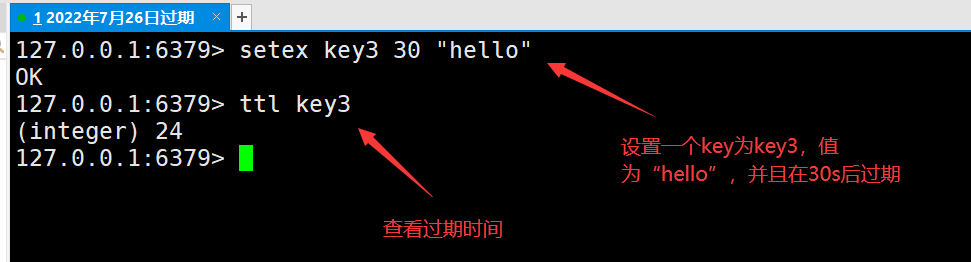

过期时间

设置过期时间

setex(set with expire)

127.0.0.1:6379> setex key3 30 "hello" OK 127.0.0.1:6379> ttl key3 (integer) 24

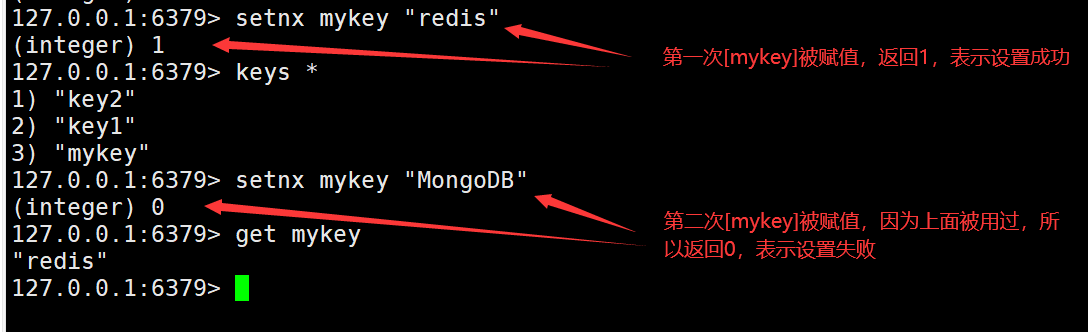

不存在再设置

如果这个[key]没有被用过,才会去设置,否则会失败(在分布式锁中会常常使用!)

setnx(set if not exist)(原子性操作,一起成功,一起失败)

127.0.0.1:6379> setnx mykey "redis" (integer) 1 127.0.0.1:6379> keys * 1) "key2" 2) "key1" 3) "mykey" 127.0.0.1:6379> setnx mykey "MongoDB" (integer) 0 127.0.0.1:6379> get mykey "redis" 127.0.0.1:6379>

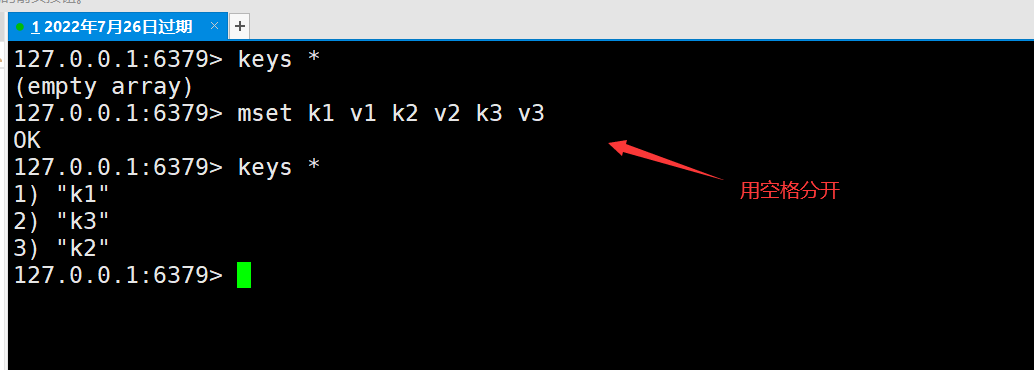

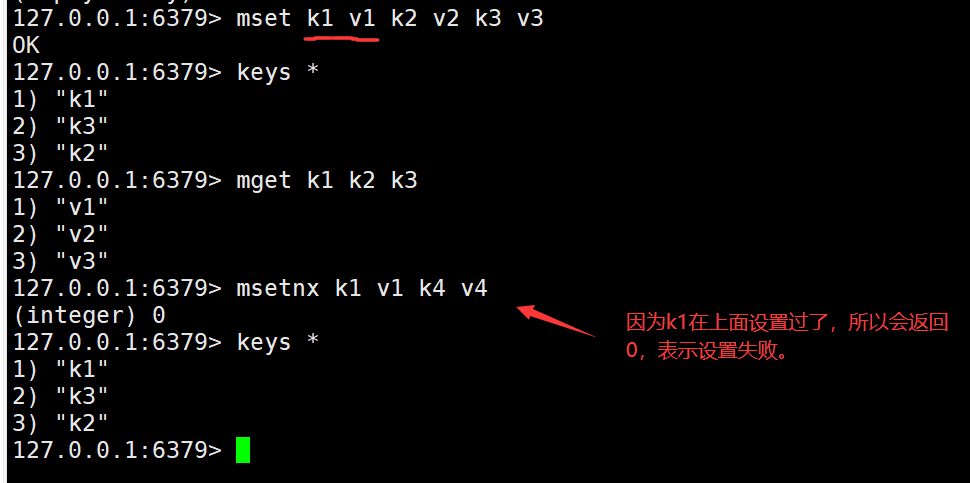

批量设置值

mset

127.0.0.1:6379> keys * (empty array) 127.0.0.1:6379> mset k1 v1 k2 v2 k3 v3 OK 127.0.0.1:6379> keys * 1) "k1" 2) "k3" 3) "k2"

msetnx

如果不存在再设置

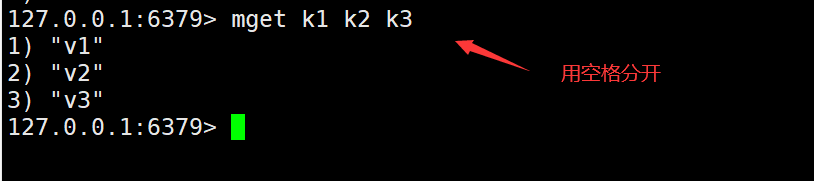

批量获取值

mget

127.0.0.1:6379> mget k1 k2 k3 1) "v1" 2) "v2" 3) "v3"

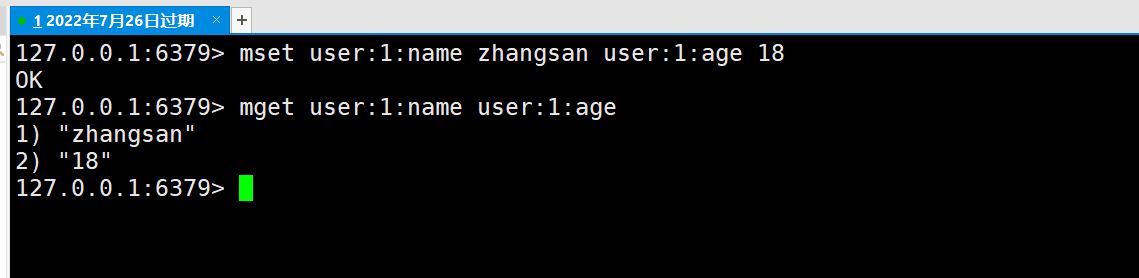

对象

# 这里的key是一个巧妙的设计:user:{id}:{attribute} value 127.0.0.1:6379> mset user:1:name zhangsan user:1:age 18 OK 127.0.0.1:6379> mget user:1:name user:1:age 1) "zhangsan" 2) "18" 127.0.0.1:6379>

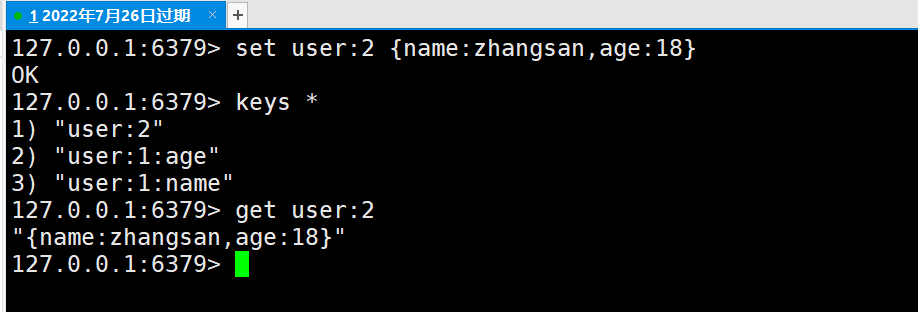

另一种设置对象方式,用json字符来保存一个对象!

127.0.0.1:6379> set user:2 {name:zhangsan,age:18} OK 127.0.0.1:6379> keys * 1) "user:2" 2) "user:1:age" 3) "user:1:name" 127.0.0.1:6379> get user:2 "{name:zhangsan,age:18}" 127.0.0.1:6379>

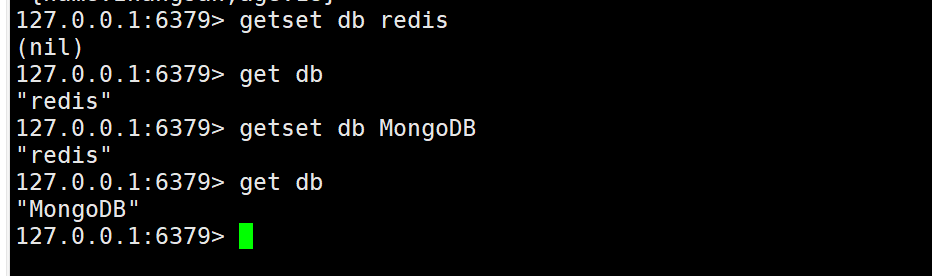

先get后set

getset

127.0.0.1:6379> getset db redis (nil) 127.0.0.1:6379> get db "redis" 127.0.0.1:6379> getset db MongoDB "redis" 127.0.0.1:6379> get db "MongoDB"

List(列表)

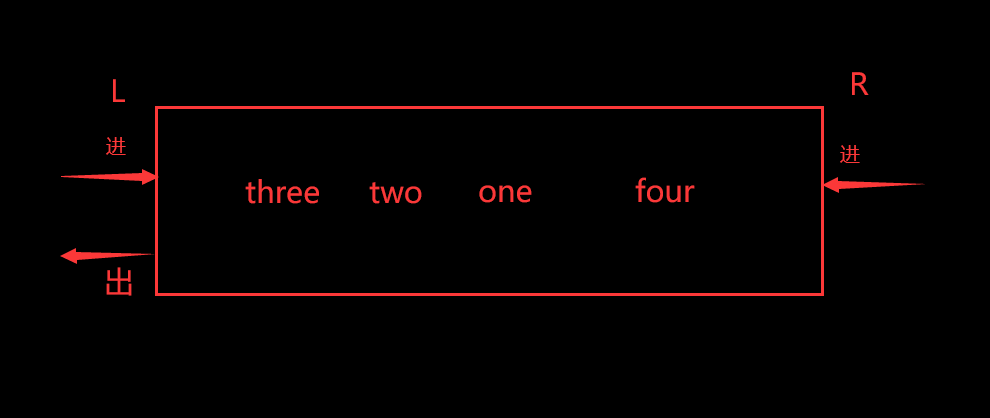

基本的数据类型,列表

list可以从左边进也可以从右边进

list可以从左边出也可以从右边出

在redis里面,我们可以把list玩成,栈、队列、阻塞队列!

所有的list命令都是用l来头的

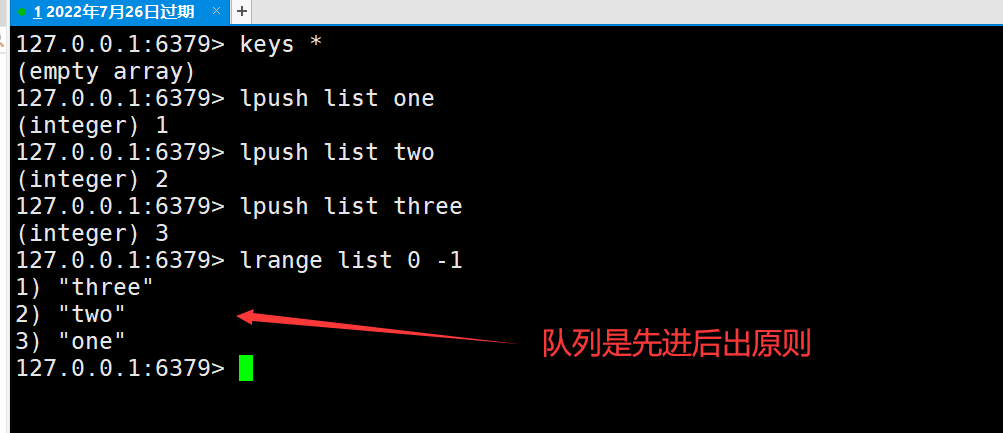

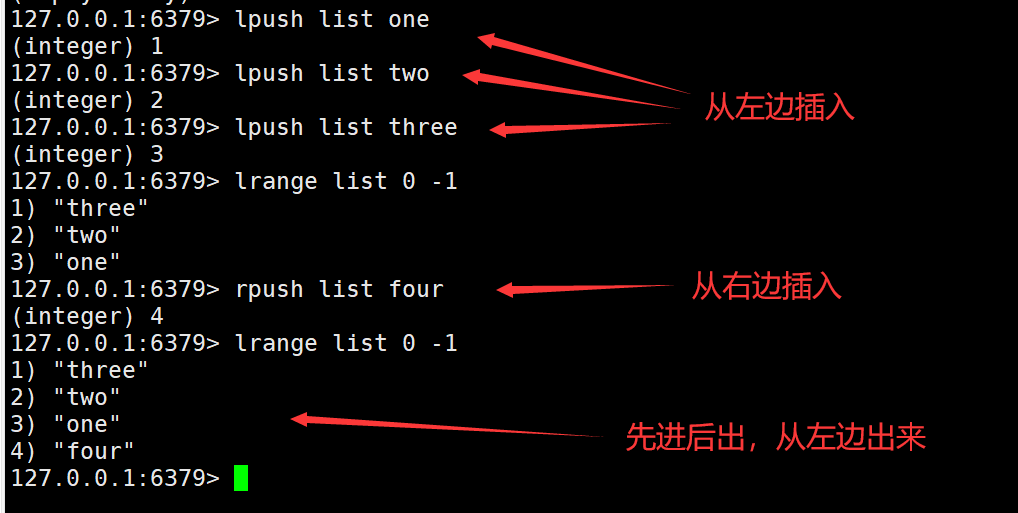

存入值

lpush [key] value

rpush [key] value

# 将一个值或者多个值,插入到列表头部(左) 127.0.0.1:6379> lpush list one (integer) 1 127.0.0.1:6379> lpush list two (integer) 2 127.0.0.1:6379> lpush list three (integer) 3 127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "two" 3) "one" 127.0.0.1:6379>

# 将一个值或者多个值,插入到列表头部(右) 127.0.0.1:6379> rpush list four (integer) 4 127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "two" 3) "one" 4) "four"

图解

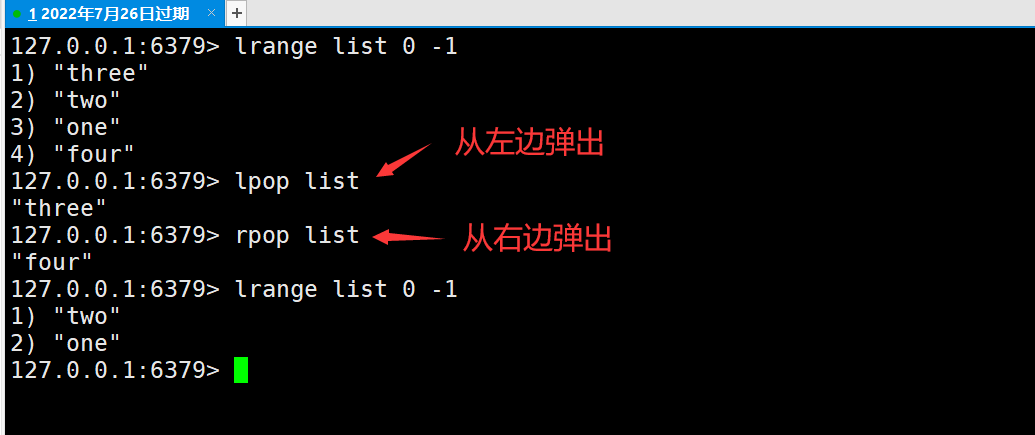

移除值

lpop [key]

rpop [key]

127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "two" 3) "one" 4) "four" 127.0.0.1:6379> lpop list "three" 127.0.0.1:6379> rpop list "four" 127.0.0.1:6379> lrange list 0 -1 1) "two" 2) "one"

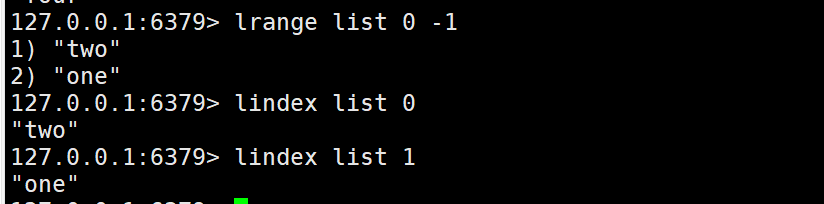

利用下标获取值

lindex [key] index

127.0.0.1:6379> lrange list 0 -1 1) "two" 2) "one" 127.0.0.1:6379> lindex list 0 "two" 127.0.0.1:6379> lindex list 1 "one"

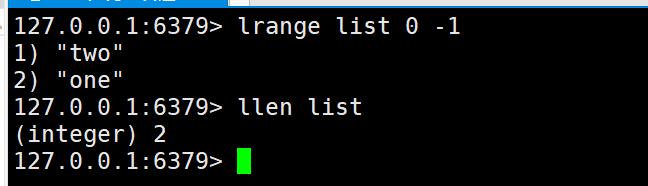

获取list长度

llen

127.0.0.1:6379> lrange list 0 -1 1) "two" 2) "one" 127.0.0.1:6379> llen list (integer) 2

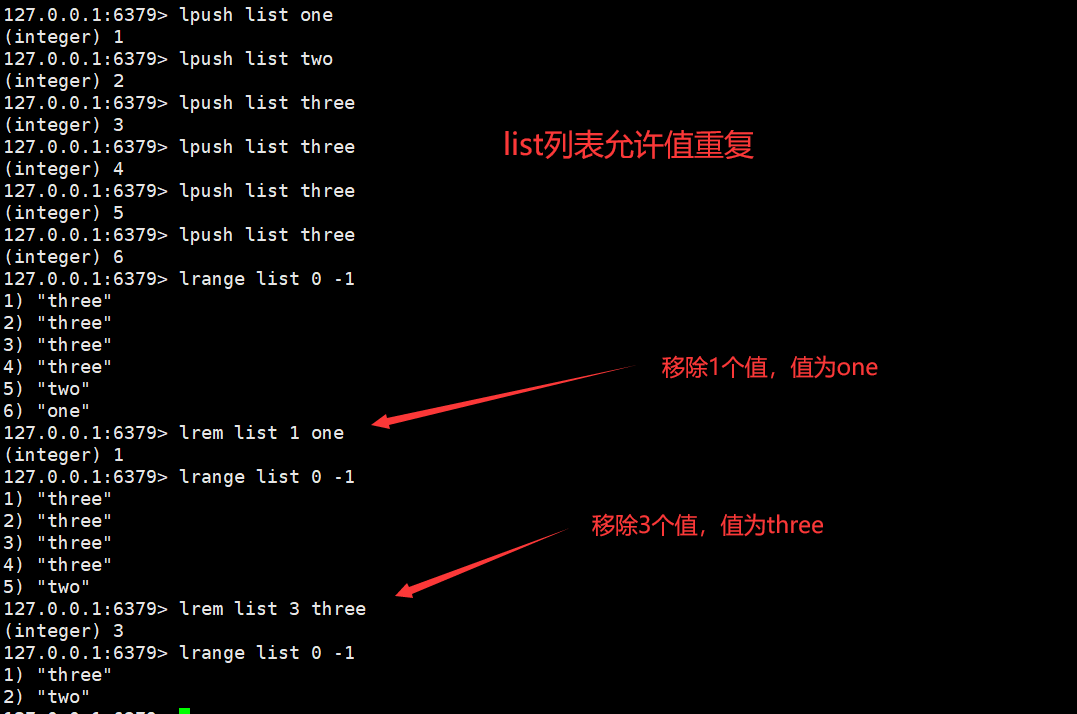

移除指定的值

lrem

127.0.0.1:6379> lpush list one (integer) 1 127.0.0.1:6379> lpush list two (integer) 2 127.0.0.1:6379> lpush list three (integer) 3 127.0.0.1:6379> lpush list three (integer) 4 127.0.0.1:6379> lpush list three (integer) 5 127.0.0.1:6379> lpush list three (integer) 6 127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "three" 3) "three" 4) "three" 5) "two" 6) "one" 127.0.0.1:6379> lrem list 1 one (integer) 1 127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "three" 3) "three" 4) "three" 5) "two" 127.0.0.1:6379> lrem list 3 three (integer) 3 127.0.0.1:6379> lrange list 0 -1 1) "three" 2) "two"

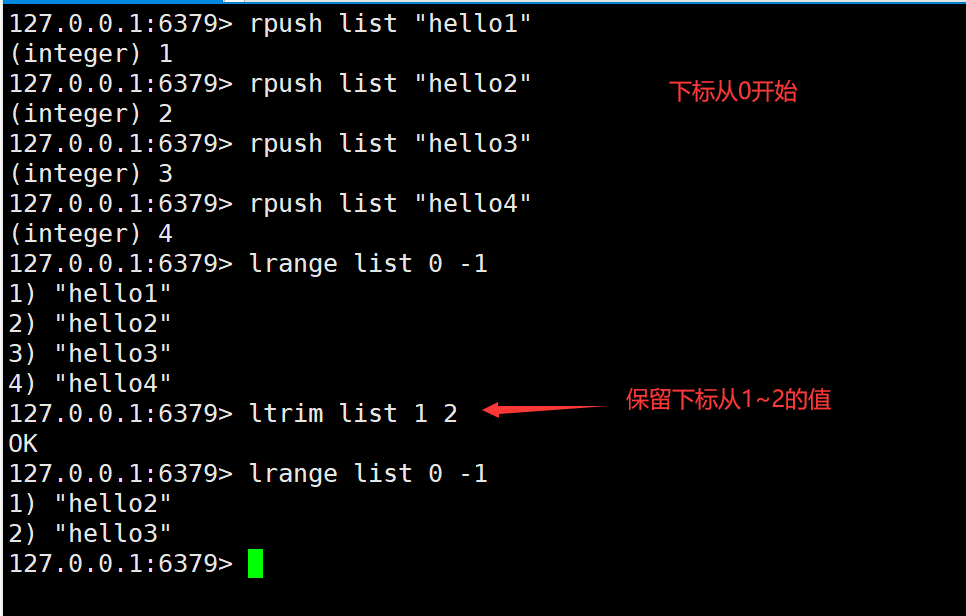

保留某一段的值

ltrim

127.0.0.1:6379> rpush list "hello1" (integer) 1 127.0.0.1:6379> rpush list "hello2" (integer) 2 127.0.0.1:6379> rpush list "hello3" (integer) 3 127.0.0.1:6379> rpush list "hello4" (integer) 4 127.0.0.1:6379> lrange list 0 -1 1) "hello1" 2) "hello2" 3) "hello3" 4) "hello4" 127.0.0.1:6379> ltrim list 1 2 OK 127.0.0.1:6379> lrange list 0 -1 1) "hello2" 2) "hello3"

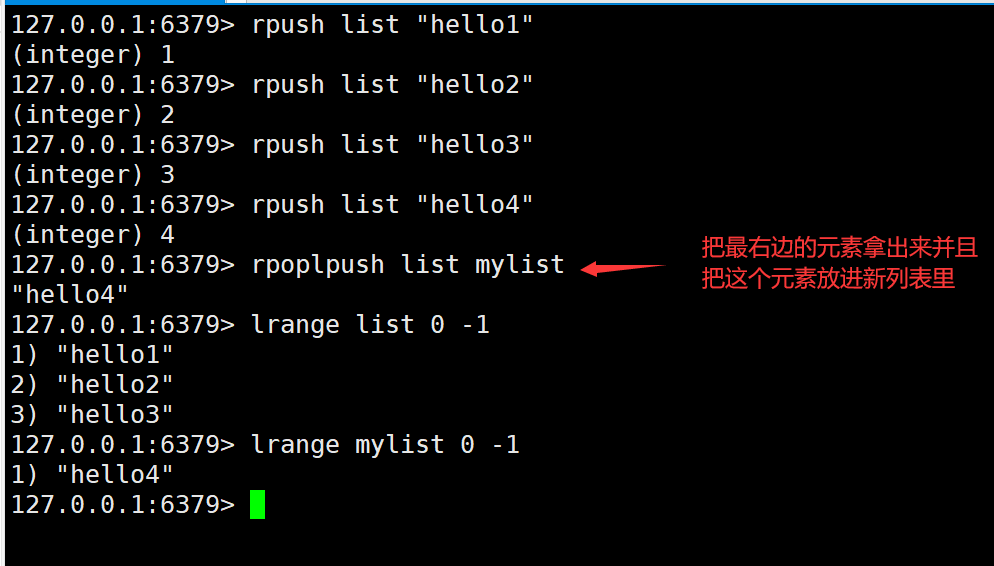

移除列表元素并添加到另一个列表里

tip:如果另一个列表不存在,会自动创建

rpoplpush

移除list列表中最右边的元素并且把这个元素添加到新list列表里

127.0.0.1:6379> clear 127.0.0.1:6379> rpush list "hello1" (integer) 1 127.0.0.1:6379> rpush list "hello2" (integer) 2 127.0.0.1:6379> rpush list "hello3" (integer) 3 127.0.0.1:6379> rpush list "hello4" (integer) 4 127.0.0.1:6379> rpoplpush list mylist "hello4" 127.0.0.1:6379> lrange list 0 -1 1) "hello1" 2) "hello2" 3) "hello3" 127.0.0.1:6379> lrange mylist 0 -1 1) "hello4"

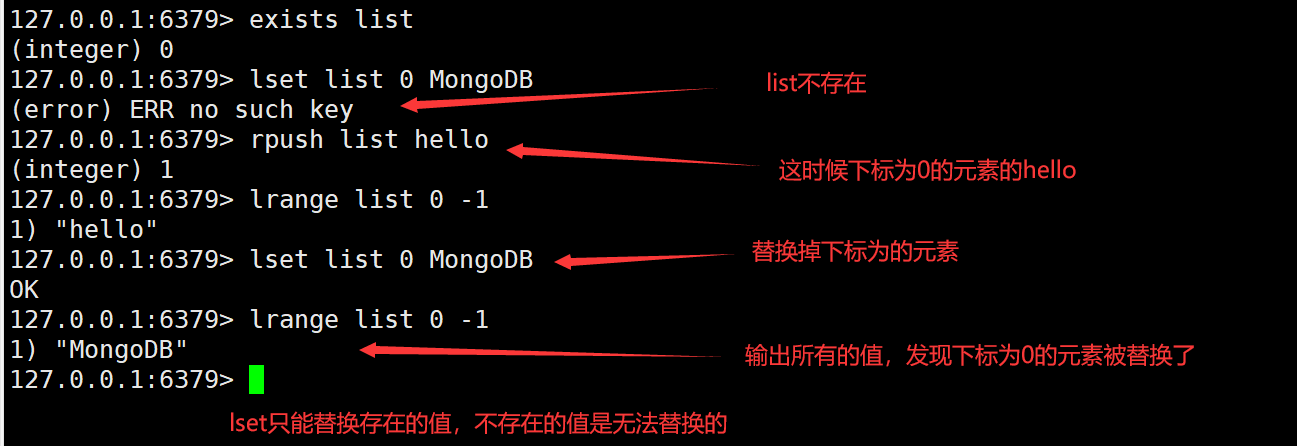

替换指定的值

相对于更新操作

lset

127.0.0.1:6379> exists list (integer) 0 127.0.0.1:6379> lset list 0 MongoDB (error) ERR no such key 127.0.0.1:6379> rpush list hello (integer) 1 127.0.0.1:6379> lrange list 0 -1 1) "hello" 127.0.0.1:6379> lset list 0 MongoDB OK 127.0.0.1:6379> lrange list 0 -1 1) "MongoDB"

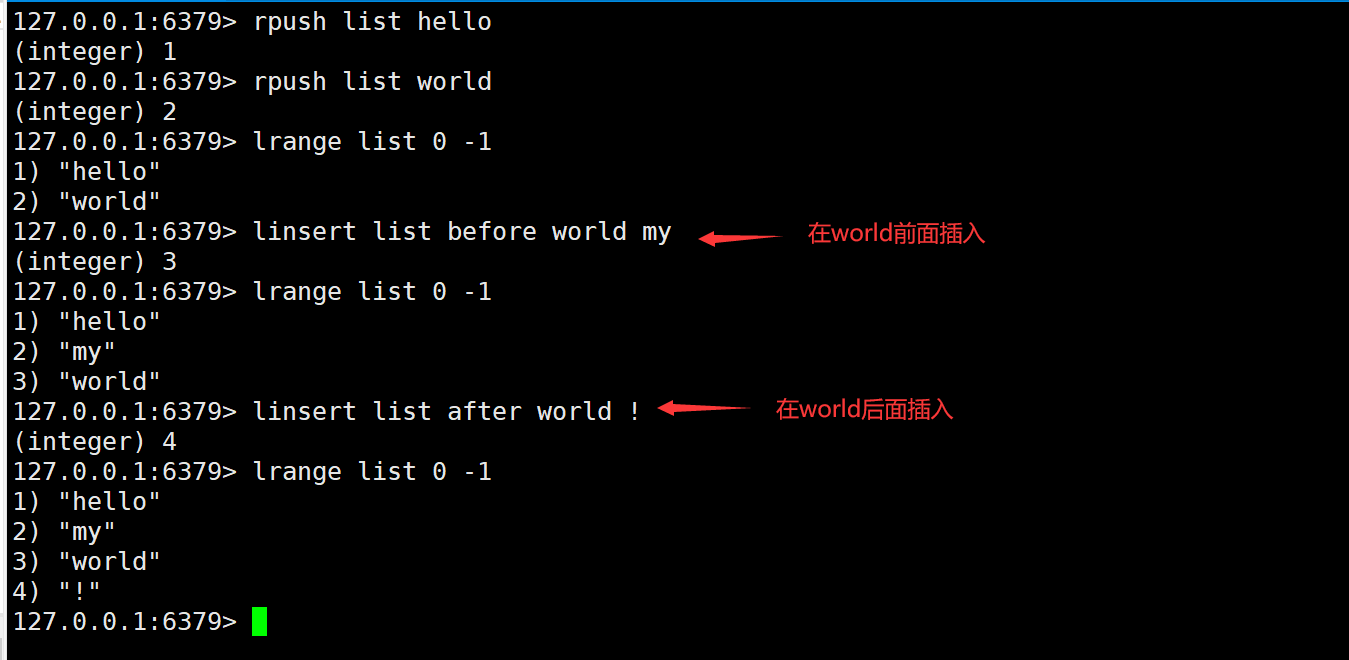

往指定位置插入值

linsert

127.0.0.1:6379> rpush list hello (integer) 1 127.0.0.1:6379> rpush list world (integer) 2 127.0.0.1:6379> lrange list 0 -1 1) "hello" 2) "world" 127.0.0.1:6379> linsert list before world my (integer) 3 127.0.0.1:6379> lrange list 0 -1 1) "hello" 2) "my" 3) "world" 127.0.0.1:6379> linsert list after world ! (integer) 4 127.0.0.1:6379> lrange list 0 -1 1) "hello" 2) "my" 3) "world" 4) "!"

小结

- 他实际上是一个链表,before Node after,left ,right 都可以插入值

- 如果key不存在,创建新的链表

- 如果key存在,新增内容

- 如果移除了所有值,空链表,也代表不存在!

- 在两边插入或者改动值,效率最高!中间元素,相对来说效率会低一点

消息队列(Lpush Rpop),栈(Lpush Lpop)

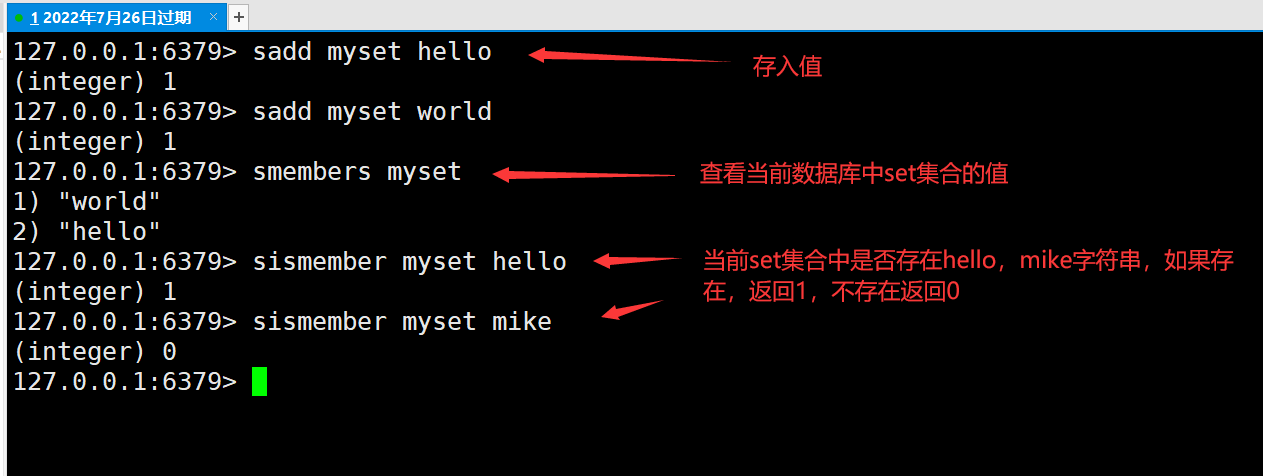

Set(无序集合)

存入值

set中的值是不能重复的!

add [key] value

127.0.0.1:6379> sadd myset hello (integer) 1 127.0.0.1:6379> sadd myset world (integer) 1 127.0.0.1:6379> smembers myset 1) "world" 2) "hello" 127.0.0.1:6379> sismember myset hello (integer) 1 127.0.0.1:6379> sismember myset mike (integer) 0

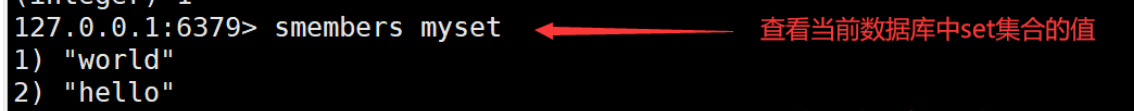

查看值

smembers [key]

127.0.0.1:6379> smembers myset 1) "world" 2) "hello"

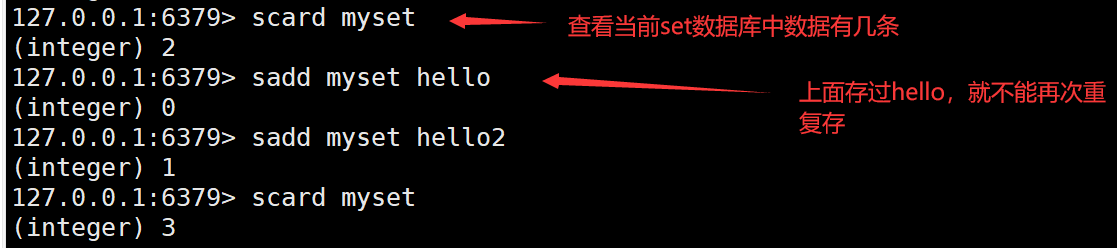

获取set集合中的内容元素个数

scard [key]

127.0.0.1:6379> scard myset (integer) 2 127.0.0.1:6379> sadd myset hello (integer) 0 127.0.0.1:6379> sadd myset hello2 (integer) 1 127.0.0.1:6379> scard myset (integer) 3

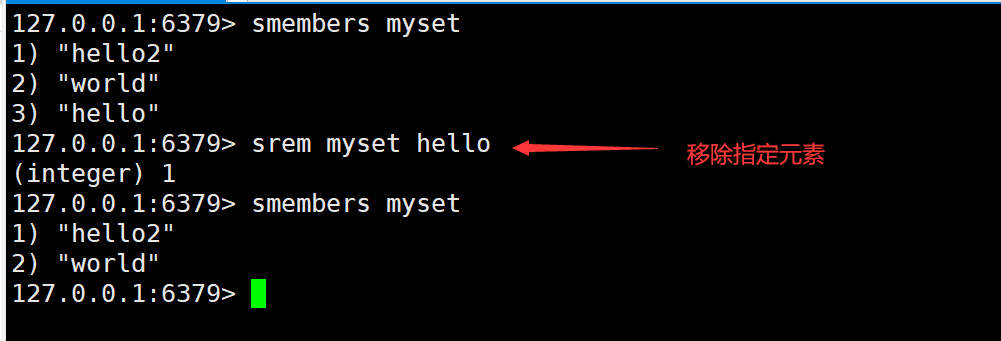

移除指定元素

srem [key] value

127.0.0.1:6379> smembers myset 1) "hello2" 2) "world" 3) "hello" 127.0.0.1:6379> srem myset hello (integer) 1 127.0.0.1:6379> smembers myset 1) "hello2" 2) "world"

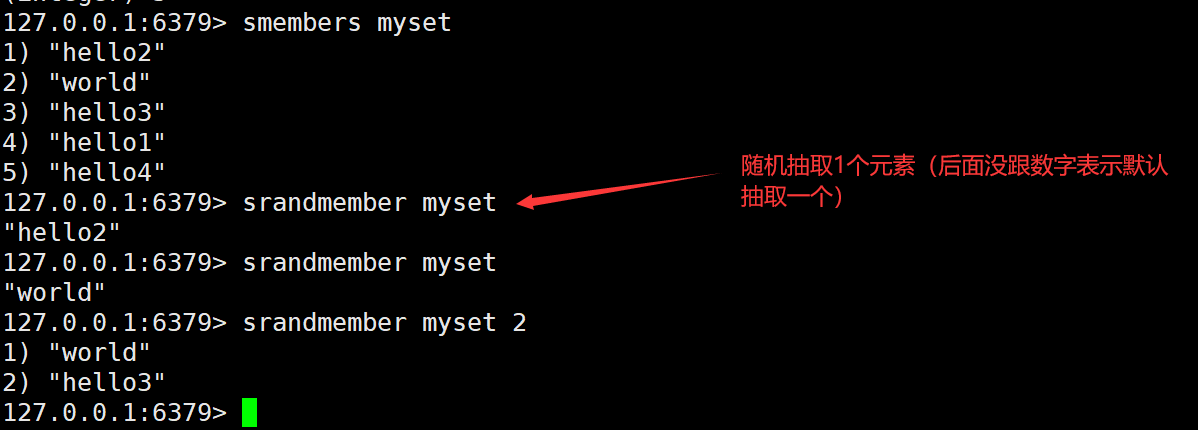

set中抽随机

srandmember [key]

127.0.0.1:6379> smembers myset 1) "hello2" 2) "world" 3) "hello3" 4) "hello1" 5) "hello4" 127.0.0.1:6379> srandmember myset "hello2" 127.0.0.1:6379> srandmember myset "world" 127.0.0.1:6379> srandmember myset 2 1) "world" 2) "hello3"

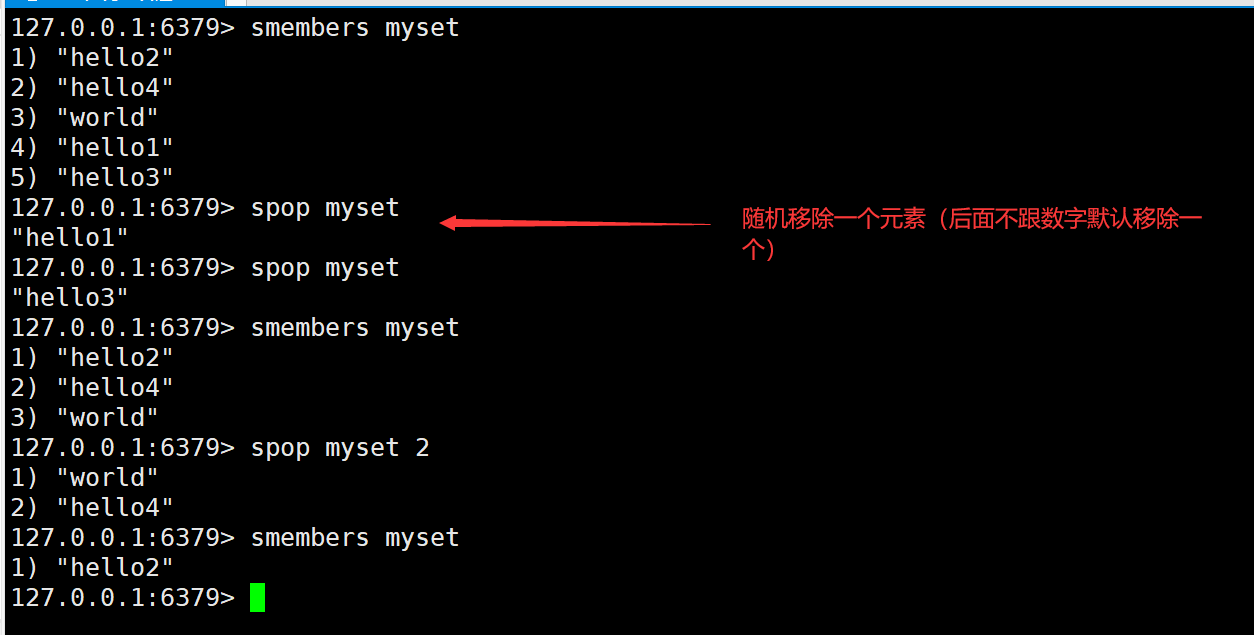

随机移除一个元素

spop [key]

127.0.0.1:6379> smembers myset 1) "hello2" 2) "hello4" 3) "world" 4) "hello1" 5) "hello3" 127.0.0.1:6379> spop myset "hello1" 127.0.0.1:6379> spop myset "hello3" 127.0.0.1:6379> smembers myset 1) "hello2" 2) "hello4" 3) "world" 127.0.0.1:6379> spop myset 2 1) "world" 2) "hello4" 127.0.0.1:6379> smembers myset 1) "hello2"

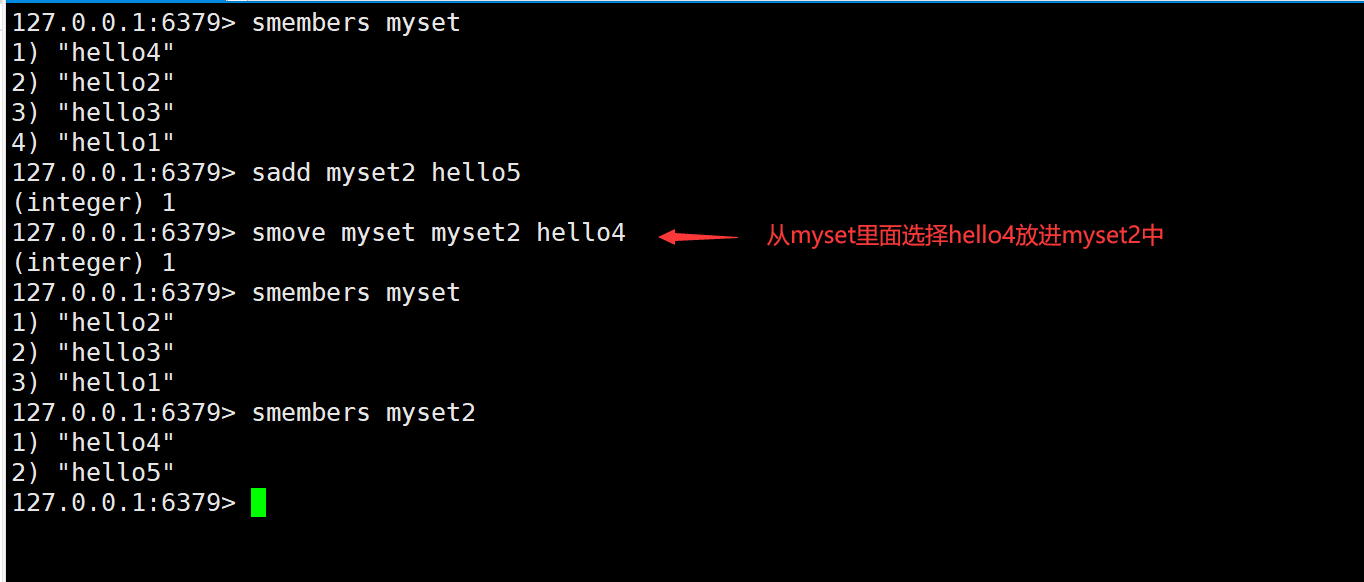

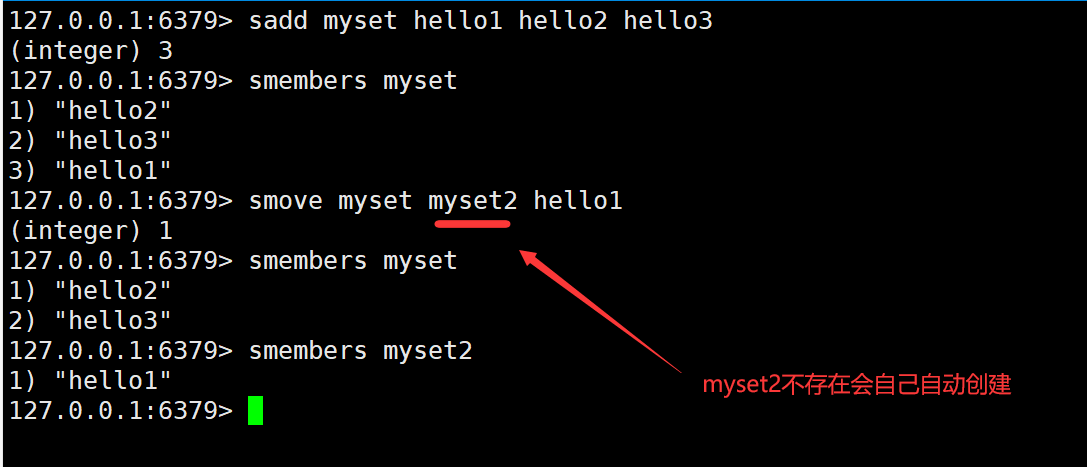

指定一个元素,移动到另外一个set集合

tip:如果另一个set不存在,会自动创建

smove

127.0.0.1:6379> smembers myset 1) "hello4" 2) "hello2" 3) "hello3" 4) "hello1" 127.0.0.1:6379> sadd myset2 hello5 (integer) 1 127.0.0.1:6379> smove myset myset2 hello4 (integer) 1 127.0.0.1:6379> smembers myset 1) "hello2" 2) "hello3" 3) "hello1" 127.0.0.1:6379> smembers myset2 1) "hello4" 2) "hello5"

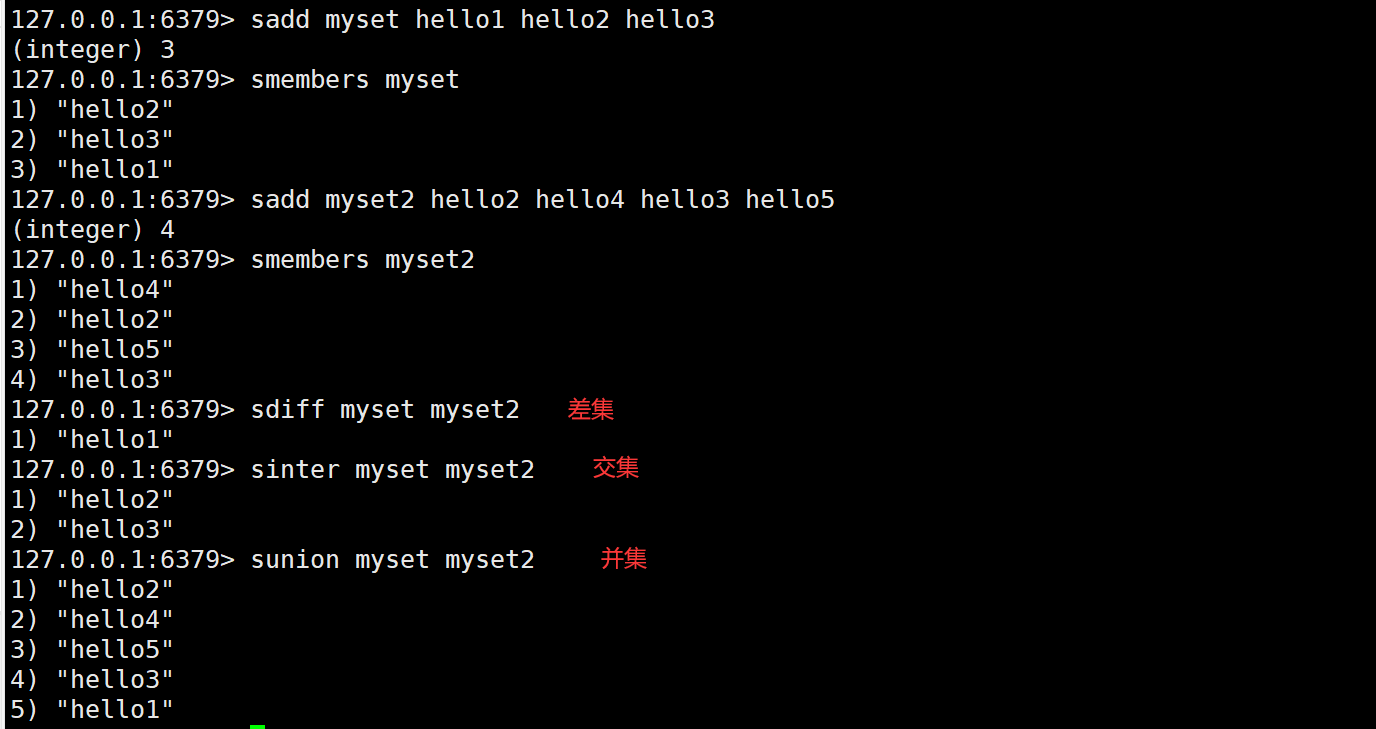

共同关注(并集)

应用场景:微博,抖音互关

数字集合类

- 差集

sdiff - 交集

sinter - 并集

sunion

127.0.0.1:6379> sadd myset hello1 hello2 hello3 (integer) 3 127.0.0.1:6379> smembers myset 1) "hello2" 2) "hello3" 3) "hello1" 127.0.0.1:6379> sadd myset2 hello2 hello4 hello3 hello5 (integer) 4 127.0.0.1:6379> smembers myset2 1) "hello4" 2) "hello2" 3) "hello5" 4) "hello3" 127.0.0.1:6379> sdiff myset myset2 1) "hello1" 127.0.0.1:6379> sinter myset myset2 1) "hello2" 2) "hello3" 127.0.0.1:6379> sunion myset myset2 1) "hello2" 2) "hello4" 3) "hello5" 4) "hello3" 5) "hello1"

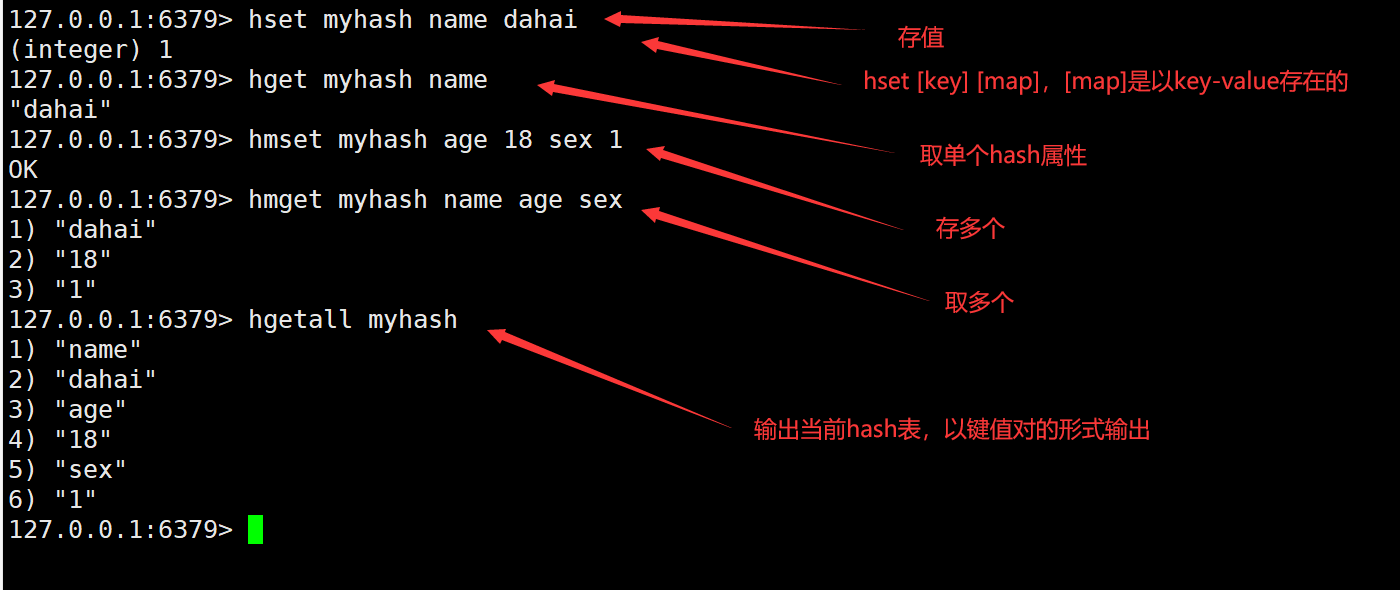

Hash(哈希)

Map集合,key-map!

存取hash字段

127.0.0.1:6379> hset myhash name dahai (integer) 1 127.0.0.1:6379> hget myhash name "dahai" 127.0.0.1:6379> hmset myhash age 18 sex 1 OK 127.0.0.1:6379> hmget myhash name age sex 1) "dahai" 2) "18" 3) "1" 127.0.0.1:6379> hgetall myhash 1) "name" 2) "dahai" 3) "age" 4) "18" 5) "sex" 6) "1"

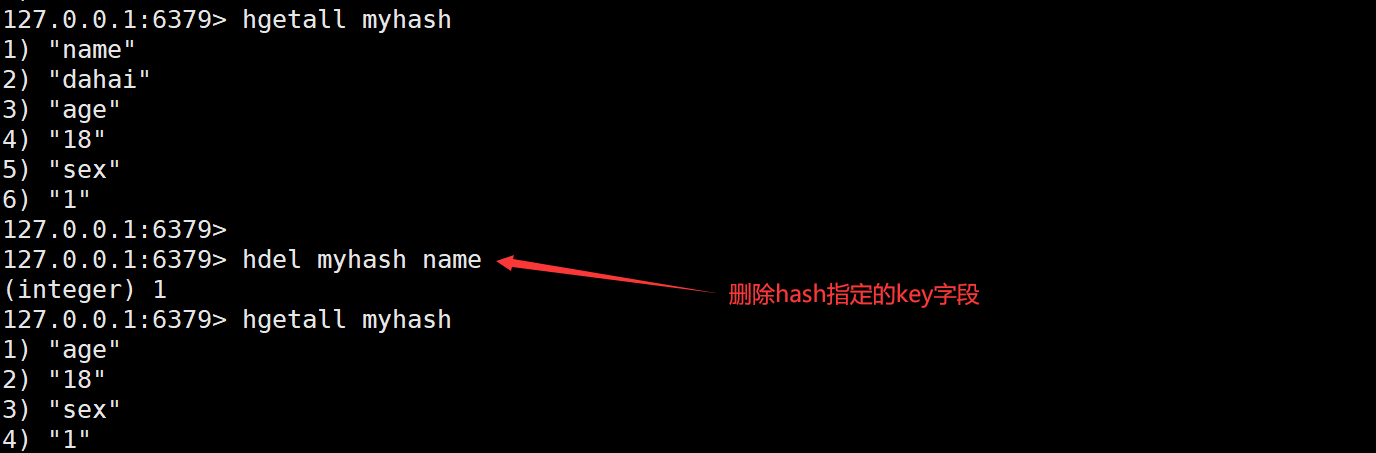

删除指定的key字段

hdel

127.0.0.1:6379> hgetall myhash 1) "name" 2) "dahai" 3) "age" 4) "18" 5) "sex" 6) "1" 127.0.0.1:6379> 127.0.0.1:6379> hdel myhash name (integer) 1 127.0.0.1:6379> hgetall myhash 1) "age" 2) "18" 3) "sex" 4) "1"

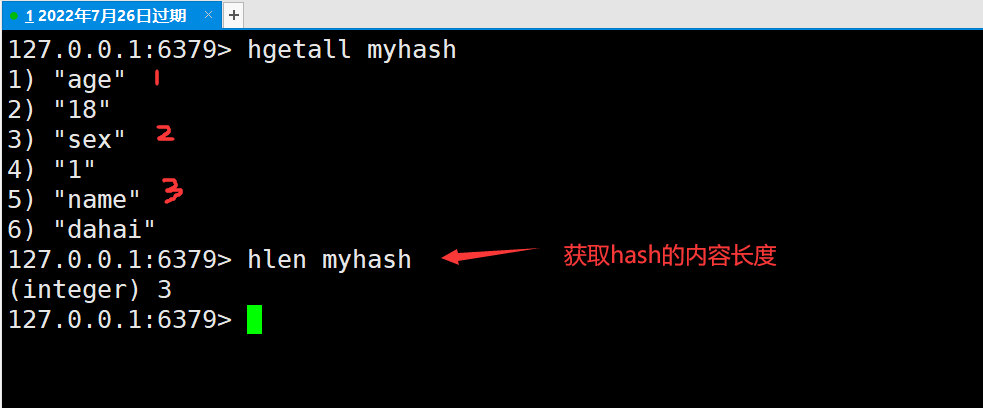

获取hash表的字段数量

127.0.0.1:6379> hgetall myhash 1) "age" 2) "18" 3) "sex" 4) "1" 5) "name" 6) "dahai" 127.0.0.1:6379> hlen myhash (integer) 3

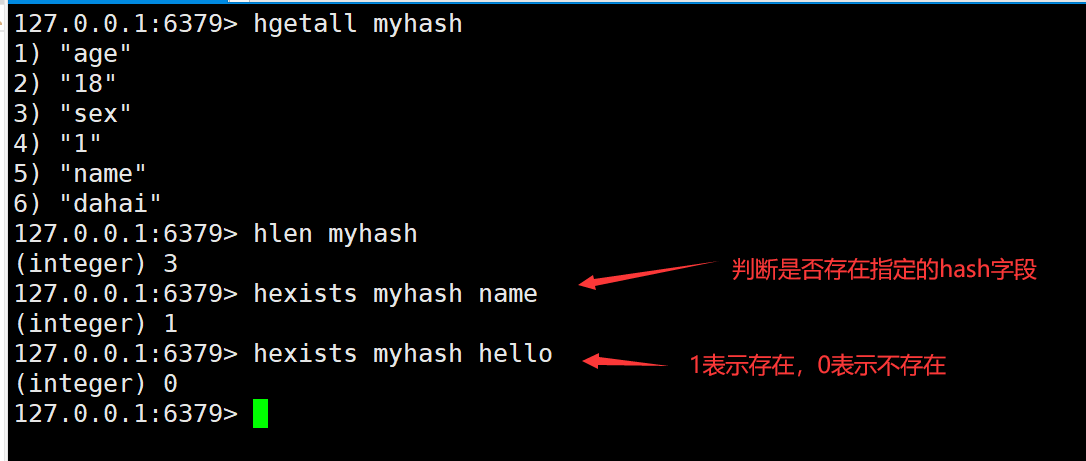

判断hash表中指定字段是否存在

127.0.0.1:6379> hexists myhash name (integer) 1 127.0.0.1:6379> hexists myhash hello (integer) 0

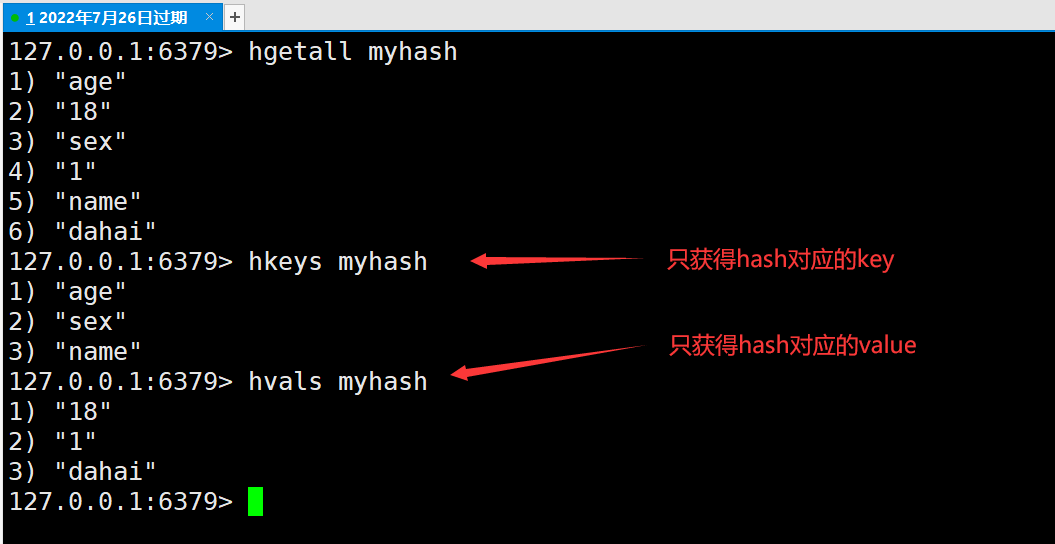

只获得hash对应的key/value

127.0.0.1:6379> hgetall myhash 1) "age" 2) "18" 3) "sex" 4) "1" 5) "name" 6) "dahai" 127.0.0.1:6379> hkeys myhash 1) "age" 2) "sex" 3) "name" 127.0.0.1:6379> hvals myhash 1) "18" 2) "1" 3) "dahai"

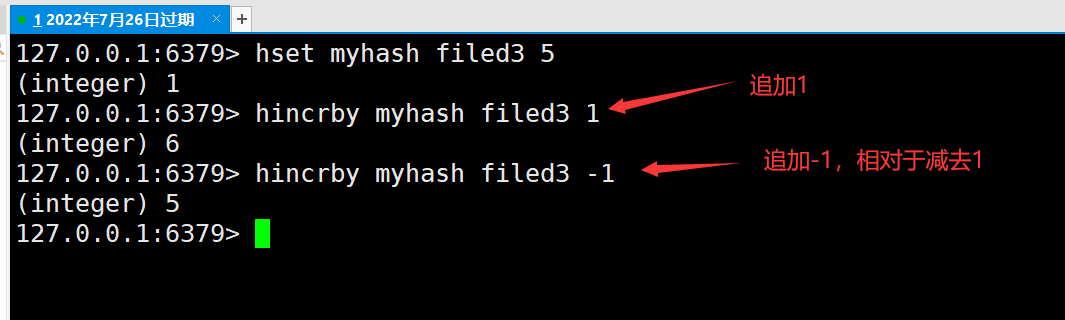

追加值

127.0.0.1:6379> hset myhash filed3 5 (integer) 1 127.0.0.1:6379> hincrby myhash filed3 1 (integer) 6 127.0.0.1:6379> hincrby myhash filed3 -1 (integer) 5

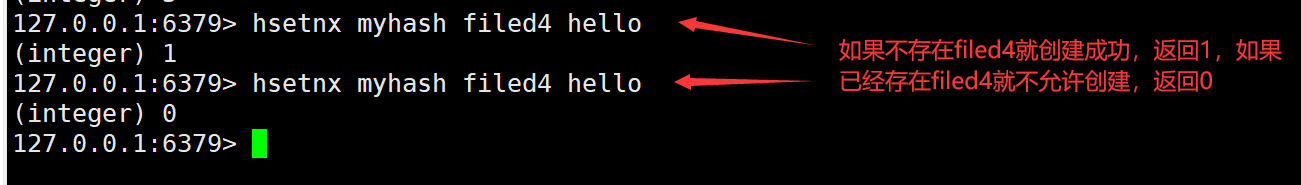

hash表中不存在某字段才创建

127.0.0.1:6379> hsetnx myhash filed4 hello (integer) 1 127.0.0.1:6379> hsetnx myhash filed4 hello (integer) 0

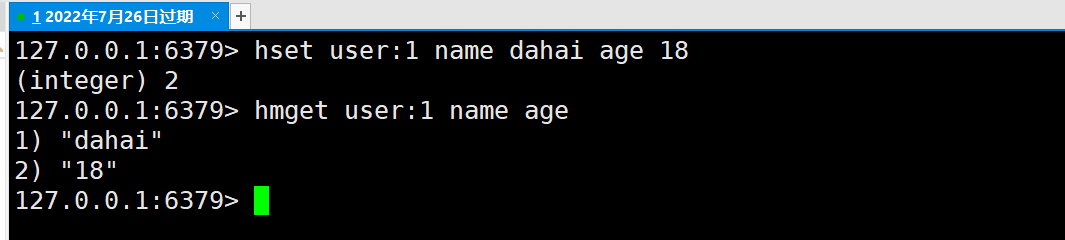

用hash存对象

# 这里的key是一个巧妙的设计:user:{id}:{attribute} value 127.0.0.1:6379> hset user:1 name dahai age 18 (integer) 2 127.0.0.1:6379> hmget user:1 name age 1) "dahai" 2) "18"

hash可以保存变更的数据 user name age ,尤其是用户信息之类的,经常变动的信息!hash更适合对象的存储,Sring更适合字符串的存储!

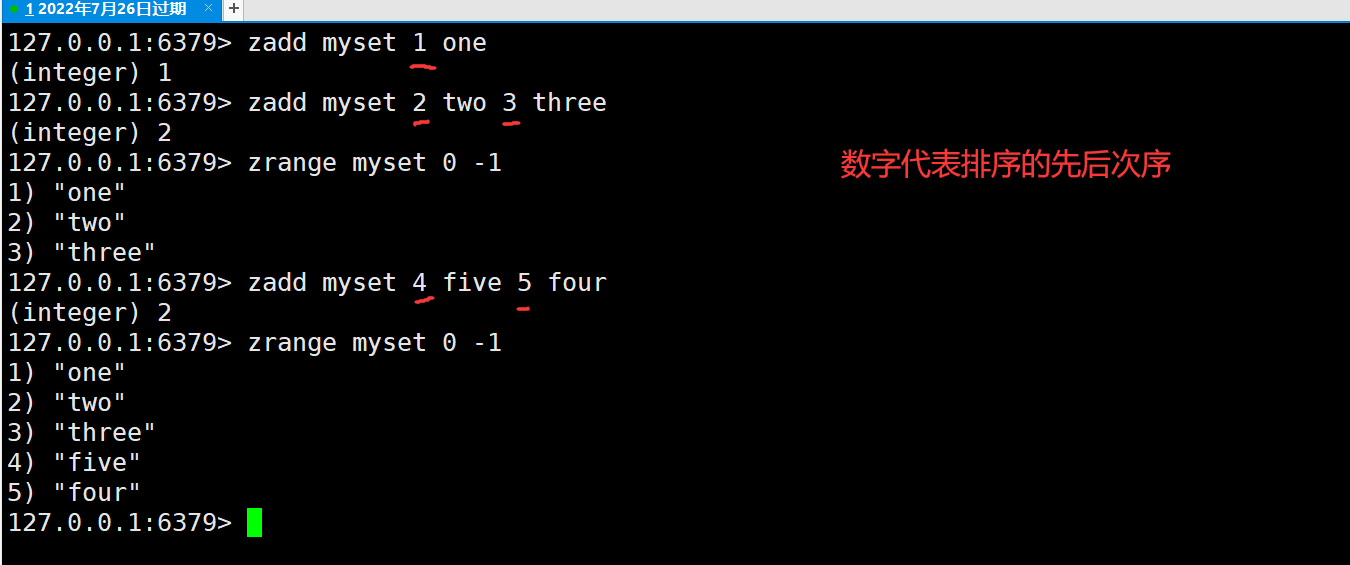

Zset(有序集合)

score叫计数位

存字段的时候给字段一个次序

# zadd [key] [score] value 127.0.0.1:6379> zadd myset 1 one (integer) 1 127.0.0.1:6379> zadd myset 2 two 3 three (integer) 2 127.0.0.1:6379> zrange myset 0 -1 1) "one" 2) "two" 3) "three" 127.0.0.1:6379> zadd myset 4 five 5 four (integer) 2 127.0.0.1:6379> zrange myset 0 -1 1) "one" 2) "two" 3) "three" 4) "five" 5) "four"

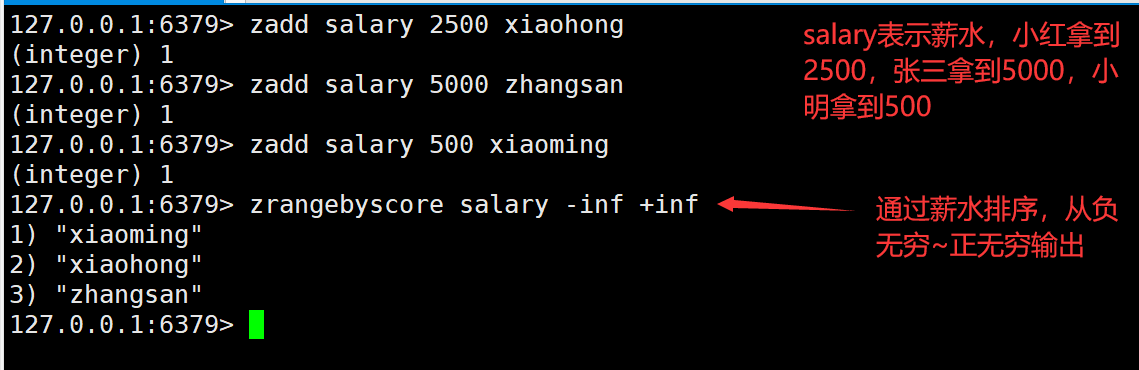

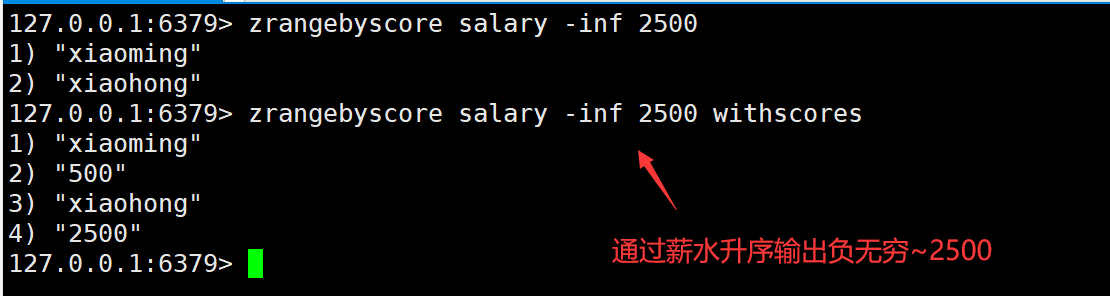

通过score排序

升序查找

127.0.0.1:6379> zadd salary 2500 xiaohong (integer) 1 127.0.0.1:6379> zadd salary 5000 zhangsan (integer) 1 127.0.0.1:6379> zadd salary 500 xiaoming (integer) 1 127.0.0.1:6379> zrangebyscore salary -inf +inf 1) "xiaoming" 2) "xiaohong" 3) "zhangsan"

127.0.0.1:6379> zrangebyscore salary -inf 2500 1) "xiaoming" 2) "xiaohong" 127.0.0.1:6379> zrangebyscore salary -inf 2500 withscores 1) "xiaoming" 2) "500" 3) "xiaohong" 4) "2500"

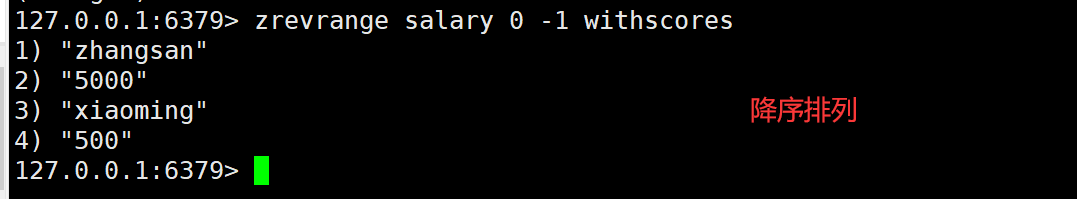

降序查找

127.0.0.1:6379> zrevrange salary 0 -1 withscores 1) "zhangsan" 2) "5000" 3) "xiaoming" 4) "500"

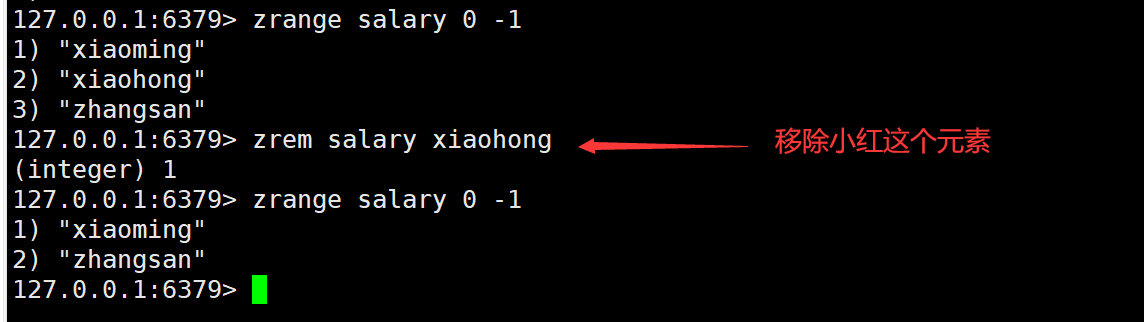

移除指定的元素

127.0.0.1:6379> zrange salary 0 -1 1) "xiaoming" 2) "xiaohong" 3) "zhangsan" 127.0.0.1:6379> zrem salary xiaohong (integer) 1 127.0.0.1:6379> zrange salary 0 -1 1) "xiaoming" 2) "zhangsan"

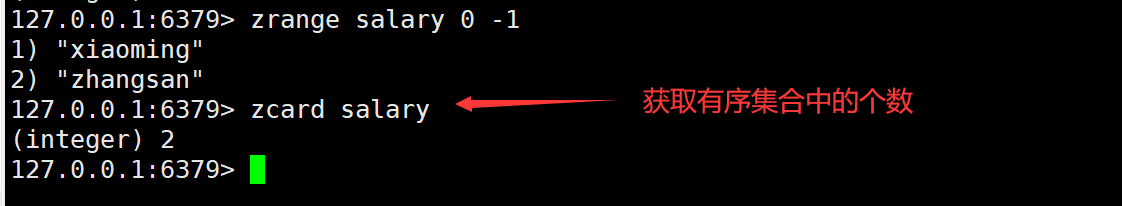

获取有序集合中的个数

127.0.0.1:6379> zrange salary 0 -1 1) "xiaoming" 2) "zhangsan" 127.0.0.1:6379> zcard salary (integer) 2

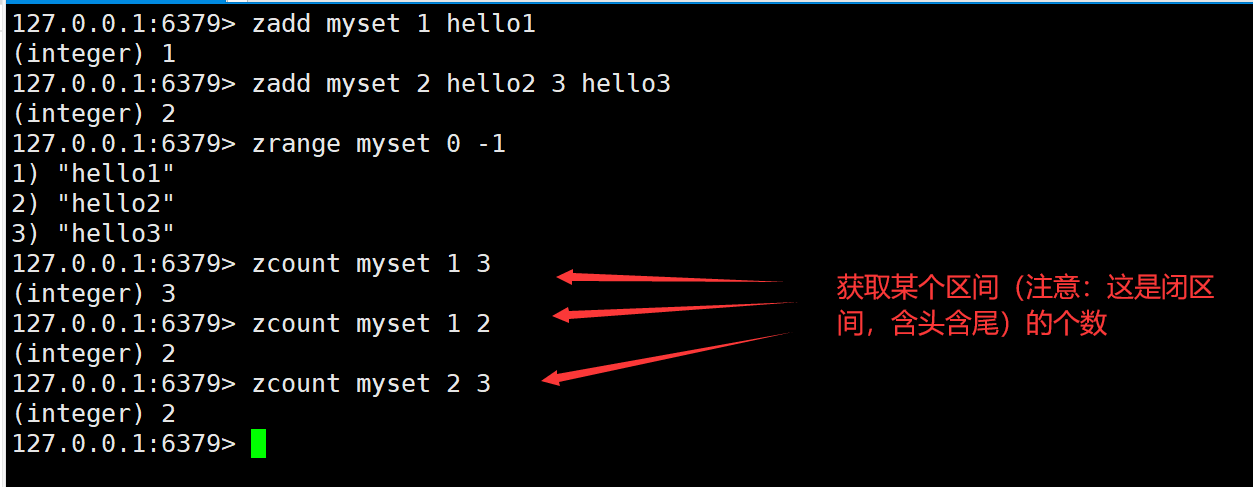

获取指定区间的元素个数

127.0.0.1:6379> zadd myset 1 hello1 (integer) 1 127.0.0.1:6379> zadd myset 2 hello2 3 hello3 (integer) 2 127.0.0.1:6379> zrange myset 0 -1 1) "hello1" 2) "hello2" 3) "hello3" 127.0.0.1:6379> zcount myset 1 3 (integer) 3 127.0.0.1:6379> zcount myset 1 2 (integer) 2 127.0.0.1:6379> zcount myset 2 3 (integer) 2

三种特殊数据类型

geospatial(地理空间)

朋友的定位,附近的人,打车距离计算?

查询城市经纬度工具:http://www.jsons.cn/lngcode/

只有六个命令

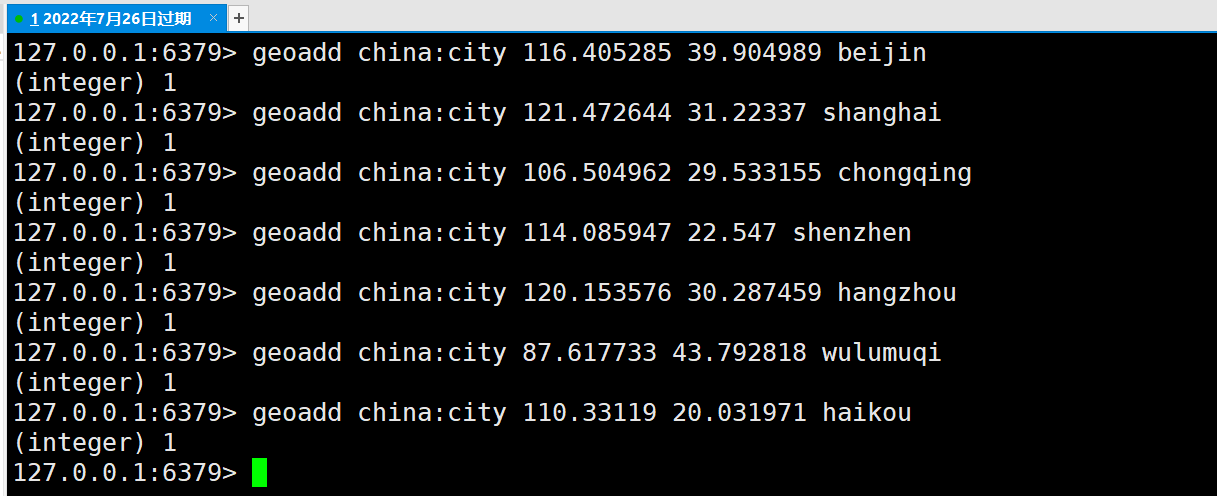

GEOADD

时间复杂度:每一个元素添加是O(log(N)) ,N是sorted set的元素数量。

规定如下:

- 有效的经度从-180度到180度。

- 有效的纬度从-85.05112878度到85.05112878度。

当坐标位置超出上述指定范围时,该命令将会返回一个错误。

# geoadd 添加地理位置 # 规则:两极无法直接添加,我们一般会下载城地理位置数据,直接通过java程序一次性导入! # 参数 key 值(纬度,经度,名称) 127.0.0.1:6379> geoadd china:city 116.405285 39.904989 beijin (integer) 1 127.0.0.1:6379> geoadd china:city 121.472644 31.22337 shanghai (integer) 1 127.0.0.1:6379> geoadd china:city 106.504962 29.533155 chongqing (integer) 1 127.0.0.1:6379> geoadd china:city 114.085947 22.547 shenzhen (integer) 1 127.0.0.1:6379> geoadd china:city 120.153576 30.287459 hangzhou (integer) 1 127.0.0.1:6379> geoadd china:city 87.617733 43.792818 wulumuqi (integer) 1 127.0.0.1:6379> geoadd china:city 110.33119 20.031971 haikou (integer) 1

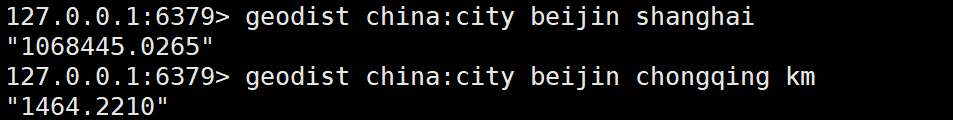

GEODIST

**时间复杂度:O(log(N)) **

两人之间的距离

返回两个给定位置之间的距离。

如果两个位置之间的其中一个不存在, 那么命令返回空值。

指定单位的参数 unit 必须是以下单位的其中一个:

- m 表示单位为米。

- km 表示单位为千米。

- mi 表示单位为英里。

- ft 表示单位为英尺。

# 查看上海到北京的直线距离,若后面不接长度单位,默认使用米(M)输出 127.0.0.1:6379> geodist china:city beijin shanghai "1068445.0265" # 查看重庆到北京的直线距离 127.0.0.1:6379> geodist china:city beijin chongqing km "1464.2210"

GEOHASH

**时间复杂度:O(log(N)) **

返回一个或多个位置元素的 Geohash 表示。

通常使用表示位置的元素使用不同的技术,使用Geohash位置52点整数编码。由于编码和解码过程中所使用的初始最小和最大坐标不同,编码的编码也不同于标准。此命令返回一个标准的Geohash,在维基百科和geohash.org网站都有相关描述

该命令将返回11个字符的Geohash的字符串

# 将二维的经纬度转换成一维的字符串!,如果两个字符串约接近,之间的距离越近 127.0.0.1:6379> geohash china:city beijin chongqing 1) "wx4g0b7xrt0" 2) "wm78p86e170"

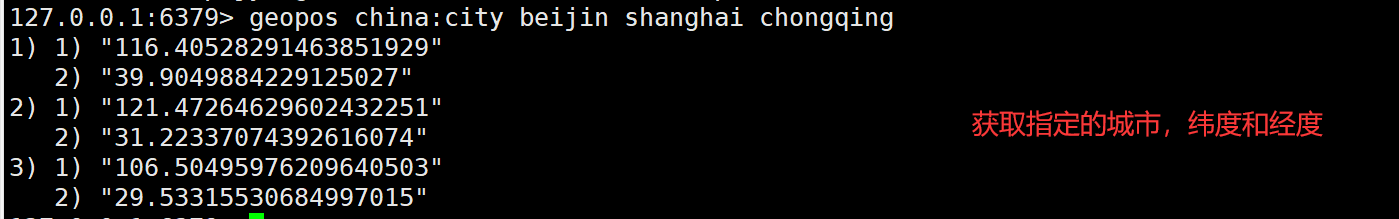

GEOPOS

**时间复杂度:O(log(N)) **

获取指定的城市的纬度和经度

127.0.0.1:6379> geopos china:city beijin shanghai chongqing 1) 1) "116.40528291463851929" 2) "39.9049884229125027" 2) 1) "121.47264629602432251" 2) "31.22337074392616074" 3) 1) "106.50495976209640503" 2) "29.53315530684997015"

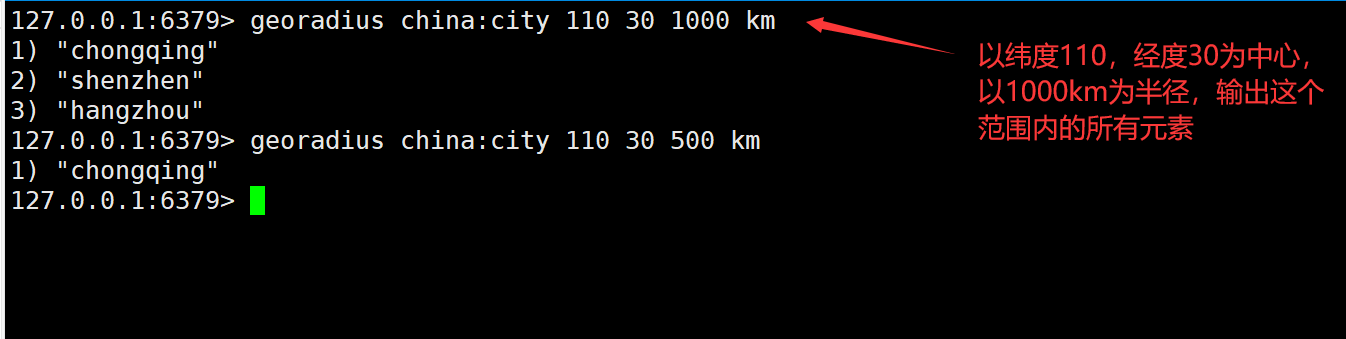

GEORADIUS

时间复杂度:O(N+log(M))

以给定的经纬度为中心, 返回键包含的位置元素当中, 与中心的距离不超过给定最大距离的所有位置元素。

范围可以使用以下其中一个单位:

- m 表示单位为米。

- km 表示单位为千米。

- mi 表示单位为英里。

- ft 表示单位为英尺。

127.0.0.1:6379> georadius china:city 110 30 1000 km 1) "chongqing" 2) "shenzhen" 3) "hangzhou" 127.0.0.1:6379> georadius china:city 110 30 500 km 1) "chongqing"

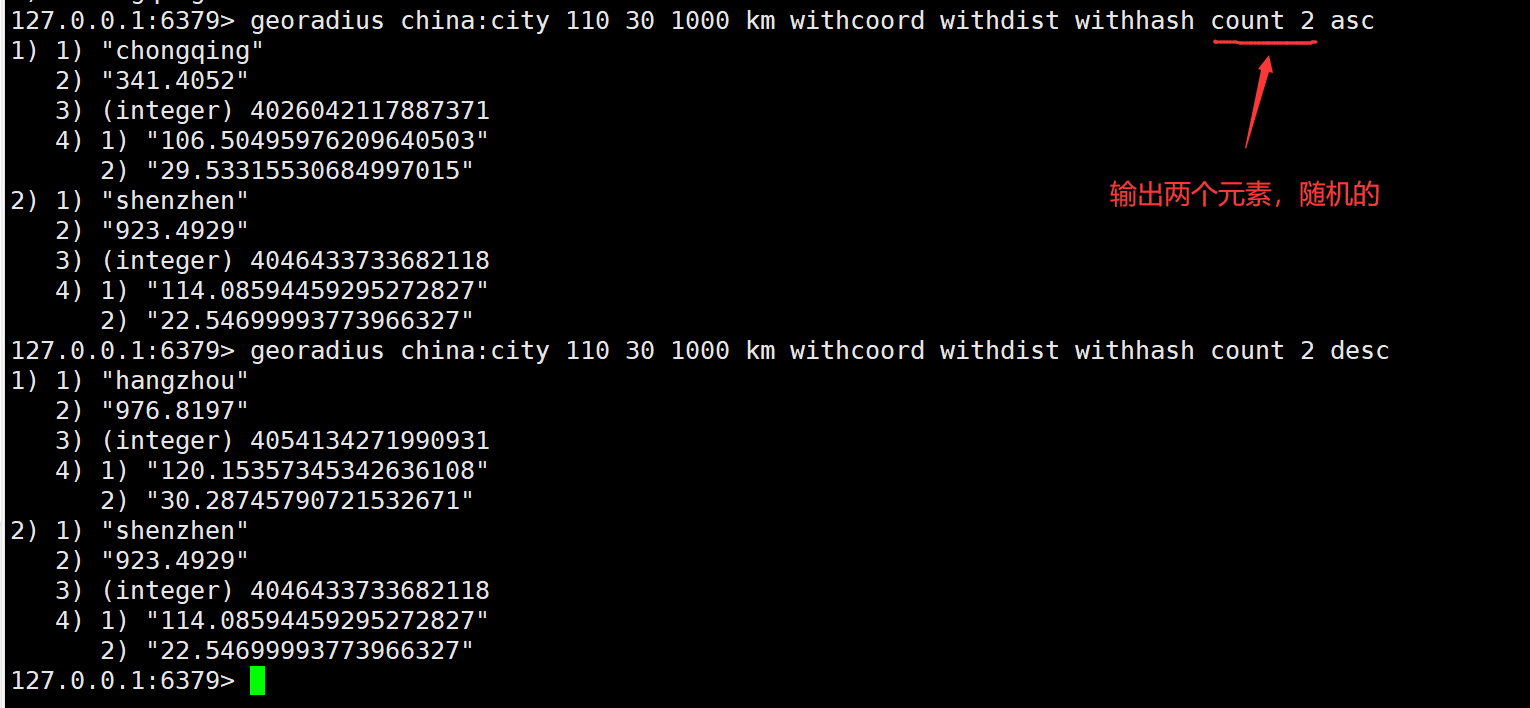

在给定以下可选项时, 命令会返回额外的信息:

WITHDIST: 在返回位置元素的同时, 将位置元素与中心之间的距离也一并返回。 距离的单位和用户给定的范围单位保持一致。WITHCOORD: 将位置元素的经度和维度也一并返回。WITHHASH: 以 52 位有符号整数的形式, 返回位置元素经过原始 geohash 编码的有序集合分值。 这个选项主要用于底层应用或者调试, 实际中的作用并不大。

命令默认返回未排序的位置元素。 通过以下两个参数, 用户可以指定被返回位置元素的排序方式:

ASC: 根据中心的位置, 按照从近到远的方式返回位置元素。DESC: 根据中心的位置, 按照从远到近的方式返回位置元素。

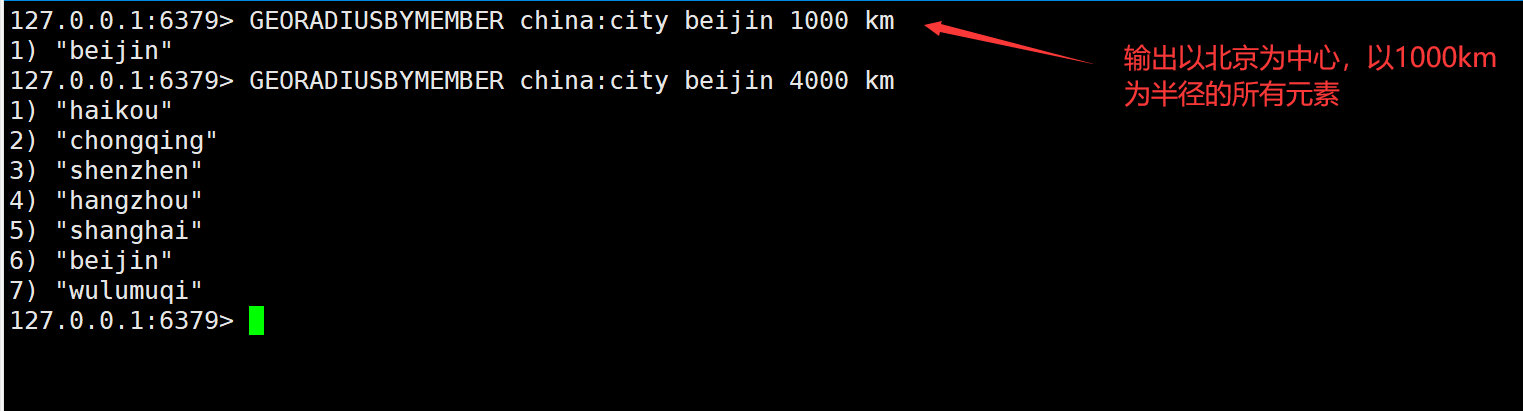

GEORADIUSBYMEMBER

时间复杂度:O(N+log(M))

127.0.0.1:6379> GEORADIUSBYMEMBER china:city beijin 1000 km 1) "beijin" 127.0.0.1:6379> GEORADIUSBYMEMBER china:city beijin 4000 km 1) "haikou" 2) "chongqing" 3) "shenzhen" 4) "hangzhou" 5) "shanghai" 6) "beijin" 7) "wulumuqi"

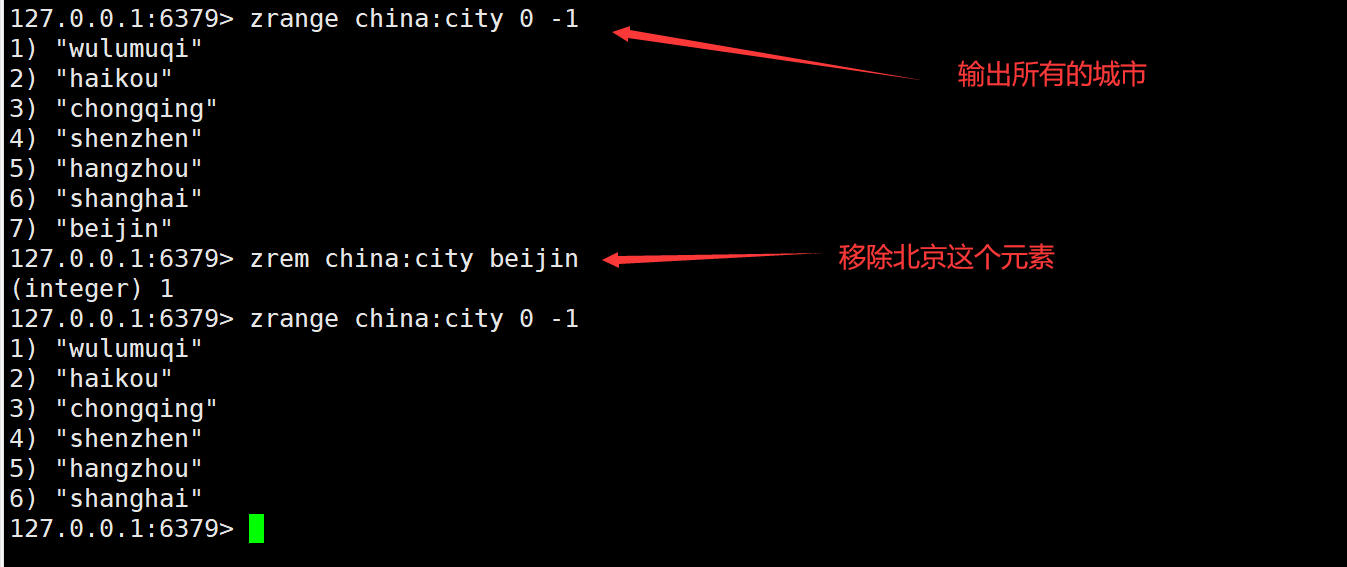

Geo的底层实现原理其实就是Zset,我们可以使用Zset命令操作Geo

127.0.0.1:6379> zrange china:city 0 -1 1) "wulumuqi" 2) "haikou" 3) "chongqing" 4) "shenzhen" 5) "hangzhou" 6) "shanghai" 7) "beijin" 127.0.0.1:6379> zrem china:city beijin (integer) 1 127.0.0.1:6379> zrange china:city 0 -1 1) "wulumuqi" 2) "haikou" 3) "chongqing" 4) "shenzhen" 5) "hangzhou" 6) "shanghai"

hyperloglog(基数统计)

简介

Redis的基数统计算法结构HyperLogLog。HyperLogLog结构是Redis在在 2.8.9 版本新增加的。

HyperLogLog 是用来做基数统计的算法,HyperLogLog 的优点是,在输入元素的数量或者体积非常非常大时,计算基数所需的空间总是固定 的、并且是很小的。在 Redis 里面,每个 HyperLogLog 键只需要花费 12 KB 内存,就可以计算接近 2^64 个不同元素的基 数。

但是,因为 HyperLogLog 只会根据输入元素来计算基数,而不会储存输入元素本身,所以 HyperLogLog 不能像集合那样,返回输入的各个元素。

什么是基数?

一般来说一组数据中,去掉重复的数据后的数据,可称为基数。比如数据集 {1, 3, 5, 7, 5, 7, 8}, 那么这个数据集的基数集为 {1, 3, 5 ,7, 8}, 基数(不重复元素)为5。 基数估计就是在误差可接受的范围内,快速计算基数。

网页的UV(一个人访问网站多次,但是还是算作一个人)

传统的方式,set保存用户的id,然后就可以统计set中元素数量作为判断标准。

这个方式如果保存大量的用户id,就会比较麻烦!我们的目的是为了计数,而不是保存用户id。

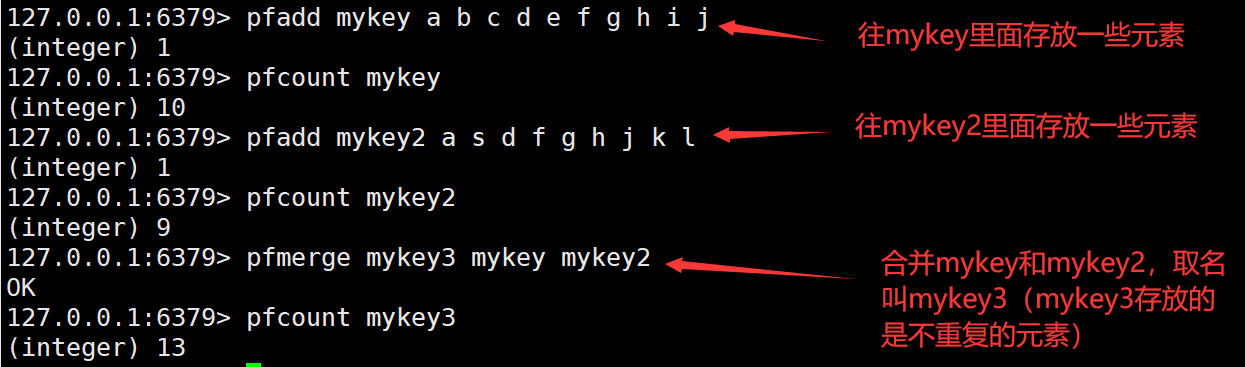

测试,统计计数

127.0.0.1:6379> pfadd mykey a b c d e f g h i j (integer) 1 127.0.0.1:6379> pfcount mykey (integer) 10 127.0.0.1:6379> pfadd mykey2 a s d f g h j k l (integer) 1 127.0.0.1:6379> pfcount mykey2 (integer) 9 127.0.0.1:6379> pfmerge mykey3 mykey mykey2 OK 127.0.0.1:6379> pfcount mykey3 (integer) 13

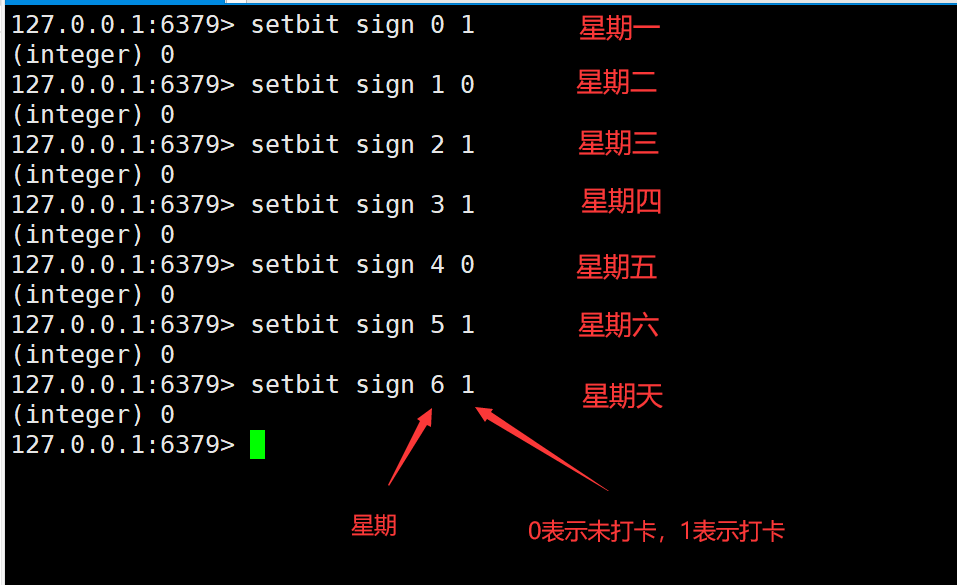

bitmap(位图场景)

位存储

Bitmaps位图,数据结构!都是操作二进制位来进行记录。就只有0和1两个状态。

存值

127.0.0.1:6379> setbit sign 0 1 (integer) 0 127.0.0.1:6379> setbit sign 1 0 (integer) 0 127.0.0.1:6379> setbit sign 2 1 (integer) 0 127.0.0.1:6379> setbit sign 3 1 (integer) 0 127.0.0.1:6379> setbit sign 4 0 (integer) 0 127.0.0.1:6379> setbit sign 5 1 (integer) 0 127.0.0.1:6379> setbit sign 6 1 (integer) 0

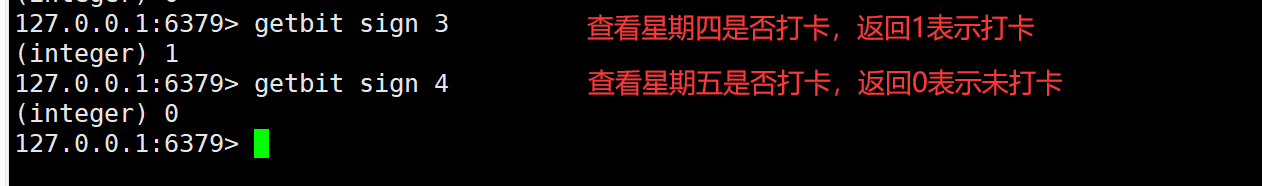

查看某一天是否打卡

查看指定的值

127.0.0.1:6379> getbit sign 3 (integer) 1 127.0.0.1:6379> getbit sign 4 (integer) 0

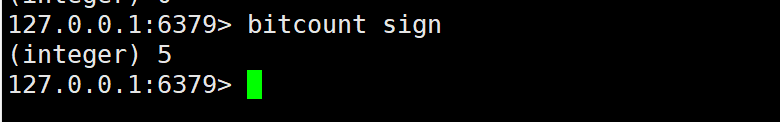

统计

统计打卡的天数

127.0.0.1:6379> bitcount sign (integer) 5

事务

Redis事务本质:一组命令的集合!一个事务中所有的命令都会被序列化,事务在执行的过程中,会按照顺序执行。

一次性,顺序性,排他性!执行一系列的命令!

----- 队列 set set set 执行-------

Redis事务没有隔离级别的概念

所有的命令在事务中,并没有直接被执行,只有发起执行命令的时候才会执行。

Redis单条命令是原子性的,但是事务不保证原子性。

redis的事务:

- 开启事务(multi)

- 命令入队(....)

- 执行事务(exec)

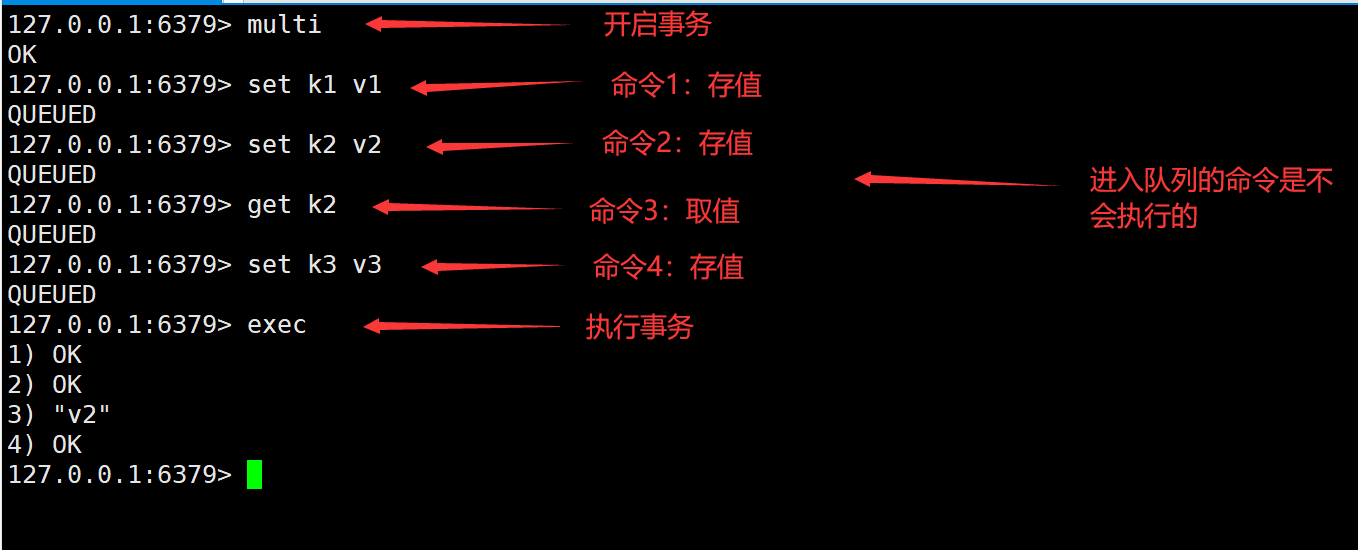

正常执行事务

127.0.0.1:6379> multi OK 127.0.0.1:6379> set k1 v1 QUEUED 127.0.0.1:6379> set k2 v2 QUEUED 127.0.0.1:6379> get k2 QUEUED 127.0.0.1:6379> set k3 v3 QUEUED 127.0.0.1:6379> exec 1) OK 2) OK 3) "v2" 4) OK

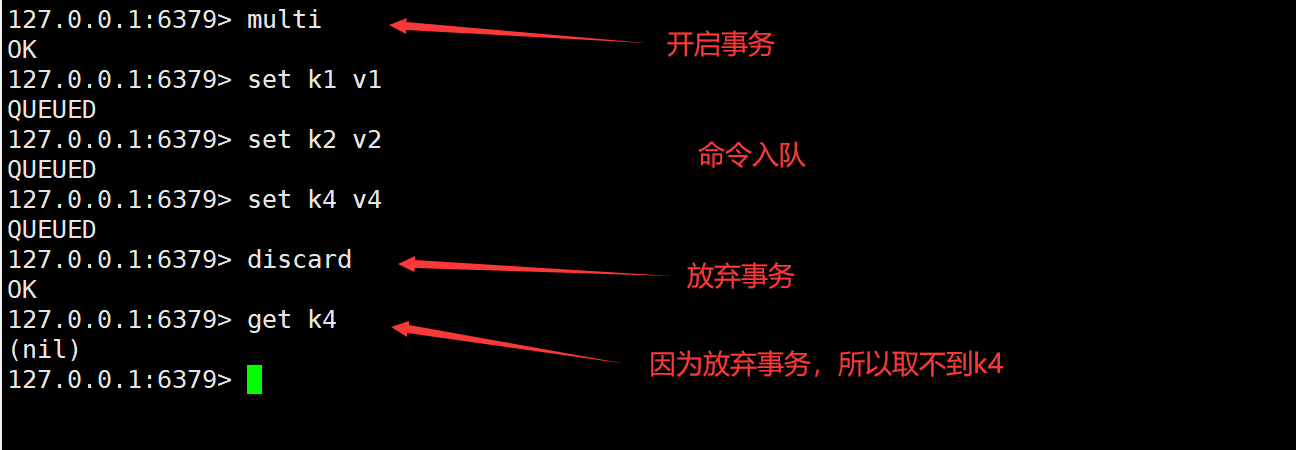

放弃事务

入队的命令都不会被执行

127.0.0.1:6379> multi OK 127.0.0.1:6379> set k1 v1 QUEUED 127.0.0.1:6379> set k2 v2 QUEUED 127.0.0.1:6379> set k4 v4 QUEUED 127.0.0.1:6379> discard OK 127.0.0.1:6379> get k4 (nil)

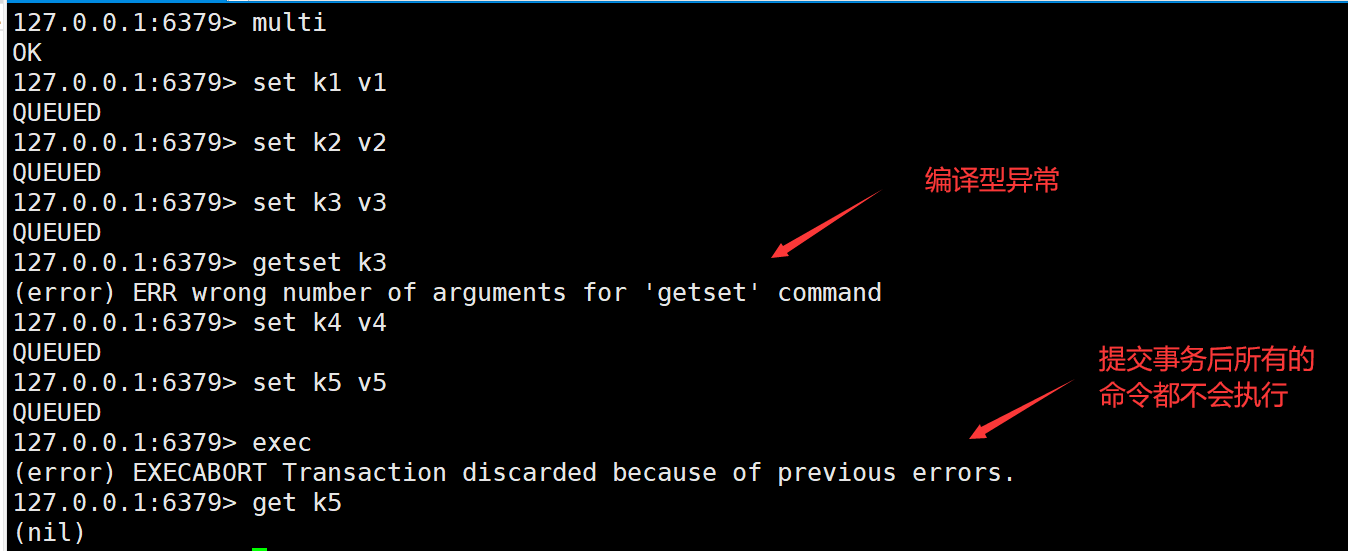

编译型异常

(代码有问题!命令有错!事务中所有的命令都不会被执行!)

127.0.0.1:6379> multi OK 127.0.0.1:6379> set k1 v1 QUEUED 127.0.0.1:6379> set k2 v2 QUEUED 127.0.0.1:6379> set k3 v3 QUEUED 127.0.0.1:6379> getset k3 (error) ERR wrong number of arguments for 'getset' command 127.0.0.1:6379> set k4 v4 QUEUED 127.0.0.1:6379> set k5 v5 QUEUED 127.0.0.1:6379> exec (error) EXECABORT Transaction discarded because of previous errors. 127.0.0.1:6379> get k5 (nil)

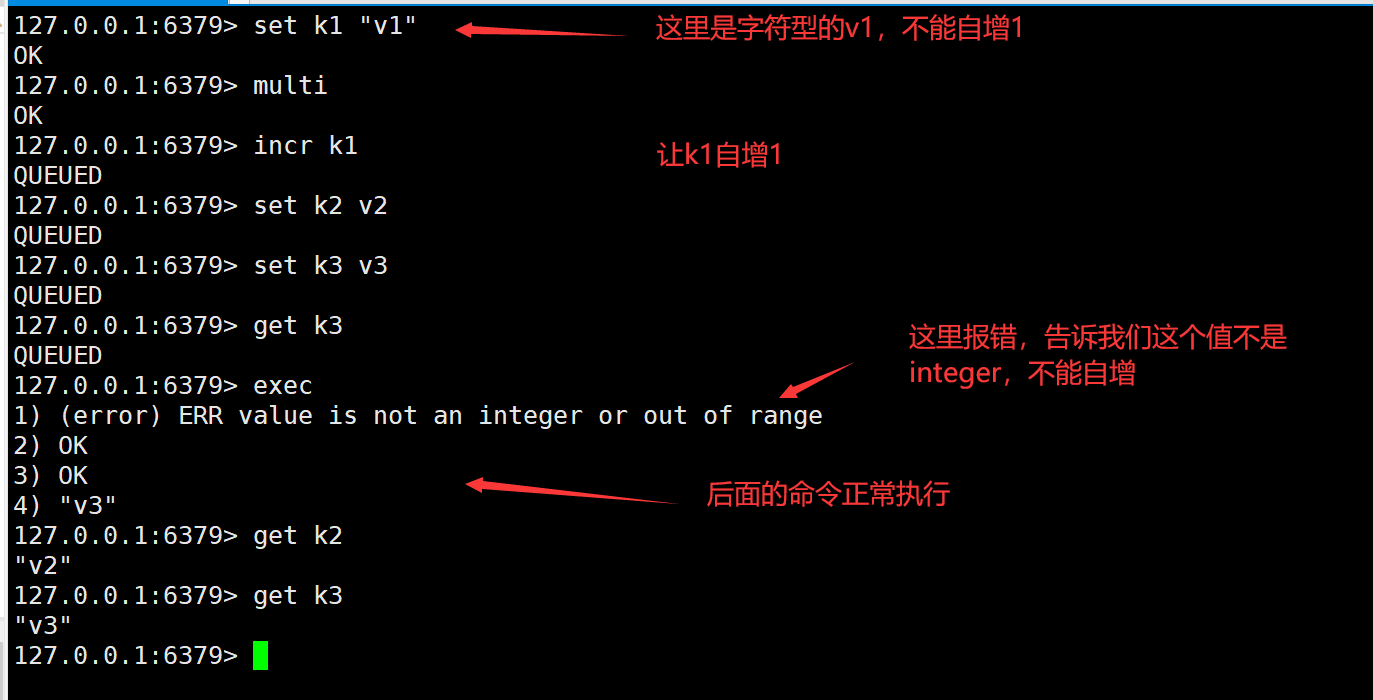

运行异常

(1/0的异常),如果事务队列中存在语法性异常,那么执行命令的时候,其他命令依然会正常执行。(所以这就是redis的事务不存在原子性)

127.0.0.1:6379> set k1 "v1" OK 127.0.0.1:6379> multi OK # 下面这行代码语法没有错误,但是运行是错误的 127.0.0.1:6379> incr k1 QUEUED 127.0.0.1:6379> set k2 v2 QUEUED 127.0.0.1:6379> set k3 v3 QUEUED 127.0.0.1:6379> get k3 QUEUED 127.0.0.1:6379> exec 1) (error) ERR value is not an integer or out of range 2) OK 3) OK 4) "v3" 127.0.0.1:6379> get k2 "v2" 127.0.0.1:6379> get k3 "v3"

监控watch

悲观锁

- 很悲观,什么时候都会出问题,无论干什么都不会出现问题

乐观锁

- 很乐观,认为什么时候都不会出问题,所以不会上锁,更新数据的时候去判断一下,在此期间是否有人修改过这个数据。

- 获取version

- 更新的时候比较version

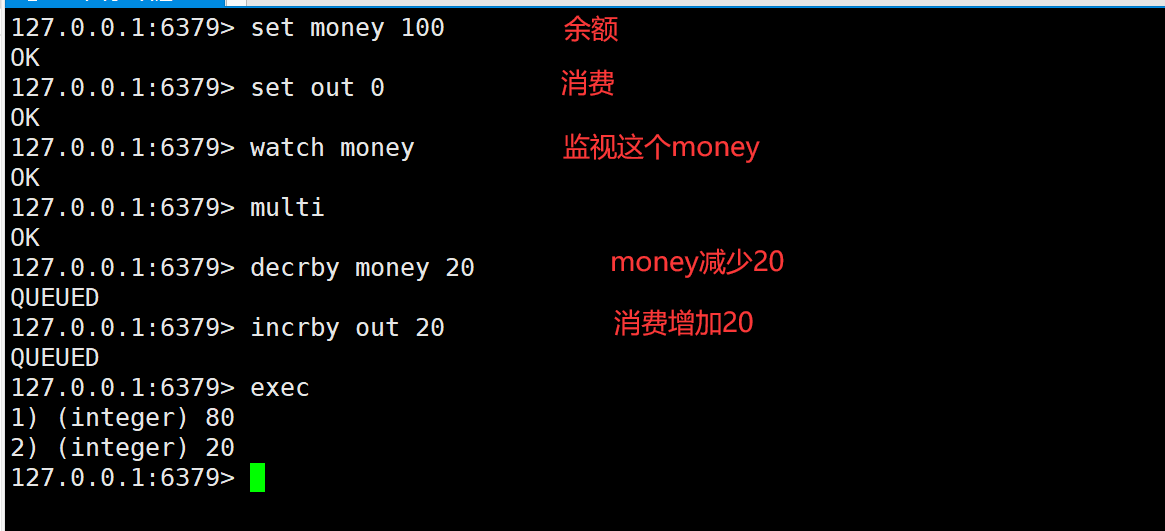

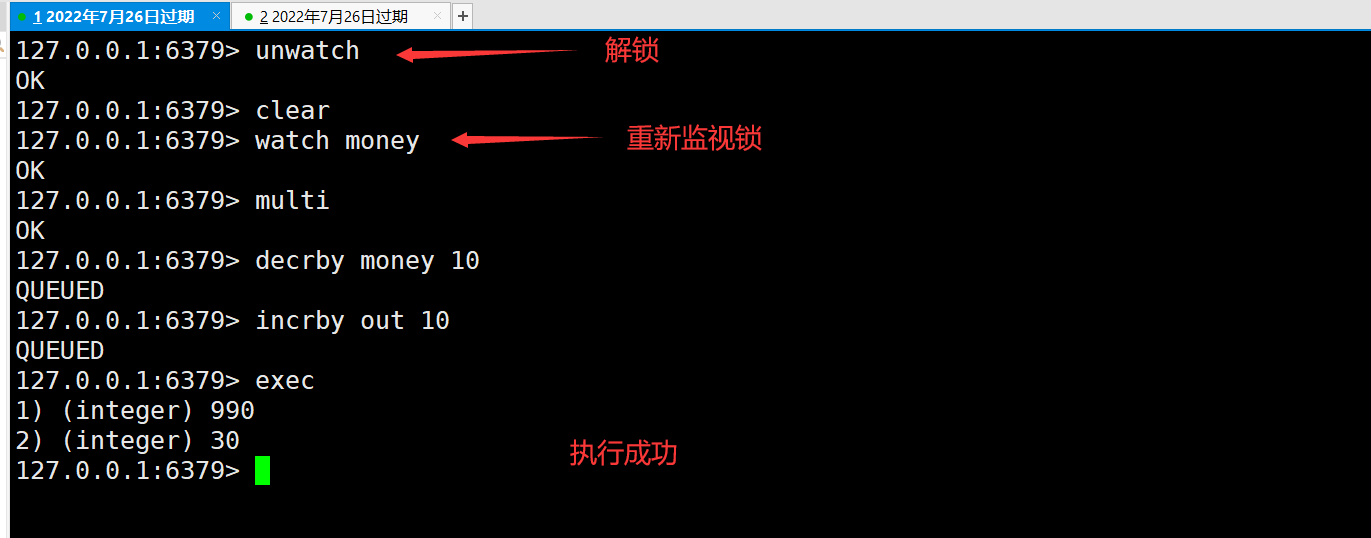

Redis的监视测试

乐观锁

正常执行成功

事务期间,数据没有发生变化

127.0.0.1:6379> clear 127.0.0.1:6379> set money 100 OK 127.0.0.1:6379> set out 0 OK 127.0.0.1:6379> watch money OK 127.0.0.1:6379> multi OK 127.0.0.1:6379> decrby money 20 QUEUED 127.0.0.1:6379> incrby out 20 QUEUED 127.0.0.1:6379> exec 1) (integer) 80 2) (integer) 20

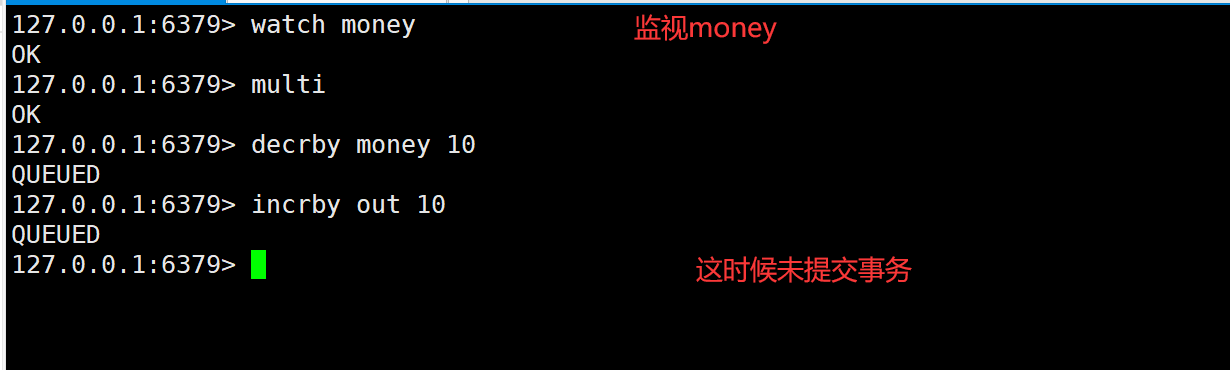

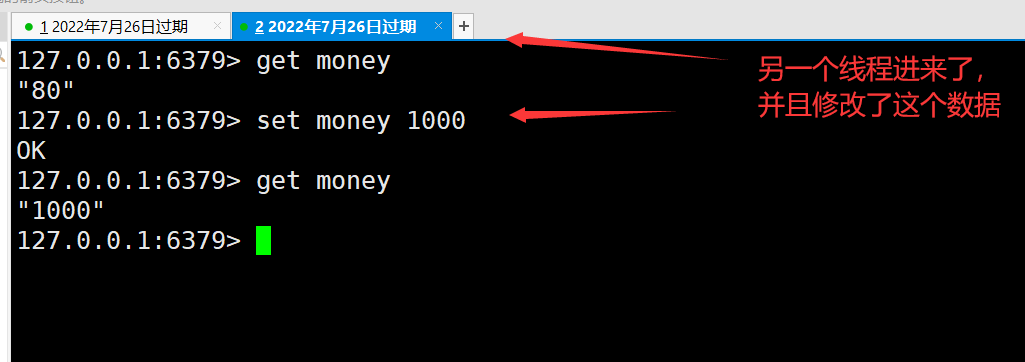

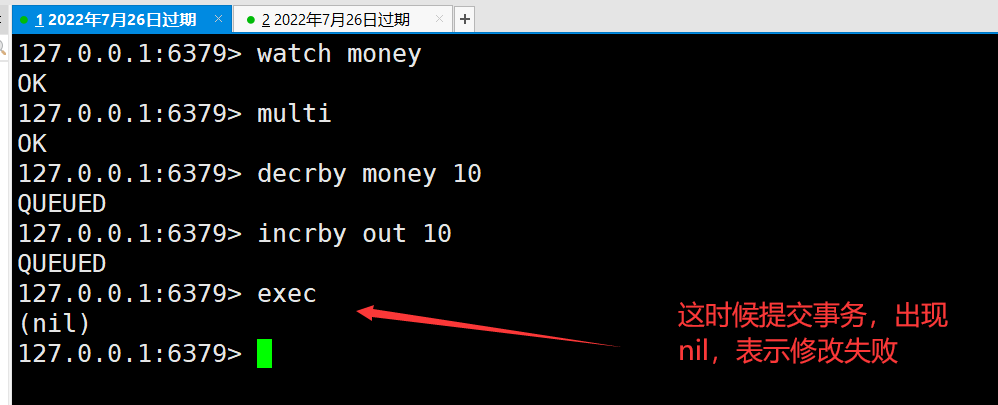

异常执行

一条数据正在被监视,期间另一条线程改变了这个数据

测试多线程修改值,使用watch可以当做redis的乐观锁操作

另一个线程突然进来

提交事务

需要解锁,然后重新获得锁

执行失败必须解锁,然后重新获得锁

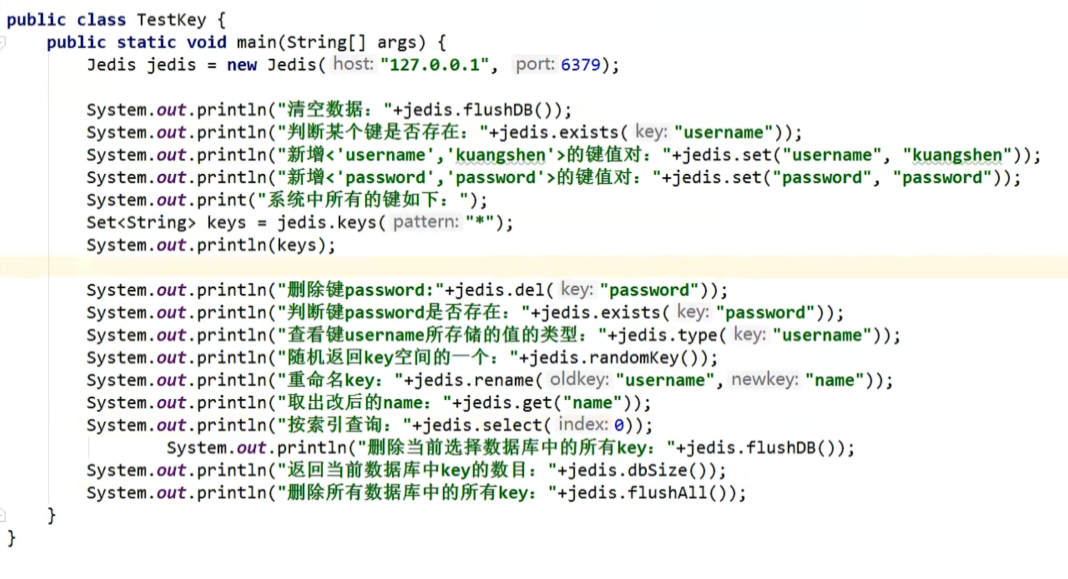

Jedis

我们要使用java来操作Redis

什么是jedis

- 是Redis官方推荐的java连接开发工具!使用java操作redis中间件。如果要使用java操作redis,那么一定要对jedis非常熟悉!

测试

1、导入对应的依赖

<?xml version="1.0" encoding="UTF-8"?> <project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance" xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd"> <modelVersion>4.0.0</modelVersion> <groupId>com.dahai</groupId> <artifactId>redis-01-jedis</artifactId> <version>1.0-SNAPSHOT</version> <dependencies> <!--导入jedis的包--> <!-- https://mvnrepository.com/artifact/redis.clients/jedis --> <dependency> <groupId>redis.clients</groupId> <artifactId>jedis</artifactId> <version>4.2.3</version> </dependency> <!--fastjson--> <dependency> <groupId>com.alibaba</groupId> <artifactId>fastjson</artifactId> <version>1.2.80</version> </dependency> </dependencies> </project>

2、编码测试

- 连接数据库

- 操作命令

- 断开连接

用Jedis连接阿里云等服务器上的redis 一. 配置redis.conf 1.设置访问redis的密码:requirepass 要设置密码 2.注释bind 127.0.0.1 (重启redis-server服务,进入redis后要先验证密码,用这个命令:auth 密码 ,然后ping一下看有没有配置成功) 二 . idea访问时添加auth密码 Jedis jedis = new Jedis("服务器的外网ip",6379); jedis.auth("redis的密码"); System.out.println(jedis.ping()); (输出PONG的话就成功了) # ========================================= 首先要开启安全组策略6379!!!!!!!!! 然后bind注释掉所有!!!!!!! 受保护的也设置为no!!!!! 防护墙也要关掉!!!! 且要重启才能生效!!!

连接本地redis

package com.dahai; import redis.clients.jedis.Jedis; public class TestPing { public static void main(String[] args) { //1、new 一个jedis对象即可 Jedis jedis = new Jedis("127.0.0.1",6379); //jedis 所有的命令就是我们之前学习的所有指令! System.out.println(jedis.ping()); } } //输出结果:PONG

常用API

String

List

Set

Hash

Zset

事务

package com.dahai; import org.json.JSONArray; import org.json.JSONObject; import redis.clients.jedis.Jedis; import redis.clients.jedis.Transaction; public class TestTx { public static void main(String[] args) { //1、new 一个jedis对象即可 Jedis jedis = new Jedis("127.0.0.1",6379); //jedis 所有的命令就是我们之前学习的所有指令! System.out.println(jedis.ping()); JSONObject jsonObject = new JSONObject(); jsonObject.put("hello","world"); jsonObject.put("name","dahai"); //开启事务 Transaction multi = jedis.multi(); String result = jsonObject.toString(); try { multi.set("user1",result); multi.set("user2",result); multi.exec(); //执行事务 }catch (Exception e){ multi.discard(); //放弃事务 e.printStackTrace(); }finally { System.out.println(jedis.get("user1")); System.out.println(jedis.get("user2")); jedis.close(); //关闭连接 } } }

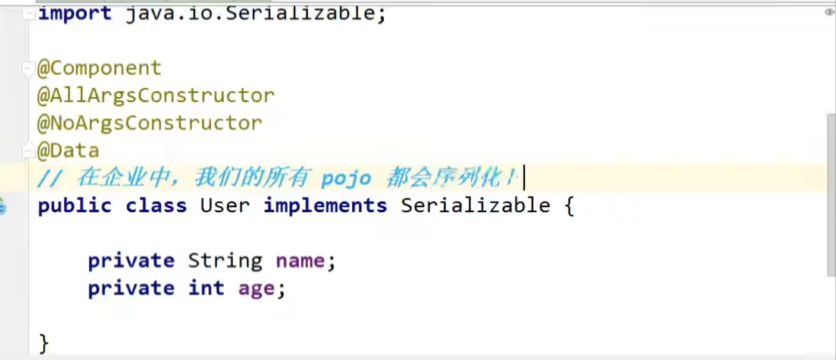

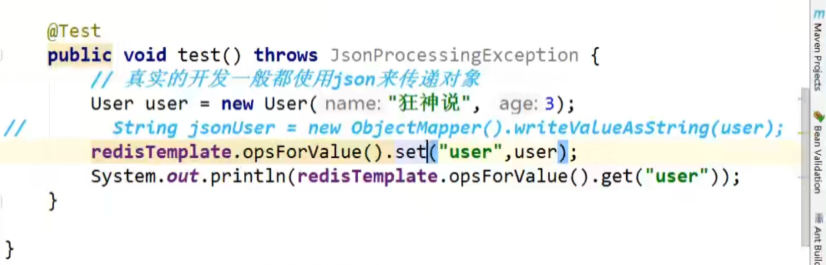

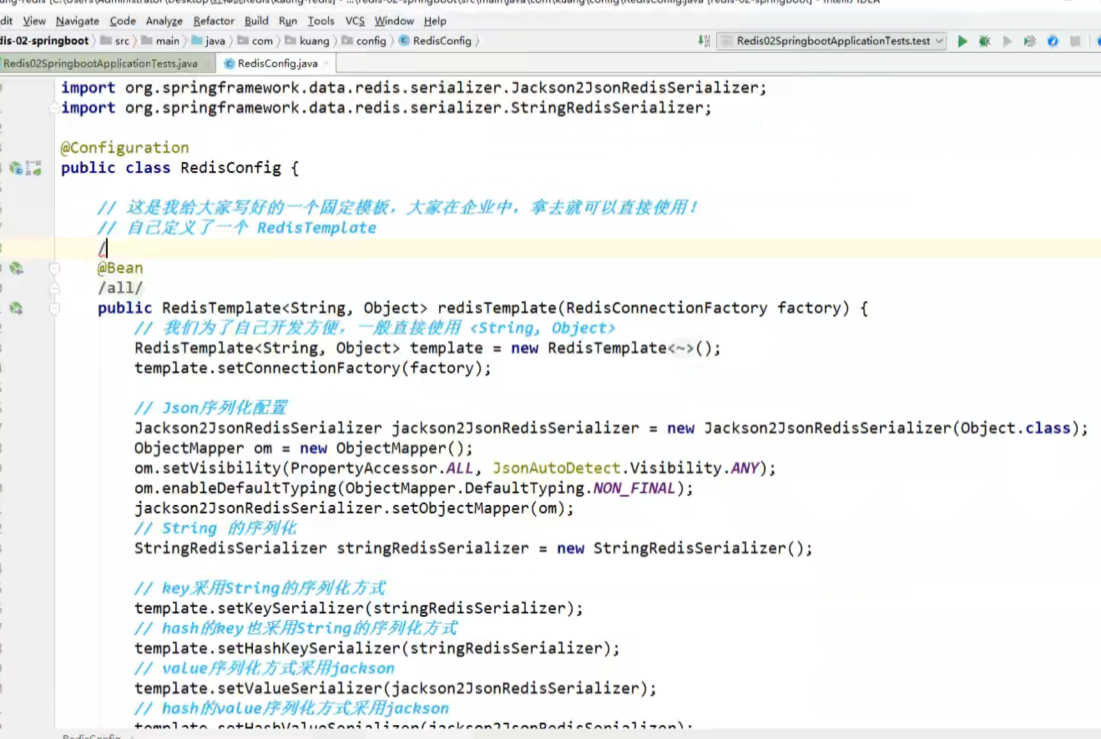

SpringBoot整合

需要再次看视频复习

说明:在springboot2.x之后,原来使用的jedis被替换成了lettuce。

jedis:采用的是直连,多个线程操作的话是不安全的,如果想要避免不安全,使用jedis pool连接池!BIO

lettuce:采用netty,实例可以在多个线程中被共享,不存在线程不安全的情况!可以减少线程数据,更像NIO模式

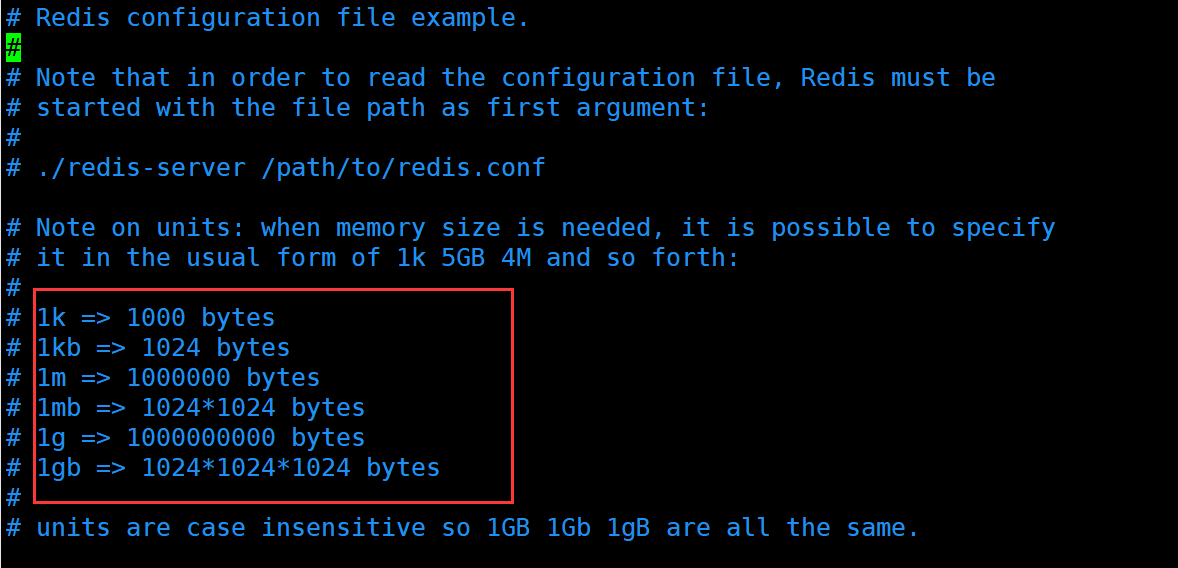

Redis.conf详解

启动的时候,就通过配置文件来启动的

单位

1、配置文件unit单位对大小写不敏感!

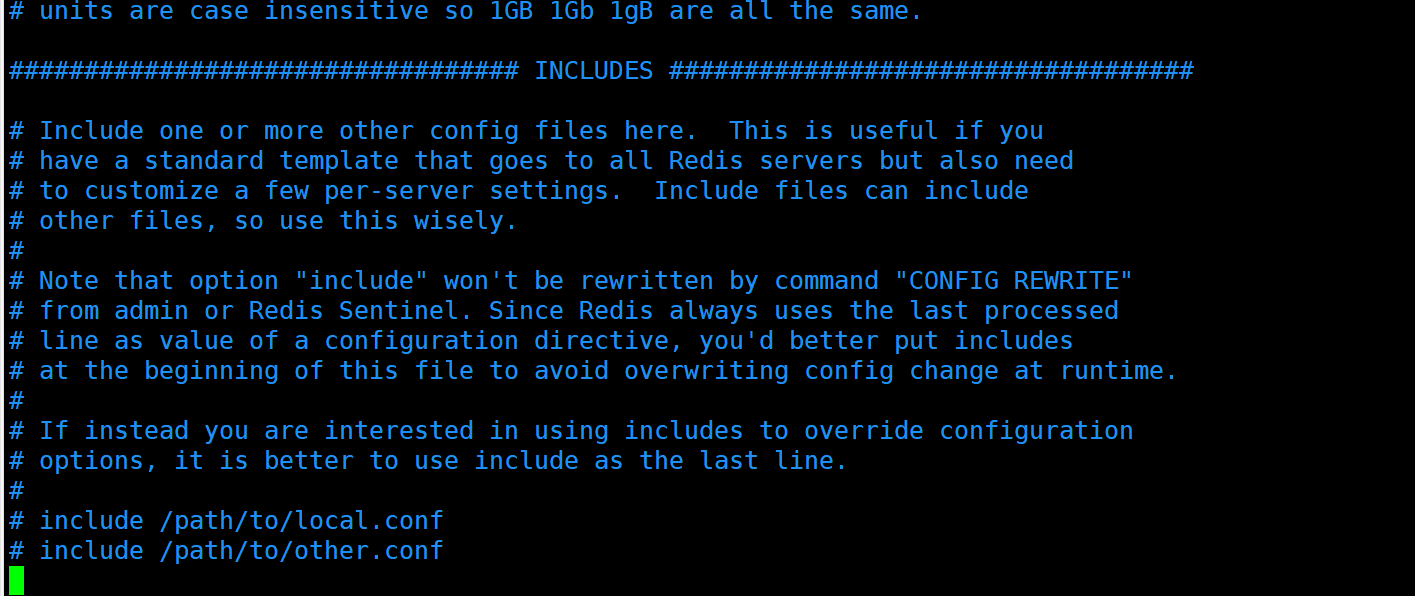

包含

就好比我们学习spring、import、include

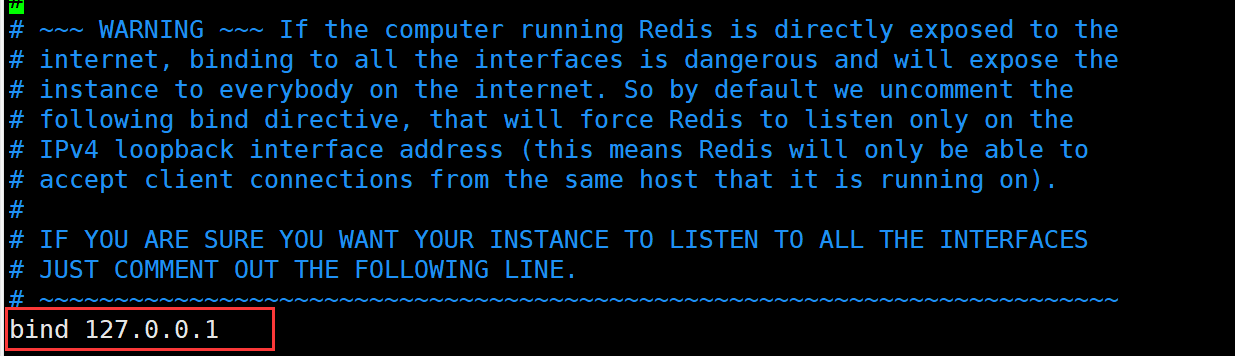

网络

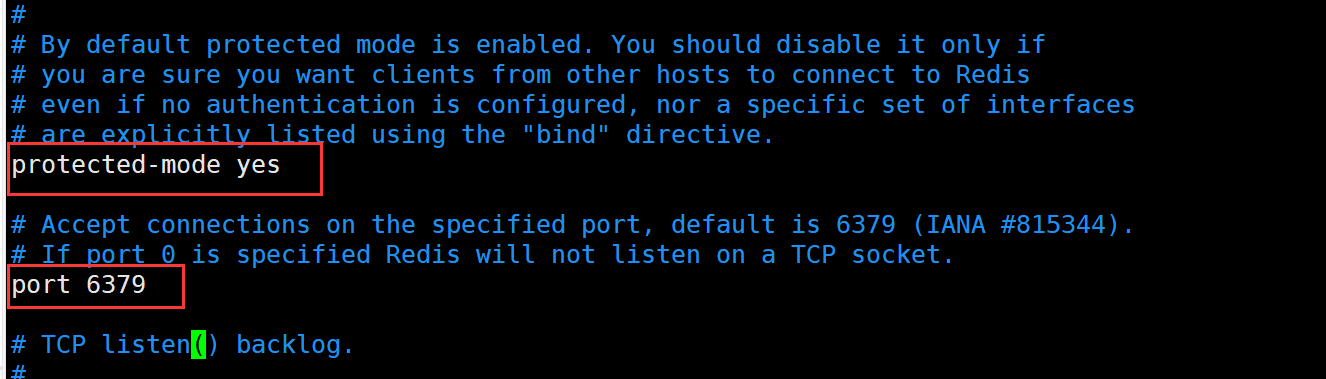

bind 127.0.0.1 # 绑定的ip protected-model yes # 保护模式 port 6379 # 端口设置

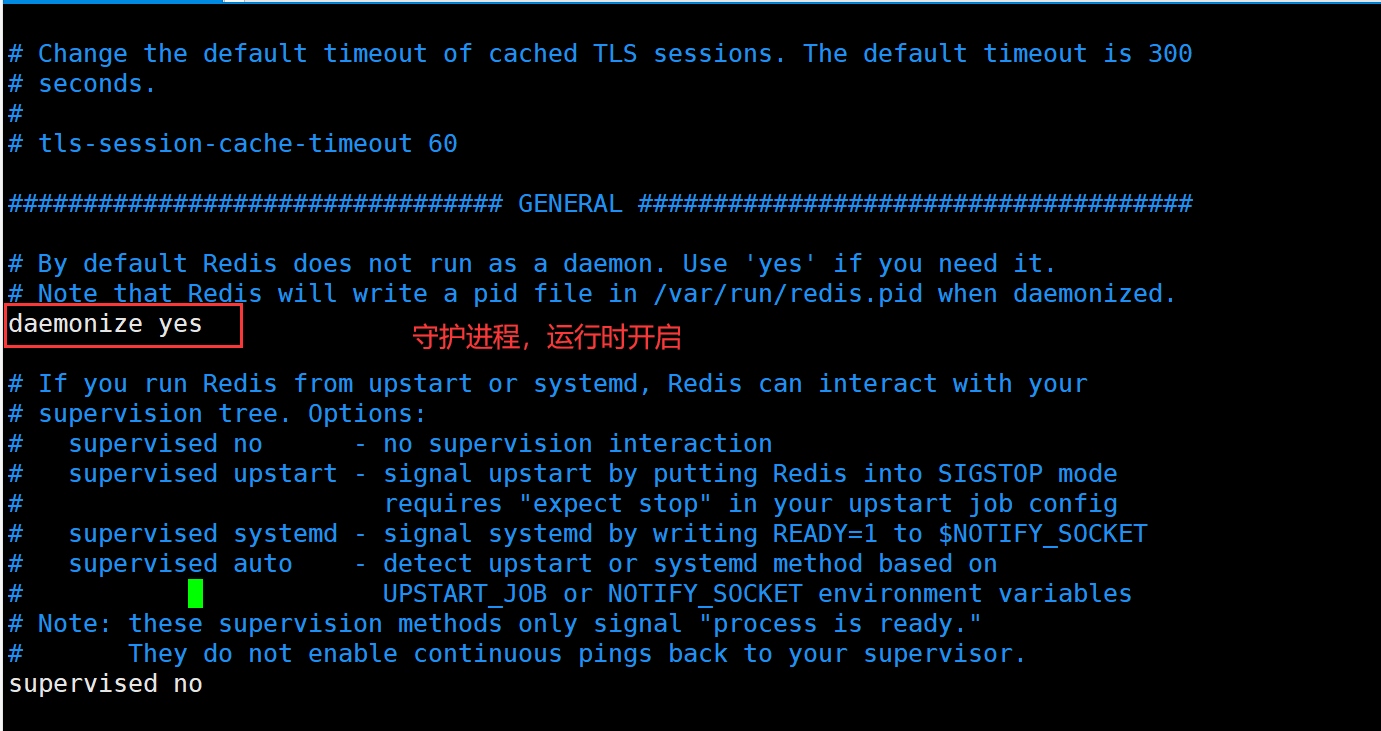

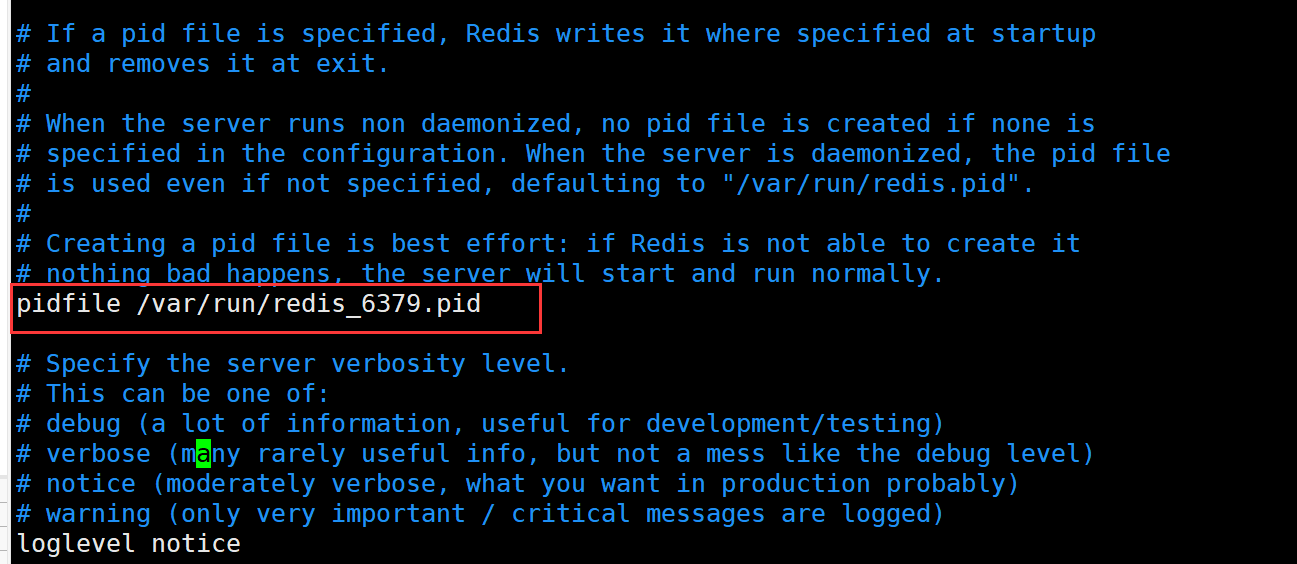

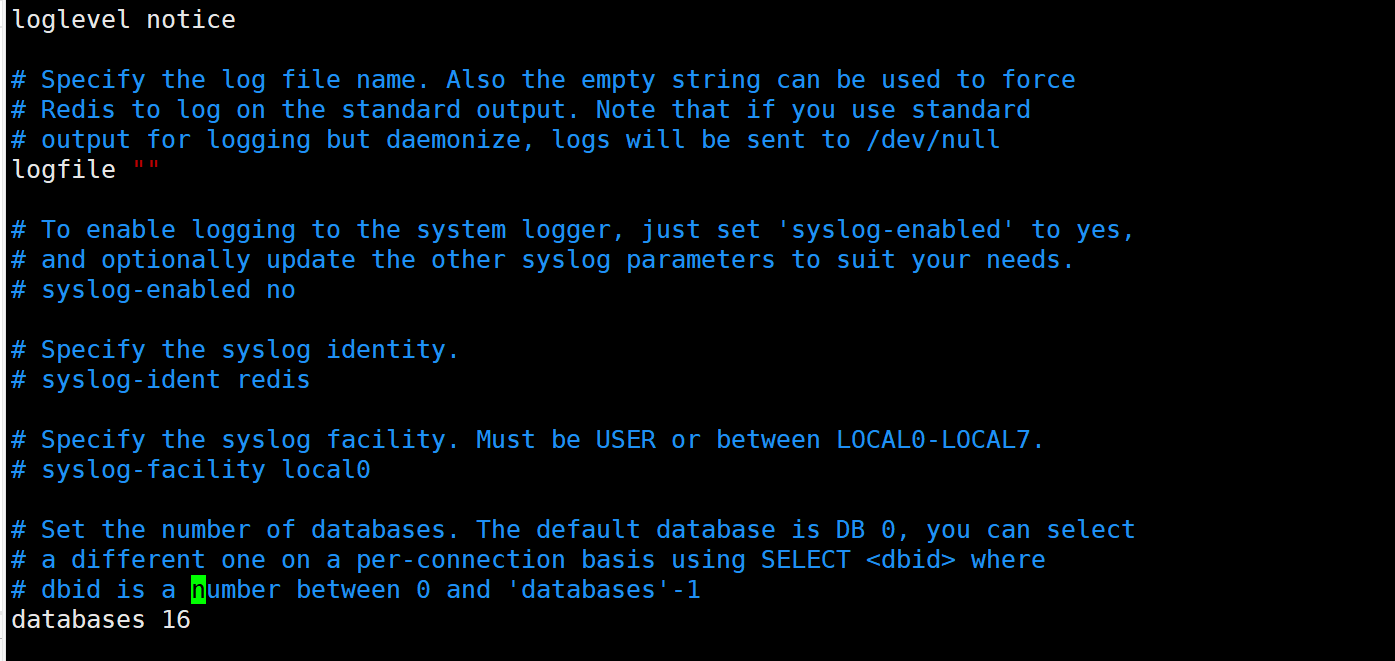

通用GENERAL

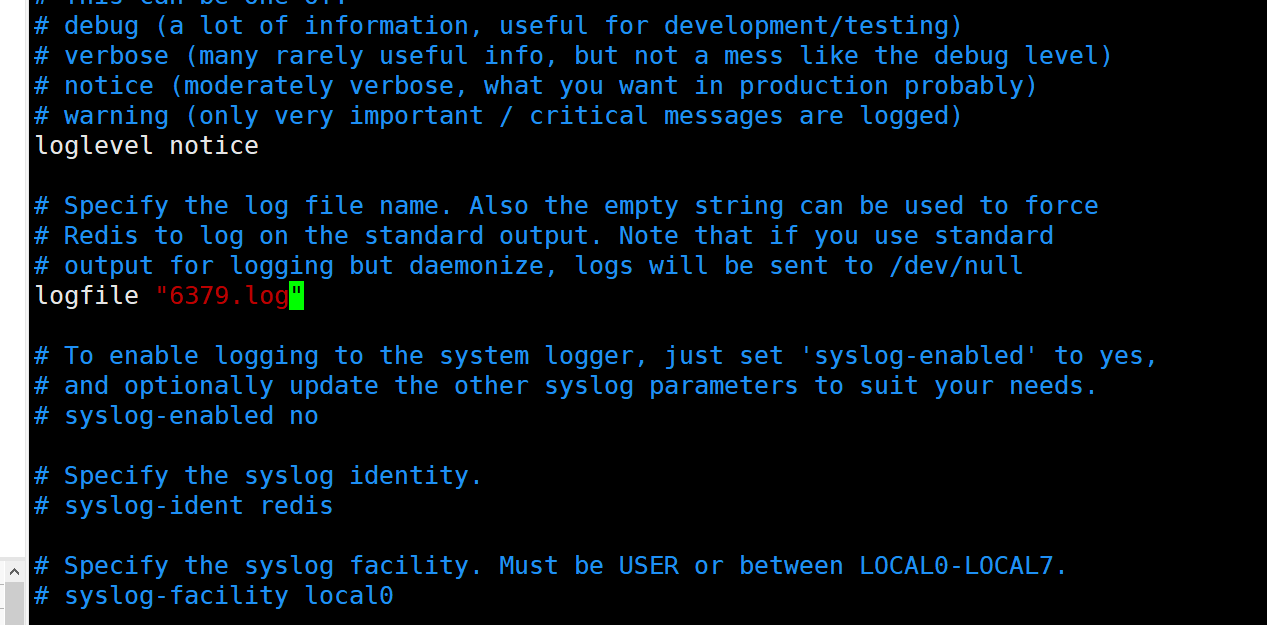

daemonize yes # 以守护进程的方式运行,默认是no,我们需要自己开启为yes pidfile /var/run/redis_6379.pid # 如果以后台方式运行,我们就需要指定一个pid文件! # 日志 # Specify the server verbosity level. # This can be one of: # debug (a lot of information, useful for development/testing) # verbose (many rarely useful info, but not a mess like the debug level) # notice (moderately verbose, what you want in production probably) # warning (only very important / critical messages are logged) loglevel notice logfile "" # 日志的文件位置名 databases 16 # 数据库的数量,默认是16个 always-show-logo yes # 是否总是显示logo

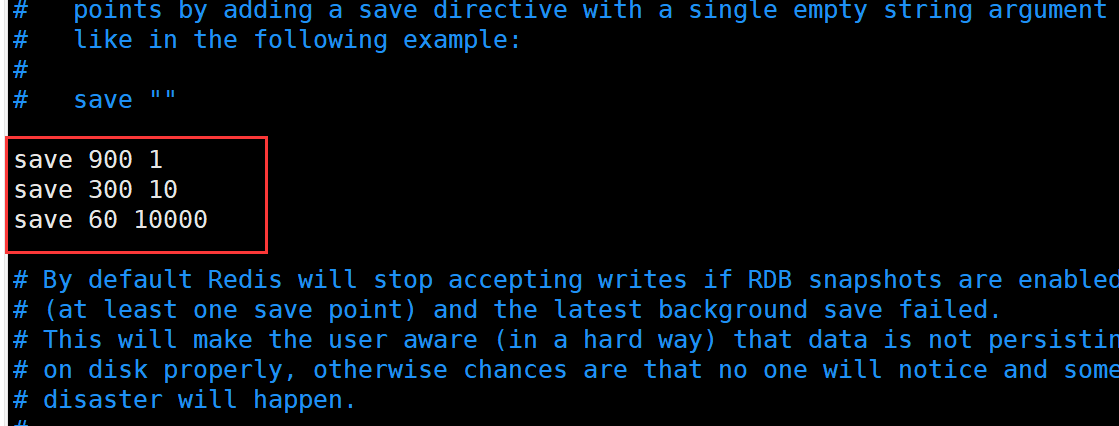

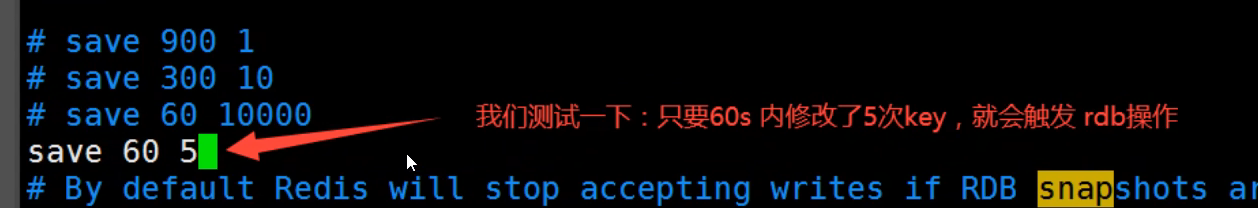

快照

RDB

持久化,在规定时间内,执行了多少次操作,则会持久化到文件 .rdb.aof

redis是内存数据库,如果没有持久化,那么数据断电及失

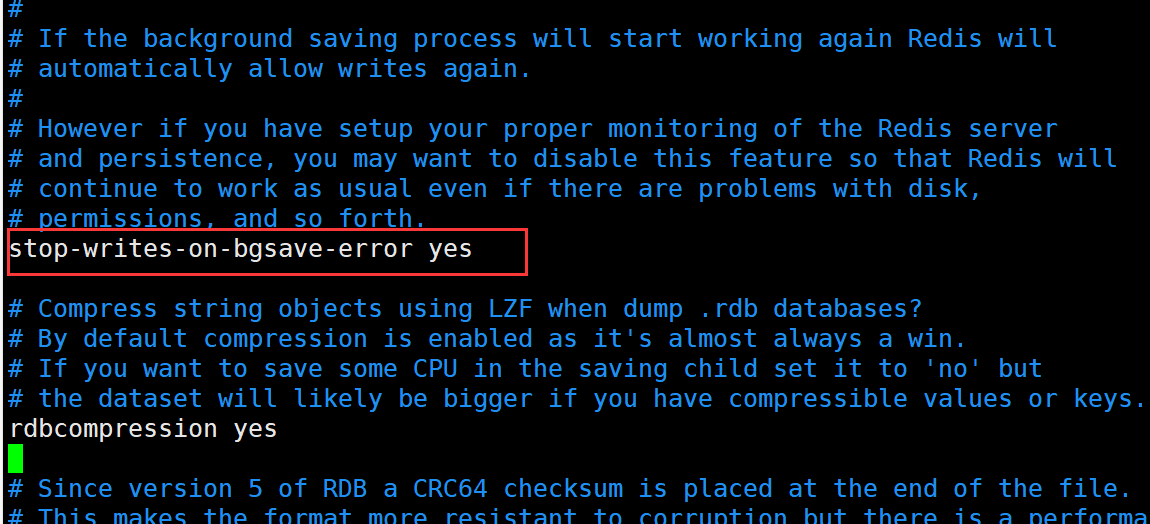

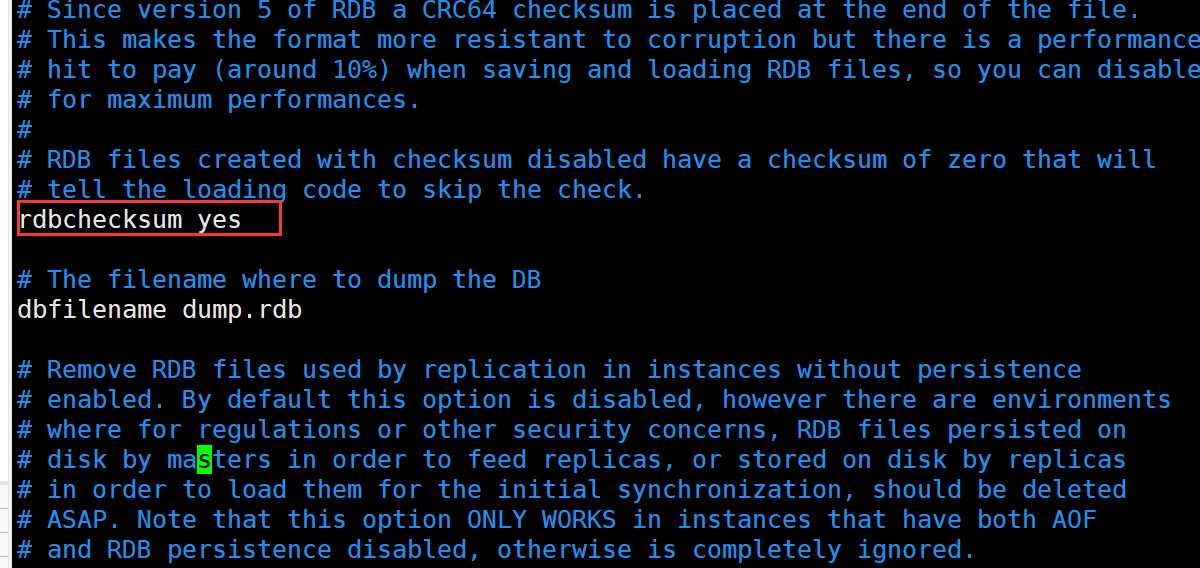

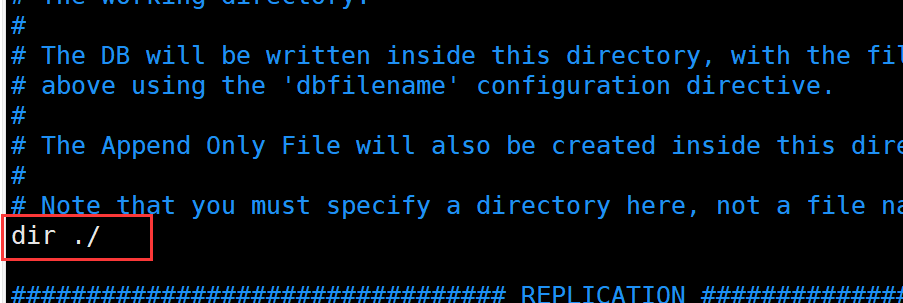

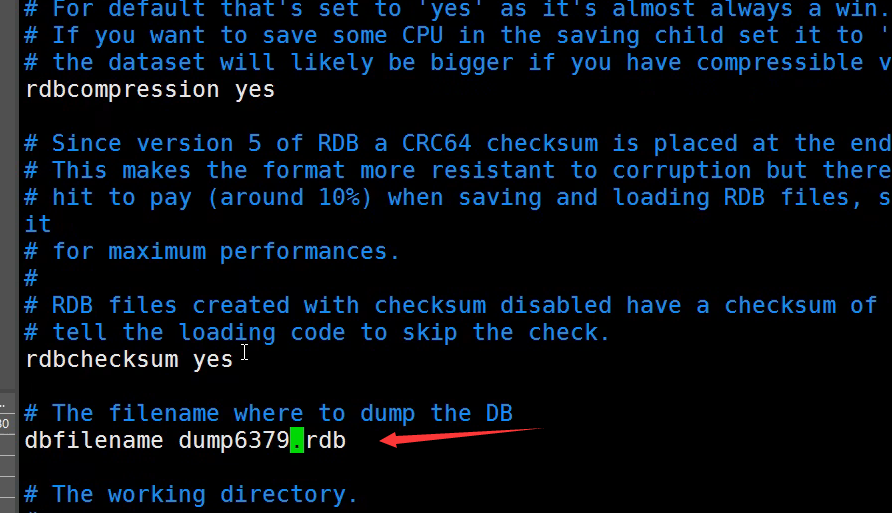

# 如果900秒内,如果至少有1个key进行了修改,我们就进行持久化操作 save 900 1 # 如果300秒内,如果至少有10个key进行了修改,我们就进行持久化操作 save 300 10 # 如果60秒内,如果至少有10000个key进行了修改,我们就进行持久化操作 save 60 10000 # 我们之后学习持久化,会自己定义这个测试 stop-writes-on-bgsave-error yes # 持久化如果出错,是否还需要继续工作 rdbcompression yes # 是否压缩rdb文件,需要消耗一些CPU资源! rdbchecksum yes # 是否校验rdb文件 dir ./ # rdb文件保存的目录

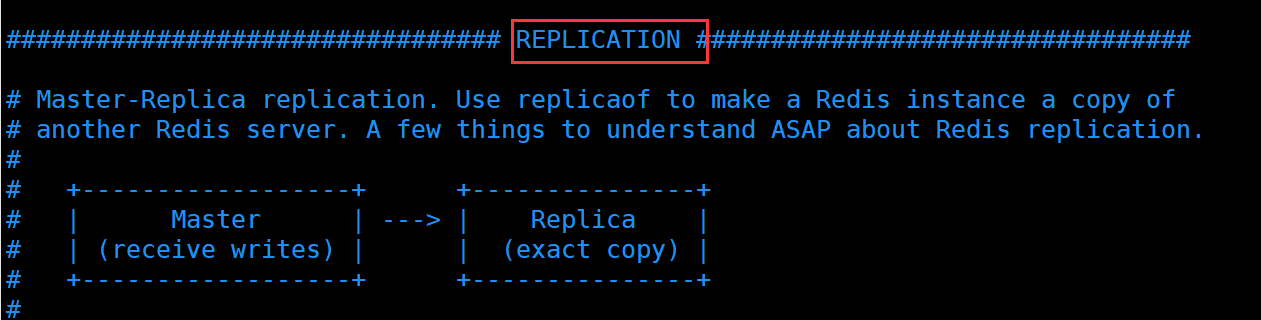

主从复制

REPLICATION

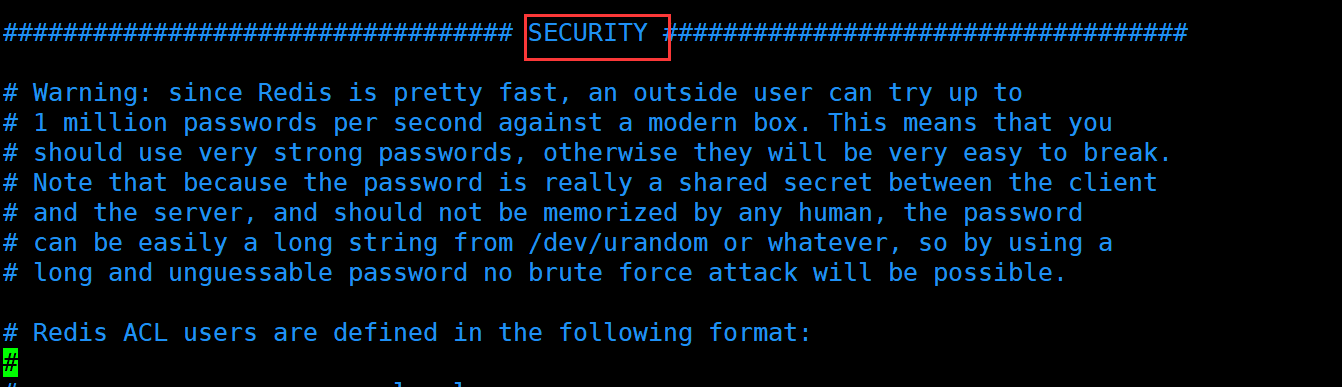

安全

127.0.0.1:6379> config get requirepass # 查看redis的登录密码 1) "requirepass" 2) "" 127.0.0.1:6379> config set requirepass "123456" # 设置redis的登录密码 ok 127.0.0.1:6379> ping (error) NOAUTH Authentication required # 这个意思是说,你没有权限登录 127.0.0.1:6379> auth 123456 # 使用redis的登录密码 ok 127.0.0.1:6379> config get requirepass 1) "requirepass" 2) "123456"

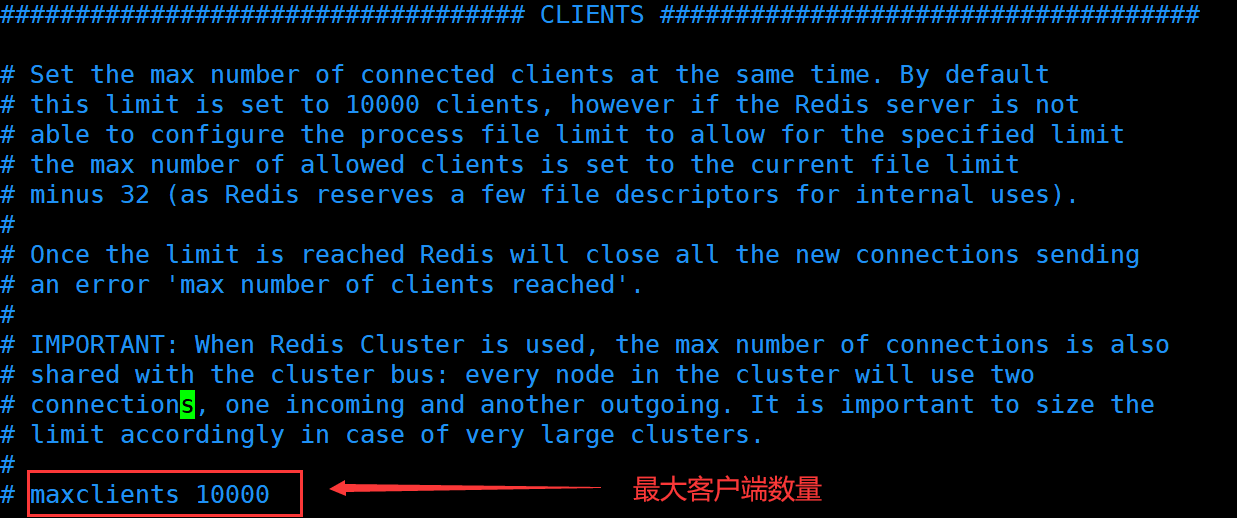

限制

CLIENTS

maxclients 10000 #设置能连接上redis的最大客户端的数量 maxmemory <bytes> #redis配置最大的内存容量 maxmemory-policy noeviction #内存到达上限之后的处理策略 # 移除一些过期的key # 报错

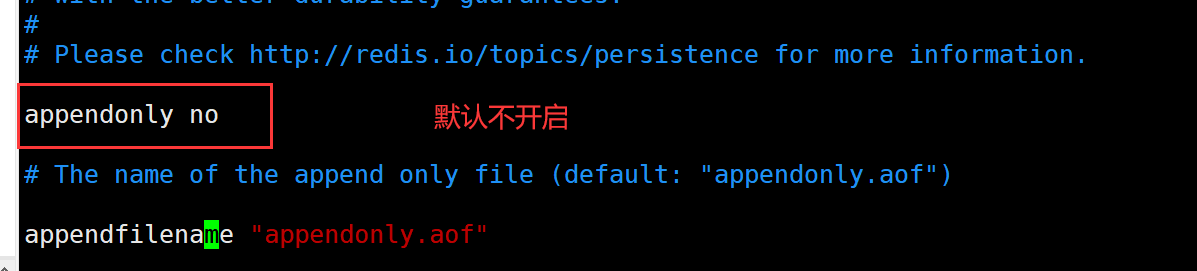

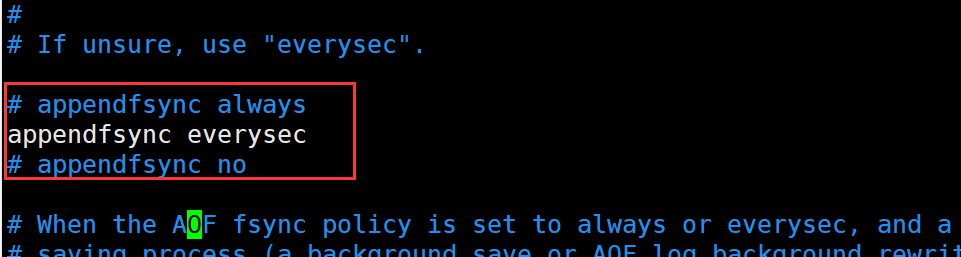

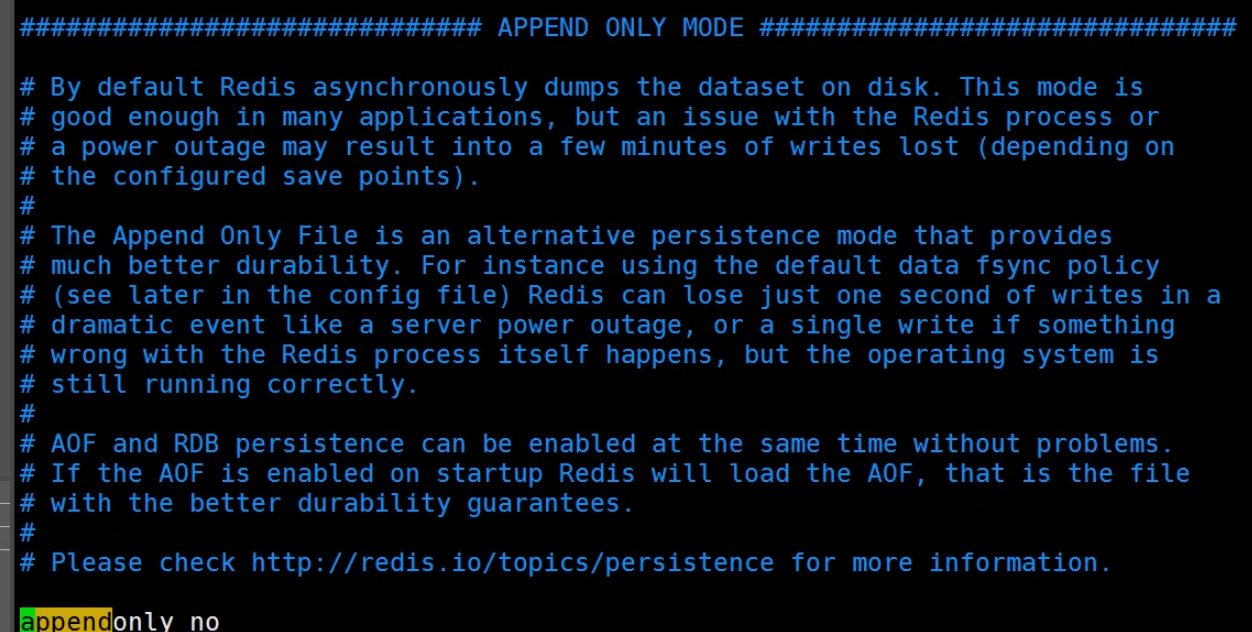

aof配置

APPEND ONLY MODE模式

appendonly no #默认是不开启aof模式的,默认是使用rdb方式持久化的,在大部分所有的情况下,rdb完全够用 appendfilename "appendonly.aof" #持久化的文件的名字 # appendfsync always # 每次修改都会sync,消耗性能 appendfsync everysec # 每秒执行一次,sync,可能会丢失这1s的数据! # appendfsync no # 不执行sync,这个时候需要操作系统自己同步数据,速度最快!

Redis持久化

Redis是内存数据库,如果不将内存中的数据库状态保存到磁盘,那么一旦服务器进程退出,服务器中的数据库状态也会消失。所以Redis提供了持久化功能!

RDB(Redis Data Base)

什么是RDB

RDB 是 Redis DataBase 的缩写,即内存块照。因为Redis的数据时存在内存中的,当服务器宕机时,Redis中存储的数据就会丢失。这个时候就需要内存快照来恢复Redis中的数据了。快照就是在某一时刻,将Redis中的所有数据,以文件的形式存储起来。这就类似于照片,当你给朋友拍照时,一张照片就能把朋友一瞬间的形象完全记下来。

RDB持久化通过保存数据库中的键值对来记录数据库状态不同

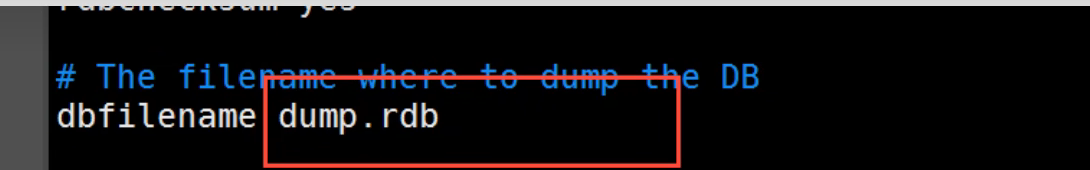

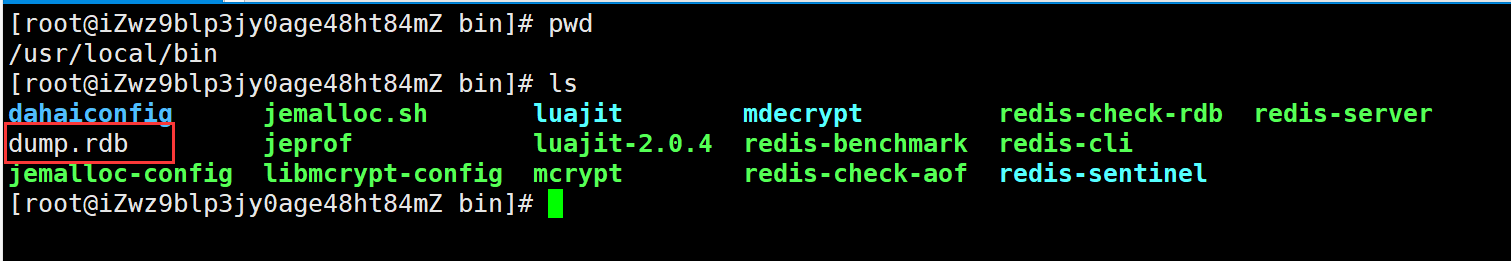

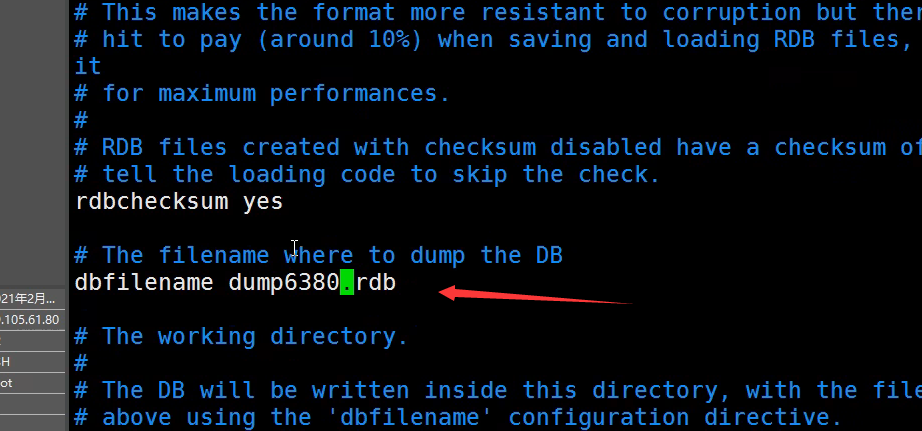

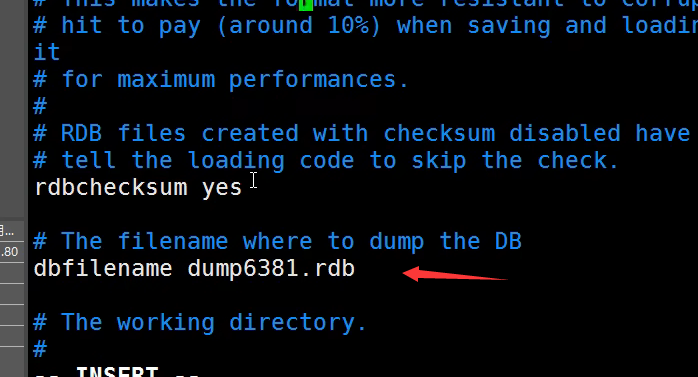

rdb保存的文件是dump.rdb都是在我们的配置文件中快照中进行配置的!

触发机制

1、save的规则满足的情况下,会自动触发rdb规则

2、执行flushall 命令,也会触发我们的rdb规则!

3、退出redis,也会产生rdb文件!

备份就自动生成一个 dump.rdb

恢复RDB文件

1、只需要将rdb文件放在我们redis启动目录就可以,redis启动的时候会自动检查dump.rdb恢复其中的数据!

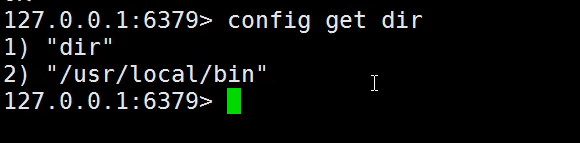

2、查看需要存在的位置

127.0.0.1:6379> config get dir 1)"dir" 2)"/usr/local/bin" #如果在这个目录下存在dump.rdb 文件,启动就会自动恢复其中的数据

优点:

1、适合大规模的数据恢复!dump.rdb!

2、对数据的完整性要不高!

缺点:

1、需要一定的时间间隔进程操作!如果edis意外宕机了,这个最后一次修改数据就没有的了

2、fork进程的时候,会占用一定的内容空间

AOF(Append Only File)

AOF持久化是通过保存Redis服务器所执行的写命令来记录数据库状态的(不记录读命令)。

追加文件

将我们的所有命令都记录下来,history,恢复的时候就把这个文件全部在执行一遍!

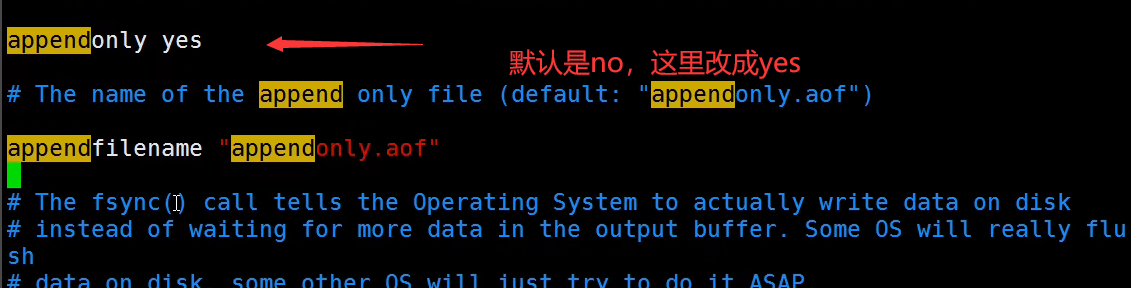

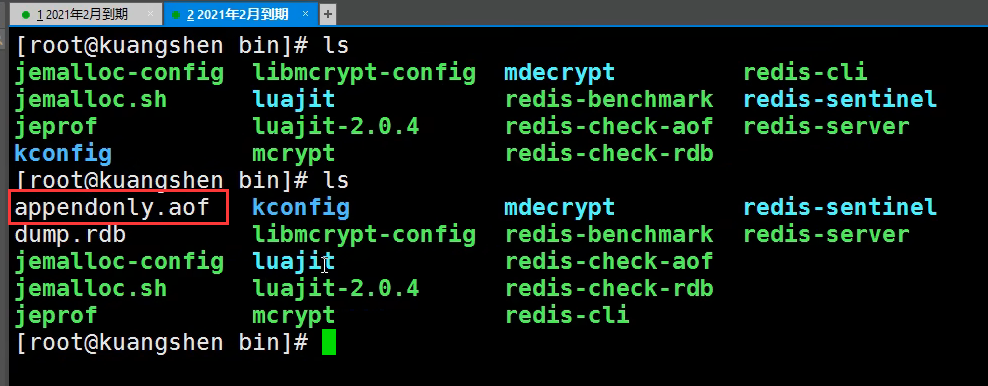

Aof保存的是appendonly.aof文件

默认是不开启的,我们需要手动进行配置!我们只需要将appendorly改为yes就开启了aof !

重启, redis就可以生效了

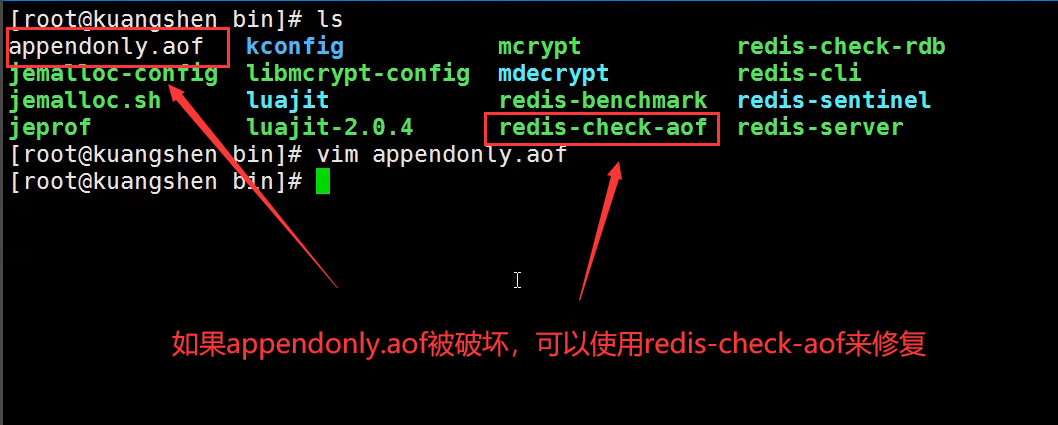

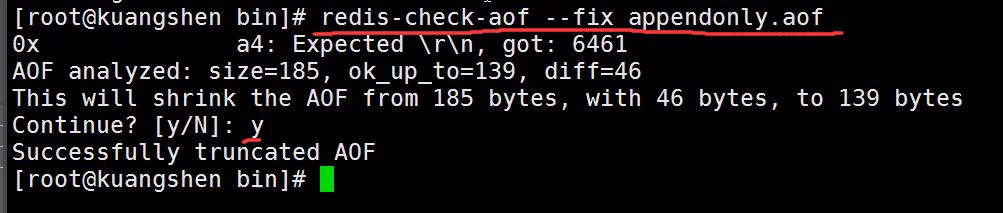

如果这个aof文件有错误,这时候redis 是启动不起来的,我们需要修复这个aof文件

redis给我们提供了一个工具redis-check-aof --fix appendonly.aof

输入命令:redis-check-aof --fix appendonly.aof

优点:

1、每一次修改都同步,文件的完整会更加好!

2、每秒同步一次,效率最高

缺点:

1、相对于数据文件来说,aof远远大于rdb,修复的速度也比rdb慢!

2、Aof运行效率也要比rdb慢,所以我们redis默认的配置就是rdb持久化!

Redis发布订阅

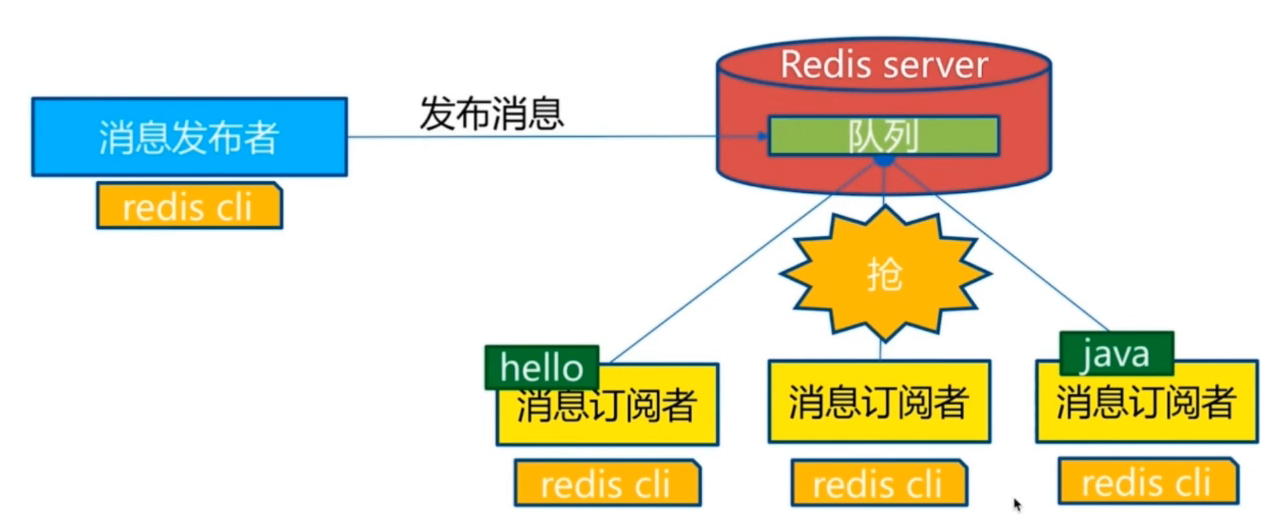

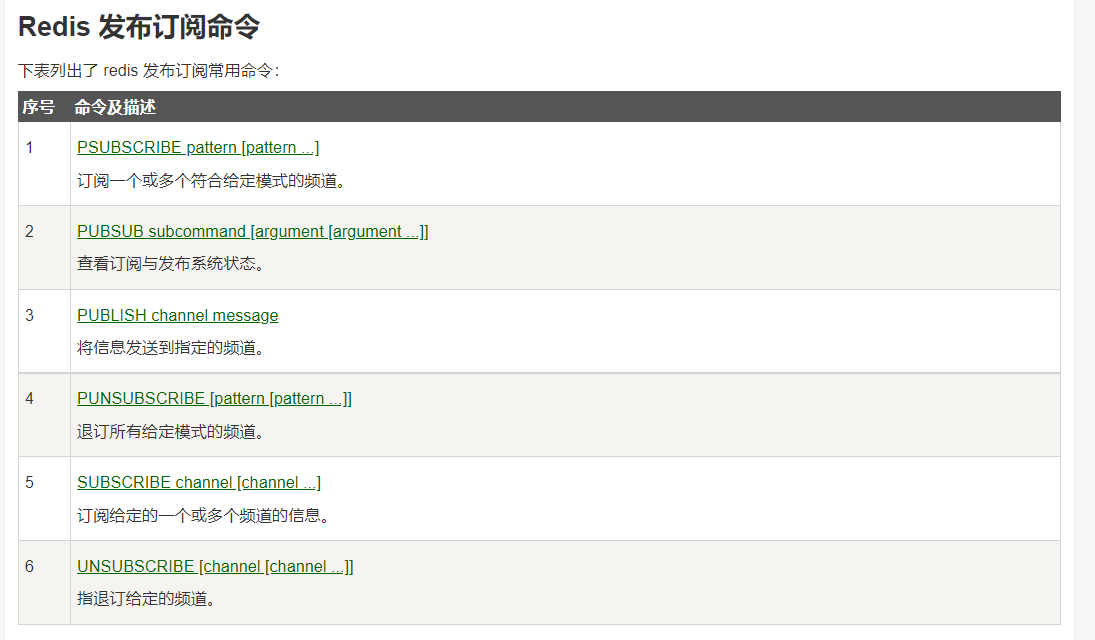

Redis 发布订阅 (pub/sub) 是一种消息通信模式:发送者 (pub) 发送消息,订阅者 (sub) 接收消息。

Redis 客户端可以订阅任意数量的频道。

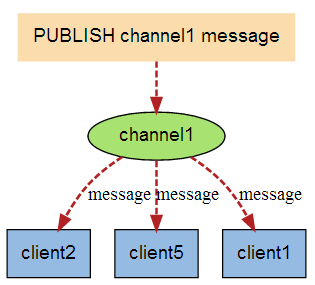

第一个:消息发送者,第二个:频道第三个: 消息订阅者!

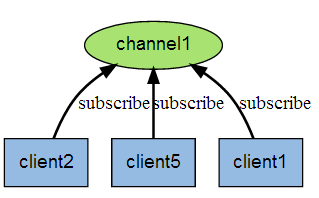

下图展示了频道 channel1 , 以及订阅这个频道的三个客户端 —— client2 、 client5 和 client1 之间的关系:

当有新消息通过 PUBLISH 命令发送给频道 channel1 时, 这个消息就会被发送给订阅它的三个客户端:

实例

以下实例演示了发布订阅是如何工作的,需要开启两个 redis-cli 客户端。

在我们实例中我们创建了订阅频道名为 runoobChat:

第一个 redis-cli 客户端

redis 127.0.0.1:6379> SUBSCRIBE runoobChat Reading messages... (press Ctrl-C to quit) 1) "subscribe" 2) "runoobChat" 3) (integer) 1

现在,我们先重新开启个 redis 客户端,然后在同一个频道 runoobChat 发布两次消息,订阅者就能接收到消息。

第二个 redis-cli 客户端

redis 127.0.0.1:6379> PUBLISH runoobChat "Redis PUBLISH test" (integer) 1 redis 127.0.0.1:6379> PUBLISH runoobChat "Learn redis by runoob.com" (integer) 1 # 订阅者的客户端会显示如下消息 1) "message" 2) "runoobChat" 3) "Redis PUBLISH test" 1) "message" 2) "runoobChat" 3) "Learn redis by runoob.com"

- 开启本地 Redis 服务,开启两个 redis-cli 客户端。

- 在第一个 redis-cli 客户端输入 SUBSCRIBE runoobChat,意思是订阅

runoobChat频道。 - 在第二个 redis-cli 客户端输入 PUBLISH runoobChat "Redis PUBLISH test" 往 runoobChat 频道发送消息,这个时候在第一个 redis-cli 客户端就会看到由第二个 redis-cli 客户端发送的测试消息。

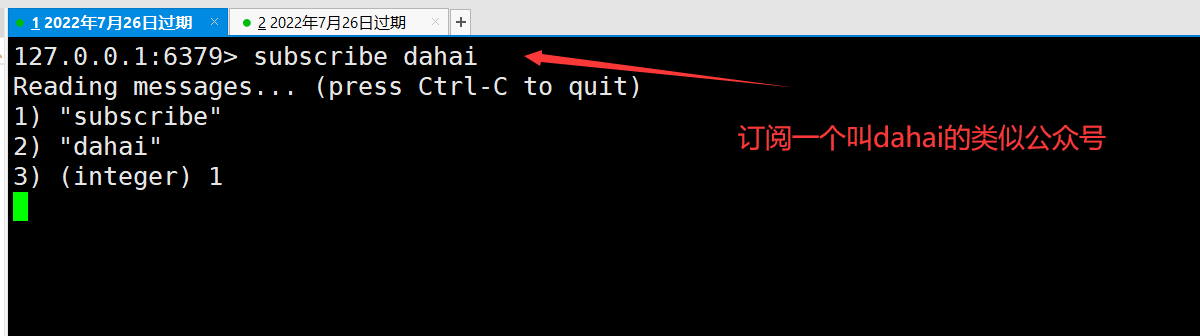

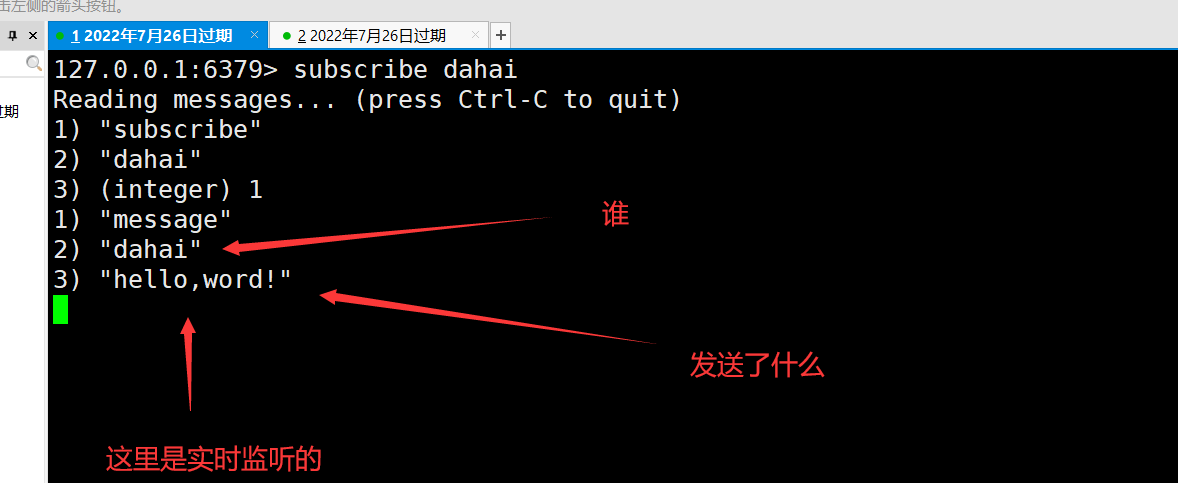

第一步:订阅某个频道

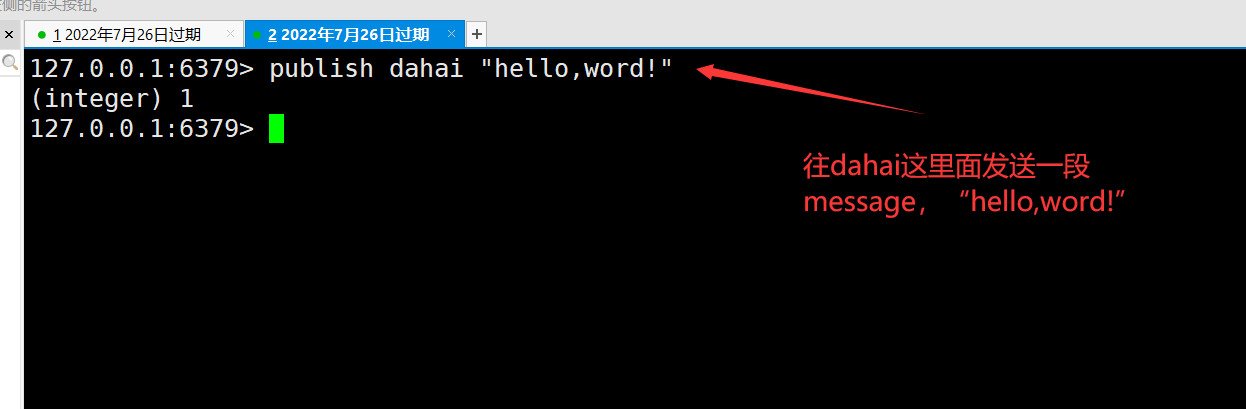

第二步:往这个频道里面添加一段message

回到第一个服务端,看见输出了一段message(注意这里是自动输出的,我们没有做任何操作)

再发一条试试

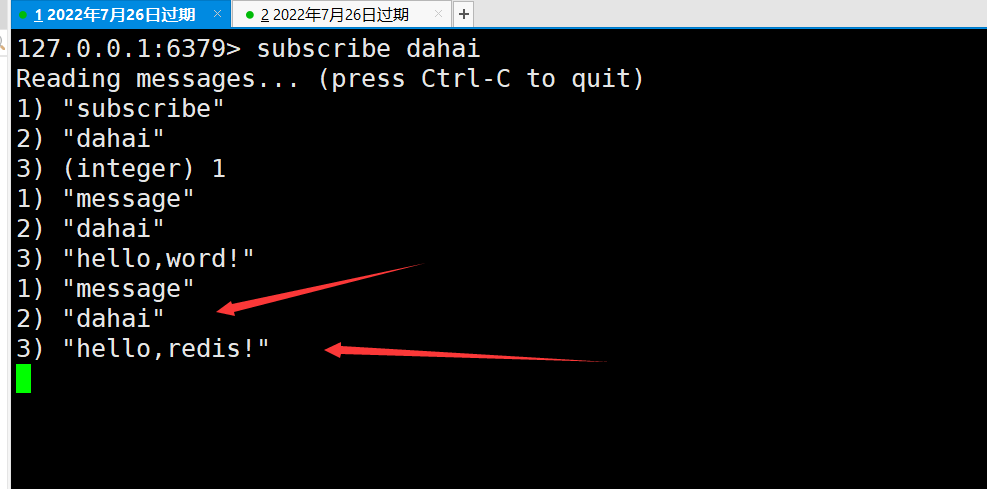

回到第一个服务端

注意,这里必须是订阅了这个频道,才会自动输出内容。

127.0.0.1:6379> subscribe dahai # 订阅一个频道名叫dahai Reading messages... (press Ctrl-C to quit) 1) "subscribe" 2) "dahai" 3) (integer) 1 1) "message" 2) "dahai" 3) "hello,word!" 1) "message" 2) "dahai" 3) "hello,redis!"

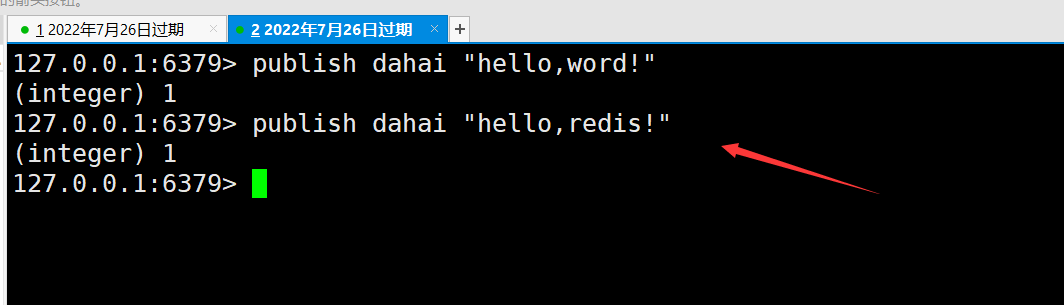

127.0.0.1:6379> publish dahai "hello,word!" #发布者发布消息到频道! (integer) 1 127.0.0.1:6379> publish dahai "hello,redis!" #发布者发布消息到频道! (integer) 1 127.0.0.1:6379>

Redis主从复制

概念

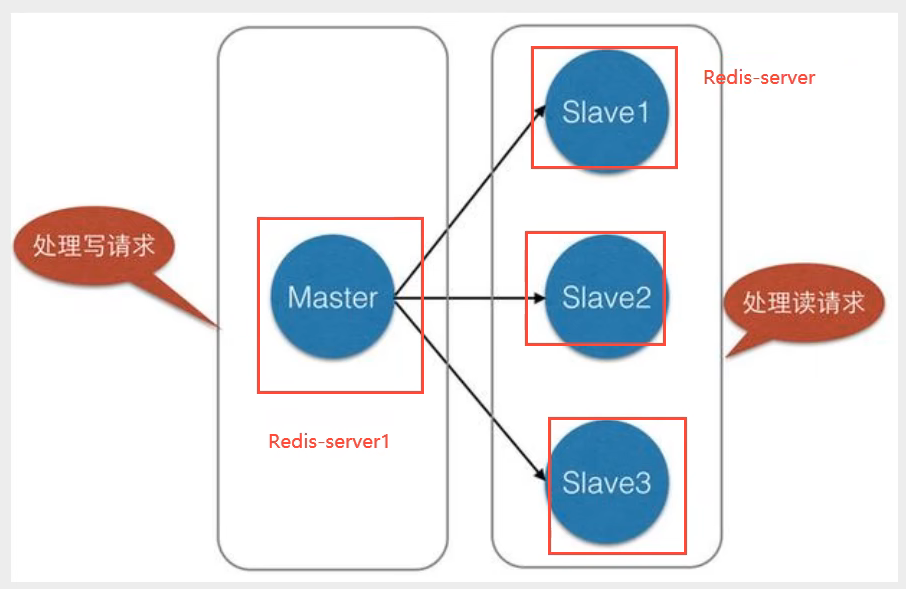

主从复制,是指将一台Redis服务器的数据 ,复制到其他的Redis服务器。前者称为主节点(master/leader) ,后者称为从节点(slave/follower) ;数据的复制是单向的,只能由主节点到从节点。Master以写为主, Slave 以读主。

默认情况下,每台Redis服务器都是主节点;且一个主节点可以有多个从节点(或没有从节点) ,但一个从节点只能有一个主节点。

主从复制的作用

主从复制的作用主要包括

1、数据冗余:主从复制实现了数据的热备份,是持久化之外的一种数据冗余方式。

2、故障恢复:当主节点出现问题时,可以由从节点提供服务,实现快速的故障恢复;实际上是一种服务的冗余。

3、负载均衡:在主从复制的基础.上,配合读写分离,可以由主节点提供写服务,由从节点提供读服务(即写Redis数据时应用连接主节点,读Redis数据时应用连接从节点) , 分担服务器负载;尤其是在写少读多的场景下,通过多个从节点分担读负载,可以大大提高Redis服务器的并发量。

4、高可用基石:除了上述作用以外,主从复制还是哨兵和集群能够实施的基础,因此说主从复制是Redis高可用的基础。

一般来说,要将Redis运用于工程项目中,只使用一台Redis是万万不能的(宕机,至少是一主二从),原因如下:

1、从结构上,单个Redis服务器会发生单点故障,并且一台服务器需要处理所有的请求负载,压力较大;

2、从容量上,单个Redis服务器内存容量有限,就算一台Redis服务器内存容 量为256G ,也不能将所有内存用作

Redis存储内存,一般来说 ,单台Redis最大使用内存不应该超过20G。

电商网站上的商品,一般都是一次上传,无数次浏览的,说专业点也就是"多读少写"。

对于这种场景,我们可以使如下这种架构:

主从复制,读写分离。80%的情况下都是在进行读操作!减缓服务器的压力!架构中经常使用!

环境配置

只配置从库,不用配置主库!

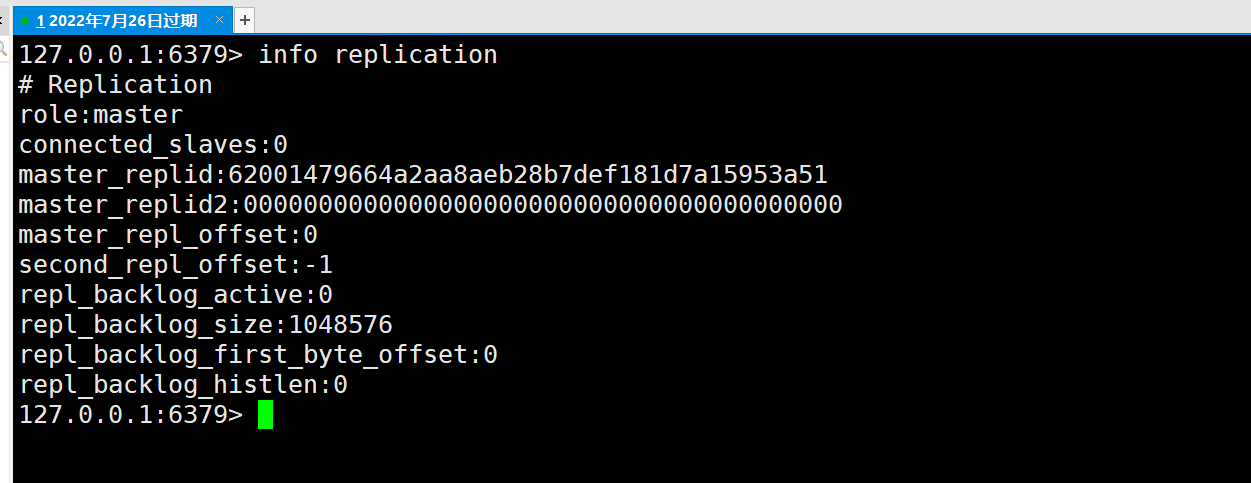

127.0.0.1:6379> info replication # 查看当前库的信息 # Replication role:master #角色 master connected_slaves:0 # 没有从机 master_replid:62001479664a2aa8aeb28b7def181d7a15953a51 master_replid2:0000000000000000000000000000000000000000 master_repl_offset:0 second_repl_offset:-1 repl_backlog_active:0 repl_backlog_size:1048576 repl_backlog_first_byte_offset:0 repl_backlog_histlen:0

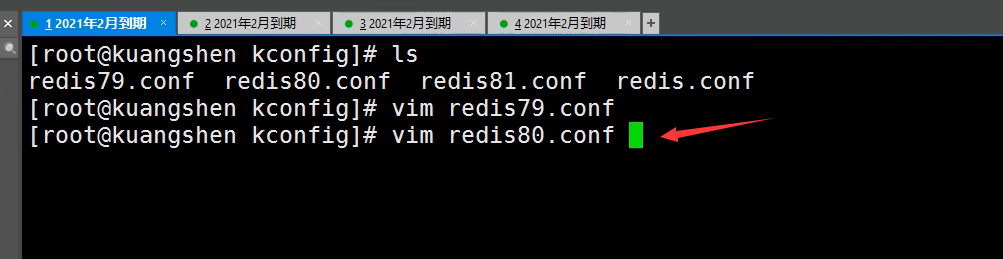

集群测试

一主二从

搭建

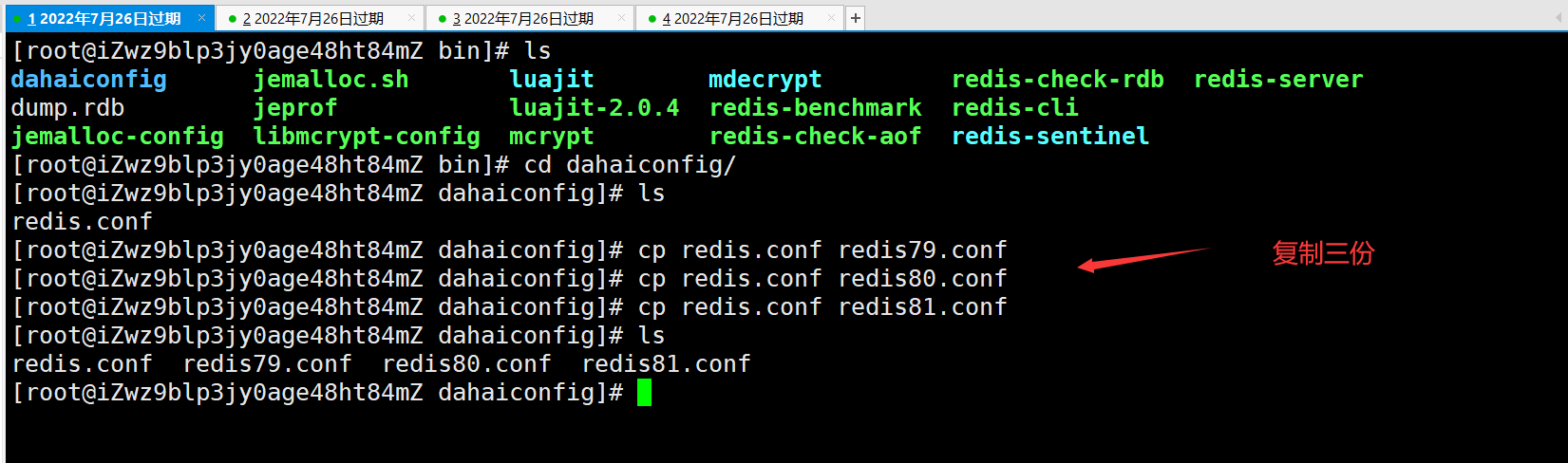

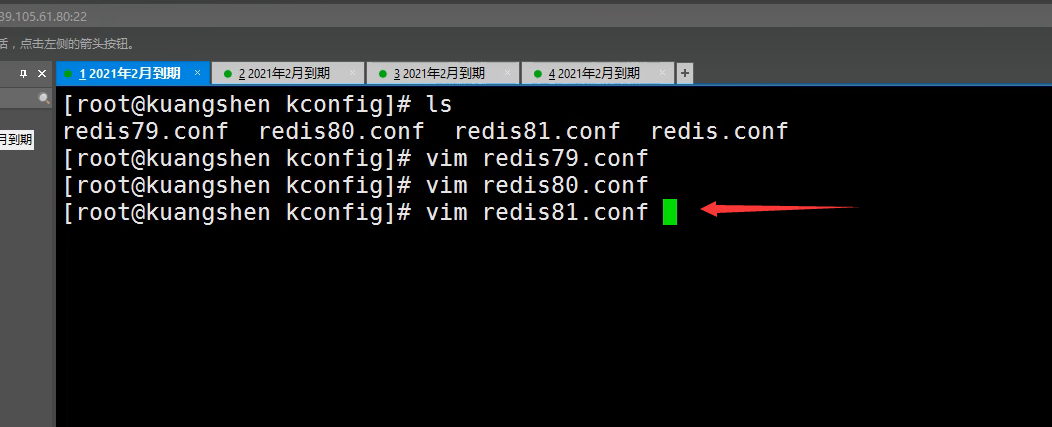

复制三份redis.conf

编辑第一个

编辑第二个

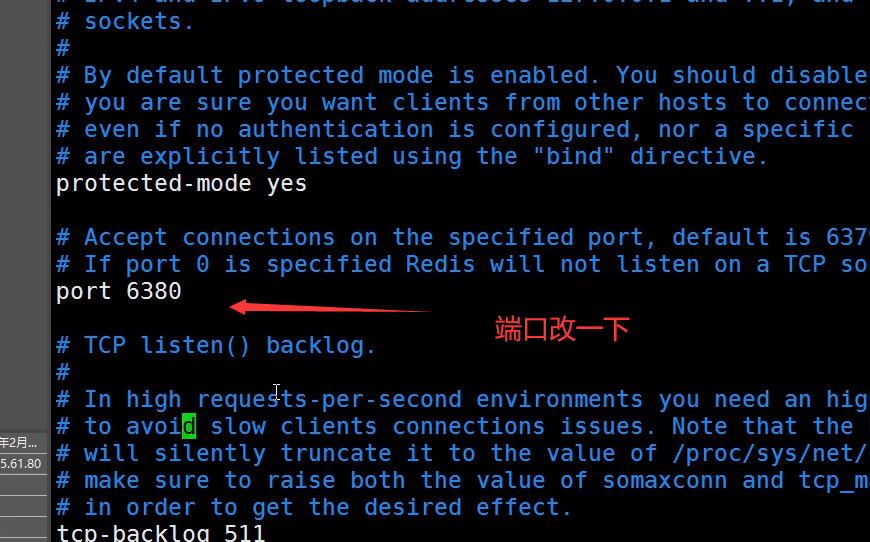

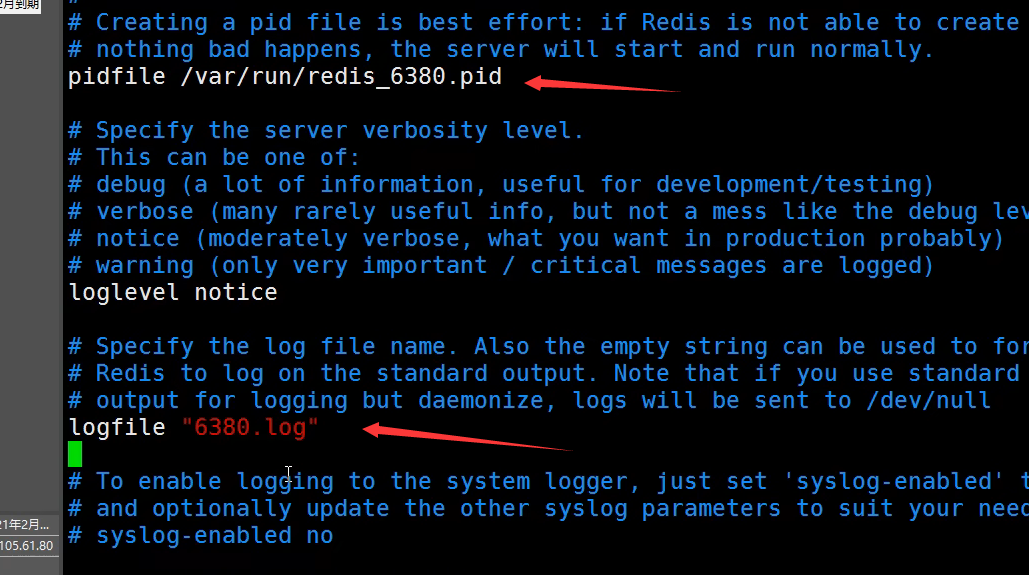

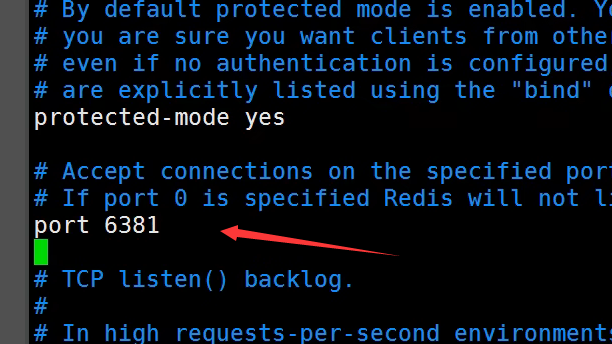

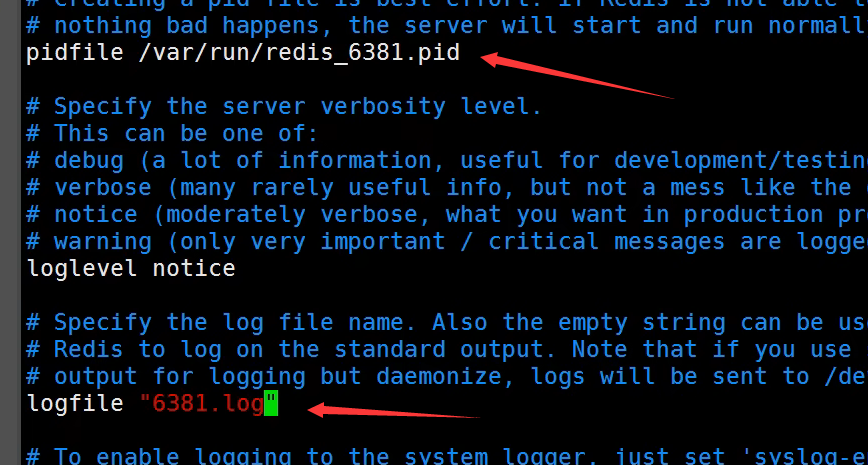

改一下端口

编辑第三个

改一下端口

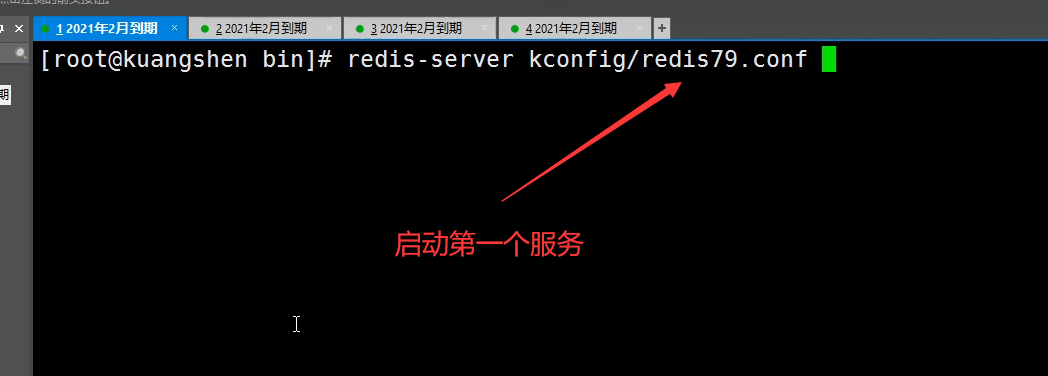

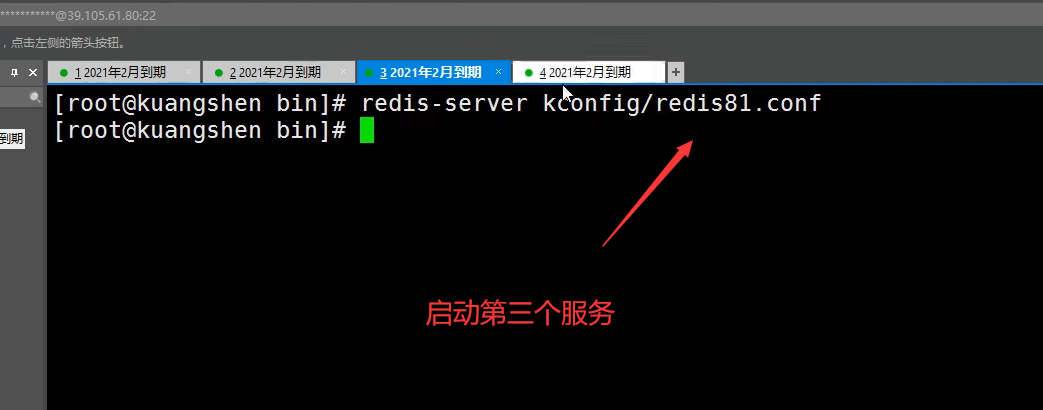

启动服务

启动第一个服务

启动第二个服务

启动第三个服务

一主二从

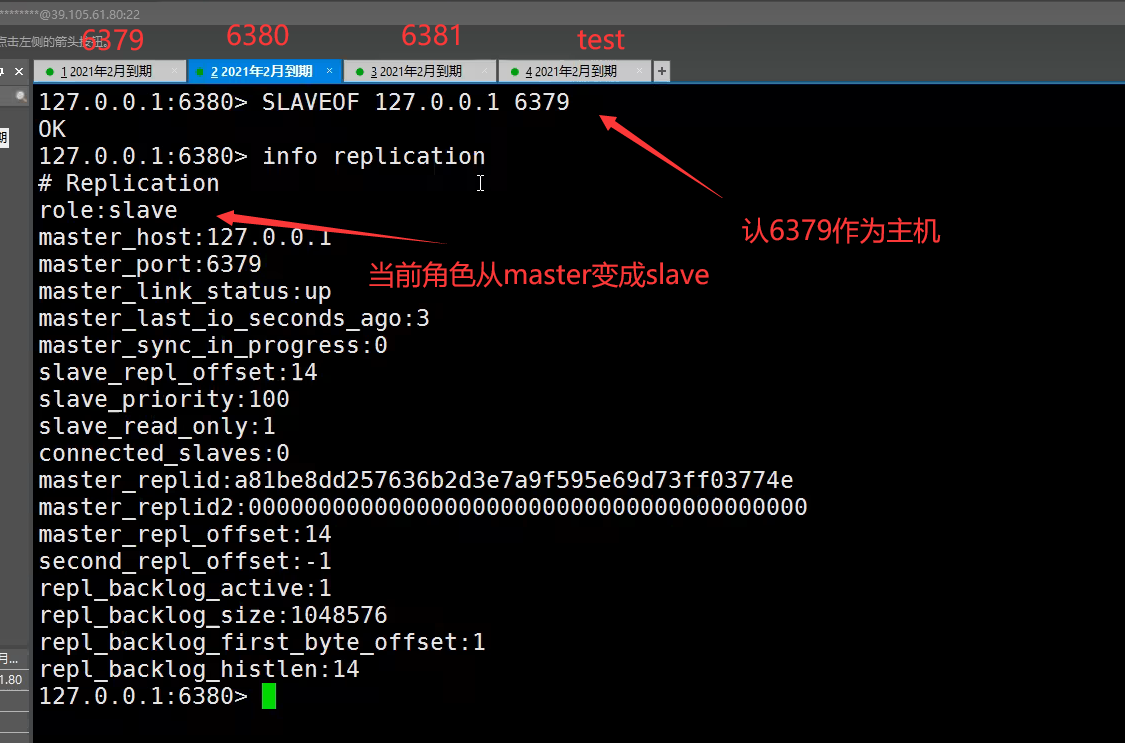

默认情况下,每台Redis服务器都是主节点;我们一般情况下只用配置从机就好了!

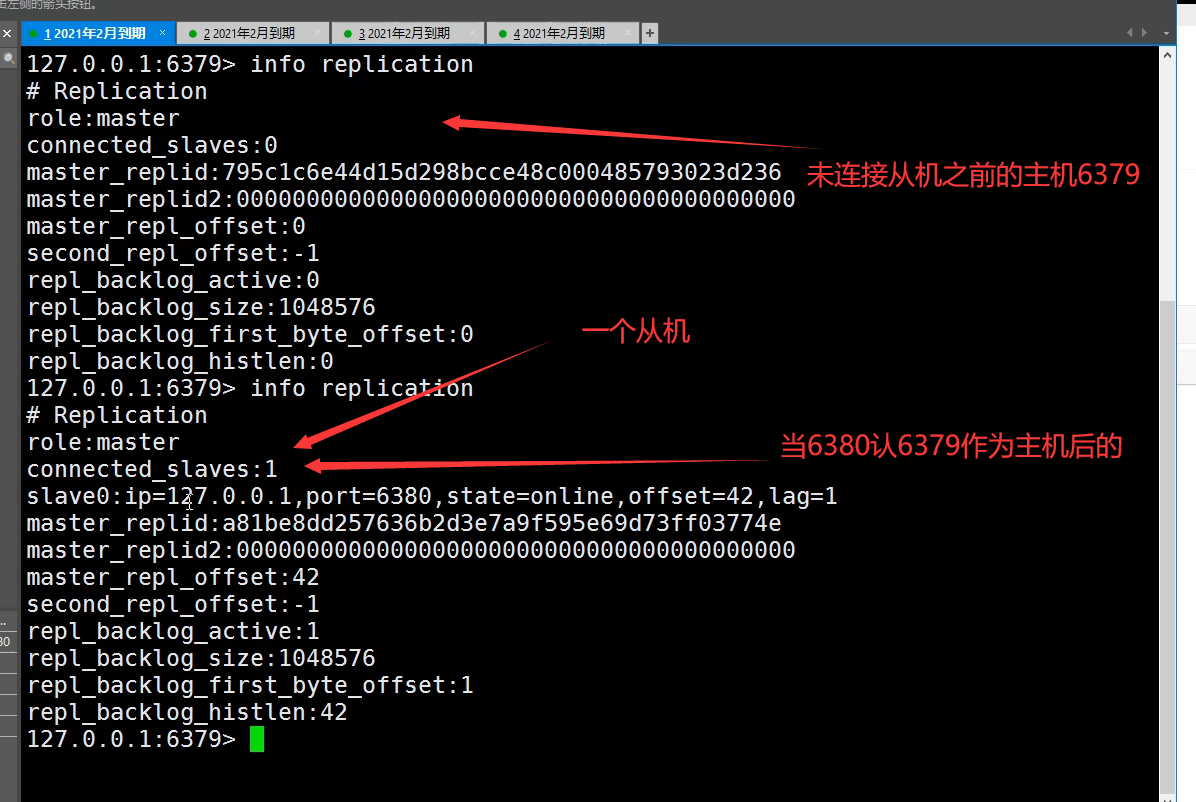

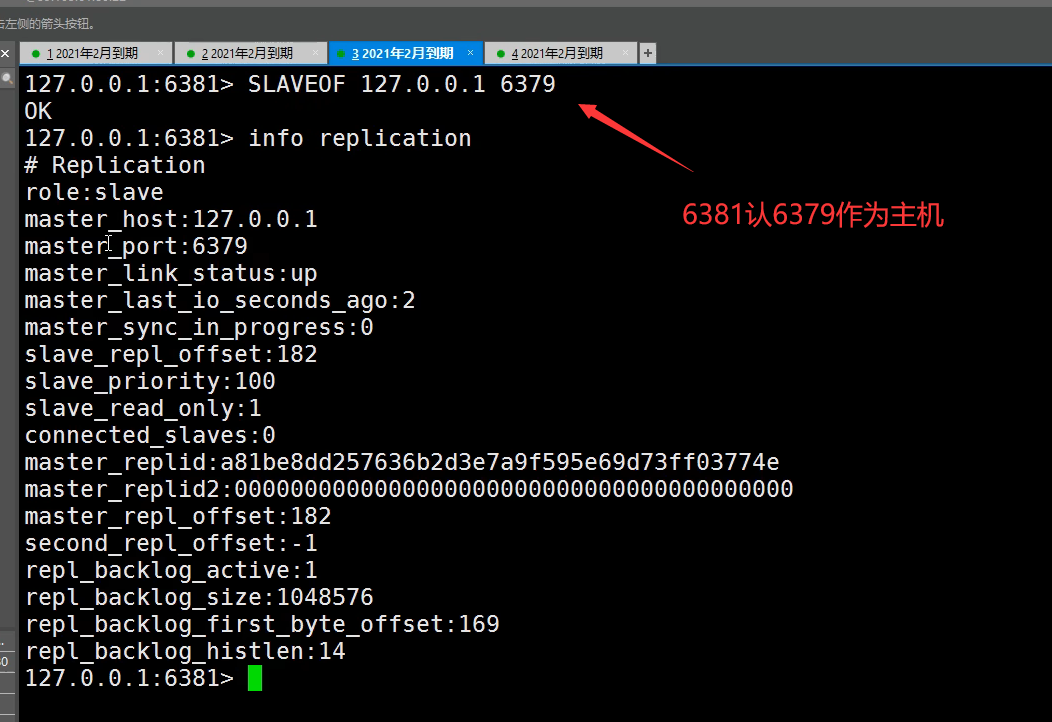

认老大,一主(79)二从(80,81 )

命令配置主从机

6380认6379作主机

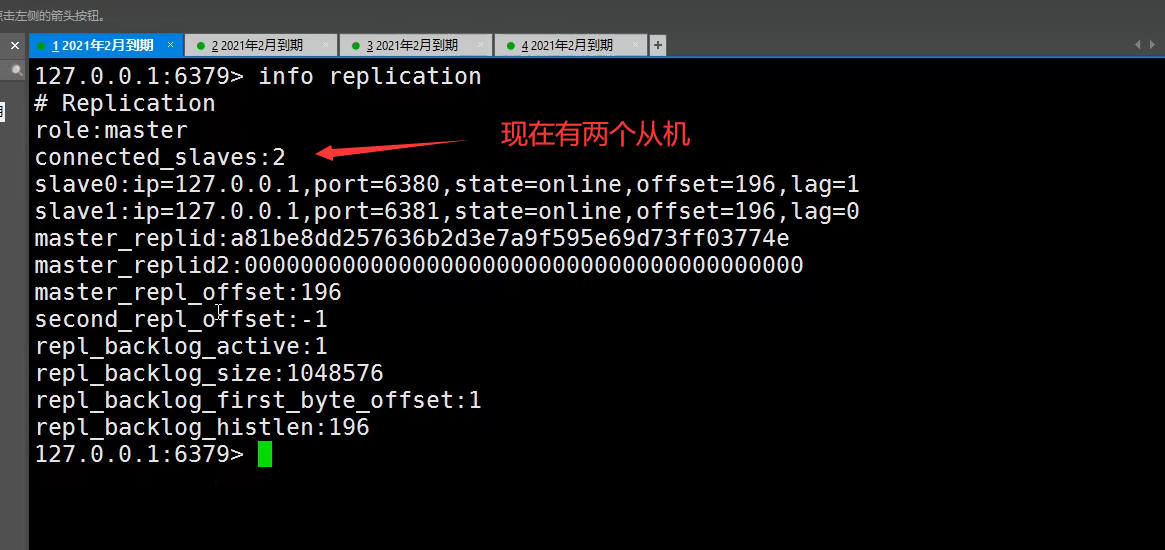

当前主机6379下有一台从机

6381认6379作主机

6379现在有两个从机

真实的从主配置应该在配置文件中配置,这样的话是永久的,我们这里使用的是命令,暂时的!

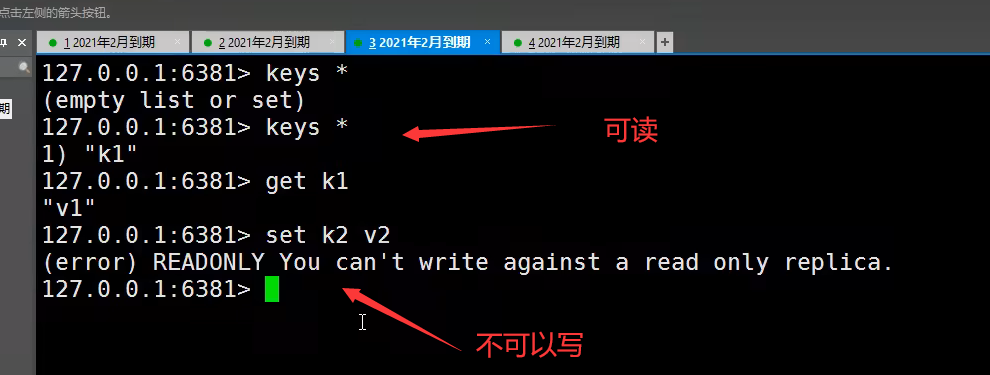

细节

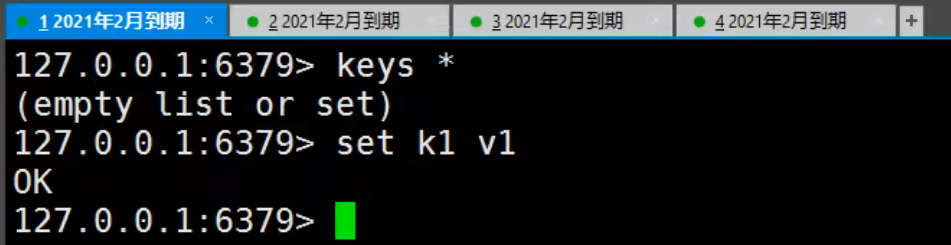

主机可以写,从机不能写只能读!主机中的所有信息和数据,都会自动被从机保存!

主机写

从机读

主机断开连接,从机依旧连接到主机的,但是没有写操作,这个时候,主机如果回来了,从机依旧可以直接获取到主机写的信息!

从机如果是使用命令行来配置的,这个时候如果重启了, 就会变回主机!这时候如果想重新拿到主机写的数据,就需要重新认6379(上面是以6379为主机)为主机

复制原理

Slave启动成功连接到master后会发送一个sync同步命令

Master接到命令,启动后台的存盘进程,同时收集所有接收到的用于修改数据集命令,在后台进程执行完毕之后, master将传送整个数据文件到slave ,并完成一次完全同步。

全量复制:而slave服务在接收到数据库文件数据后,将其存盘并加载到内存中。

增量复制: Master继续将新的所有收集到的修改命令依次传给slave ,完成同步

但是只要是重新连接master , - -次完全同步(全量复制)将被自动执行

宕机后手动配置主机

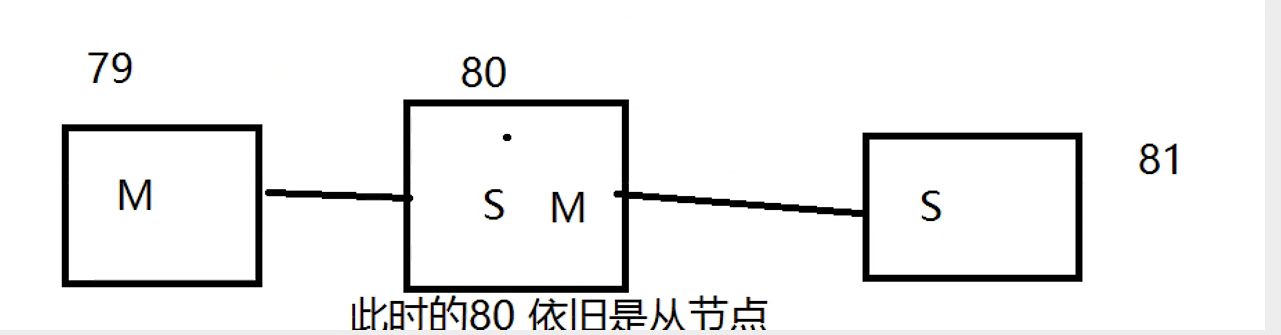

层层链路

上一个M链接下一个S !

这时候也可以完成我们的主从复制!

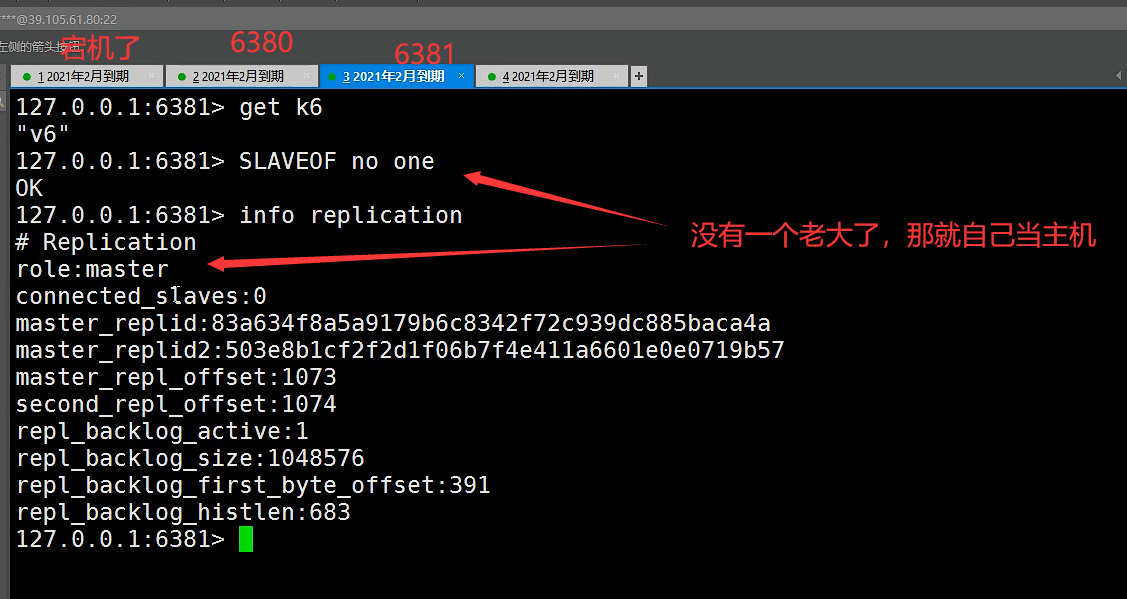

如果没有老大了,这个时候能不能选择一个老大出来呢 ?手动!

谋朝篡位

如果主机断开了连接,我们可以使用SLAVEOF no one让自己变成主机!其他的节点就可以手动连接到最新的这个主节点(手动),如果这个时候老大修复了, 那就重新连接!

哨兵模式

- 自动选举老大

概述

主从切换技术的方法是:当主服务器宕机后,需要手动把一台从服务器切换为主服务器,这就需要人工干预,费事费力,还会造成一段时间内服务不可用。这不是一种推荐的方式,更多时候,我们优先考虑哨兵模式Redis从2.8开始正式提供了Sentinel (哨兵)架构来解决这个问题。

课朝篡位的自动版,能够后台监控主机是否故障,如果故障根据投票数自动将从库转换为主库。

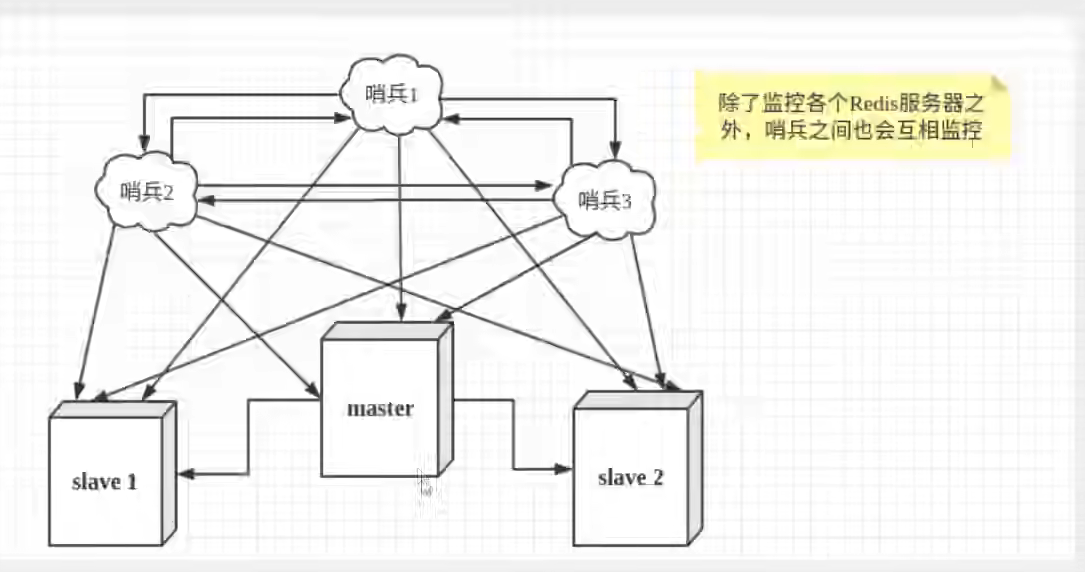

多哨兵模式

假设主服务器宕机,哨兵1先检测到这个结果,系统并不会马上进行failover过程,仅仅是哨兵1主观的认为主服务器不可用,这个现象成为主观下线。当后面的哨兵也检测到主服务器不可用,并且数量达到一-定值时,那么哨兵之间就会进行一次投票 ,投票的结果由一个哨兵发起,进行failover[故障转移]操作。切换成功后,就会通过发布订阅模式,让各个哨兵把自己监控的从服务器实现切换主机,这个过程称为客观下线。

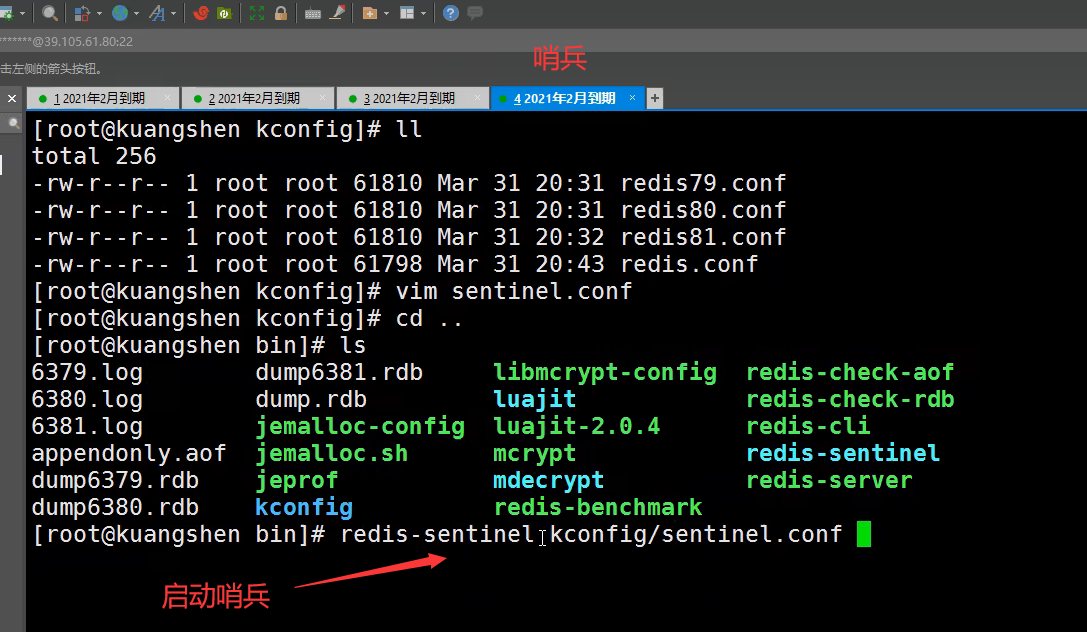

测试

配置,写好保存退出

后面的这个数字1 ,代表主机挂了, slave投票看让谁接替成为主机,票数最多的,就会成为主机!

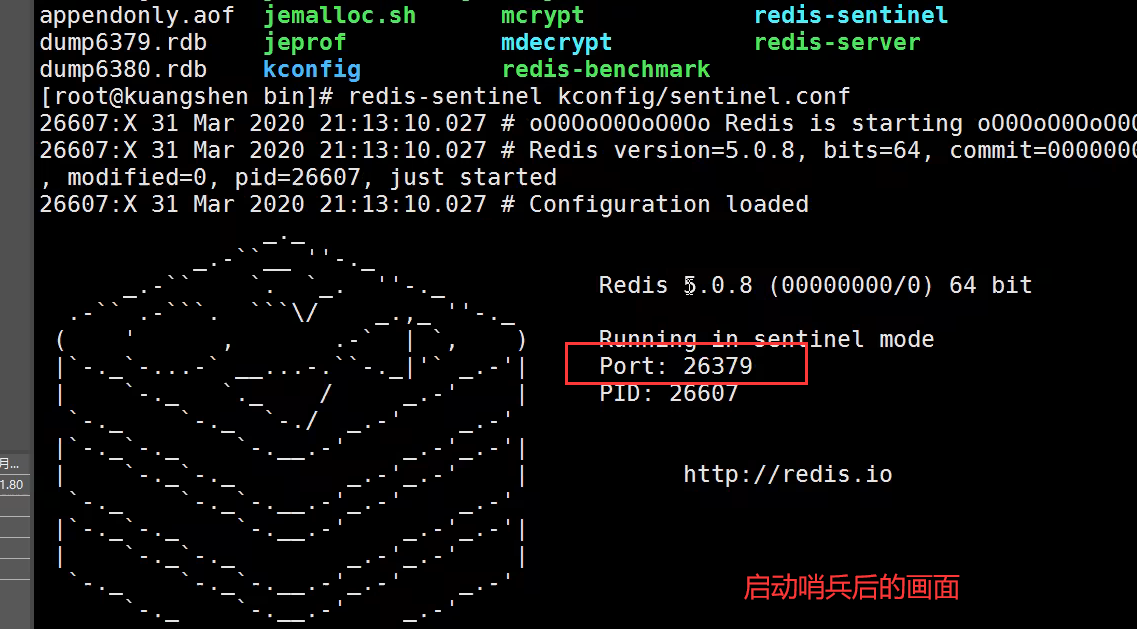

启动哨兵

启动哨兵成功

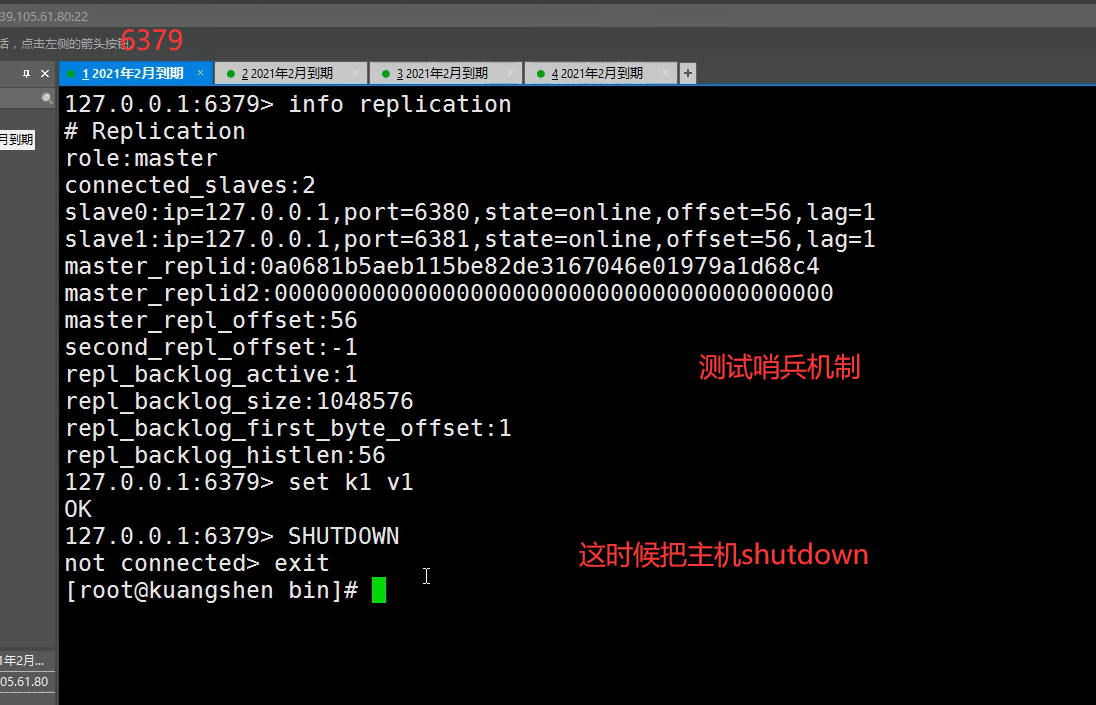

这时候关闭主机测试一下

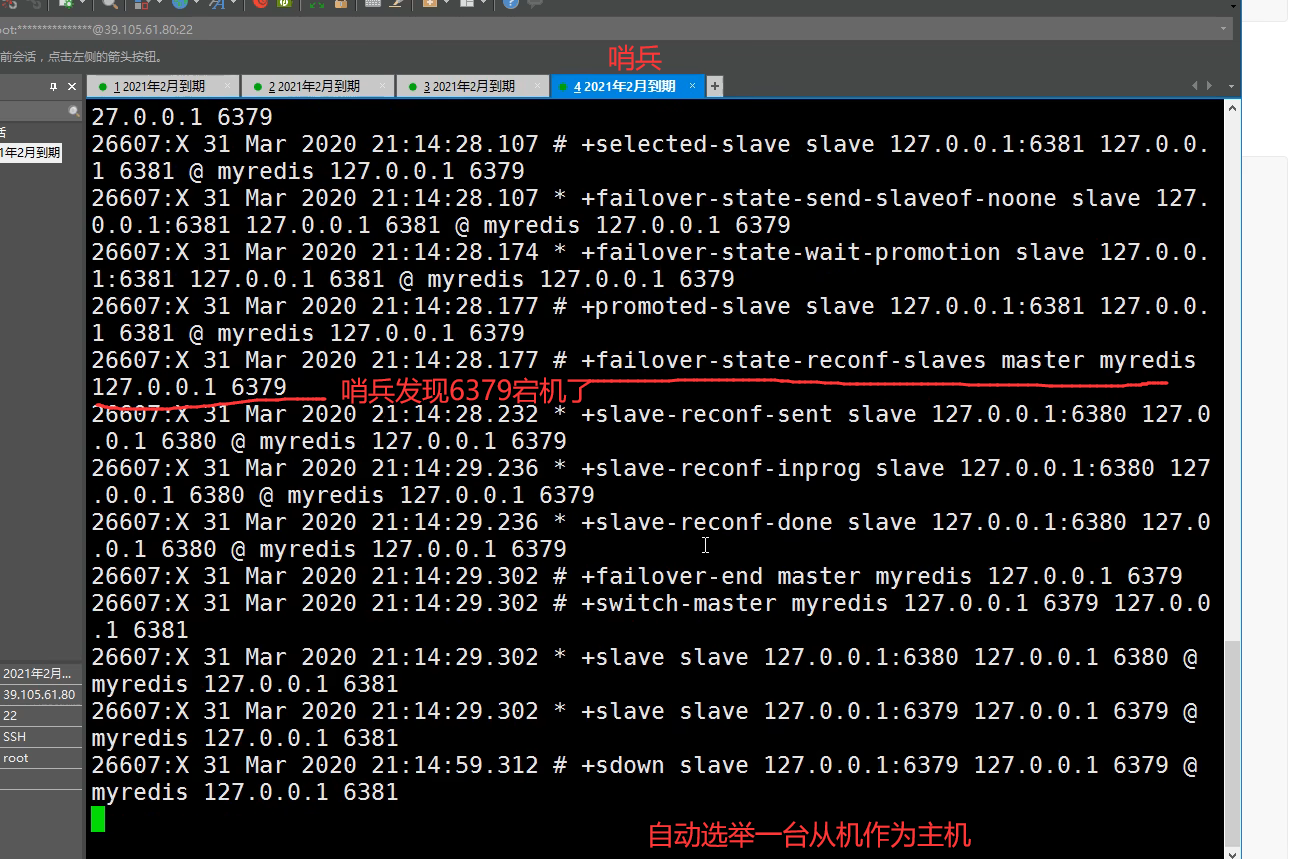

等待一会,哨兵会自动输出内容

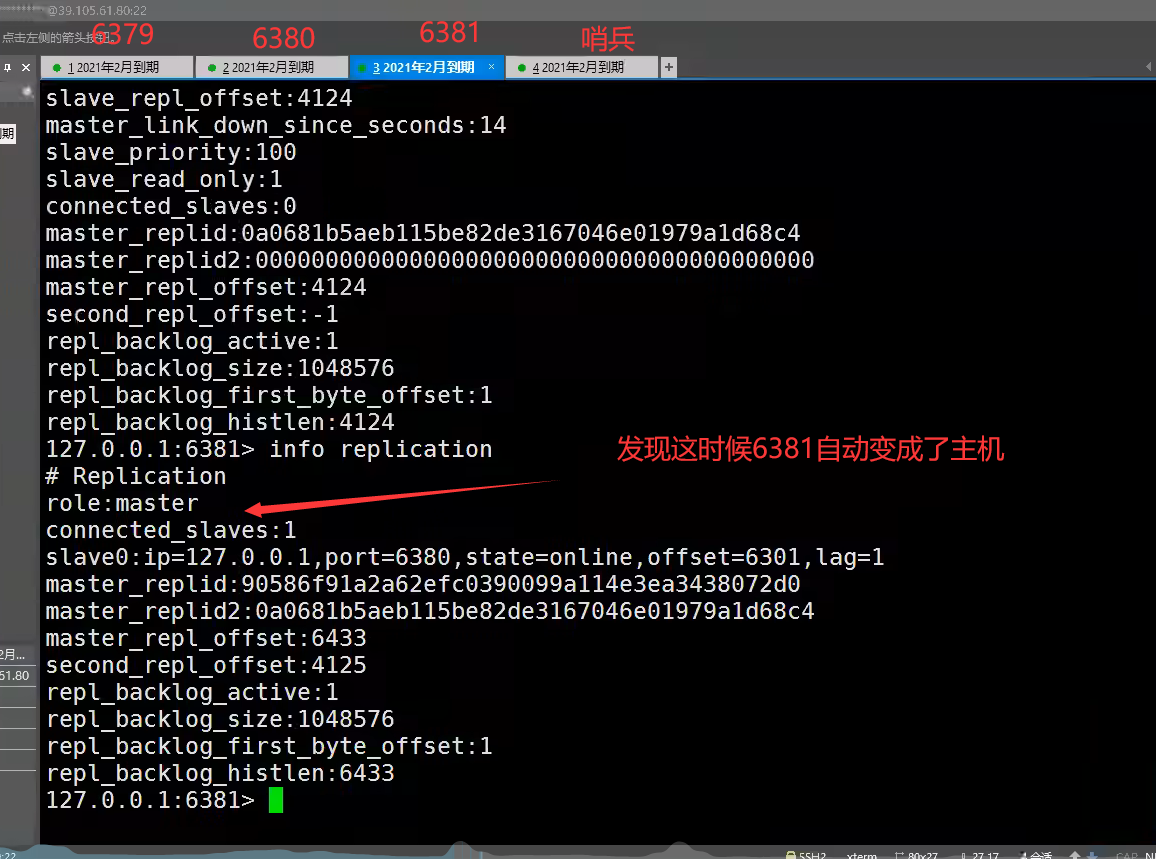

再次查看6380和6381这两个从机的info replication

如果Master节点断开了,这个时候就会从从机中随机选择一个服务器! ( 这里面有一个投票算法! )

投票算法可以自行研究源码

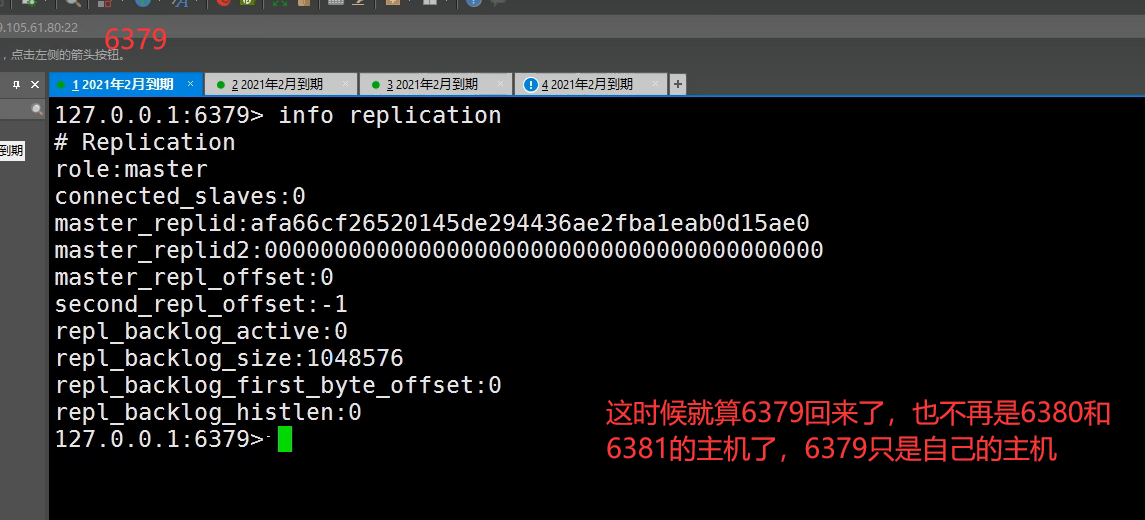

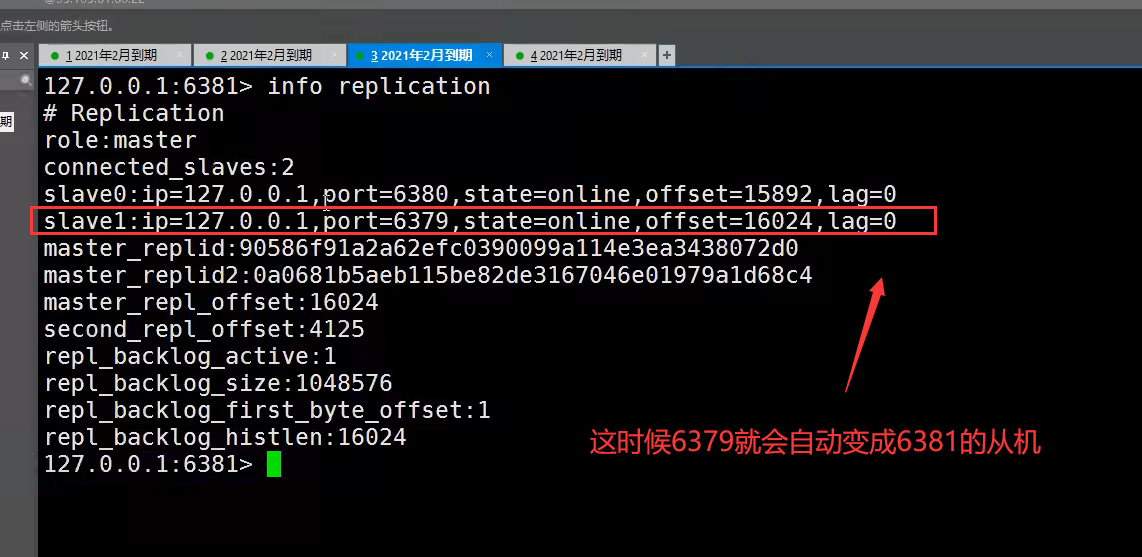

这时候6379回来了

如果主机此时回来了,只能归并到新的主机下,当做从机,这就是哨兵模式的规则!

查看6381

优点:

1、哨兵集群,基于主从复制模式,所有的主从配置优点,它全有

2、主从可以切换,故障可以转移,系统的可用性就会更好

3、哨兵模式就是主从模式的升级,手动到自动,更加健壮!

缺点:

1、Redis不好啊在线扩容的,集群容量一旦到达上限,在线扩容就十分麻烦! .

2、实现哨兵模式的配置其实是很麻烦的,里面有很多选择!

哨兵模式的全部配置

可百度

Redis缓存穿透和雪崩

Redis缓存的使用,极大的提升了应用程序的性能和效率,特别是数据查询方面。但同时,它也带来了一些问题。其中,最要害的问题,就是数据的一致性问题,从严格意义上讲,这个问题无解。如果对数据的一致性要求很高,那么就不能使用缓存。另外的一些典型问题就是,缓存穿透、缓存雪崩和缓存击穿。目前,业界也都有比较流行的解决方案。

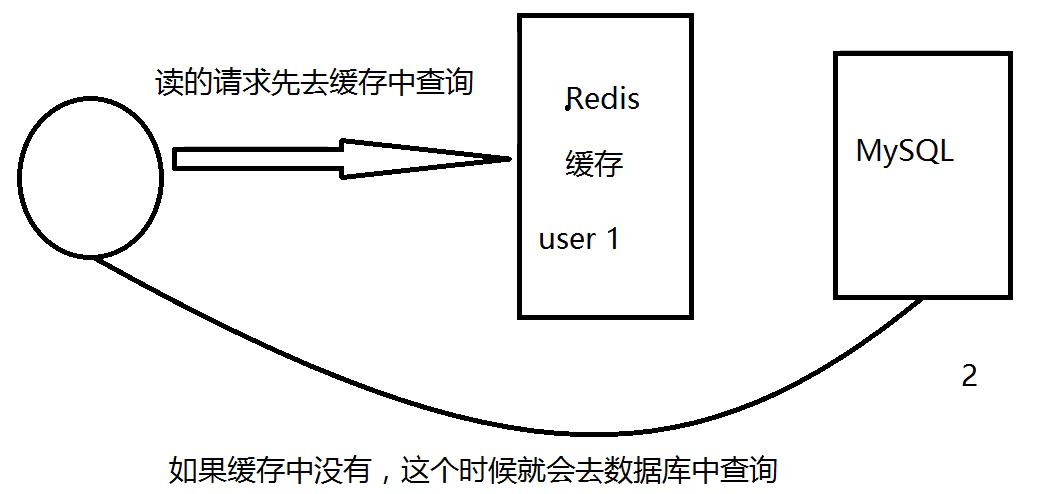

缓存穿透(查不到)

概念

缓存穿透的概念很简单,用户想要查询一个数据,发现redis内存数据库没有,也就是缓存没有命中,于是向持久层数据库查询。发现也没有,于是本次查询失败。当用户很多的时候,缓存都没有命中 (类似秒杀活动!), 于是都去请求了持久层数据库。这会给持久层数据库造成很大的压力,这时候就相当于出现了缓存穿透。

解决方案

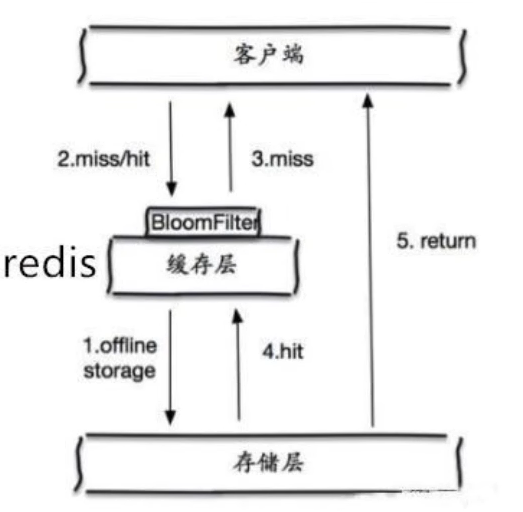

布隆过滤器

布隆过滤器是一种数据结构,对所有可能查询的参数以hash形式存储,在控制层先进行校验,不符合则丢弃,从而避免了对底层存储系统的查询压力;

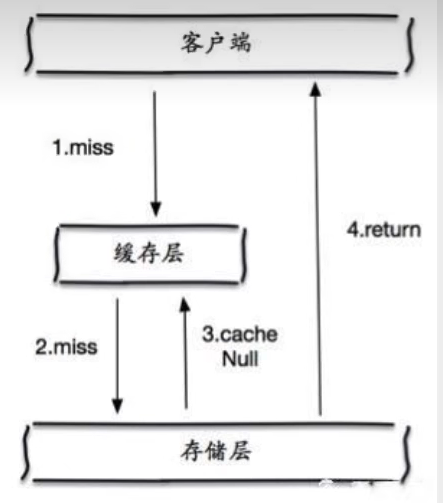

缓存空对象

当存储层不命中后,即使返回的空对象也将其缓存起来,同时会设置一 个过期时间,之后再访问这个数据将会从缓存中获取,保护了后端数据源;

但是这种方法会存在两个问题:

1、如果空值能够被缓存起来,这就意味着缓存需要更多的空间存储更多的键,因为这当中可能会有很多的空值的键;

2、即使对空值设置了过期时间,还是会存在缓存层和存储层的数据会有一-段时间窗口的不-致,这对于需要保持一致性的业务会有影响。

缓存击穿(请求过多)

大量请求获取同一个热点

概念

这里需要注意和缓存击穿的区别,缓存击穿,是指一个key非常热点,在不停的扛着大并发,大并发集中对这-一个点进行访问,当这个key在失效的瞬间,持续的大并发就穿破缓存,直接请求数据库,就像在一个屏障上凿开了一个洞。

当某个key在过期的瞬间,有大量的请求并发访问,这类数据一般是热点数据 ,由于缓存过期,会同时访问数据库来查询最新数据,并且回写缓存,会导使数据库瞬间压力过大。

解决方案

1、设置热点数据永不过期

从缓存层面来看,没有设置过期时间,所以不会出现热点key过期后产生的问题。

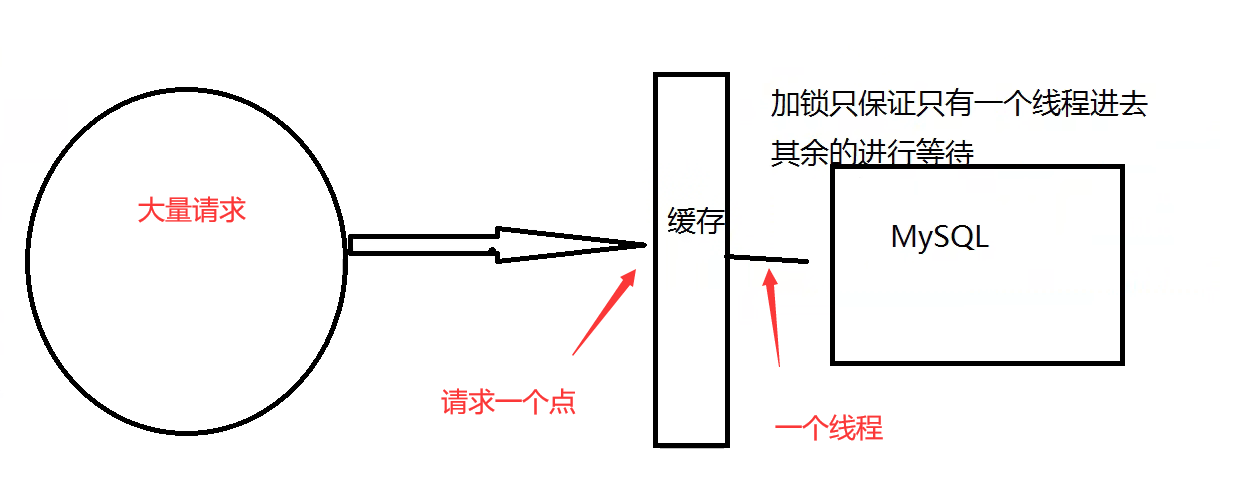

2、加互斥锁

分布式锁:使用分布式锁,保证对于每个key同时只有一个线程去查询后端服务,其他线程没有获得分布式锁的权限,因此只需要等待即可。这种方式将高并发的压力转移到了分布式锁,因此对分布式锁的考验很大。

缓存雪崩

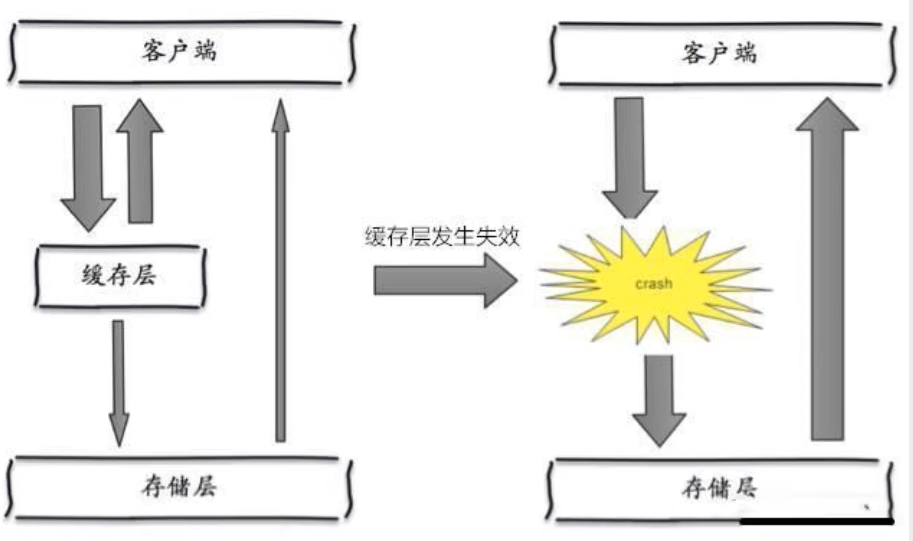

概念

缓存雪崩,是指在某一个时间段,缓存集中过期失效。(redis集群集体宕机)

产生雪崩的原因之一,比如在写本文的时候,马上就要到双十二零点,很快就会迎来一波抢购,这波商品时间比较集中的放入了缓存,假设缓存一个小时。 那么到了凌晨一点钟的时候 ,这批商品的缓存就都过期了。而对这批商品的访问查询,都落到了数据库上,对于数据库而言,就会产生周期性的压力波峰。于是所有的请求都会达到存储层,存储层的调用量会暴增,造成存储层也会挂掉的情况。

其实集中过期,倒不是非常致命,比较致命的缓存雪崩,是缓存服务器某个节点宕机或断网。因为自然形成的缓存雪崩, 一定是在某个时间段集中创建缓存,这个时候,数据库也是可以顶住压力的。无非就是对数据库产生周期性的压力而已。而缓存服务节点的宕机,对数据库服务器造成的压力是不可预知的,很有可能瞬间就把数据库压垮。

解决方案

redis高可用

这个思想的含义是,既然redis有可能挂掉,那我多增设几台redis ,这样一台挂掉之 后其他的还可以继续工作,其实就是搭建的集群。(异地多活!)

限流降级

这个解决方案的思想是,在缓存失效后,通过加锁或者队列来控制读数据库写缓存的线程数量。比如对某个key只允许一个线程查询数据和写缓存,其他线程等待。

数据预热

数据加热的含义就是在正式部署之前,我先把可能的数据先预先访问一遍,这样部分可能大量访问的数据就会加载到缓存中。在即将发生大并发访问前手动触发加载缓存不同的key ,设置不同的过期时间,让缓存失效的时间点尽量均匀。

【推荐】国内首个AI IDE,深度理解中文开发场景,立即下载体验Trae

【推荐】编程新体验,更懂你的AI,立即体验豆包MarsCode编程助手

【推荐】抖音旗下AI助手豆包,你的智能百科全书,全免费不限次数

【推荐】轻量又高性能的 SSH 工具 IShell:AI 加持,快人一步

· 周边上新:园子的第一款马克杯温暖上架

· 分享 3 个 .NET 开源的文件压缩处理库,助力快速实现文件压缩解压功能!

· Ollama——大语言模型本地部署的极速利器

· DeepSeek如何颠覆传统软件测试?测试工程师会被淘汰吗?

· 使用C#创建一个MCP客户端