K-近邻算法(KNN)

引入

如何进行电影分类

众所周知,电影可以按照题材分类,然而题材本身是如何定义的?由谁来判定某部电影属于哪 个题材?也就是说同一题材的电影具有哪些公共特征?这些都是在进行电影分类时必须要考虑的问 题。没有哪个电影人会说自己制作的电影和以前的某部电影类似,但我们确实知道每部电影在风格 上的确有可能会和同题材的电影相近。那么动作片具有哪些共有特征,使得动作片之间非常类似, 而与爱情片存在着明显的差别呢?动作片中也会存在接吻镜头,爱情片中也会存在打斗场景,我们 不能单纯依靠是否存在打斗或者亲吻来判断影片的类型。但是爱情片中的亲吻镜头更多,动作片中 的打斗场景也更频繁,基于此类场景在某部电影中出现的次数可以用来进行电影分类。

这里介绍第一个机器学习算法:K-近邻算法,它非常有效而且易于掌握

1、k-近邻算法原理

简单地说,K-近邻算法采用测量不同特征值之间的距离方法进行分类。

- 优点:精度高(计算距离)、对异常值不敏感(单纯根据距离进行分类,会忽略特殊情况)、无数据输入假定(不会对数据预先进行判定)。

- 缺点:时间复杂度高、空间复杂度高。

- 适用数据范围:数值型和标称型。

工作原理

存在一个样本数据集合,也称作训练样本集,并且样本集中每个数据都存在标签,即我们知道样本集中每一数据 与所属分类的对应关系。输人没有标签的新数据后,将新数据的每个特征与样本集中数据对应的 特征进行比较,然后算法提取样本集中特征最相似数据(最近邻)的分类标签。一般来说,我们 只选择样本数据集中前K个最相似的数据,这就是K-近邻算法中K的出处,通常K是不大于20的整数。 最后 ,选择K个最相似数据中出现次数最多的分类,作为新数据的分类。

回到前面电影分类的例子,使用K-近邻算法分类爱情片和动作片。有人曾经统计过很多电影的打斗镜头和接吻镜头,下图显示了6部电影的打斗和接吻次数。假如有一部未看过的电影,如何确定它是爱情片还是动作片呢?我们可以使用K-近邻算法来解决这个问题。

首先我们需要知道这个未知电影存在多少个打斗镜头和接吻镜头,上图中问号位置是该未知电影出现的镜头数图形化展示,具体数字参见下表

即使不知道未知电影属于哪种类型,我们也可以通过某种方法计算出来。首先计算未知电影与样本集中其他电影的距离,如图所示。

现在我们得到了样本集中所有电影与未知电影的距离,按照距离递增排序,可以找到K个距离最近的电影。假定k=3,则三个最靠近的电影依次是California Man、He's Not Really into Dudes、Beautiful Woman。K-近邻算法按照距离最近的三部电影的类型,决定未知电影的类型,而这三部电影全是爱情片,因此我们判定未知电影是爱情片。

欧几里得距离(Euclidean Distance)

欧氏距离是最常见的距离度量,衡量的是多维空间中各个点之间的绝对距离。公式如下:

2、在scikit-learn库中使用k-近邻算法

- 分类问题:from sklearn.neighbors import KNeighborsClassifier

2.1 简单示例

性别判断示例(身高、体重、鞋子尺码数据对应性别):

import numpy as np import pandas as pd from pandas import DataFrame,Series from sklearn.neighbors import KNeighborsClassifier # 样本集的特征数据 feature = np.array([[170,75,41],[166,65,38],[177,80,43],[179,80,43],[170,60,40],[160,55,38]]) # 样本集的目标数据 target = np.array(['男','女','男','男','女','女']) # 实例化一个knn对象 knn = KNeighborsClassifier(n_neighbors=3) # 根据样本集对knn进行训练 knn.fit(feature,target) # 对精度评分 knn.score(feature,target) # 预测 knn.predict(np.array([[176,71,38]])) 输出:array(['男'], dtype='<U1') #其他特征数据(判断男女):心率、血压、体温

判断电影类型示例:

df = pd.read_excel('../../my_films.xlsx') feature = df[['Action lens','Love lens']] target = df['target'] knn = KNeighborsClassifier(n_neighbors=4) knn.fit(feature,target) knn.score(feature,target) knn.predict(np.array([[60,42]])) 输出:array(['Action'], dtype=object)

2.2 用于分类

# 导包,机器学习的算法KNN from sklearn.neighbors import KNeighborsClassifier # 数据蓝蝴蝶 import sklearn.datasets as datasets iris = datasets.load_iris() # 提取样本数据 feature = iris['data'] target = iris['target'] # 将样本数据进行随机打乱 np.random.seed(1) np.random.shuffle(feature) np.random.seed(1) np.random.shuffle(target) feature.shape # (150, 4) # 获取训练样本数据和测试样本数据 #训练数据 x_train = feature[:140] y_train = target[:140] #测试数据 x_test = feature[-10:] y_test = target[-10:] # 实例化模型对象&训练模型 knn = KNeighborsClassifier(n_neighbors=10) knn.fit(x_train,y_train) knn.score(x_train,y_train) # 0.9857142857142858 print('预测分类:',knn.predict(x_test)) # 预测分类: [0 2 1 2 0 1 2 1 1 0] print('真实分类:',y_test) # 真实分类: [0 2 1 1 0 1 2 1 1 0]

# 读取adult.txt文件,最后一列是年收入,并使用KNN算法训练模型,然后使用模型预测一个人的年收入是否大于50 df = pd.read_csv('../data/adults.txt') # 获取年龄、教育程度、职位、每周工作时间作为机器学习数据 # 获取薪水作为对应结果 job_array = df['occupation'].unique() # 所有职位 # 数据转换,将String类型的职位数据转换为int dic = {} for i in range(15): key = job_array[i] value = i dic[key] = value df['occupation'] = df['occupation'].map(dic) feature = df[['occupation','age','education_num','hours_per_week']] target = df['salary'] # 切片:训练数据和预测数据 feature.shape # (32561, 4) x_train = feature[:32551] y_train = target[:32551] x_test = feature[-10:] y_test = target[-10:] # 生成算法 knn = KNeighborsClassifier(n_neighbors=10) knn.fit(x_train,y_train) knn.score(x_train,y_train) # 0.8192375042241405 print('预测值:',knn.predict(x_test)) print('真实值:',y_test)

import numpy as np

# bmp 图片后缀

import matplotlib.pyplot as plt

%matplotlib inline

from sklearn.neighbors import KNeighborsClassifier

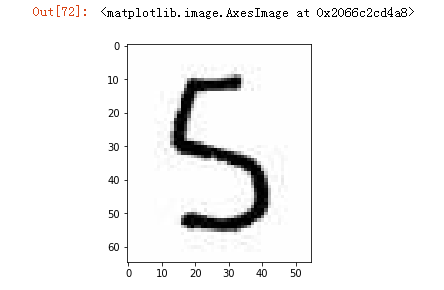

img_arr = plt.imread('./data/3/3_100.bmp')

plt.imshow(img_arr)

all_imgs_list = []

target_list = []

for i in range(10):

for j in range(500):

img_path = './data/'+str(i)+'/'+str(i)+'_'+str(j+1)+'.bmp' # 例: ./data/3/3_100.bmp

img_arr = plt.imread(img_path)

all_imgs_list.append(img_arr)

target_list.append(i)

# feature是一个三维数组(执行降维操作)

feature = feature.reshape(5000,28*28)

np.random.seed(3)

np.random.shuffle(feature)

np.random.seed(3)

np.random.shuffle(target)

x_train = feature[:4950]

y_train = target[:4950]

x_test = feature[-50:]

y_test = target[-50:]

knn = KNeighborsClassifier(n_neighbors=30)

knn.fit(x_train,y_train)

knn.score(x_train,y_train) # 0.9195959595959596

print('预测分类:',knn.predict(x_test))

print('真实数据:',y_test)

# 保存模型

from sklearn.externals import joblib

joblib.dump(knn,'./digist.m') # ['./digist.m']

knn = joblib.load('./digist.m')

# 外部图片的识别

img_arr = plt.imread('./数字.jpg')

plt.imshow(img_arr)

# five数组是三维的,需要进行降维,舍弃第三个表示颜色的维度

five_arr = five_arr.mean(axis=2)

five_arr.shape # (65, 55)

# 将像素转换为 28*28

import scipy.ndimage as ndimage

five = ndimage.zoom(five_arr,zoom = (28/65,28/55))

浙公网安备 33010602011771号

浙公网安备 33010602011771号