论文阅读:UCL-Dehaze(2022-CVPR)

UCL-Dehaze(2022-CVPR)

UCL-Dehaze: Towards Real-world Image Dehazing via Unsupervised Contrastive Learning

paper: https://arxiv.org/abs/2205.01871

code: https://github.com/yz-wang/UCL-Dehaze

摘要

虽然在合成模糊数据上训练图像去雾模型的智慧可以减轻收集真实世界的模糊/干净图像对的难度,但它带来了众所周知的域转移问题。从一个不同但新的角度,本文探讨了对比学习与对抗性训练的努力,以利用未配对的真实世界模糊图像和干净图像,从而避免了合成和现实世界模糊图像之间的差距。我们为图像去雾提出了一种

问题

-

从实际角度来看,在现实世界中很难甚至不可能获得清晰图像和雾图的配对数据。所以现有的方法采用合成模糊数据进行训练。合成和真实模糊图像之间的差距不可避免地降低了它们处理真实场景的去模糊能力。

-

大多数基于学习的方法仅利用清晰图像作为正样本来指导网络的训练,而忽略了模糊图像中的未利用信息作为负样本是有价值的。负样本还提供了有益的监督信息,以提高去雾模型的性能。

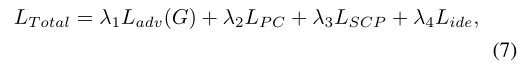

网路

Network Architecture

Generator

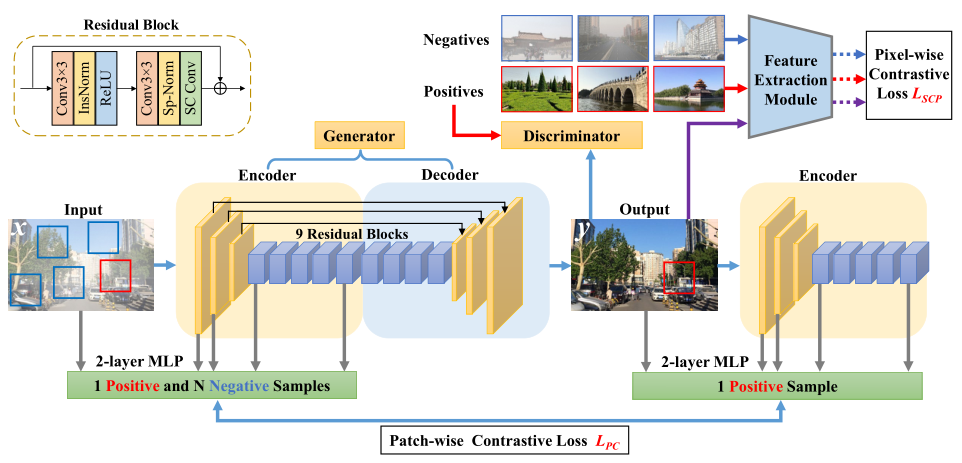

引入多尺度特征提取模块,即自校准卷积,进一步提高了网络的去雾性能

SC Conv

Self-calibrated Convolutions

自校准卷积模块是一种改进的CNN架构,可以捕获每个空间位置周围的长距离空间和信道间相关性。因此,它可以扩展每个卷积层的感受野,并帮助CNN产生更丰富的特征。鉴于此,采用自校准卷积模块作为多尺度特征提取模块,以提高UCL-Dehaze的去叠性能。

在每个卷积运算的ReLU层之后添加了自校准卷积模块,以扩展卷积层的接收场并提取多尺度特征,从而提高生成器的性能

Discriminator

使用著名的PatchGAN作为鉴别器,可以减少网络参数,比其他传统鉴别器执行的更快

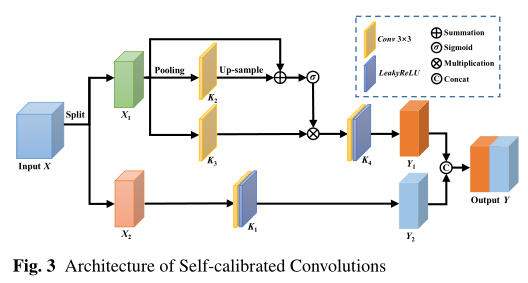

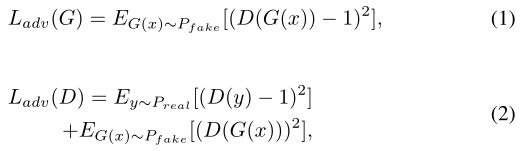

采用最小二乘GAN(LSGAN)损失训练网络,可以保证训练过程更稳定

目的:匹配输入图像和输出图像的相应正样本块,同时将其他块推离。

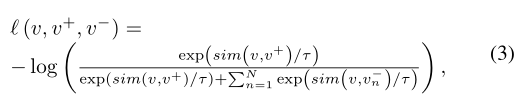

使用噪声对比估计模块来最大化正样本(x和y中的对应块)之间的互信息,表示为交叉熵损失:

逐块多层对比损失:

Pixel-wise Contrastive Learning

基于AECR网络开发新的像素级自对比感知损失:

![]()

采用同一损失来保持去叠后的结构相同,鼓励输出图像具有与输入图像相同的颜色组成和结构,从而提高生成图像的质量:

![]()

创新

-

提出了一种新的无监督对比学习范式,该范式将真实世界的图像去模糊化视为图像到图像的转换问题(称为UCL去模糊化)。UCLDehaze建立在对比学习框架之上,并受益于对抗性训练。

-

为了以无监督的方式有效地训练网络,除了逐块对比损失,制定了一种新的逐像素对比损失,即自对比感知(SCP)损失,以鼓励恢复图像和干净图像(正样本)在表示空间中聚集在一起,同时将它们从模糊图像(负样本)中推开。

实验

Datasets:

训练集由从RTTS和URHI中选择的1800幅真实模糊图像组成。对于无雾图像,从ITS中随机选择1800张干净图像。

训练集中所有模糊和干净的图像都是真实世界的图像,彼此不成对。SOT和HST都被用作测试集

Metrics:

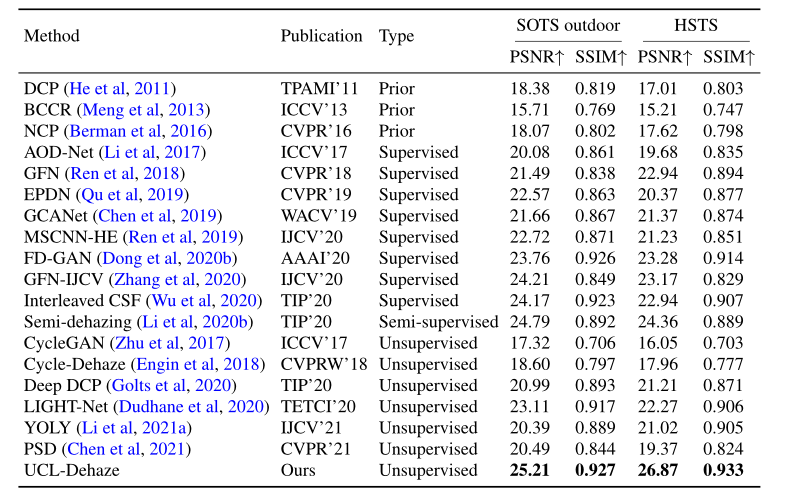

对比度增益 用于评估 图像的对比度

指标(e, r)通过测量图像边缘的增强程度 用于评估 图像的可见性

指标 σ ( 图像去雾后饱和像素(黑色或白色)的比率 )用于评估 去雾方法的颜色恢复性能

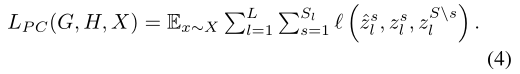

Comparison with SOTA

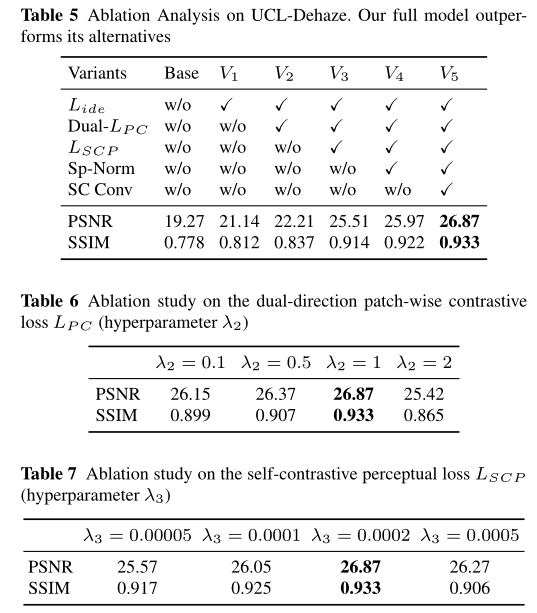

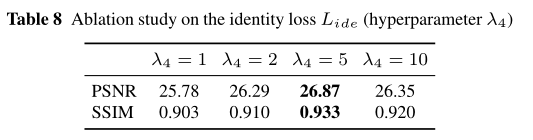

Ablation Study

结论与启发

从对抗训练的角度探索无监督对比学习,以利用未配对的真实世界模糊和清晰的图像。与大多数现有的图像去雾工作不同,UCL在训练期间不需要成对数据,并利用未配对的正/负数据来更好地增强去雾性能。它利用了对抗性训练,并受益于未配对的真实世界训练数据,因此可以在真实世界的模糊场景中顺利概括。此外,为了以无监督的方式有效地训练网络,提出了一种新的逐像素对比损失函数,即自对比感知损失,它鼓励恢复的图像接近干净的图像,同时远离嵌入空间中的模糊图像。

不足:

UCL Dehaze在真实场景中的去雾能力超过SOTA,但在合成数据集比起SOTA监督方法仍有不足;

浓雾场景的去雾效果不稳健,整个场景和物体的边缘很难自然恢复;