论文阅读:FFA-AECR-LD-DRN

FFA-Net (2020-AAAI)

FFA-Net Feature Fusion Attention Network for Single Image Dehazing

摘要

在本文中,我们提出了一种端到端的特征融合注意力网络(FFA-Net)来直接恢复无雾图像。 FFA-Net 架构由三个关键组件组成:

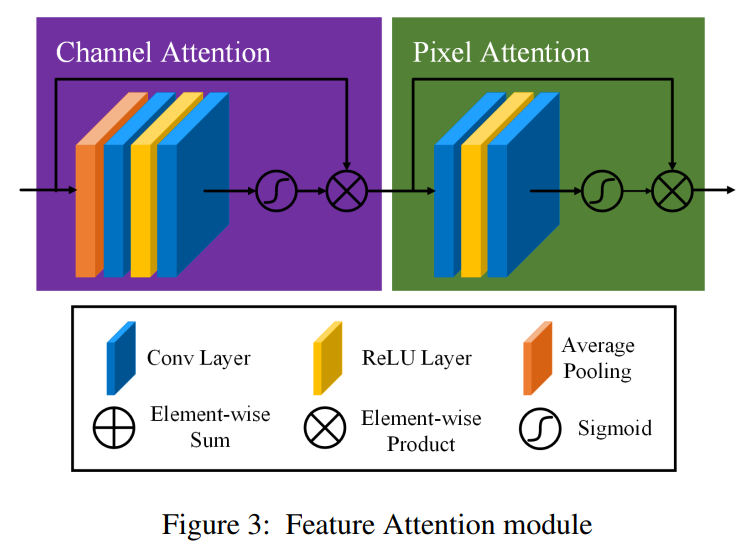

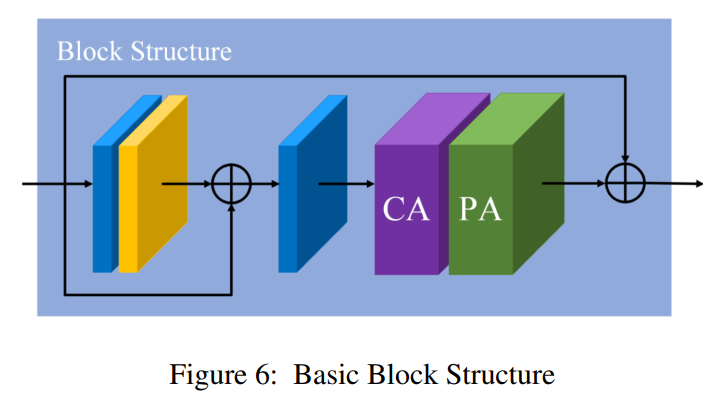

2)基本块结构由Local Residual Learning和Feature Attention组成,Local Residual Learning允许通过多个局部残差连接绕过薄雾区域或低频等不太重要的信息,让主网络架构专注于更有效的信息.

3)一种基于Attention的不同层次的Feature Fusion(FFA)结构,特征权重从Feature Attention(FA)模块自适应学习,赋予重要特征更多的权重。这种结构还可以保留浅层的信息,并将其传递到深层。

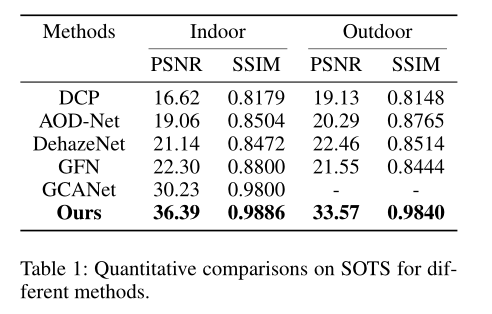

实验结果表明,我们提出的 FFANet 在数量和质量上都大大超过了以前最先进的单图像去雾方法,在 SOTS 室内测试数据集上将最佳发布的 PSNR 指标从 30.23 dB 提高到 36.39 dB。

1.以前基于 CNN 的图像去雾网络同等对待通道和像素特征,但是雾度在图像中分布不均匀,非常薄的雾度的权重应该与厚雾区域像素的权重有显着差异。此外, DCP 还发现,在至少一个颜色(RGB)通道中,某些像素具有非常低的强度是很常见的,这进一步说明了不同的通道特征具有完全不同的加权信息。 如果我们一视同仁,它将为不太重要的信息花费大量资源进行不必要的计算,网络将缺乏覆盖所有像素和通道的能力。 最后,它将极大地限制网络的表示。

2.随着网络的越来越深,浅层特征信息很难去保存

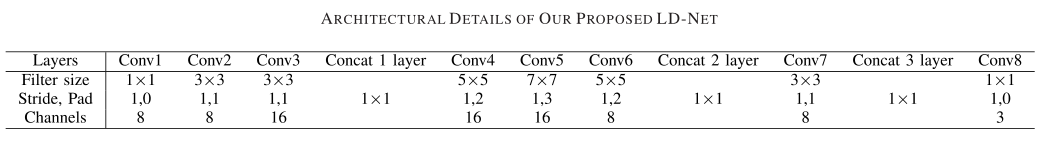

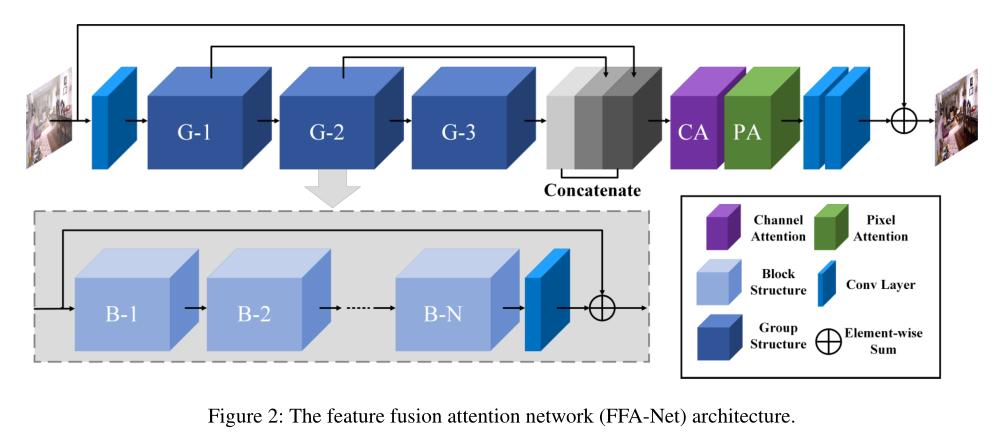

网络

Overall Framework

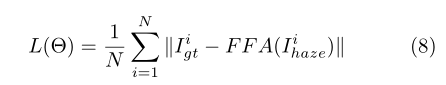

LOSS

L1 Loss

创新

1.提出了一种新的特征注意模块(FA)

2.提出了一个由局部残差学习和特征注意(FA)组成的基本块,局部残差学习允许通过多个跳转连接绕过薄雾区域的信息和低频信息,使主网络学习到更多有用的信息,特征注意(FA)进一步提高了FFA网络的容量

3.提出了一种基于注意的特征融合结构(FFA),该结构能够保留浅层信息并将其传递到深层。此外,它不仅可以融合所有特征,还可以自适应地学习不同层次特征信息的不同权重。

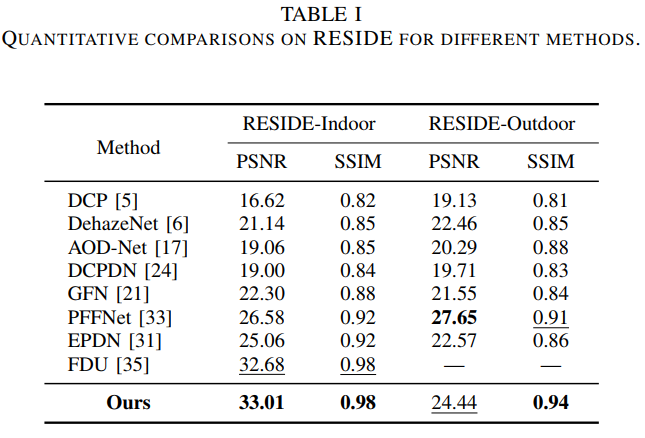

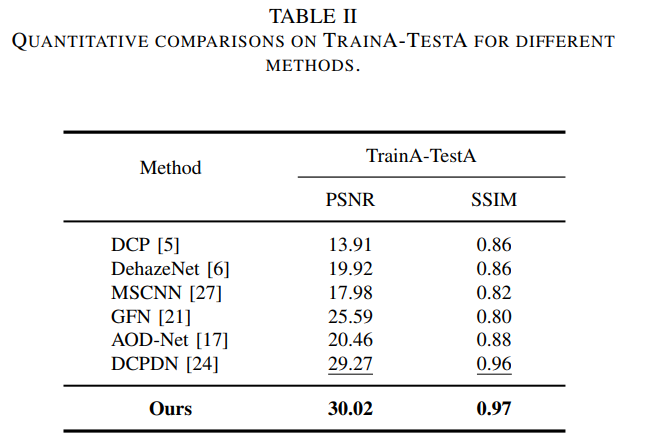

实验

Datasets: RESIDE

Metrics: PSNR、SSIM

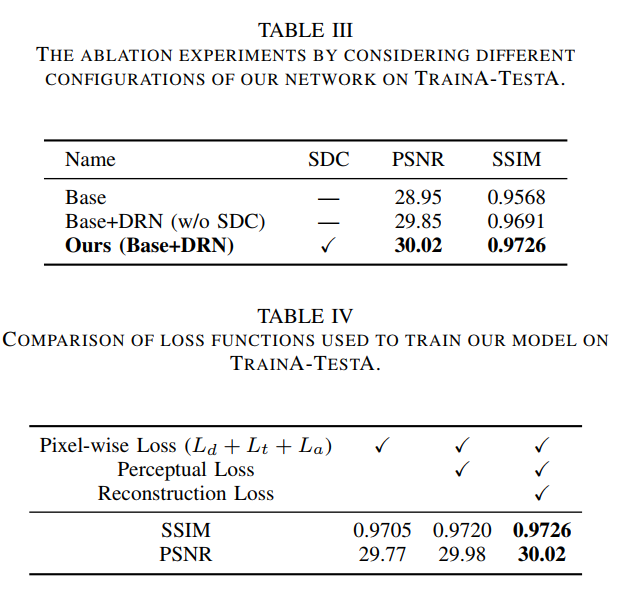

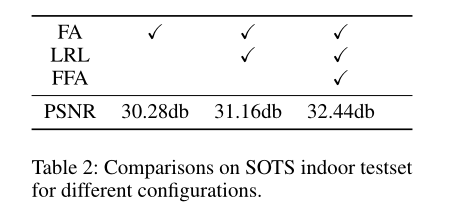

Ablation Study

AECR-Net (2021-CVPR)

Contrastive Learning for Compact Single Image Dehazing

摘要

由于严重的信息退化,单幅图像去雾是一个具有挑战性的不适定问题。然而,现有的基于深度学习的去雾方法只采用清晰的图像作为正样本来指导去雾网络的训练,而没有利用负信息。此外,他们中的大多数都专注于随着深度和宽度的增加来加强去雾网络,导致对计算和内存的需求很大。在本文中,我们提出了一种基于对比学习的新型对比正则化(CR),以分别利用模糊图像和清晰图像的信息作为负样本和正样本。 CR 确保在表示空间中将恢复的图像拉到更靠近清晰图像并推到远离模糊图像的位置。 此外,考虑到性能和内存存储之间的权衡,我们开发了一个基于自动编码器(AE)框架的紧凑去雾网络。它涉及自适应混合操作和动态特征增强模块,可以分别从自适应地保留信息流和扩展感受野以提高网络的转换能力中受益。我们将具有自动编码器和对比正则化的去雾网络称为 AECR-Net。对合成数据集和真实世界数据集的广泛实验表明,我们的 AECR-Net 超越了最先进的方法。

-

大多数现有的方法通常采用清晰的图像作为正样本,通过基于L1/L2的图像重建损失来指导dehazing网络的训练,而无需任何正则化。然而,仅图像重建丢失不能有效地处理图像的细节,这可能导致恢复图像中的颜色失真。并且这些方法将正面图像的信息作为上界,但由于负面图像的未利用信息作为下界,仍然会出现伪影或不满意的结果

-

以前的工作侧重于通过显著增加去雾模型的深度或宽度来提高去雾性能,而不考虑内存或计算开销,这限制了它们在资源有限的环境中使用,如移动或嵌入式设备

-

早期的工作专注于直接估计透射图和大气光。然而,这些方法可能会导致累积误差来产生伪影,因为对透射图和全球大气光的不准确估计或某些估计偏差会导致恢复图像和清晰图像之间的较大重建误差

网络

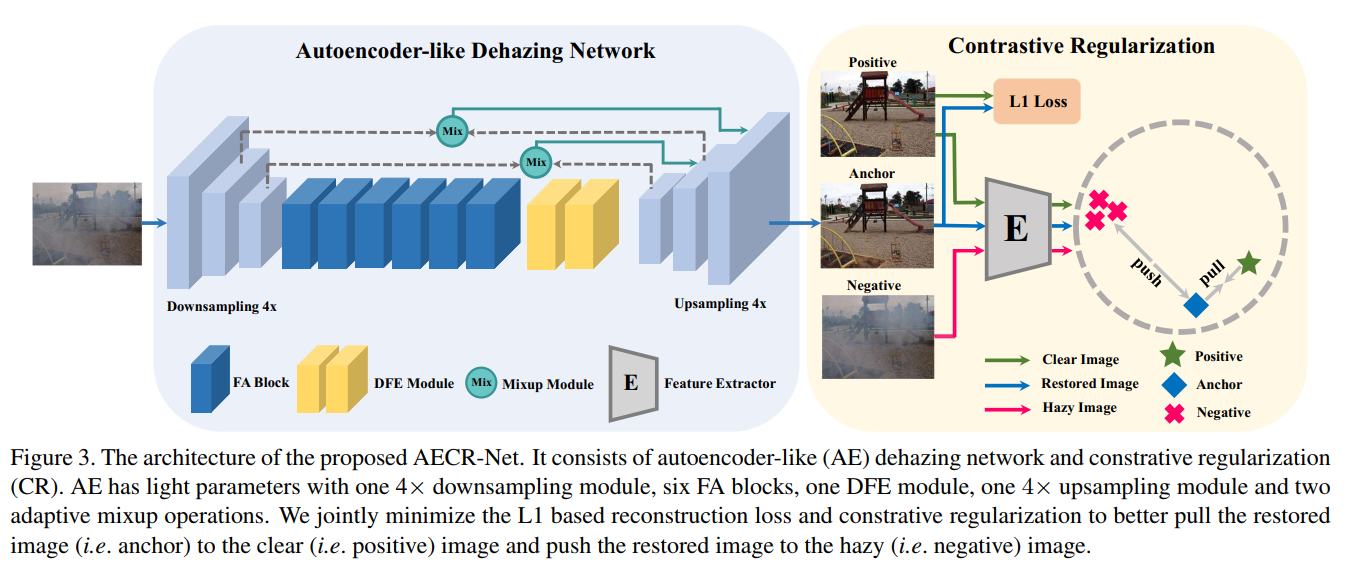

Overall Framework

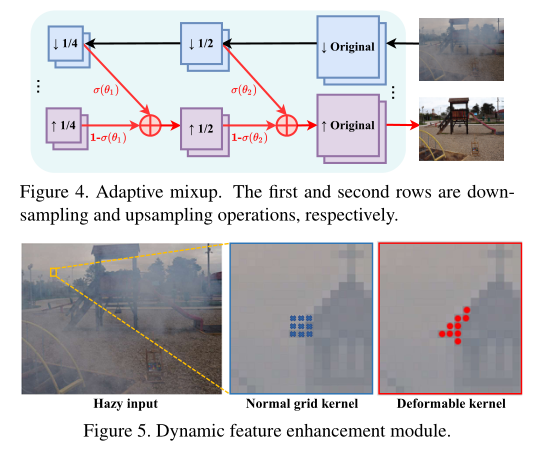

空间可变形卷积核可能会导致图像纹理损坏和过度平滑伪影,因此提出了可变形2D核来增强图像去噪的特征。通过可变形卷积引入动态特征增强模块(DFE),以自适应形状扩展感受野,提高模型的转换能力,从而更好地进行图像去雾。特别地,使用两个可变形卷积层来实现采样网格的更多自由形式变形。因此,网络可以动态地更加关注兴趣区域的计算,以融合更多的空间结构信息

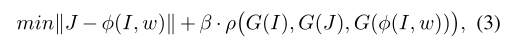

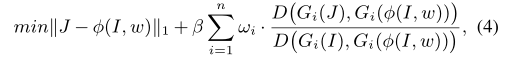

Loss

L1 Loss + CR

创新

-

提出了一种新的ACER网络,通过对比正则化和基于高度紧凑的类自动编码器的去雾网络,有效地生成高质量的无雾图像

-

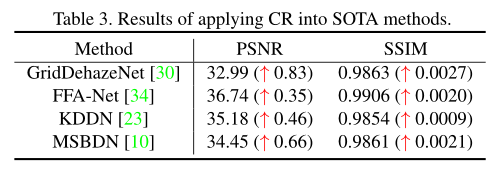

提出的对比正则化(CR 像素级对比损耗)作为一种通用正则化,通过对比学习来利用负面图像和正面图像的信息,可以进一步提高各种最先进的dehazing网络的性能

-

基于类似自动编码器的框架,通过减少层数和空间大小,dehazing网络是紧凑的

-

在所提出的类自动编码器(AE)去杂网络中,自适应混合和动态特征增强(DFE)模块可以分别帮助去雾模型自适应地保持信息流和增强网络的转换能力:(1)自适应混合动态融合下采样层和上采样层之间的特征,以保持特征。(2) 动态特征增强(DFE)模块通过融合更多的空间结构信息来增强转换能力

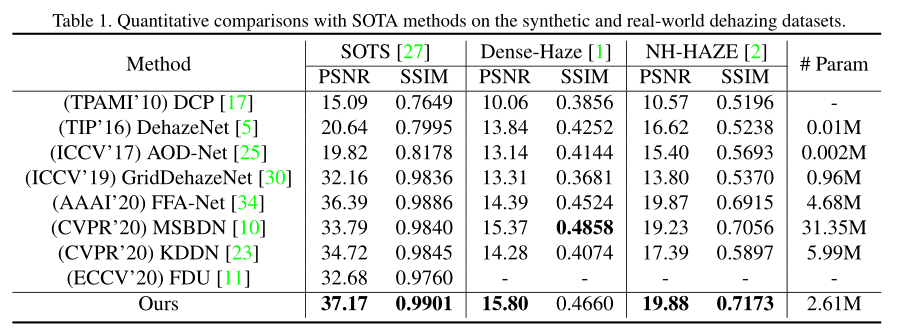

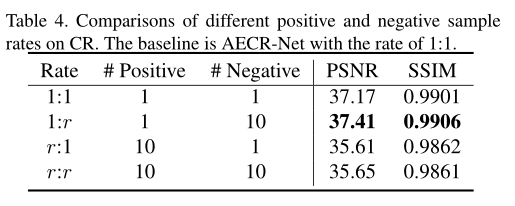

实验

Datasets: RESIDE

Metrics: PSNR、SSIM

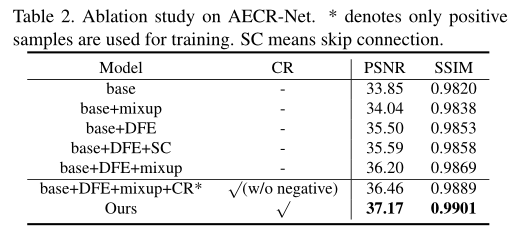

Ablation study

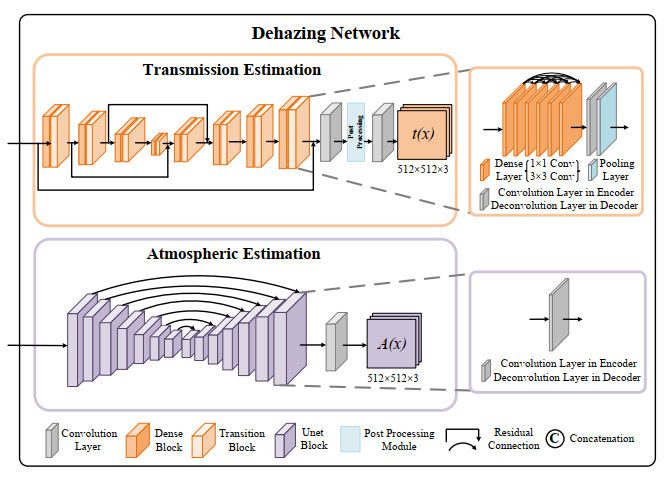

LD-Net(2021-IEEE)

Light-DehazeNet A Novel Lightweight CNN Architecture for Single Image Dehazing

摘要

由于人工智能技术的快速发展,工业部门在自动化、可靠性和稳健性方面发生了革命性的变化,从而显着提高了质量和生产力。大多数监控和工业部门都由视觉传感器网络监控,捕捉不同的周围环境图像。然而,在暴风雨天气条件下,图像的视觉质量会因受污染的悬浮大气颗粒影响整个监视系统而降低。为了应对这些挑战,本文提出了一种计算效率高的轻量级卷积神经网络,称为 LightDehazeNet (LD-Net),用于重建模糊图像。与其他分别测量透射图和大气光的基于学习的方法不同,我们提出的 LD-Net 使用变换的大气散射模型联合估计透射图和大气光。此外,提出了一种颜色可见性恢复方法来避免去雾图像中的颜色失真。最后,我们使用合成和自然的模糊图像进行了广泛的实验。对不同基准模糊数据集的定量和定性评估验证了所提出的方法相对于其他最先进的图像去雾技术的优越性。此外,额外的实验验证了所提出的方法在目标检测任务中的适用性。考虑到具有最小计算成本的轻量级架构,鼓励将所提出的系统作为基于视觉的监控系统的一个组成部分纳入,以提高整体性能。

问题

1.现有的图像去雾方法大多分别近似大气光和透射图,这增加了整个图像去雾过程的时间复杂度。

2.许多基于CNN的去杂方法具有非常复杂的体系结构,这增加了整个模糊图像重建过程的计算成本和时间复杂性。它们在计算和时间复杂性方面都非常昂贵,限制了它们对实时系统的适用性。

3.图像去雾是在恶劣、有雾或有雾天气下拍摄的模糊图像中识别和删除不需要的信息的过程。在模糊图像的重建过程中,恢复图像的特定光谱通常会受到干扰,通过引入不切实际的颜色失真,即光晕伪影和不平衡对比度,显著降低了颜色质量

4.他们的方法无法恢复浓雾图像,图像质量大大降低。此外,他们的网络从合成的模糊图像中学习映射函数;因此,限制了它们在室内和室外监控捕获的真实图像上的性能

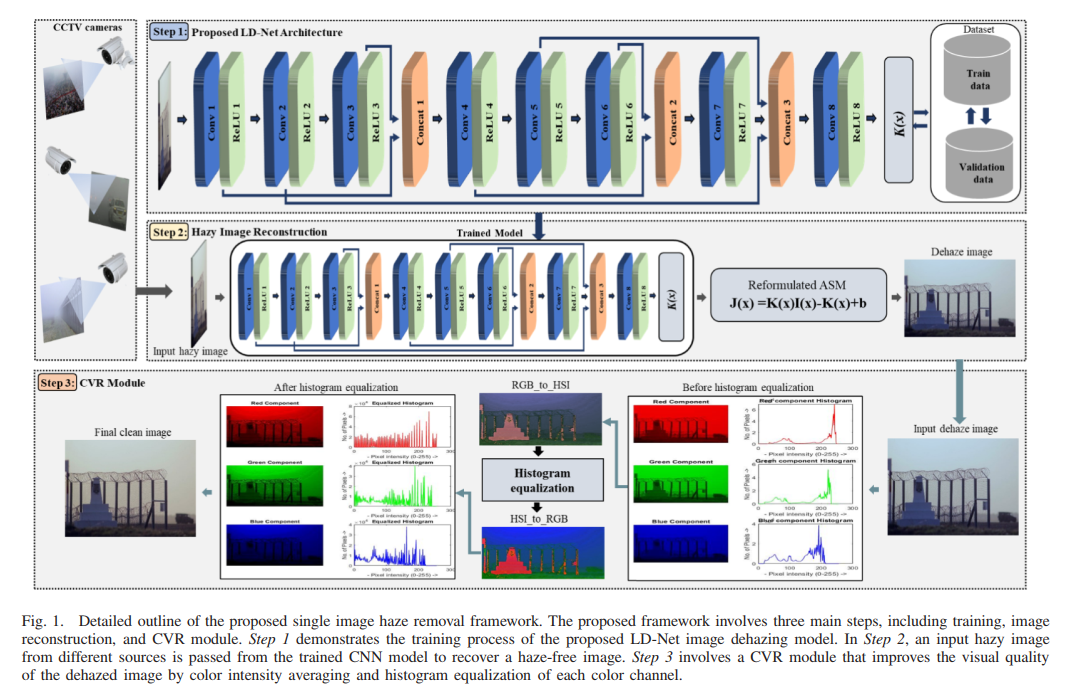

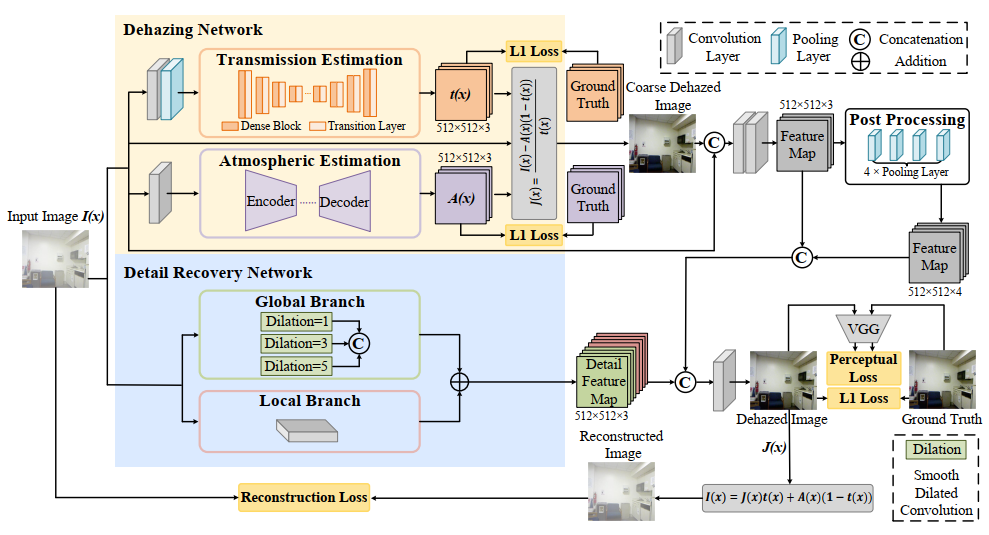

网络

Overall Framework

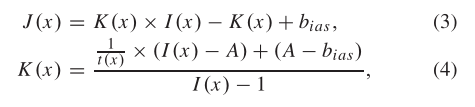

Hazy Image Reconstruction

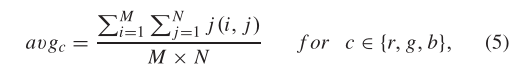

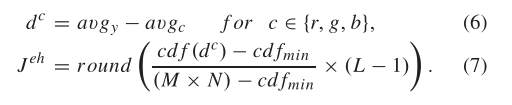

直方图均衡

对比度增强

创新

1.提出了一种计算效率高的卷积神经网络结构LD,用于单幅模糊图像重建。在LD网络体系结构中嵌入新的ASM模型,使我们提出的系统能够联合计算大气光和传输图,从而减少时间和计算复杂性

2.提出了一种补偿dehaze图像颜色损失的CVR模块。CVR模块对颜色直方图进行像素级平均和归一化,以恢复dehaze图像的颜色信息

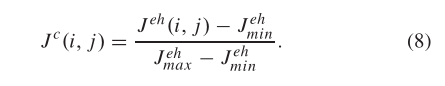

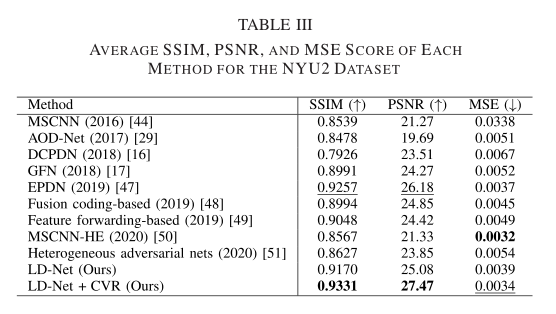

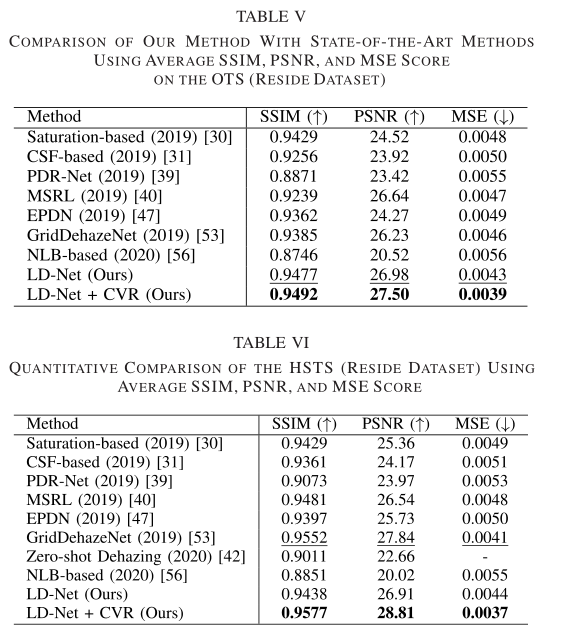

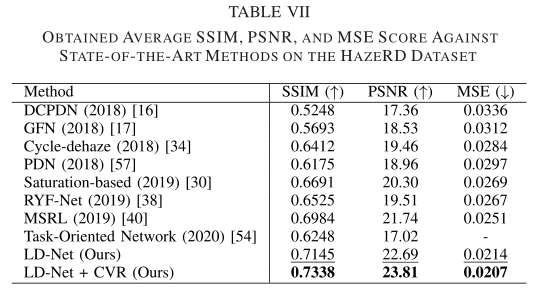

实验

Datasets: NYU2

Metrics: PSNR、SSIM

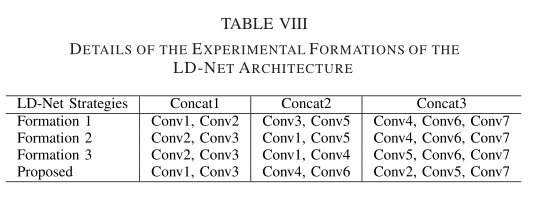

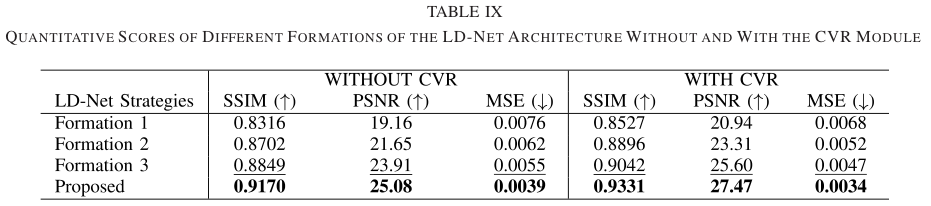

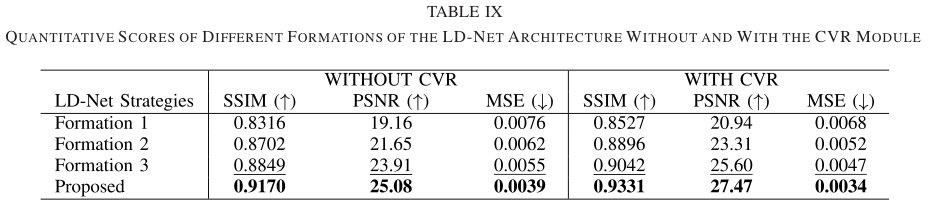

Ablation Study

Runtime Analysis

DRN (2021-ArXiv)

Single Image Dehazing with An Independent Detail-Recovery Network

摘要

单幅图像去雾是影响许多计算机视觉任务性能的先决条件,近年来越来越受到关注。然而,大多数现有的去雾方法更多地强调去雾,而不是去雾图像的细节恢复。在本文中,我们提出了一种具有独立细节恢复网络 (DRN) 的单幅图像去雾方法,该方法考虑通过单独的网络从输入图像中捕获细节,然后将它们整合到粗糙的去雾图像中。整个网络由两个独立的网络组成,分别命名为 DRN 和去雾网络。具体来说,DRN旨在分别通过局部和全局分支恢复去雾图像细节。局部分支可以通过卷积层获得局部细节信息,全局分支可以通过平滑扩张卷积(SDC)捕获更多的全局信息。将细节特征图融合到粗去雾图像中,得到图像细节丰富的去雾图像。此外,我们将 DRN、基于物理模型的去雾网络和重建损失集成到一个端到端的联合学习框架中。对公共图像去雾数据集(RESIDE-Indoor、RESIDE-Outdoor 和 TrainATestA)的广泛实验说明了所提出方法中模块的有效性,并表明我们的方法在数量和质量上都优于最新的去雾方法。

问题

1.大部分现有的方法主要关注于图像去雾,忽视了去雾图像细节的恢复

2.一些方法尝试去保存细节在去雾的主干网络中,然而避免不了去雾过程中的细节损失(EPDN)

3.很多方法只关注如何精确计算透射率矩阵,忽视了大气光的精确计算

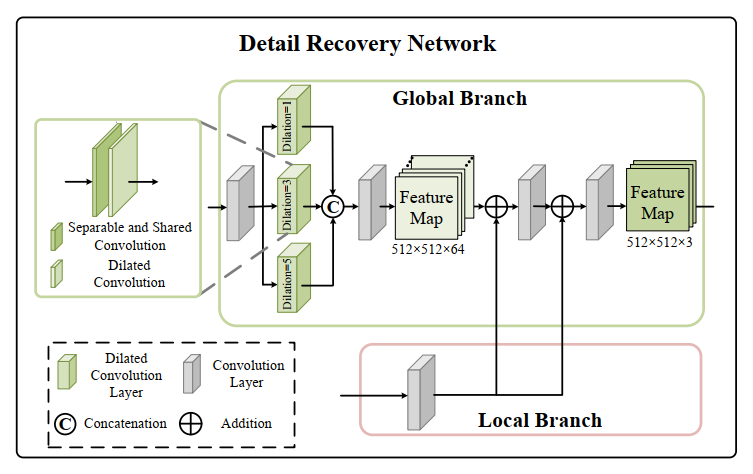

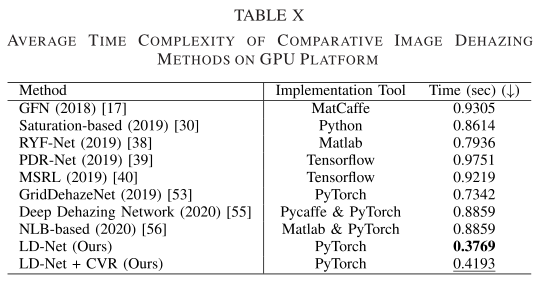

网络

Overall Framework

Dehazing Network

采用编码器-译码器结构学习透色率矩阵,采用密集连接模块,包含跳过连接,可以将浅层特征信息传递给深层网络

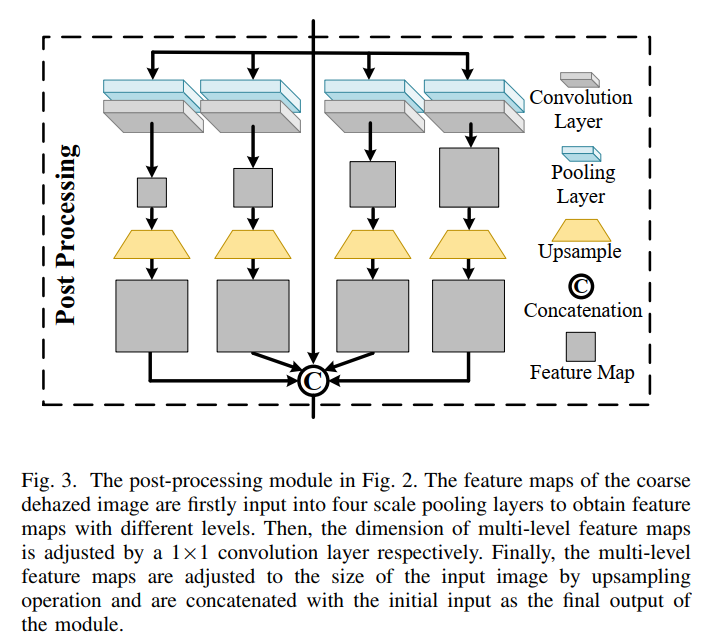

Post-processing Network

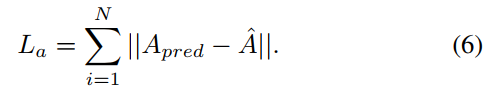

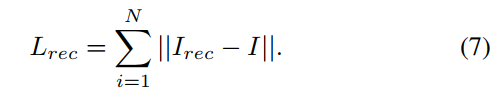

LOSS

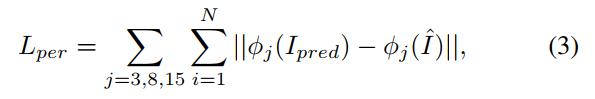

Perceptual Loss:去雾图像和真实无雾图像之间高级水平特征得差异损失

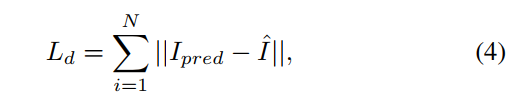

Pixel-wise Loss:L1损失,像素级损失

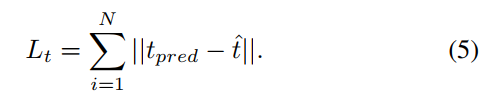

Reconstruction Loss:对整个网络进行联合优化

Total Loss:

![]()

创新

1.提出了一个独立的模块DRN进行细节恢复,采用局部分支和全局分支同时提取图像的局部和全局纹理信息

2.融合DRN模块、大气物理散射模型、重建损失成网络,提出了多方面损失函数,包括L1损失(像素级损失)、感知损失(特征级损失)和重建损失

实验

Datasets: RESIDE

Metrics: PSNR、SSIM

Ablation Study