2.机器学习相关数学基础

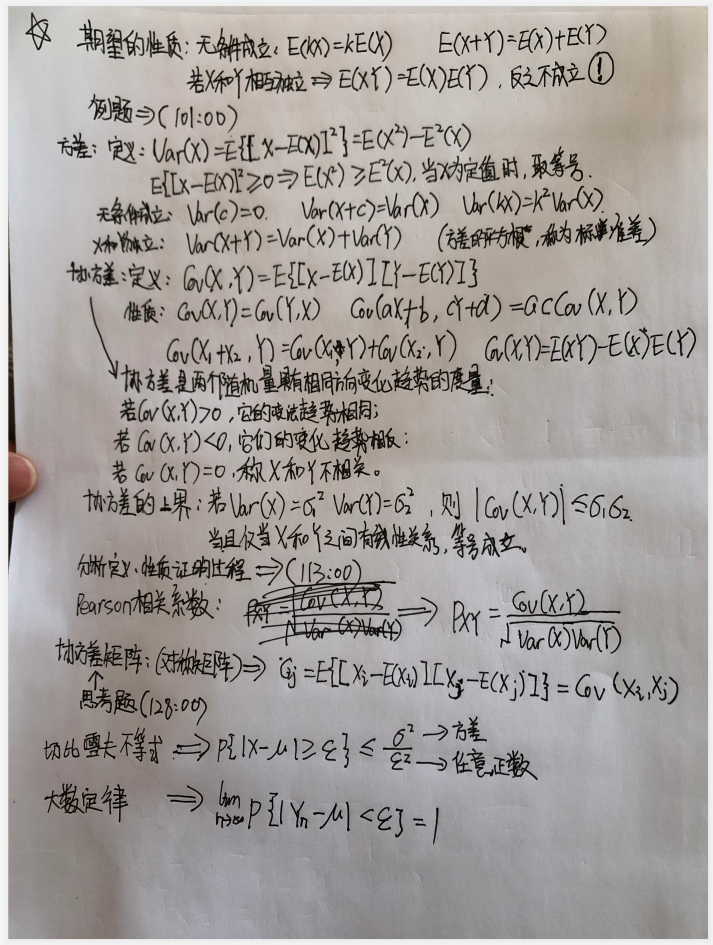

1)P2 概率论与贝叶斯先验

学习笔记:

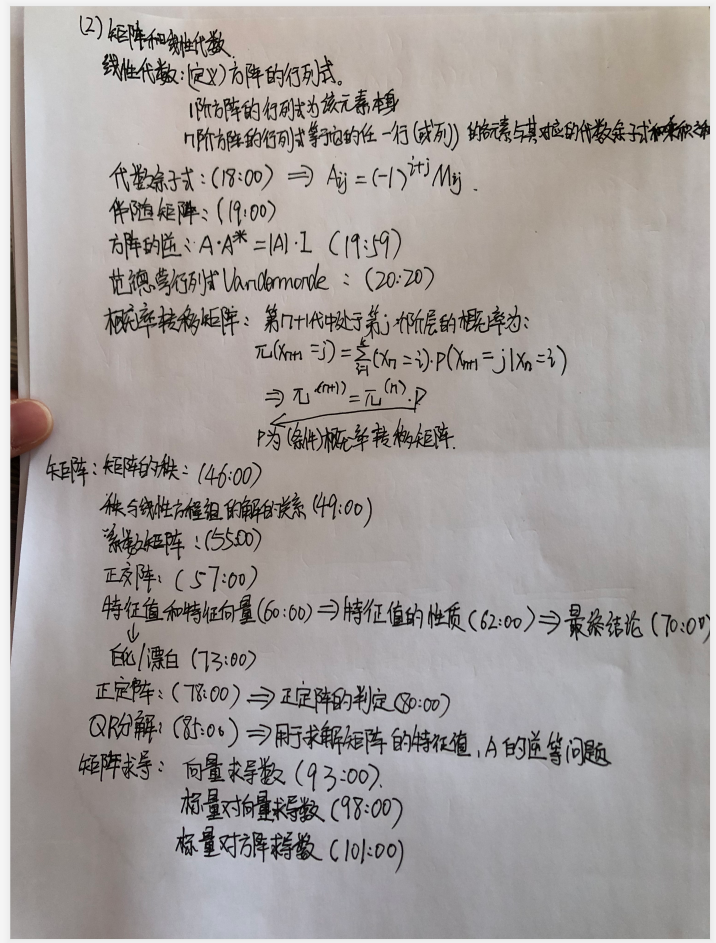

2)P3 矩阵和线性代数

学习笔记:

3)总结“梯度”,“梯度下降”和“贝叶斯定理”

如果存在一个可微分的函数。这个函数就代表着一座山。而目标就是找到这个函数的最小值,也就是山底。根据之前的场景假设,最快的下山的方式就是找到当前位置最陡峭的方向,然后沿着此方向向下走,对应到函数中,就是找到给定点的梯度 ,然后朝着梯度相反的方向,就能让函数值下降的最快!因为梯度的方向就是函数之变化最快的方向。所以,需要重复利用这个方法,反复求取梯度,最后就能到达局部的最小值。求取梯度就确定了最陡峭的方向,也就是场景中测量方向的手段。

梯度实际上就是多变量微分的一般化。我们可以看到,梯度就是分别对每个变量进行微分,然后用逗号分割开,梯度是用<>包括起来,说明梯度其实一个向量。在单变量的函数中,梯度其实就是函数的微分,代表着函数在某个给定点的切线的斜率在多变量函数中,梯度是一个向量,向量有方向,梯度的方向就指出了函数在给定点的上升最快的方向

梯度下降由梯度方向,和步长决定,每次移动一点点。但是每一次移动都是对你所在的那个点来说,往极值方向,所以能够保证收敛。梯度下降不一定能够找到全局的最优解,有可能是一个局部最优解。当然,如果损失函数是凸函数,梯度下降法得到的解就一定是全局最优解。

贝叶斯定理:在运用概率对某一事件进行推断之前,其实往往已经事先掌握了关于这一事件的概率,这个概率可能是主观概率或者相对概率,这种初始的概率可以称为先验概率。如果在后续的研究中,通过抽样调查样本等消息源又获得了有关该事件的信息,就可以根据这些新信息对先验概率进行修正,使先验概率变为后验概率。这个修正概率的定理就称为贝叶斯定理。

贝叶斯定理是用来描述两个条件概率之间关系的定理,比如P(A|B)和P(B|A),通常,事件A在事件B发生的条件下的概率{P(A|B)}与事件B在事件A的条件下的概率{P(B|A)}是不一样的,但是这两者之间有确定的关系,贝叶斯法则就是这种关系的陈述。

浙公网安备 33010602011771号

浙公网安备 33010602011771号