Multi-Layer Perceptron 多层感知机

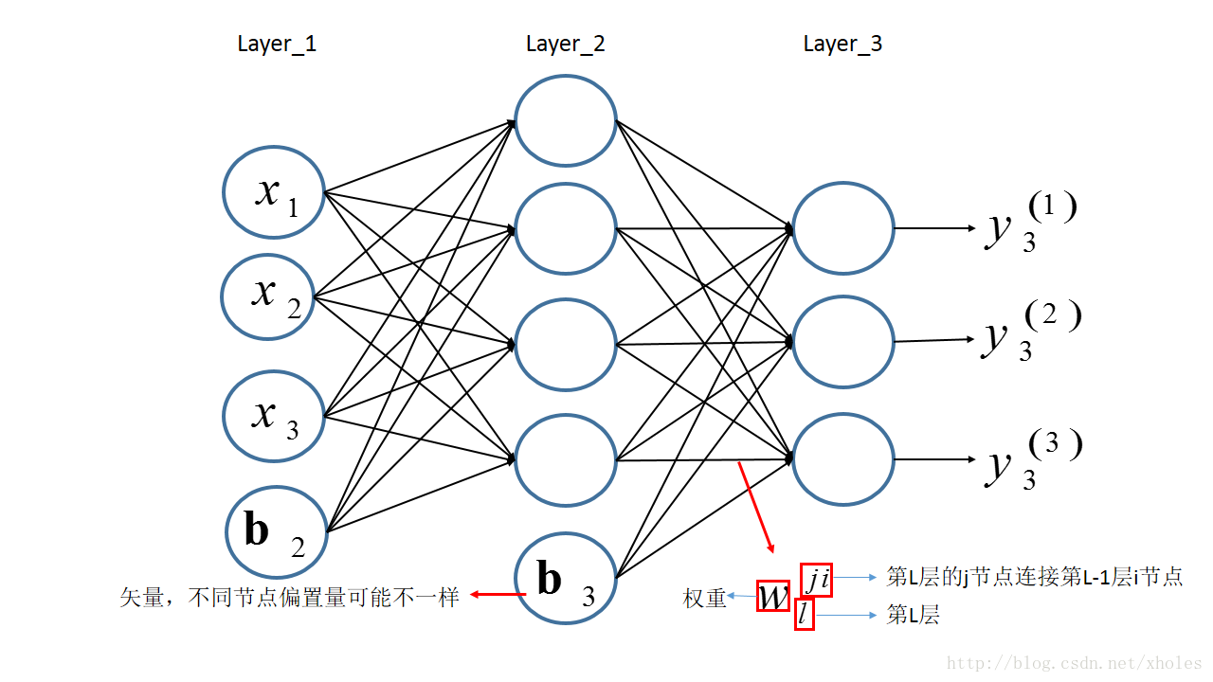

多层感知器,计算训练数据的输出,根据预测输出和实际输出之间的差异去调整神经元的权值w和偏重b,不断迭代训练直到误差小于一定范围。

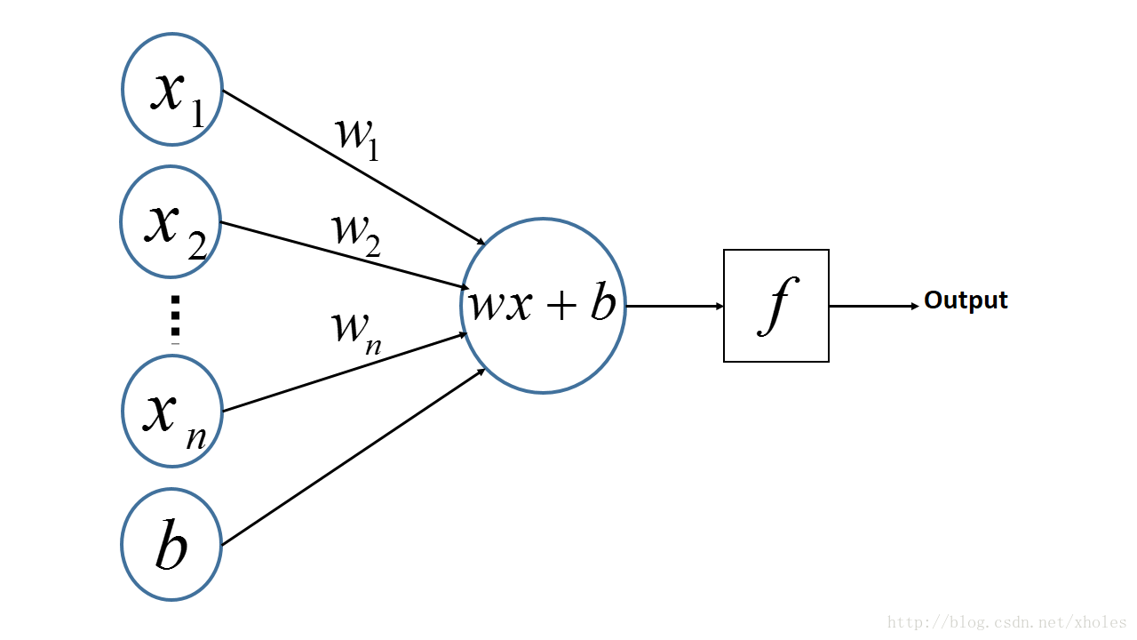

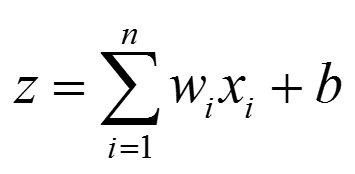

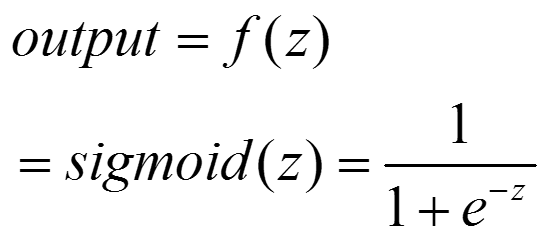

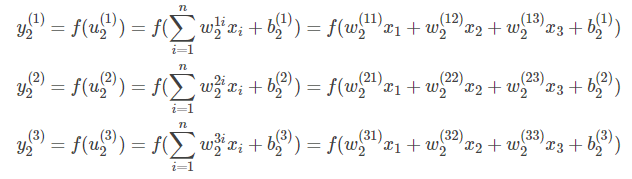

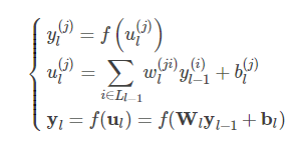

对于单个神经元:

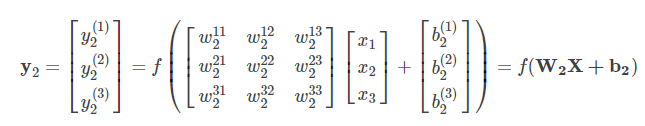

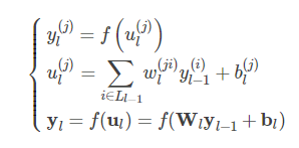

多层感知机的前向传播(Forward Propagation):

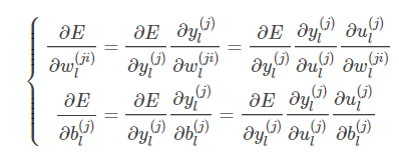

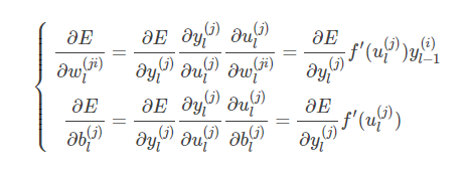

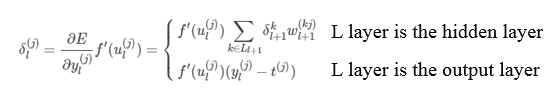

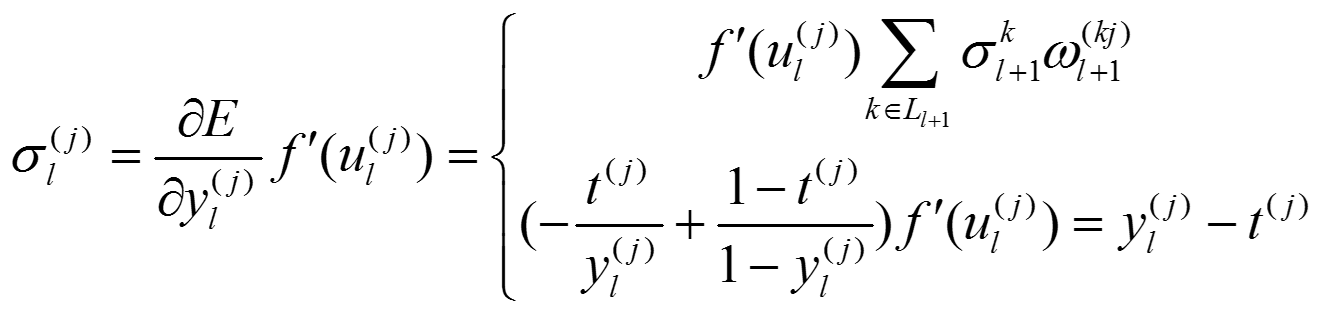

多层感知机的反向传播(Backward Propagation):

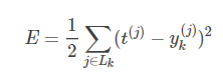

Loss function:

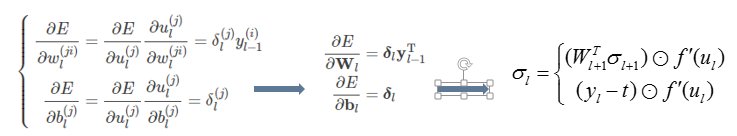

To minimize Loss function, using Gradient descend method:

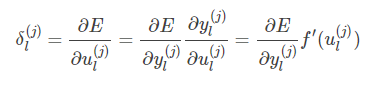

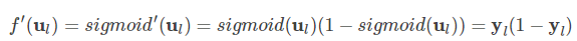

Assuming that:

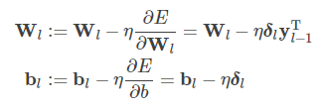

最终得到各层参数的更新公式为:

反复迭代,直到y*=y或训练轮数达到预设的上限或精度第一次达到或超过设定的阈值。

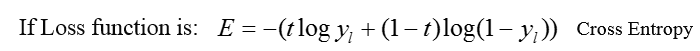

如果Loss function采用交叉熵(为什么?逻辑回归中最常采用交叉熵,采用交叉熵能使得代价函数为凸函数)

where,

浙公网安备 33010602011771号

浙公网安备 33010602011771号