git1:https://gitee.com/juncaoit/kafka-basic

git2: https://gitee.com/juncaoit/kafka-springboo-pro

一:kafka

1.

Kafka是最初由Linkedin公司开发,是一个分布式、支持分区的(partition)、多副本的(replica),基于zookeeper协调的分布式消息系统,它的最大的特性就是可以实时的处理大量数据以满足各种需求场景:比如基于hadoop的批处理系统、低延迟的实时系统、Storm/Spark流式处理引擎,web/nginx日志、访问日志,消息服务等等,用scala语言编写,Linkedin于2010年贡献给了Apache基金会并成为顶级开源 项目。

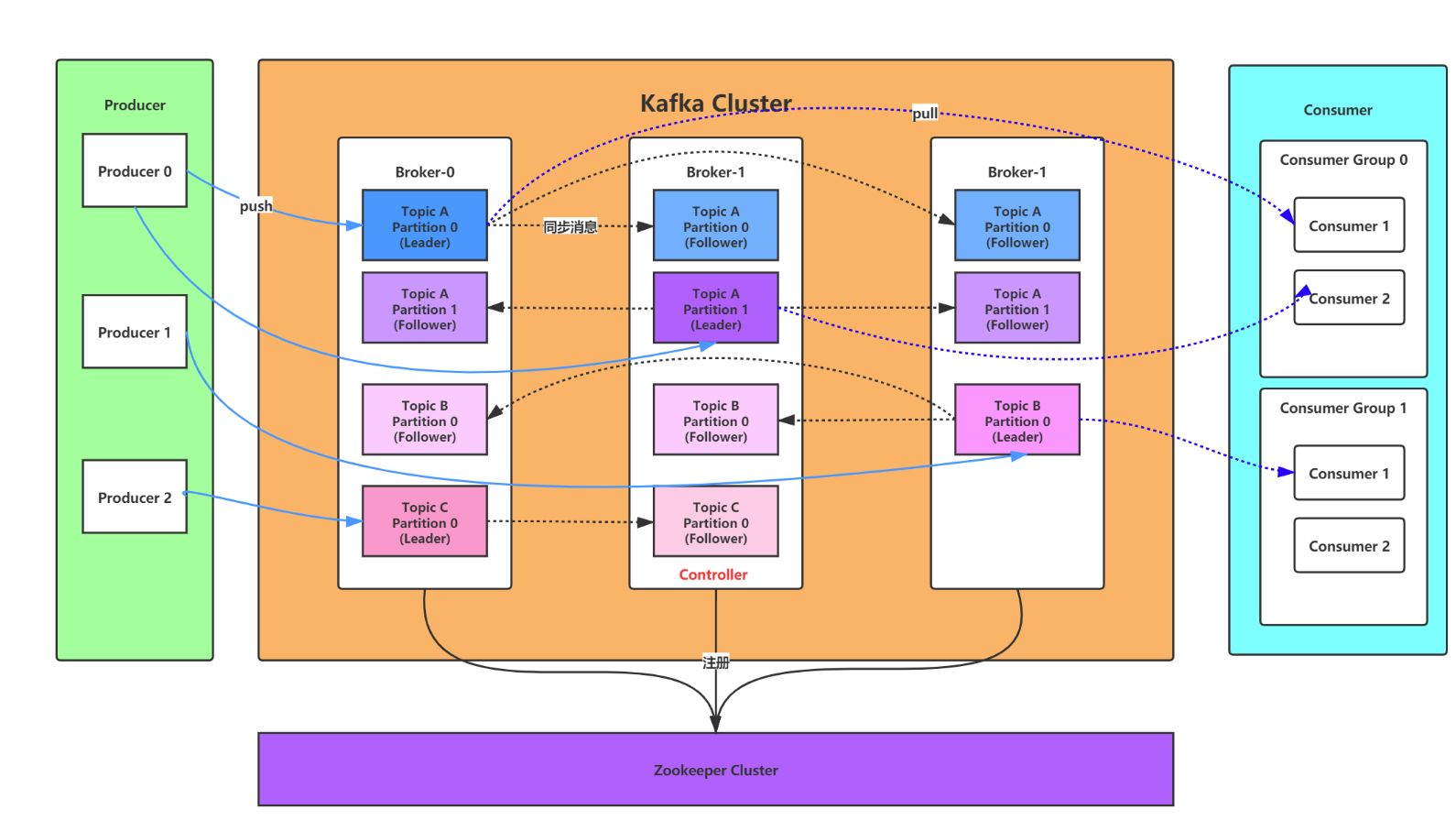

2.架构

producer通过网络发送消息到Kafka集群,然后consumer来进行消费

二:安装

1.下载

wget https://archive.apache.org/dist/kafka/2.4.1/kafka_2.11-2.4.1.tgz

2.解压

3.修改server.properties

#broker.id属性在kafka集群中必须要是唯一 broker.id=0 #kafka部署的机器ip和提供服务的端口号 listeners=PLAINTEXT://192.168.12.131:9092 #kafka的消息存储文件 log.dir=/usr/local/data/kafka-logs #kafka连接zookeeper的地址 zookeeper.connect=192.168.12.131:2181

|

Property

|

Default

|

Description

|

|

broker.id

|

0

|

每个broker都可以用一个唯一的非负整数id进行标识;这个id可以作为broker的“名字”,你可以选择任意你喜欢的数字作为id,只要id是唯一的即可。

|

|

log.dirs

|

/tmp/kafka-logs

|

kafka存放数据的路径。这个路径并不是唯一的,可以是多个,路径之间只需要使用逗号分隔即可;每当创建新partition时,都会选择在包含最少partitions的路径下进行。

|

|

listeners

|

PLAINTEXT://192.168.65.60:9092

|

server接受客户端连接的端口,ip配置kafka本机ip即可

|

|

zookeeper.connect

|

localhost:2181

|

zooKeeper连接字符串的格式为:hostname:port,此处hostname和port分别是ZooKeeper集群中某个节点的host和port;zookeeper如果是集群,连接方式为 hostname1:port1, hostname2:port2, hostname3:port3

|

|

log.retention.hours

|

168

|

每个日志文件删除之前保存的时间。默认数据保存时间对所有topic都一样。

|

|

num.partitions

|

1

|

创建topic的默认分区数

|

|

default.replication.factor

|

1

|

自动创建topic的默认副本数量,建议设置为大于等于2

|

|

min.insync.replicas

|

1

|

当producer设置acks为-1时,min.insync.replicas指定replicas的最小数目(必须确认每一个repica的写数据都是成功的),如果这个数目没有达到,producer发送消息会产生异常

|

|

delete.topic.enable

|

false

|

是否允许删除主题

|

4.启动

bin/kafka-server-start.sh -daemon config/server.properties

5.主题,创建,删除

1.创建

现在我们来创建一个名字为“test”的Topic,这个topic只有一个partition,并且备份因子也设置为1:

bin/kafka-topics.sh --create --zookeeper 192.168.12.131:2181 --replication-factor 1 --partitions 1 --topic test

查看topic:

bin/kafka-topics.sh --list --zookeeper 192.168.12.131:2181

注意:

除了我们通过手工的方式创建Topic,当producer发布一个消息到某个指定的Topic,这个Topic如果不存在,就自动创建。

bin/kafka-topics.sh --delete --topic test --zookeeper 192.168.12.131:2181

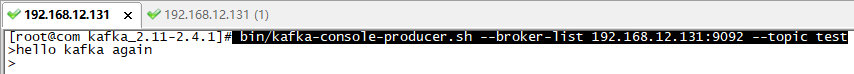

bin/kafka-console-producer.sh --broker-list 192.168.12.131:9092 --topic test

2.消费

对于consumer,kafka同样也携带了一个命令行客户端,会将获取到内容在命令中进行输出,默认是消费最新的消息:

bin/kafka-console-consumer.sh --bootstrap-server 192.168.12.131:9092 --topic test

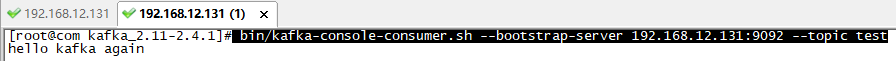

7.单播消息与多播消息

1.单播

分别在两个客户端执行如下消费命令,然后往主题里发送消息,结果只有一个客户端能收到消息

bin/kafka-console-consumer.sh --bootstrap-server 192.168.12.131:9092 --consumer-property group.id=testgroup --topic test

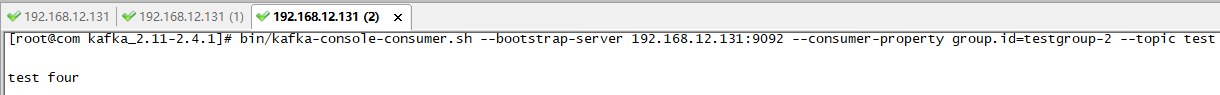

2.多播

再加入一个客户端

bin/kafka-console-consumer.sh --bootstrap-server 192.168.12.131:9092 --consumer-property group.id=testgroup-2 --topic test

效果:

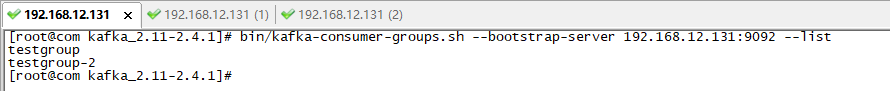

8.查看消费组

bin/kafka-consumer-groups.sh --bootstrap-server 192.168.12.131:9092 --list

效果

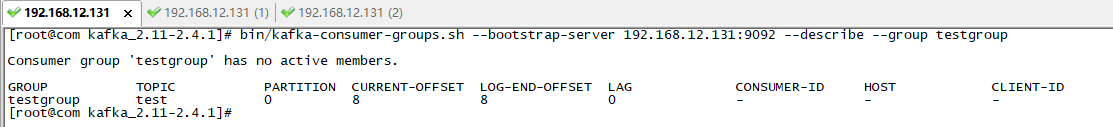

9.查看消费者偏移量

bin/kafka-consumer-groups.sh --bootstrap-server 192.168.12.131:9092 --describe --group testgroup

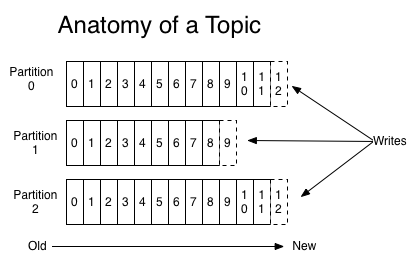

三:主题topic与消息日志

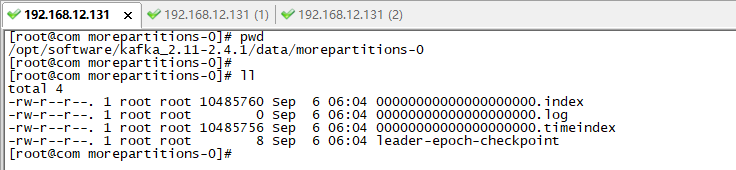

Partition是一个有序的message序列,这些message按顺序添加到一个叫做commit log的文件中。每个partition中的消息都有一个唯一的编号,称之为offset,用来唯一标示某个分区中的message。

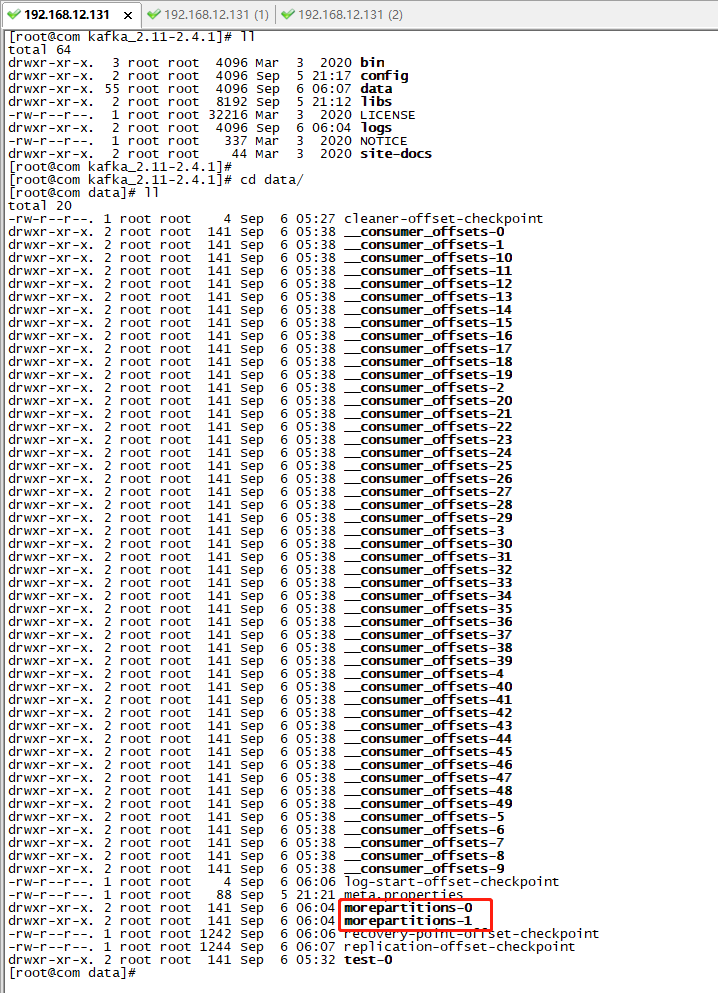

2.创建多个分区

bin/kafka-topics.sh --create --zookeeper 192.168.12.131:2181 --replication-factor 1 --partitions 2 --topic morepartitions

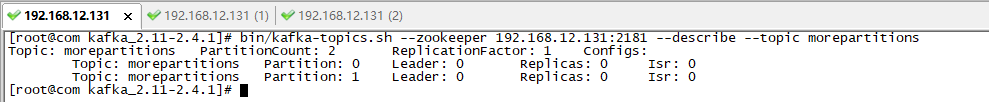

3.查看topic的情况

bin/kafka-topics.sh --zookeeper 192.168.12.131:2181 --describe --topic morepartitions

以下是输出内容的解释,第一行是所有分区的概要信息,之后的每一行表示每一个partition的信息。

- leader节点负责给定partition的所有读写请求。

- replicas 表示某个partition在哪几个broker上存在备份。不管这个几点是不是”leader“,甚至这个节点挂了,也会列出。

- isr 是replicas的一个子集,它只列出当前还存活着的,并且已同步备份了该partition的节点。

再进一步:

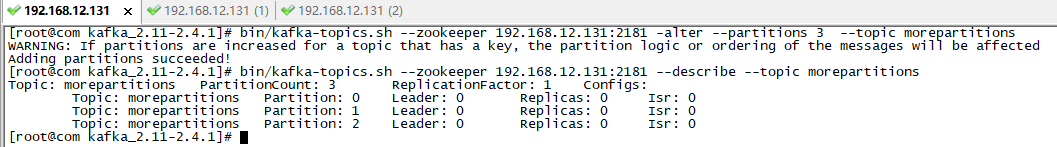

5.增加partions

不支持减少

bin/kafka-topics.sh --zookeeper 192.168.12.131:2181 -alter --partitions 3 --topic morepartitions

效果

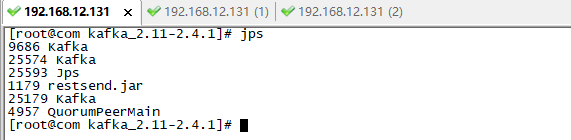

四:集群

cp config/server.properties config/server-1.properties cp config/server.properties config/server-2.properties

2.修改配置

配置文件的需要修改的内容分别如下:

#broker.id属性在kafka集群中必须要是唯一 broker.id=1 #kafka部署的机器ip和提供服务的端口号 listeners=PLAINTEXT://192.168.12.131:9093 log.dir=/opt/software/kafka_2.11-2.4.1/data/log1 #kafka连接zookeeper的地址,要把多个kafka实例组成集群,对应连接的zookeeper必须相同 zookeeper.connect=192.168.12.131:2181

#broker.id属性在kafka集群中必须要是唯一 broker.id=2 #kafka部署的机器ip和提供服务的端口号 listeners=PLAINTEXT://192.168.12.131:9094 log.dir=/opt/software/kafka_2.11-2.4.1/data/log2 #kafka连接zookeeper的地址,要把多个kafka实例组成集群,对应连接的zookeeper必须相同 zookeeper.connect=192.168.12.131:2181

3.启动新的实例

bin/kafka-server-start.sh -daemon config/server-1.properties bin/kafka-server-start.sh -daemon config/server-2.properties

4.创建主题

bin/kafka-topics.sh --create --zookeeper 192.168.12.131:2181 --replication-factor 3 --partitions 2 --topic clusterTest

5.消息,生产,消费

生产

bin/kafka-console-producer.sh --broker-list 192.168.12.131:9092,192.168.12.131:9093,192.168.12.131:9094 --topic clusterTest

消费

bin/kafka-console-consumer.sh --bootstrap-server 192.168.12.131:9092,192.168.12.131:9093,192.168.12.131:9094 --topic clusterTest --from-beginning

五:普通java访问kafka

1.producter

package com.jun.kafka.producter; import com.alibaba.fastjson.JSON; import com.jun.kafka.Order; import org.apache.kafka.clients.producer.*; import org.apache.kafka.common.serialization.StringSerializer; import java.util.Arrays; import java.util.Properties; import java.util.concurrent.CountDownLatch; import java.util.concurrent.ExecutionException; import java.util.concurrent.TimeUnit; /** * 生产者 */ public class MsgProducer { private final static String TOPIC_NAME = "my-replicated-topic"; public static void main(String[] args) throws InterruptedException, ExecutionException { // 设置参数 Properties props = getProperties(); Producer<String, String> producer = new KafkaProducer<String, String>(props); // 5个线程异步发送 int msgNum = 5; final CountDownLatch countDownLatch = new CountDownLatch(msgNum); for (int i = 1; i <= msgNum; i++) { Order order = new Order(i, 100 + i, 1, 1000.00); sendAsyn(producer, countDownLatch, order); } // 都发送完成,关闭生产者 countDownLatch.await(5, TimeUnit.SECONDS); producer.close(); } /** * 同步发送 */ private static void send(Producer<String, String> producer, CountDownLatch countDownLatch, Order order) throws ExecutionException, InterruptedException { // 未指定发送分区,具体发送的分区计算公式:hash(key)%partitionNum ProducerRecord<String, String> producerRecord = new ProducerRecord<String, String>(TOPIC_NAME, order.getOrderId().toString(), JSON.toJSONString(order)); // 等待消息发送成功的同步阻塞方法 // 多一个get RecordMetadata metadata = producer.send(producerRecord).get(); System.out.println("同步方式发送消息结果:" + "topic-" + metadata.topic() + "|partition-" + metadata.partition() + "|offset-" + metadata.offset()); } /** * 异步发送 */ private static void sendAsyn(Producer<String, String> producer, CountDownLatch countDownLatch, Order order) { //未指定发送分区,具体发送的分区计算公式:hash(key)%partitionNum ProducerRecord<String, String> producerRecord = new ProducerRecord<String, String>(TOPIC_NAME, order.getOrderId().toString(), JSON.toJSONString(order)); //异步回调方式发送消息 producer.send(producerRecord, new Callback() { public void onCompletion(RecordMetadata metadata, Exception exception) { if (exception != null) { System.err.println("发送消息失败:" + Arrays.toString(exception.getStackTrace())); } if (metadata != null) { System.out.println("异步方式发送消息结果:" + "topic-" + metadata.topic() + "|partition-" + metadata.partition() + "|offset-" + metadata.offset()); } countDownLatch.countDown(); } }); } /** * 设置参数 */ private static Properties getProperties() { Properties props = new Properties(); /** * 必须参数 */ props.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG, "192.168.12.131:9092,192.168.12.131:9093,192.168.12.131:9094"); //把发送的key从字符串序列化为字节数组,把发送消息value从字符串序列化为字节数组 props.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName()); props.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG, StringSerializer.class.getName()); /** * 优化的参数 */ /* 发出消息持久化机制参数 (1)acks=0: 表示producer不需要等待任何broker确认收到消息的回复,就可以继续发送下一条消息。性能最高,但是最容易丢消息。 (2)acks=1: 至少要等待leader已经成功将数据写入本地log,但是不需要等待所有follower是否成功写入。就可以继续发送下一 条消息。这种情况下,如果follower没有成功备份数据,而此时leader又挂掉,则消息会丢失。 (3)acks=-1或all: 需要等待 min.insync.replicas(默认为1,推荐配置大于等于2) 这个参数配置的副本个数都成功写入日志,这种策略会保证 只要有一个备份存活就不会丢失数据。这是最强的数据保证。一般除非是金融级别,或跟钱打交道的场景才会使用这种配置。 */ props.put(ProducerConfig.ACKS_CONFIG, "1"); /* 发送失败会重试,默认重试间隔100ms,重试能保证消息发送的可靠性,但是也可能造成消息重复发送,比如网络抖动,所以需要在 接收者那边做好消息接收的幂等性处理 */ props.put(ProducerConfig.RETRIES_CONFIG, 3); //重试间隔设置 props.put(ProducerConfig.RETRY_BACKOFF_MS_CONFIG, 300); //设置发送消息的本地缓冲区,如果设置了该缓冲区,消息会先发送到本地缓冲区,可以提高消息发送性能,默认值是33554432,即32MB props.put(ProducerConfig.BUFFER_MEMORY_CONFIG, 33554432); /* kafka本地线程会从缓冲区取数据,批量发送到broker, 设置批量发送消息的大小,默认值是16384,即16kb,就是说一个batch满了16kb就发送出去 */ props.put(ProducerConfig.BATCH_SIZE_CONFIG, 16384); /* 默认值是0,意思就是消息必须立即被发送,但这样会影响性能 一般设置10毫秒左右,就是说这个消息发送完后会进入本地的一个batch,如果10毫秒内,这个batch满了16kb就会随batch一起被发送出去 如果10毫秒内,batch没满,那么也必须把消息发送出去,不能让消息的发送延迟时间太长 */ props.put(ProducerConfig.LINGER_MS_CONFIG, 10); return props; } }

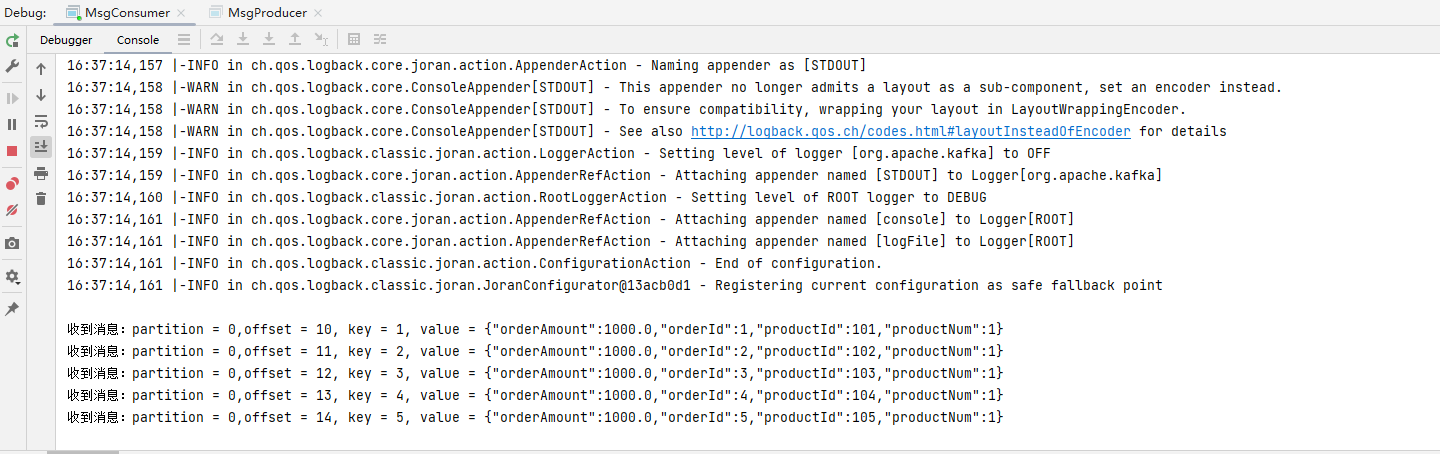

2.consumer

package com.jun.kafka.consumer; import org.apache.kafka.clients.consumer.*; import org.apache.kafka.common.TopicPartition; import org.apache.kafka.common.serialization.StringDeserializer; import java.time.Duration; import java.util.Arrays; import java.util.Collections; import java.util.Map; import java.util.Properties; /** * 消费者 */ public class MsgConsumer { private final static String TOPIC_NAME = "my-replicated-topic"; private final static String CONSUMER_GROUP_NAME = "testGroup"; public static void main(String[] args) { // 设置参数 Properties props = getProperties(); KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(props); // 消费topic consumer.subscribe(Collections.singletonList(TOPIC_NAME)); // while消费 while (true) { /* * poll() API 是拉取消息的长轮询 * 如果有数据,就继续往下运行,如果没有数据,等1000秒时,就继续往下运行 */ ConsumerRecords<String, String> records = consumer.poll(Duration.ofMillis(1000)); for (ConsumerRecord<String, String> record : records) { System.out.printf("收到消息:partition = %d,offset = %d, key = %s, value = %s%n", record.partition(), record.offset(), record.key(), record.value()); } // 同步提交offset if (records.count() > 0) { consumer.commitSync(); } } } /** * 设置参数 */ private static Properties getProperties() { Properties props = new Properties(); props.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG, "192.168.12.131:9092,192.168.12.131:9093,192.168.12.131:9094"); props.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName()); props.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG, StringDeserializer.class.getName()); // 消费分组名 props.put(ConsumerConfig.GROUP_ID_CONFIG, CONSUMER_GROUP_NAME); // 是否自动提交offset,默认就是true props.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG, "false"); /* consumer给broker发送心跳的间隔时间,broker接收到心跳如果此时有rebalance发生会通过心跳响应将 rebalance方案下发给consumer,这个时间可以稍微短一点 */ props.put(ConsumerConfig.HEARTBEAT_INTERVAL_MS_CONFIG, 1000); /* 服务端broker多久感知不到一个consumer心跳就认为他故障了,会将其踢出消费组, 对应的Partition也会被重新分配给其他consumer,默认是10秒 */ props.put(ConsumerConfig.SESSION_TIMEOUT_MS_CONFIG, 10 * 1000); //一次poll最大拉取消息的条数,如果消费者处理速度很快,可以设置大点,如果处理速度一般,可以设置小点 props.put(ConsumerConfig.MAX_POLL_RECORDS_CONFIG, 500); /* 如果两次poll操作间隔超过了这个时间,broker就会认为这个consumer处理能力太弱, 会将其踢出消费组,将分区分配给别的consumer消费 */ props.put(ConsumerConfig.MAX_POLL_INTERVAL_MS_CONFIG, 30 * 1000); /** * 当消费主题的是一个新的消费组,或者指定offset的消费方式,offset不存在,那么应该如何消费 * latest(默认) :只消费自己启动之后发送到主题的消息 * earliest:第一次从头开始消费,以后按照消费offset记录继续消费,这个需要区别于consumer.seekToBeginning(每次都从头开始消费) */ props.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG, "latest"); return props; } //**********************其他消费方式************************************************ // 消费指定分区 //consumer.assign(Arrays.asList(new TopicPartition(TOPIC_NAME, 0))); //消息回溯消费 /*consumer.assign(Arrays.asList(new TopicPartition(TOPIC_NAME, 0))); consumer.seekToBeginning(Arrays.asList(new TopicPartition(TOPIC_NAME, 0)));*/ //指定offset消费 /*consumer.assign(Arrays.asList(new TopicPartition(TOPIC_NAME, 0))); consumer.seek(new TopicPartition(TOPIC_NAME, 0), 10);*/ //从指定时间点开始消费 /*List<PartitionInfo> topicPartitions = consumer.partitionsFor(TOPIC_NAME); //从1小时前开始消费 long fetchDataTime = new Date().getTime() - 1000 * 60 * 60; Map<TopicPartition, Long> map = new HashMap<>(); for (PartitionInfo par : topicPartitions) { map.put(new TopicPartition(topicName, par.partition()), fetchDataTime); } Map<TopicPartition, OffsetAndTimestamp> parMap = consumer.offsetsForTimes(map); for (Map.Entry<TopicPartition, OffsetAndTimestamp> entry : parMap.entrySet()) { TopicPartition key = entry.getKey(); OffsetAndTimestamp value = entry.getValue(); if (key == null || value == null) continue; Long offset = value.offset(); System.out.println("partition-" + key.partition() + "|offset-" + offset); System.out.println(); //根据消费里的timestamp确定offset if (value != null) { consumer.assign(Arrays.asList(key)); consumer.seek(key, offset); } }*/ //**********************其他消费方式************************************************ //**********************异步提交offset************************************************ // 手动异步提交offset,当前线程提交offset不会阻塞,可以继续处理后面的程序逻辑 // consumer.commitAsync(new OffsetCommitCallback() { // @Override // public void onComplete(Map<TopicPartition, OffsetAndMetadata> offsets, Exception exception) { // if (exception != null) { // System.err.println("Commit failed for " + offsets); // System.err.println("Commit failed exception: " + exception.getStackTrace()); // } // } // }); //**********************异步提交offset************************************************ }

3.效果

消费者

六:springboot访问kafka

1.pom

springboot2.2.x 对应kafka2.3.x和2.4.x 版本

springboot2.3.x 对应kafka2.5.x 版本

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

<version>2.4.2.RELEASE</version>

</dependency>

2.producter

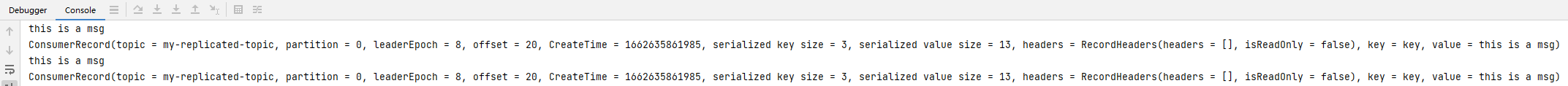

package com.jun.kafka.controller; import org.springframework.kafka.core.KafkaTemplate; import org.springframework.web.bind.annotation.RequestMapping; import org.springframework.web.bind.annotation.RestController; import javax.annotation.Resource; @RestController public class KafkaController { private final static String TOPIC_NAME = "my-replicated-topic"; @Resource private KafkaTemplate<String, String> kafkaTemplate; @RequestMapping("/send") public void send() { kafkaTemplate.send(TOPIC_NAME, "key", "this is a msg"); } }

3/consumer

package com.jun.kafka.mq; import org.apache.kafka.clients.consumer.ConsumerRecord; import org.springframework.kafka.annotation.KafkaListener; import org.springframework.kafka.support.Acknowledgment; import org.springframework.stereotype.Component; @Component public class KafkaConsumer { /** * @param record * @KafkaListener(groupId = "testGroup", topicPartitions = { * @TopicPartition(topic = "topic1", partitions = {"0", "1"}), * @TopicPartition(topic = "topic2", partitions = "0", * partitionOffsets = @PartitionOffset(partition = "1", initialOffset = "100")) * },concurrency = "6") * //concurrency就是同组下的消费者个数,就是并发消费数,必须小于等于分区总数 */ @KafkaListener(topics = "my-replicated-topic", groupId = "caoGroup") public void listenOneGroup(ConsumerRecord<String, String> record, Acknowledgment ack) { String value = record.value(); System.out.println(value); System.out.println(record); //手动提交offset ack.acknowledge(); } /** * 配置多个消费组 */ @KafkaListener(topics = "my-replicated-topic", groupId = "junGroup") public void listenTwoGroup(ConsumerRecord<String, String> record, Acknowledgment ack) { String value = record.value(); System.out.println(value); System.out.println(record); ack.acknowledge(); } }

4.配置文件

server: port: 8090 spring: kafka: bootstrap-servers: 192.168.12.131:9092,192.168.12.131:9093,192.168.12.131:9094 producer: # 生产者 retries: 3 # 设置大于0的值,则客户端会将发送失败的记录重新发送 batch-size: 16384 buffer-memory: 33554432 acks: 1 # 指定消息key和消息体的编解码方式 key-serializer: org.apache.kafka.common.serialization.StringSerializer value-serializer: org.apache.kafka.common.serialization.StringSerializer consumer: group-id: default-group enable-auto-commit: false auto-offset-reset: latest key-deserializer: org.apache.kafka.common.serialization.StringDeserializer value-deserializer: org.apache.kafka.common.serialization.StringDeserializer listener: # 当每一条记录被消费者监听器(ListenerConsumer)处理之后提交 # RECORD # 当每一批poll()的数据被消费者监听器(ListenerConsumer)处理之后提交 # BATCH # 当每一批poll()的数据被消费者监听器(ListenerConsumer)处理之后,距离上次提交时间大于TIME时提交 # TIME # 当每一批poll()的数据被消费者监听器(ListenerConsumer)处理之后,被处理record数量大于等于COUNT时提交 # COUNT # TIME | COUNT 有一个条件满足时提交 # COUNT_TIME # 当每一批poll()的数据被消费者监听器(ListenerConsumer)处理之后, 手动调用Acknowledgment.acknowledge()后提交 # MANUAL # 手动调用Acknowledgment.acknowledge()后立即提交,一般使用这种 # MANUAL_IMMEDIATE ack-mode: manual_immediate

5.运行效果

posted on

posted on

浙公网安备 33010602011771号

浙公网安备 33010602011771号