基于apache —HttpClient的小爬虫获取网页内容

今天(17-03-31)忙了一下午研究webmagic,发现自己还太年轻,对于这样难度的框架(类库)

还是难以接受,还是从基础开始吧,因为相对基础的东西教程相多一些,于是乎我找了apache其下的

HttpClient,根据前辈们发的教程自己也简单写了一下,感觉还好。

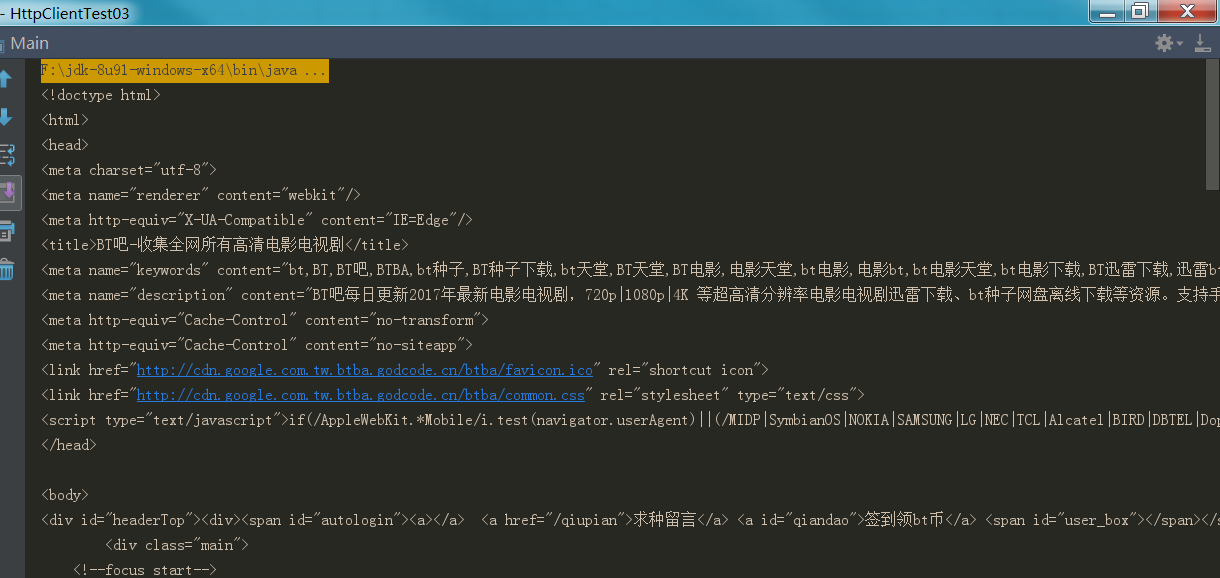

下面实现的是单个页面的获取:

import org.apache.http.HttpEntity; import org.apache.http.HttpResponse; import org.apache.http.client.HttpClient; import org.apache.http.client.methods.HttpGet; import org.apache.http.impl.client.HttpClients; import org.apache.http.util.EntityUtils; import java.io.IOException; public class Main { public static void main(String[] args) throws IOException{ try { //创建client实例 HttpClient client= HttpClients.createDefault(); //创建httpget实例 HttpGet httpGet=new HttpGet("http://www.btba.com.cn"); //执行 get请求 HttpResponse response=client.execute(httpGet); //返回获取实体 HttpEntity entity=response.getEntity(); //获取网页内容,指定编码 String web= EntityUtils.toString(entity,"UTF-8"); //输出网页 System.out.println(web); } catch (IOException e) { e.printStackTrace(); } } }

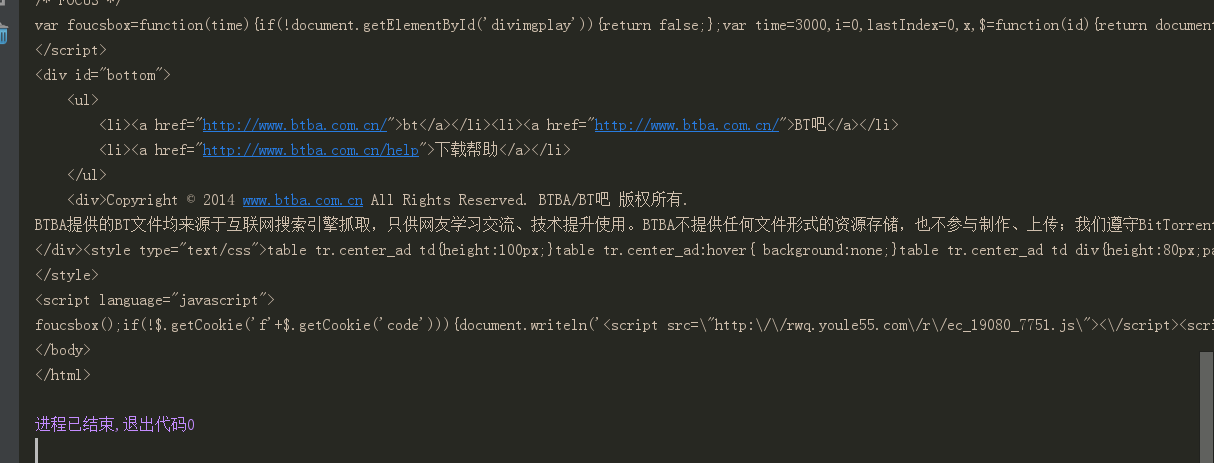

部分截图展示:

下面提供了HttpClient的下载: http://hc.apache.org/downloads.cgi

webmagic基于HttpClient、Jsoup 所以,现将这两个学会了、学懂了在去尝试啃webmagic吧

下一篇讲Jsoup对于本篇下载网页的简单解析处理。。。

本人还是小白一只,以上有什么不足或者不对之处请指出,非常感谢个位。