pytorch中的torch.autograd.backward()和torch.autograd.grad()

参考

torch.autograd学习系列之torch.autograd.grad()函数学习

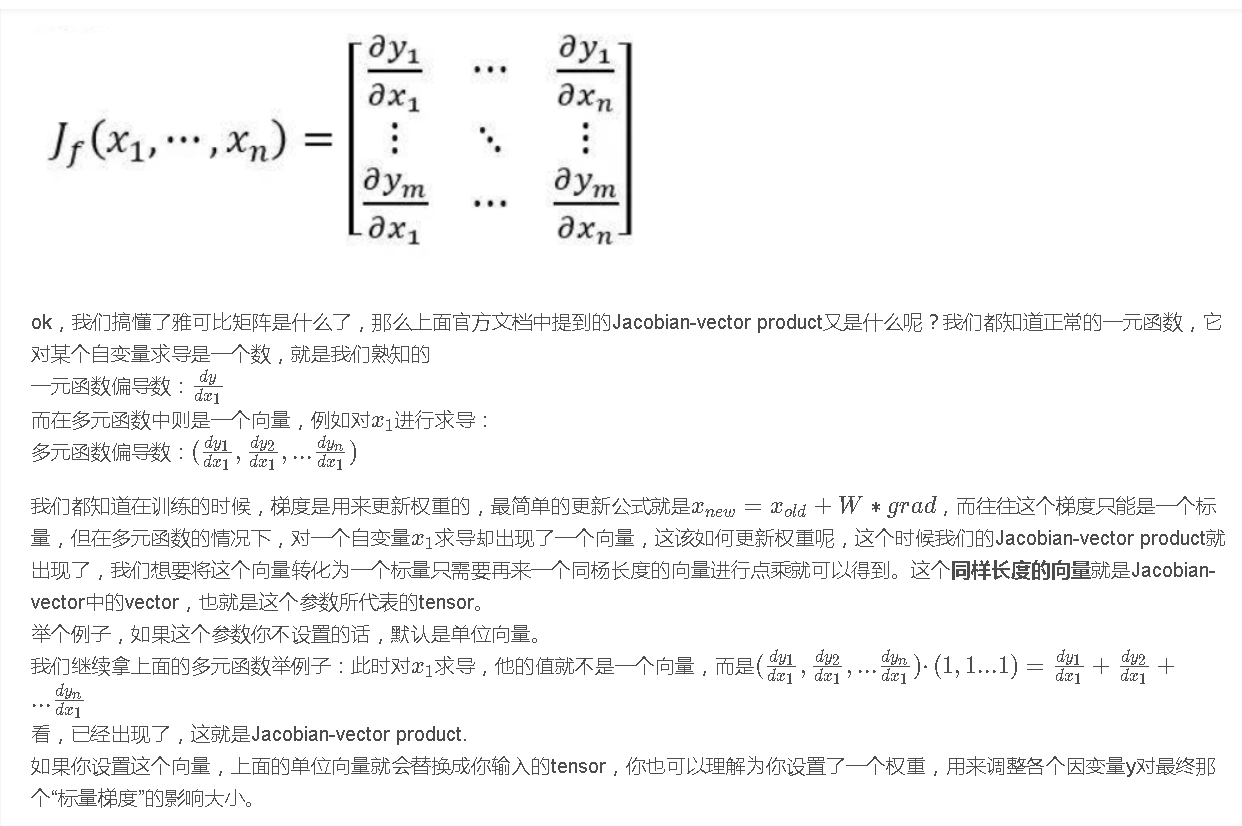

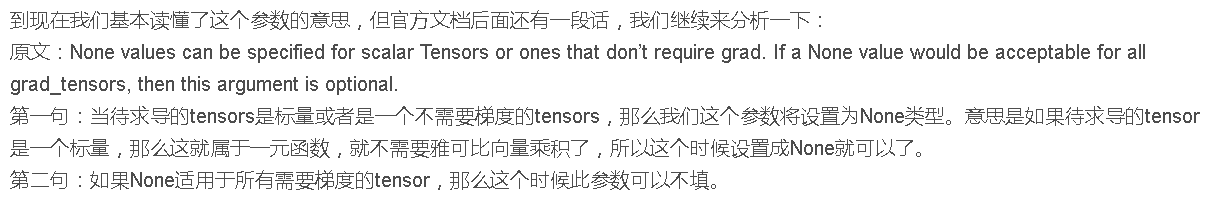

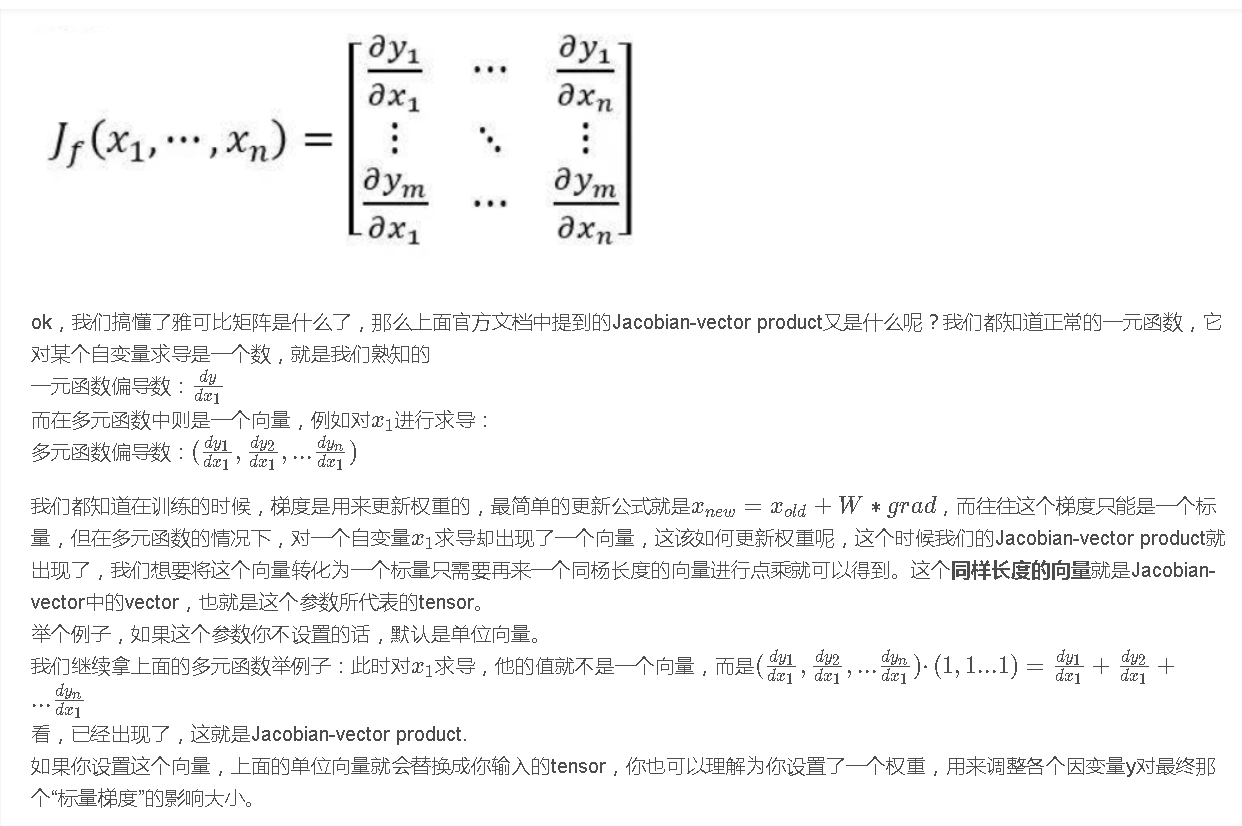

主要是对这两个函数中的参数grad_tensors或grad_outputs不理解。其实就是雅克比矢量积的系数,有了这个系数就能将矢量梯度转变为一个标量。

这个系数一般设置为1,意思是直接把矢量梯度求和。

快去成为你想要的样子!

参考

主要是对这两个函数中的参数grad_tensors或grad_outputs不理解。其实就是雅克比矢量积的系数,有了这个系数就能将矢量梯度转变为一个标量。

这个系数一般设置为1,意思是直接把矢量梯度求和。