Word2vec学习

什么是Word2vec?为什么要有这么一个东西?

word2vec是 word embedding 的方式之一, 属于NLP领域。他是将词转化为「可计算」「结构化」的向量的过程。

Word2vec的两种训练方式

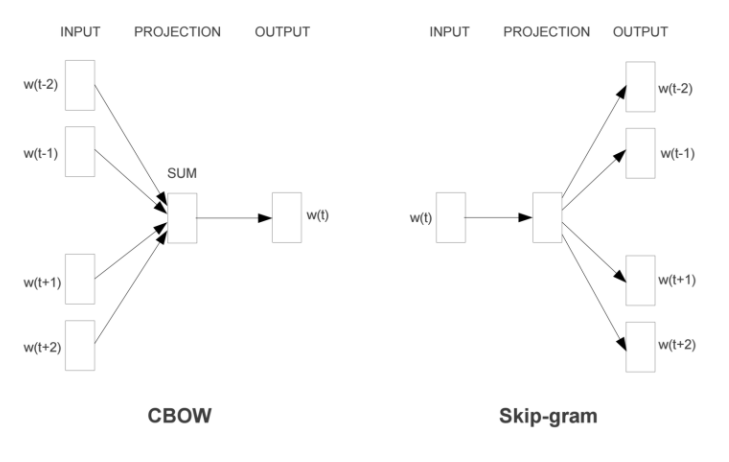

CBOW(Continuous Bag-of-Words Model)和Skip-gram (Continuous Skip-gram Model),是Word2vec 的两种训练模式。

CBOW

通过上下文(Context)来预测当前值,相当于一句话里抠掉一个词,让你来猜这个词是什么意思(类似小学填空题)。

eg:我 _____ 大便,(“我”和“大便”都是输入(input),_____为我们预测要输出的内容(output))

Skip-gram

用当前词来预测上下文。相当于给你一个词(input word),让你猜前面和后面可能出现什么词。(大概感觉就是和CBOW反过来)

eg:___ 拉 _____

类似的数学模型:

浙公网安备 33010602011771号

浙公网安备 33010602011771号