[paddlepaddle] ST-GCN

Background

本案例通过选择ST-GCN来完成对花样滑冰中动作姿态的识别任务 该模型由香港中文大学-商汤科技联合实验室在AAAI 2018 录用论文「Spatial Temporal Graph Convolutional Networks for Skeleton Based Action Recognition」中提出,不仅为解决基于人体骨架关键点的人类动作识别问题提供了新颖的思路,在标准的动作识别数据集上也取得了较大的性能提升。

“时空图”卷积网络模型

ST-GCN通过将图卷积网络(GCN)和时间卷积网络(TCN)结合起来,扩展到时空图模型,设计出了用于行为识别的骨骼点序列通用表示,该模型将人体骨骼表示为图的数据结构,如下图所示,其中图的每个节点对应于人体的一个关节点。

图中存在两种类型的边,即符合关节的自然连接的空间边(spatial edge)和在连续的时间步骤中连接相同关节的时间边(temporal edge)。在此基础上构建多层的时空图卷积,它允许信息沿着空间和时间两个维度进行整合。

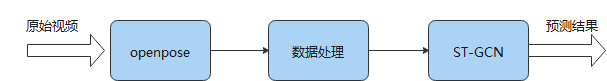

要完成通过ST-GCN识别动作类别,首先要将原始视频数据通过openpose转化为骨骼点数据。完整流程为下图所示步骤。

SKELETON-BASED ACTION RECOGNITION MODELS

Ref: https://github.com/open-mmlab/mmaction2/tree/master/configs/skeleton

这里主推了三个模型:2s-agcn, posec3d, stgcn

However, mmaction暂时在inference没有优化!

浙公网安备 33010602011771号

浙公网安备 33010602011771号