到2030年,你还能靠什么工作?唯一无法被AI取代的技能揭秘!

Dario Amodei(Anthropic 首席执行官)最近与 Lex Fridman 进行了播客。

Anthropic 是 Claude 背后的公司,Claude 是目前领先且最有效的商业大语言模型之一。

他谈到了几个话题,但今天我们将重点讨论一个——AI的未来会是什么样子?

我们将首先探讨我们是如何走到当前大语言模型(LLM)这一阶段的。接下来,我们将讨论 Amodei 对未来几年世界发展的预测。

最后,我们将揭示为什么机械解释性将成为未来最重要的领域,探讨它是什么以及为什么如此重要。

当前大语言模型的状态

AI在过去几年中进展迅速。一切始于“Attention is all you need”这篇论文,它向世界介绍了transformers,从而让我们能够创造出比以往任何东西都强大的模型。

导致我们进入当前ChatGPT时代的一个重要发现是“扩展假设”。

扩展假设认为,transformer架构越大,模型对数据的泛化能力越强。

简单来说,“模型越大,AI就越聪明,越像人类”。

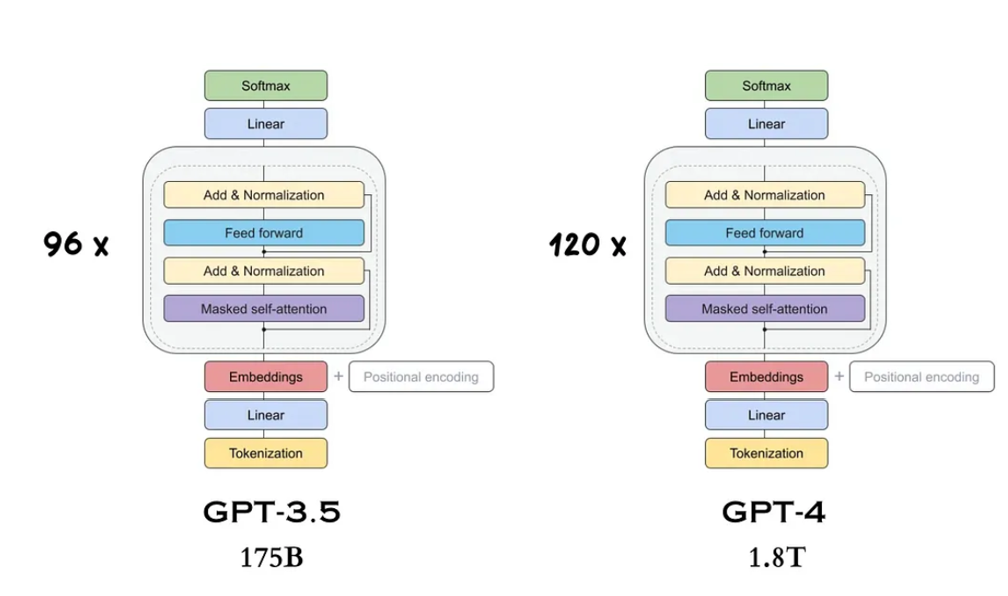

GPT-3.5和GPT-4模型的规模分别为1750亿和1.8万亿参数。随着我们扩展模型、增加更多层并提供更多训练数据,模型会变得更聪明。

Amodei在OpenAI工作时提倡了扩展假设,而这比ChatGPT席卷全球还要早。那时几乎是一个“秘密”——在他们之前,没有其他AI公司利用这个假设。训练大型模型需要花费数千万美元,但在Amodei的倡导下,OpenAI花费了这笔钱,训练了一个1750亿参数的大型模型,最终成了GPT-3。

其他AI公司很快跟随其后,看到了开发自己模型的潜力。这些公司包括像Meta(Llama)、Google(Gemma、Gemini)这样的巨头,以及像Mistral这样的小型公司。

AI的未来

未来的AI会是什么样子?

目前,大多数专家一致认为,我们很快就能实现通用人工智能(AGI)——大多数人认为,我们很快将拥有能够独立思考并执行任务的AI系统,完全不需要人类参与。

以下是Amodei的预测:

好的一面

• 由于AI研究人员的贡献,研究将进展得非常迅速,生物研究也将加速,最终我们将在未来100年内完全消除疾病。

• AI将能够处理相对开放的任务,持续数天或数周,直到解决任务,就像现在公司给员工安排任务一样。这与当前的LLM不同,后者只会立即回答用户提出的封闭式任务。

• 一些工作,如软件工程,将变得极其高效,全球各地的AI软件工程师将加速这一进程。

• 多个AI实例的副本也可以像人类一样协作,创造多维度的项目,而无需任何人工干预。

想象一下未来的情景:AI系统控制的机器人手臂自动在实验室进行研究。

一旦我们达到AI能够进行独立研究的阶段,我们就能在5到10年内实现1000年的进步。据Amodei预测,这将最终导致“技术奇点”——即技术增长变得无法控制且不可逆转的未来时刻。

不利的一面

• AI系统将变得极其强大,这意味着它们不仅能为世界带来巨大的好处,也能造成无法估量的伤害。

人类是(目前)地球上最智能的生物。虽然我们身体上不如大猩猩强壮,可能在一场肉搏战中会输,但使我们能够主宰这个世界并打败所有其他动物的,是我们的智慧。 如果创造出一种比人类更智能的存在,它“可能”会导致人类的灭绝。这就是为什么确保AI的目标与人类的目标一致非常重要。 如果我们继续让我们的AI系统越来越强大,而不确保它们的目标与人类一致,可能会发生全球灾难。

AI故意策划制造对人类有害的生物危害

因此,机械解释性将在未来几年变得越来越重要。

机械解释性

机械解释性的核心理念是打开AI系统(例如LLM)的“黑箱”,以理解它们为什么会表现出某种行为。目前,LLM是一个黑箱,我们让它们变得越来越强大,但我们没有真正的方式来预测或理解它们为何如此有效。

机械解释性最初起源于Amodei意识到需要进行AI安全研究,以造福全人类。虽然AI具有极大的潜力为人类带来好处,但它也可能带来巨大的伤害。如果我们能够最大程度地控制这种伤害,就能确保AI系统对我们产生的净收益是正面的。

机械解释性试图回答两个问题:

-

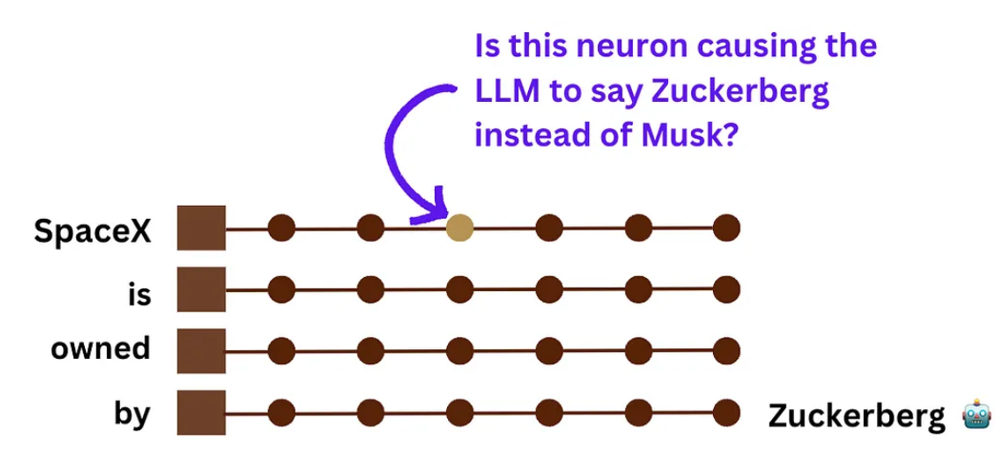

我们能否识别LLM内部计算与其行为之间的因果关系?例如:LLM是不是因为某个特定的神经元在内部状态中添加了某个数字而“撒谎”?

-

我们能否通过修改这些内部计算来改变它的行为?例如:我们能否从LLM的内部状态中减去某个数字,以便使其行为更符合我们的预期?

举个机械解释性问题的例子:transformer架构中的某个神经元是否负责输出“Zuckerberg”,因此改变这个神经元是否能帮助我们输出“Elon Musk”?

为什么机械解释性将成为2030年最重要的领域

Amodei表示,未来几年AI将迎来巨大的增长,届时将出现一种能够在多种任务上表现出色的AI。

随着技术在未来几年进步的速度,当前的工作可能最终会被完全自动化,而一套全新的工作会填补这个空缺。

到了2030年,Amodei提到,AI将达到一个阶段,如果不加以控制,可能会对世界产生灾难性后果。

因此,控制AI将成为全球的首要任务,不仅要最大化AI的好处,还要尽量减少它可能带来的负面影响。

这就是机械解释性发挥作用的地方。

目前,一些公司已经成立了自己的解释性团队,并且会随着AI风险变得更加明显而继续扩大这些团队的规模。这些团队的任务是保护人类免受AI潜在风险的威胁,同时确保AI能最大化地造福人类。

这就是为什么机械解释性将在未来几年成为一个极其重要的领域。

这个领域有多个子领域,目前正探索许多不同的研究方法。如果你想了解机械解释性的具体内容,一些相关博客可能会引起你的兴趣。