机器学习(ML)十之CNN

CNN-二维卷积层

卷积神经网络(convolutional neural network)是含有卷积层(convolutional layer)的神经网络。卷积神经网络均使用最常见的二维卷积层。它有高和宽两个空间维度,常用来处理图像数据。

二维互相关运算

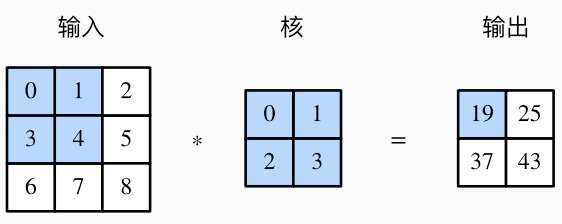

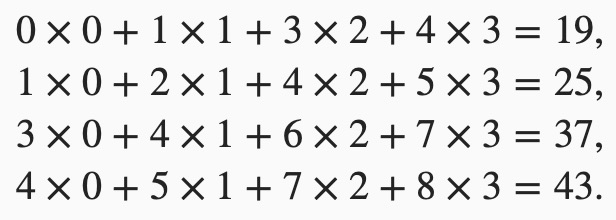

虽然卷积层得名于卷积(convolution)运算,但我们通常在卷积层中使用更加直观的互相关(cross-correlation)运算。在二维卷积层中,一个二维输入数组和一个二维核(kernel)数组通过互相关运算输出一个二维数组。 我们用一个具体例子来解释二维互相关运算的含义。如图5.1所示,输入是一个高和宽均为3的二维数组。我们将该数组的形状记为3*3或(3,3)。核数组的高和宽分别为2。该数组在卷积计算中又称卷积核或过滤器(filter)。卷积核窗口(又称卷积窗口)的形状取决于卷积核的高和宽,即2*2。下图的阴影部分为第一个输出元素及其计算所使用的输入和核数组元素:0*0+1*1+3*2+4*3 = 19。

在二维互相关运算中,卷积窗口从输入数组的最左上方开始,按从左往右、从上往下的顺序,依次在输入数组上滑动。当卷积窗口滑动到某一位置时,窗口中的输入子数组与核数组按元素相乘并求和,得到输出数组中相应位置的元素。上图中的输出数组高和宽分别为2,其中的4个元素由二维互相关运算得出:

二维卷积层

二维卷积层将输入和卷积核做互相关运算,并加上一个标量偏差来得到输出。卷积层的模型参数包括了卷积核和标量偏差。在训练模型的时候,通常我们先对卷积核随机初始化,然后不断迭代卷积核和偏差。

互相关运算和卷积运算

实际上,卷积运算与互相关运算类似。为了得到卷积运算的输出,我们只需将核数组左右翻转并上下翻转,再与输入数组做互相关运算。可见,卷积运算和互相关运算虽然类似,但如果它们使用相同的核数组,对于同一个输入,输出往往并不相同。

那么,卷积层为何能使用互相关运算替代卷积运算。其实,在深度学习中核数组都是学出来的:卷积层无论使用互相关运算或卷积运算都不影响模型预测时的输出。为了解释这一点,假设卷积层使用互相关运算学出上图中的核数组。设其他条件不变,使用卷积运算学出的核数组即上图中的核数组按上下、左右翻转。也就是说,上图中的输入与学出的已翻转的核数组再做卷积运算时,依然得到上图中的输出。为了与大多数深度学习文献一致,如无特别说明,本书中提到的卷积运算均指互相关运算。

特征图和感受野

维卷积层输出的二维数组可以看作是输入在空间维度(宽和高)上某一级的表征,也叫特征图(feature map)。影响元素x的前向计算的所有可能输入区域(可能大于输入的实际尺寸)叫做x的感受野(receptive field)。以上图为例,输入中阴影部分的四个元素是输出中阴影部分元素的感受野。我们将上图中形状为2×2的输出记为Y,并考虑一个更深的卷积神经网络:将Y与另一个形状为2×2的核数组做互相关运算,输出单个元素z。那么,z在Y上的感受野包括Y的全部四个元素,在输入上的感受野包括其中全部9个元素。可见,我们可以通过更深的卷积神经网络使特征图中单个元素的感受野变得更加广阔,从而捕捉输入上更大尺寸的特征。

我们常使用“元素”一词来描述数组或矩阵中的成员。在神经网络的术语中,这些元素也可称为“单元”。当含义明确时,本书不对这两个术语做严格区分。

- 二维卷积层的核心计算是二维互相关运算。在最简单的形式下,它对二维输入数据和卷积核做互相关运算然后加上偏差。

- 我们可以设计卷积核来检测图像中的边缘。

- 我们可以通过数据来学习卷积核。

填充和步幅

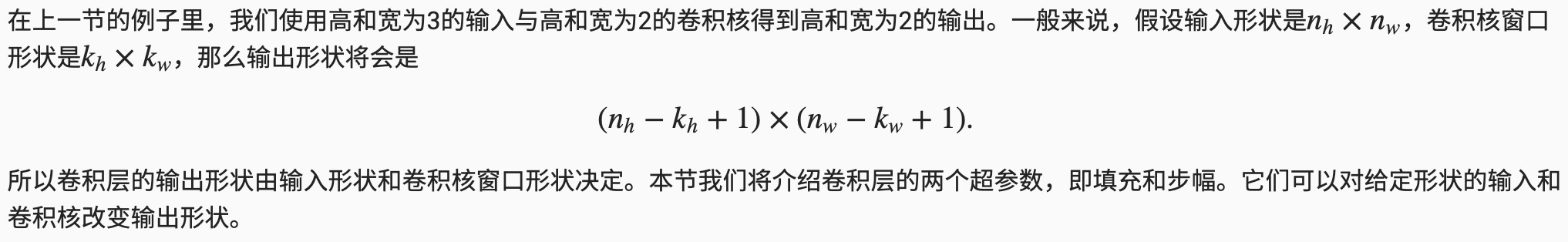

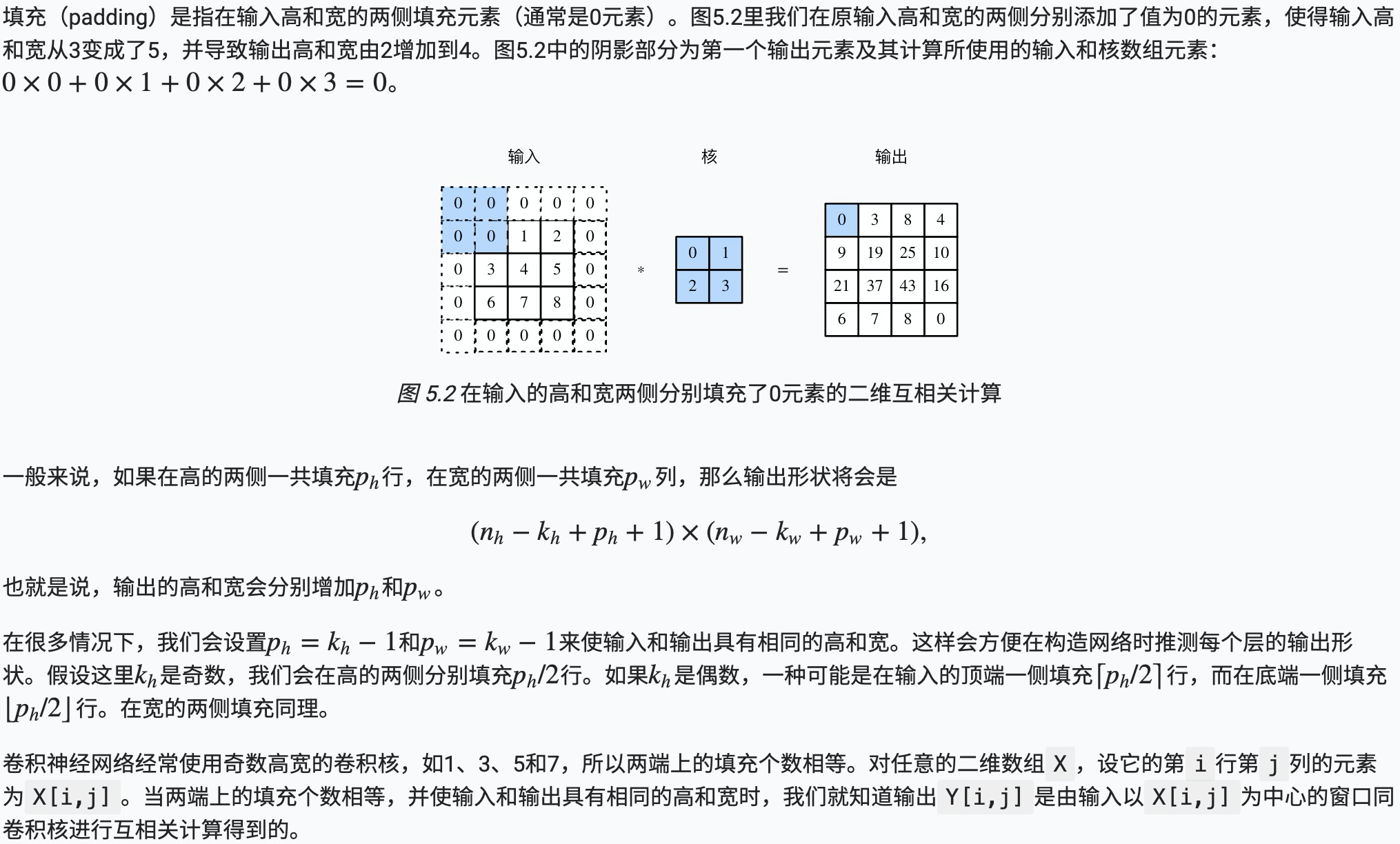

填充

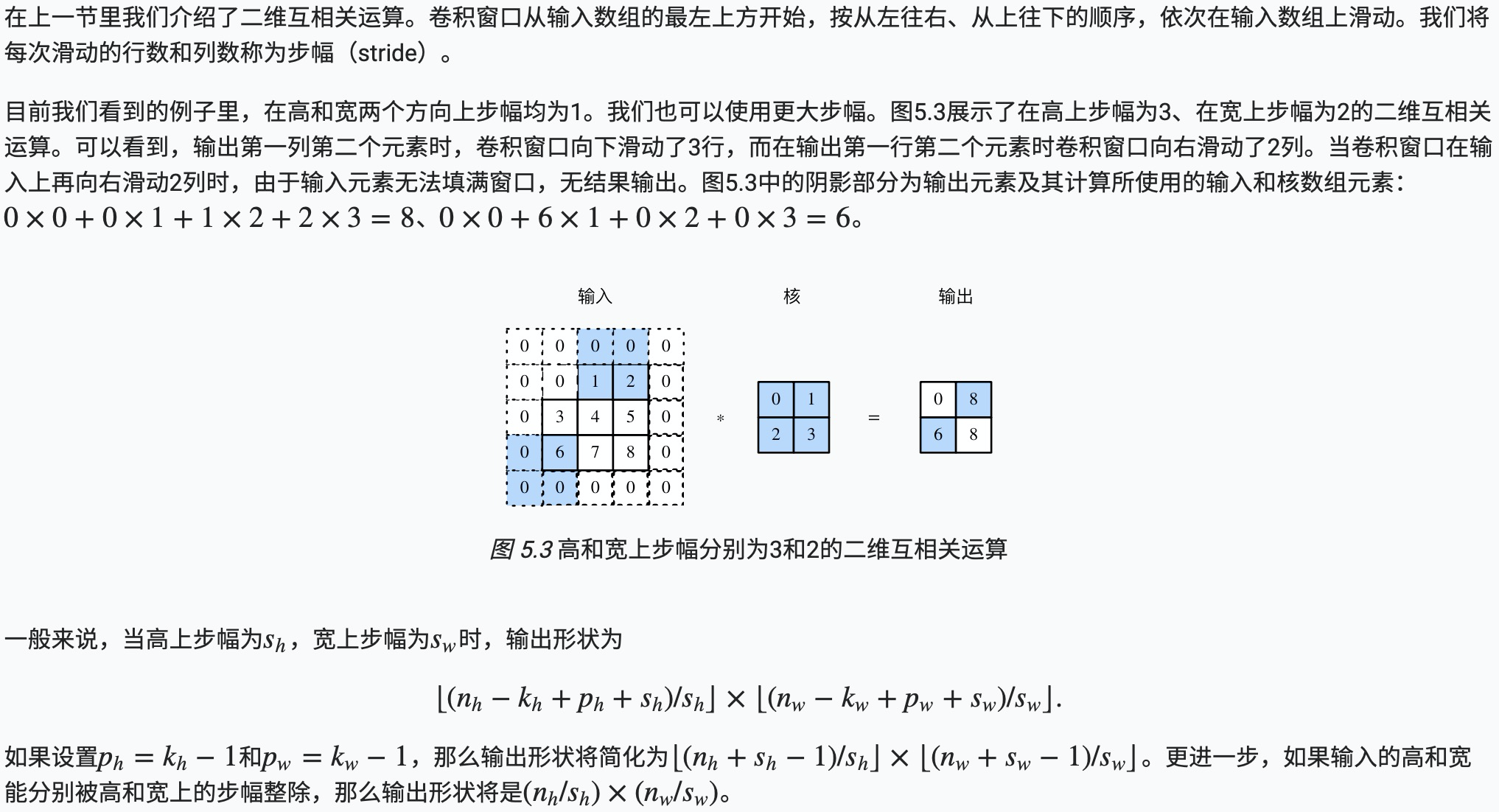

步幅

- 填充可以增加输出的高和宽。这常用来使输出与输入具有相同的高和宽。

- 步幅可以减小输出的高和宽,例如输出的高和宽仅为输入的高和宽的1/n(n为大于1的整数)。

多输入通道和多输出通道

前面我们用到的输入和输出都是二维数组,但真实数据的维度经常更高。例如,彩色图像在高和宽2个维度外还有RGB(红、绿、蓝)3个颜色通道。假设彩色图像的高和宽分别是h和w(像素),那么它可以表示为一个3×h×w的多维数组。我们将大小为3的这一维称为通道(channel)维。本节介绍含多个输入通道或多个输出通道的卷积核。

多输入通道

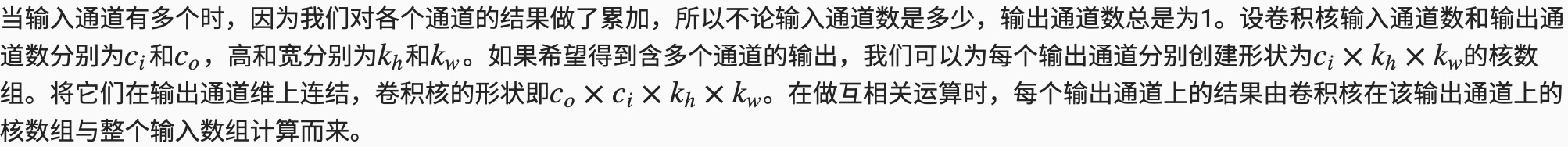

多输出通道

1×1卷积层

- 使用多通道可以拓展卷积层的模型参数。

- 假设将通道维当作特征维,将高和宽维度上的元素当成数据样本,那么1×11×1卷积层的作用与全连接层等价。

- 1×11×1卷积层通常用来调整网络层之间的通道数,并控制模型复杂度。

池化层

构造卷积核从而精确地找到了像素变化的位置。设任意二维数组X的i行j列的元素为X[i, j]。如果我们构造的卷积核输出Y[i, j]=1,那么说明输入中X[i, j]和X[i, j+1]数值不一样。这可能意味着物体边缘通过这两个元素之间。但实际图像里,我们感兴趣的物体不会总出现在固定位置:即使我们连续拍摄同一个物体也极有可能出现像素位置上的偏移。这会导致同一个边缘对应的输出可能出现在卷积输出Y中的不同位置,进而对后面的模式识别造成不便。

在本节中介绍池化(pooling)层,它的提出是为了缓解卷积层对位置的过度敏感性。

二维最大池化层和平均池化层

填充和步幅

同卷积层一样,池化层也可以在输入的高和宽两侧的填充并调整窗口的移动步幅来改变输出形状。池化层填充和步幅与卷积层填充和步幅的工作机制一样。

多通道

在处理多通道输入数据时,池化层对每个输入通道分别池化,而不是像卷积层那样将各通道的输入按通道相加。这意味着池化层的输出通道数与输入通道数相等。

- 最大池化和平均池化分别取池化窗口中输入元素的最大值和平均值作为输出。

- 池化层的一个主要作用是缓解卷积层对位置的过度敏感性。

- 可以指定池化层的填充和步幅。

- 池化层的输出通道数跟输入通道数相同。

卷积神经网络(LeNet)

对Fashion-MNIST数据集中的图像进行分类。每张图像高和宽均是28像素。我们将图像中的像素逐行展开,得到长度为784的向量,并输入进全连接层中。然而,这种分类方法有一定的局限性。

- 图像在同一列邻近的像素在这个向量中可能相距较远。它们构成的模式可能难以被模型识别。

- 对于大尺寸的输入图像,使用全连接层容易导致模型过大。假设输入是高和宽均为1,000像素的彩色照片(含3个通道)。即使全连接层输出个数仍是256,该层权重参数的形状也是3,000,000×256:它占用了大约3GB的内存或显存。这会带来过于复杂的模型和过高的存储开销。

卷积层尝试解决这两个问题。一方面,卷积层保留输入形状,使图像的像素在高和宽两个方向上的相关性均可能被有效识别;另一方面,卷积层通过滑动窗口将同一卷积核与不同位置的输入重复计算,从而避免参数尺寸过大。

卷积神经网络就是含卷积层的网络。本节里我们将介绍一个早期用来识别手写数字图像的卷积神经网络:LeNet。这个名字来源于LeNet论文的第一作者Yann LeCun。LeNet展示了通过梯度下降训练卷积神经网络可以达到手写数字识别在当时最先进的结果。这个奠基性的工作第一次将卷积神经网络推上舞台,为世人所知。

LeNet模型

eNet分为卷积层块和全连接层块两个部分。下面我们分别介绍这两个模块。

卷积层块里的基本单位是卷积层后接最大池化层:卷积层用来识别图像里的空间模式,如线条和物体局部,之后的最大池化层则用来降低卷积层对位置的敏感性。卷积层块由两个这样的基本单位重复堆叠构成。在卷积层块中,每个卷积层都使用5×5的窗口,并在输出上使用sigmoid激活函数。第一个卷积层输出通道数为6,第二个卷积层输出通道数则增加到16。这是因为第二个卷积层比第一个卷积层的输入的高和宽要小,所以增加输出通道使两个卷积层的参数尺寸类似。卷积层块的两个最大池化层的窗口形状均为2×2,且步幅为2。由于池化窗口与步幅形状相同,池化窗口在输入上每次滑动所覆盖的区域互不重叠。

卷积层块的输出形状为(批量大小, 通道, 高, 宽)。当卷积层块的输出传入全连接层块时,全连接层块会将小批量中每个样本变平(flatten)。也就是说,全连接层的输入形状将变成二维,其中第一维是小批量中的样本,第二维是每个样本变平后的向量表示,且向量长度为通道、高和宽的乘积。全连接层块含3个全连接层。它们的输出个数分别是120、84和10,其中10为输出的类别个数。

- 卷积神经网络就是含卷积层的网络。

- LeNet交替使用卷积层和最大池化层后接全连接层来进行图像分类。

LeNet模型代码实现

1 #Lenet模型实现 2 import d2lzh as d2l 3 import mxnet as mx 4 from mxnet import autograd, gluon, init, nd 5 from mxnet.gluon import loss as gloss, nn 6 import time 7 8 net = nn.Sequential() 9 net.add(nn.Conv2D(channels=6, kernel_size=5, activation='sigmoid'), 10 nn.MaxPool2D(pool_size=2, strides=2), 11 nn.Conv2D(channels=16, kernel_size=5, activation='sigmoid'), 12 nn.MaxPool2D(pool_size=2, strides=2), 13 # Dense会默认将(批量大小, 通道, 高, 宽)形状的输入转换成 14 # (批量大小, 通道 * 高 * 宽)形状的输入 15 nn.Dense(120, activation='sigmoid'), 16 nn.Dense(84, activation='sigmoid'), 17 nn.Dense(10)) 18 19 20 # In[11]: 21 22 23 #构造一个高和宽均为28的单通道数据样本,并逐层进行前向计算来查看每个层的输出形状。 24 X = nd.random.uniform(shape=(1, 1, 28, 28)) 25 net.initialize() 26 for layer in net: 27 X = layer(X) 28 print(layer.name, 'output shape:\t', X.shape) 29 30 31 # In[12]: 32 33 34 batch_size = 256 35 train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size=batch_size) 36 37 38 # In[13]: