Tensorflow实战二:彩色图片分类

Tensorflow第T2周:彩色图片分类

👉 要求:

- 学习如何编写一个完整的深度学习程序

- 了解分类彩色图片会灰度图片有什么区别

- 测试集accuracy到达72%

🚀 我的环境:

语言环境:Python3.11.9

编译器:jupyter notebook

深度学习环境:TensorFlow2.17.0

一、前期工作

1. 设置GPU

如果使用的是CPU可以忽略这步

import tensorflow as tf

gpus = tf.config.list_physical_devices("GPU")

if gpus:

gpu0 = gpus[0] #如果有多个GPU,仅使用第0个GPU

tf.config.experimental.set_memory_growth(gpu0, True) #设置GPU显存用量按需使用

tf.config.set_visible_devices([gpu0],"GPU")

2. 导入数据

import tensorflow as tf

from tensorflow.keras import datasets, layers, models

import matplotlib.pyplot as plt

(train_images, train_labels), (test_images, test_labels) = datasets.cifar10.load_data()

3. 归一化

# 将像素的值标准化至0到1的区间内。

train_images, test_images = train_images / 255.0, test_images / 255.0

train_images.shape,test_images.shape,train_labels.shape,test_labels.shape

👉 代码输出

((50000, 32, 32, 3), (10000, 32, 32, 3), (50000, 1), (10000, 1))

4. 可视化

class_names = ['airplane', 'automobile', 'bird', 'cat', 'deer','dog', 'frog', 'horse', 'ship', 'truck']

plt.figure(figsize=(20,10))

for i in range(20):

plt.subplot(5,10,i+1)

plt.xticks([])

plt.yticks([])

plt.grid(False)

plt.imshow(train_images[i], cmap=plt.cm.binary)

plt.xlabel(class_names[train_labels[i][0]])

plt.show()

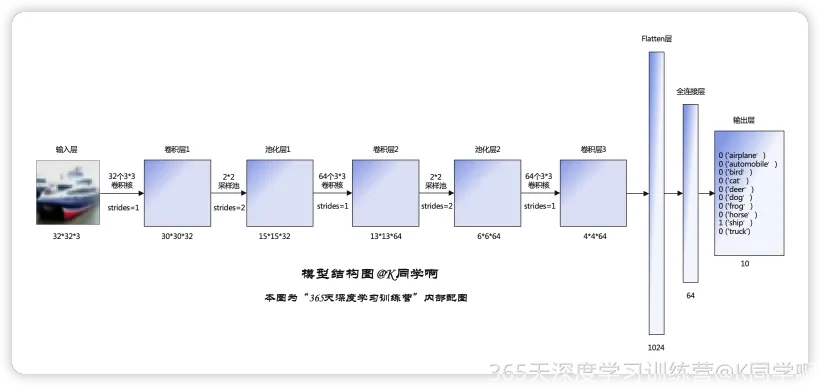

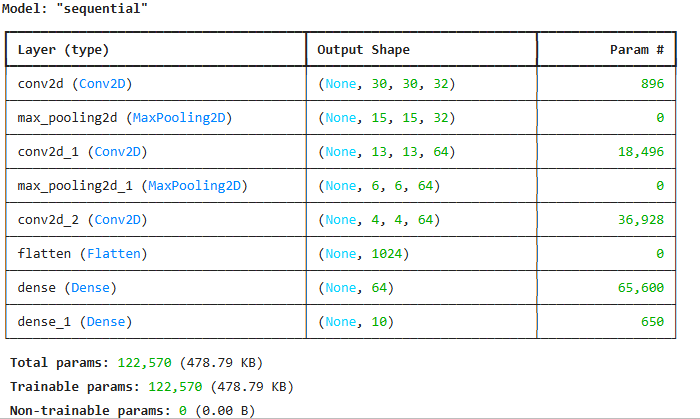

二、构建CNN网络

⭐关于卷积层:可参考【加速器节选】部分

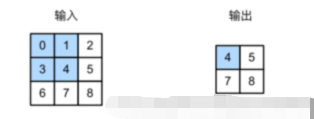

⭐池化层

池化层对提取到的特征信息进行降维,一方面使特征图变小,简化网络计算复杂度;另一方面进行特征压缩,提取主要特征,增加平移不变性,减少过拟合风险。但其实池化更多程度上是一种计算性能的一个妥协,强硬地压缩特征的同时也损失了一部分信息,所以现在的网络比较少用池化层或者使用优化后的如SoftPool。

池化层包括最大池化层(MaxPooling)和平均池化层(AveragePooling),均值池化对背景保留更好,最大池化对纹理提取更好)。同卷积计算,池化层计算窗口内的平均值或者最大值。例如通过一个 2*2 的最大池化层,其计算方式如下:

我们即将构建模型的结构图,我以分别二维和三维的形式展示出来方便大家理解。

- 立体结构图(可单击放大查看)

.png)

# 原网络

# model = models.Sequential([

# layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)), #卷积层1,卷积核3*3

# layers.MaxPooling2D((2, 2)), #池化层1,2*2采样

# layers.Conv2D(64, (3, 3), activation='relu'), #卷积层2,卷积核3*3

# layers.MaxPooling2D((2, 2)), #池化层2,2*2采样

# layers.Conv2D(64, (3, 3), activation='relu'), #卷积层3,卷积核3*3

# layers.Flatten(), #Flatten层,连接卷积层与全连接层

# layers.Dense(64, activation='relu'), #全连接层,特征进一步提取

# layers.Dense(10) #输出层,输出预期结果

# ])

# model.summary() # 打印网络结构

# 优化1:图像增强

# ①数据增强

from tensorflow.keras.preprocessing.image import ImageDataGenerator

datagen = ImageDataGenerator(

rotation_range=15,

width_shift_range=0.1,

height_shift_range=0.1,

horizontal_flip=True,

zoom_range=0.2,

fill_mode='nearest'

)

datagen.fit(train_images)

# 优化2:新网络

# ②构建新模型

model = models.Sequential([

layers.Conv2D(32, (3, 3), activation='relu', input_shape=(32, 32, 3)),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(64, (3, 3), activation='relu'),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

layers.Conv2D(128, (3, 3), activation='relu'),

layers.BatchNormalization(),

layers.MaxPooling2D((2, 2)),

layers.Flatten(),

layers.Dense(128, activation='relu'),

layers.Dense(10)

])

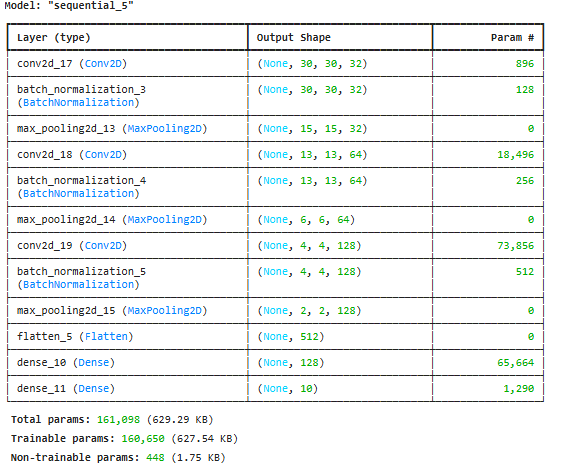

model.summary() # 打印网络结构

3. 模型编译

model.compile(optimizer='adam',

loss=tf.keras.losses.SparseCategoricalCrossentropy(from_logits=True),

metrics=['accuracy'])

四、训练模型

# history = model.fit(train_images, train_labels,

# epochs=10, validation_data=(test_images, test_labels))

# 优化后使用数据增强后的图

history = model.fit(datagen.flow(train_images, train_labels, batch_size=32),

epochs=10,

validation_data=(test_images, test_labels))

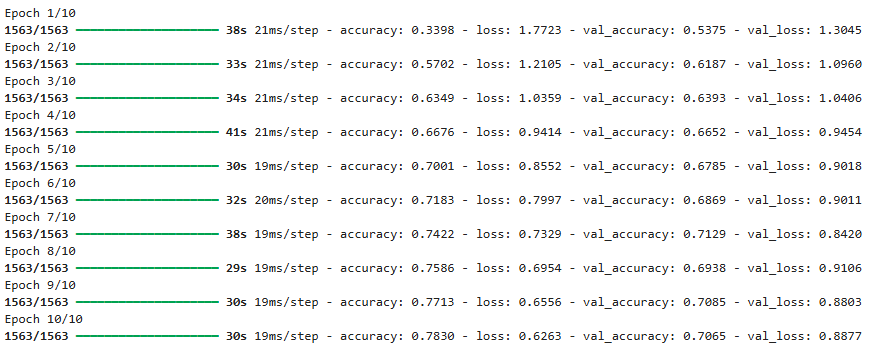

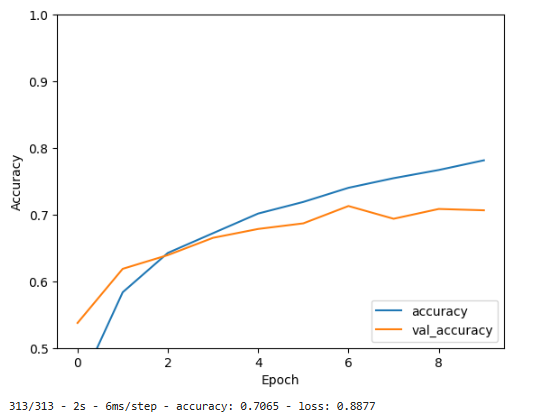

原模型训练结果:

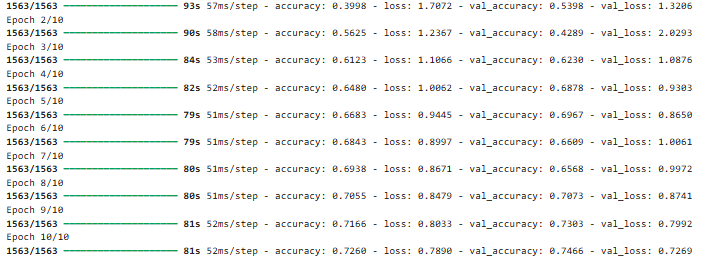

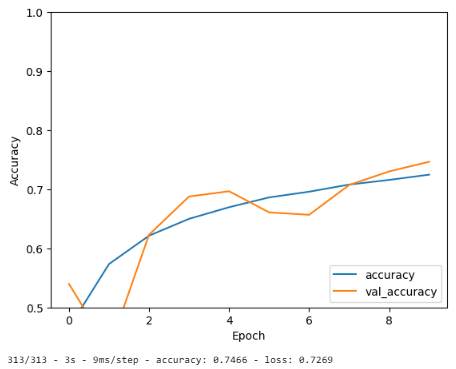

优化后模型训练结果:提升到72.6%

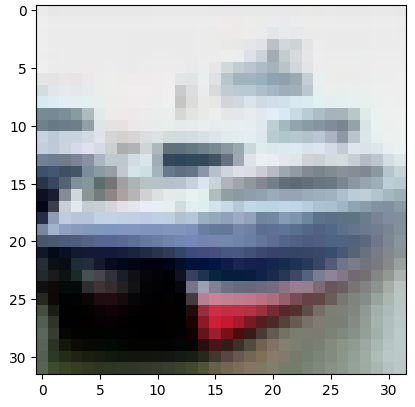

五、预测

通过模型进行预测得到的是每一个类别的概率,数字越大该图片为该类别的可能性越大

plt.imshow(test_images[1])

import numpy as np

pre = model.predict(test_images)

print(class_names[np.argmax(pre[1])])

👉 代码输出

ship

六、模型评估

import matplotlib.pyplot as plt

plt.plot(history.history['accuracy'], label='accuracy')

plt.plot(history.history['val_accuracy'], label = 'val_accuracy')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.ylim([0.5, 1])

plt.legend(loc='lower right')

plt.show()

test_loss, test_acc = model.evaluate(test_images, test_labels, verbose=2)

优化后:准确率:72.6%

总结:

在这个优化后的代码中,我们添加了数据增强来提高模型的泛化能力。同时,我们在每个卷积层后添加了Batch Normalization层来加速训练并提高模型稳定性。我们还增加了网络的深度,添加了更多的卷积层和神经元。

请注意,这些优化可能需要更多的计算资源和时间来训练模型。此外,每次更改后都应该在验证集上评估模型性能,以确保所做的更改实际上是提高了模型的泛化能力。

更多交流,请加微信:itzixueba.请备注好友来自博客园<虫吧>

浙公网安备 33010602011771号

浙公网安备 33010602011771号