Hadoop伪分布模式搭建

1、在独立模式的基础上添加ssh免密登录配置

2、配置Hadoop 中.xml文件

3、更改主机名设置host

伪分布模式。(伪分布模式:模拟集群,所有服务在一台机器上跑,模拟的是机器,因为是模拟:所以叫它伪分布式,区别:需要配置xml文件)

// 配置 文件 所在地方 /usr/local/hadoop/etc/hadoop

a)进入${HADOOP_HOME}/etc/hadoop目录

b)编辑core-site.xml

<?xml version="1.0"?>

<configuration>

<property>

#访问的主机

<name>fs.defaultFS</name>

<value>hdfs://localhost/</value>

</property>

</configuration>

c)编辑hdfs-site.xml

<?xml version="1.0"?>

<configuration>

<property>

#伪分布模式: 只有一个节点

<name>dfs.replication</name>

<value>1</value>

</property>

</configuration>

d)编辑mapred-site.xml

注意:cp mapred-site.xml.template mapred-site.xml

<?xml version="1.0"?>

<configuration>

<property>

<name>mapreduce.framework.name</name>

#框架名称是yarn

<value>yarn</value>

</property>

</configuration>

e)编辑yarn-site.xml

<?xml version="1.0"?>

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>localhost</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

</configuration>

伪分布模式的工作原理和完全分布式是一模一样的!所以需要配置ssh ,只不过他就一台机器

authorized_keys:自己创建的

f)配置SSH

1)检查是否安装了ssh相关软件包(openssh-server + openssh-clients + openssh)

$yum list installed | grep ssh

2)检查是否启动了sshd进程

$>ps -Af | grep sshd

3)在client侧生成公私秘钥对。

$>ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa

4)生成~/.ssh文件夹,里面有id_rsa(私钥) + id_rsa.pub(公钥)

5)追加公钥到~/.ssh/authorized_keys文件中(文件名、位置固定)

$>cd ~/.ssh

$>cat id_rsa.pub >> authorized_keys

6)修改authorized_keys的权限为644.

$>chmod 644 authorized_keys

7)测试

$>ssh localhost

配置hadoop,使用符号连接的方式,让三种配置形态共存。

----------------------------------------------------

1.创建三个配置目录,内容等同于hadoop目录

${hadoop_home}/etc/local

${hadoop_home}/etc/pesudo

${hadoop_home}/etc/full

2.创建符号连接

$>ln -s

3.对hdfs进行格式化(格式化只需要做一次格式化,本质生成namenode索引节点树)

$>hadoop namenode -format

4.修改hadoop配置文件,手动指定JAVA_HOME环境变量:因为它找不到java的地址

[${hadoop_home}/etc/hadoop/hadoop-env.sh]

...

export JAVA_HOME=/soft/jdk

...

5.启动hadoop的所有进程

$>start-all.sh

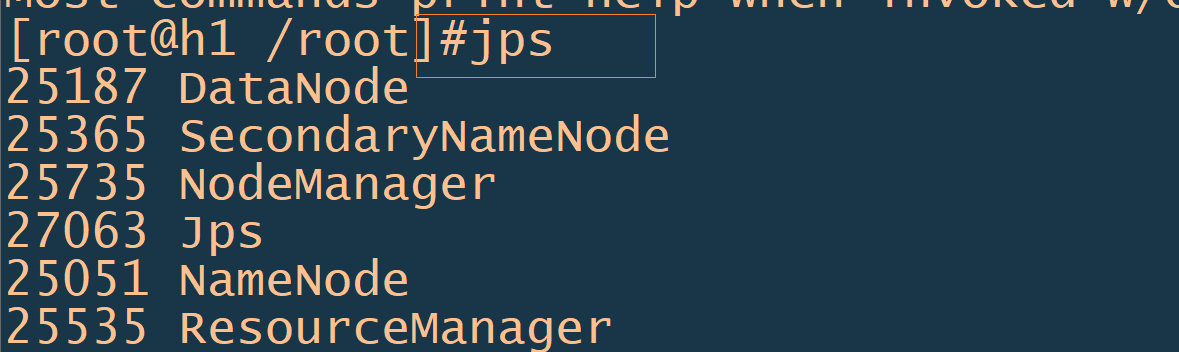

6.启动完成后,出现以下进程

$>jps

33702 NameNode

33792 DataNode

33954 SecondaryNameNode

29041 ResourceManager

34191 NodeManager

错误:没有出现 nameNOde 和dateNODE 可能是配置文件 .xml问题

7.查看hdfs文件系统

$>hdfs dfs -ls /

8.创建目录

$>hdfs dfs -mkdir -p /user/centos/hadoop

9.通过webui查看hadoop的文件系统

http://localhost:50070/

10.停止hadoop所有进程

$>stop-all.sh

作者:IT_BULL

出处:http://www.cnblogs.com/itBulls/

本文版权归作者和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文连接,否则保留追究法律责任的权利。

博客园-博客园。

浙公网安备 33010602011771号

浙公网安备 33010602011771号