深度学习资源(随时更新)

1.理论部分

主要参考高手刘建平的博客文章,他是写了一个系列,从感知机、深度学习、CNN、RNN、LSTM一路讲下来。

2.实现、应用部分

ILSVRC-2014 (ImageNet competition)競賽中獲的第一名的VGG (Visual Geometry Group, University of Oxford)網絡結構论文以及keras实现

常见深度学习框架(tensorflow、keras、pytorch、MXNet、caffe)比较

NLP过程: 分词 1 2 -----词向量化1-----后续分析

Time Series Prediction with LSTM Recurrent Neural Networks in Python with Keras

【keras】基本概念计算方法、Tensor张量、数据类型data_format、函数式模型、batch、epoch

BATCH_SIZE的主要影响到loss以及反向传播时的递度计算;在同一批次的训练中,loss及反向传播梯度为单个loss及反向传播递度的平均值。

如何用grid search的方法做keras深度学习模型超参数调优

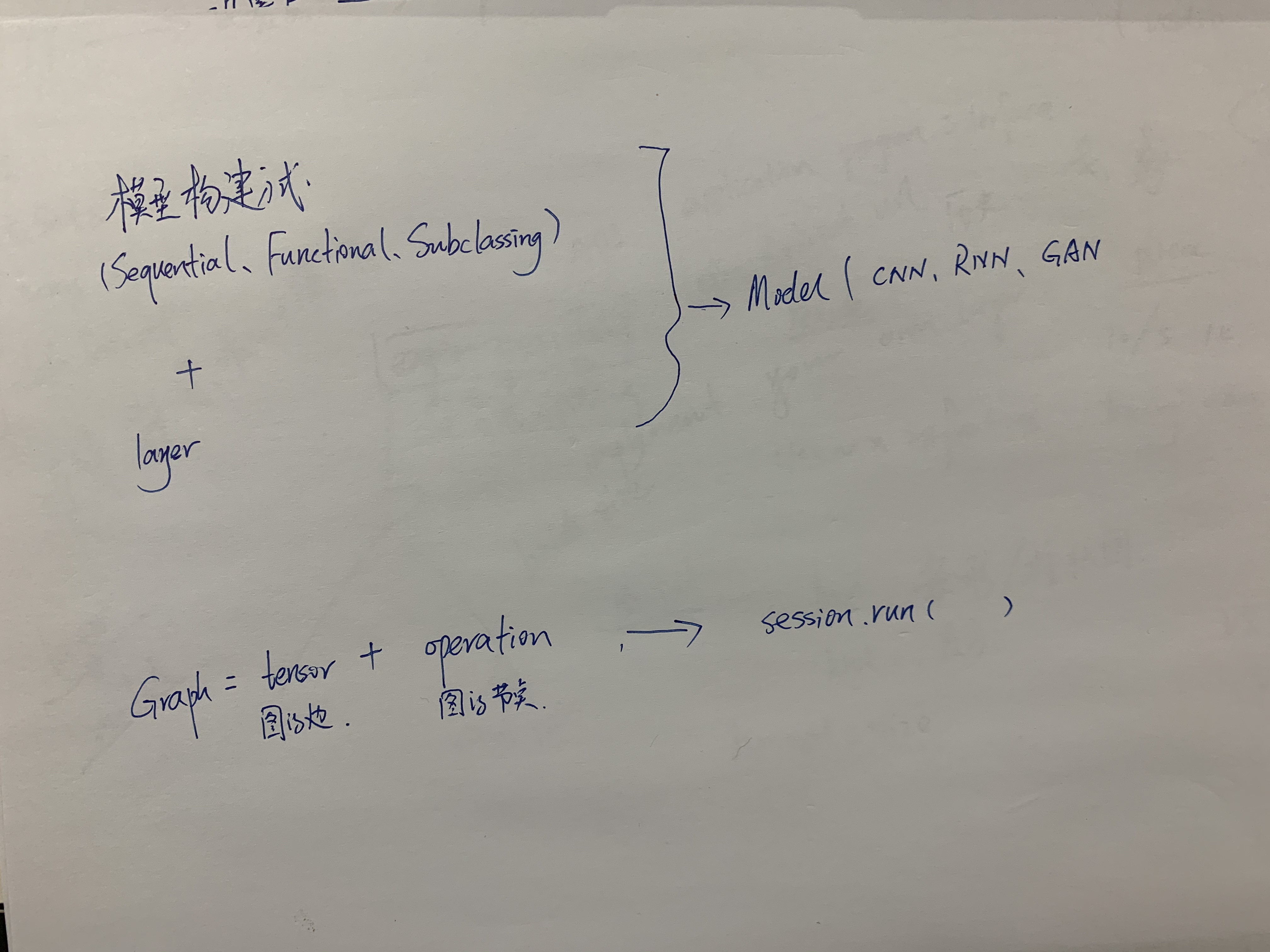

Tensorflow 2.0 中模型构建的三种方式(三种模型的定义方式)

Google云端的colabtory跑GCN深度学习(实例)

posted on 2020-03-06 21:05 静静的白桦林_andy 阅读(134) 评论(0) 编辑 收藏 举报