不同算法的信贷建模流程

一、逻辑回归评分卡

1.数据分析、数据展示

数据分析、图形化数据展示

2.数据预处理,包括

(1)数据清洗

(2)格式转换

(3)缺失值填补

3.变量衍生/特征工程

4.分箱(变量离散化)

采用ChiMerge,要求分箱完之后:

(1)不超过5箱

(2)每箱同时包含好坏样本

(3)特殊值如-1,单独成一箱

连续型变量可直接分箱

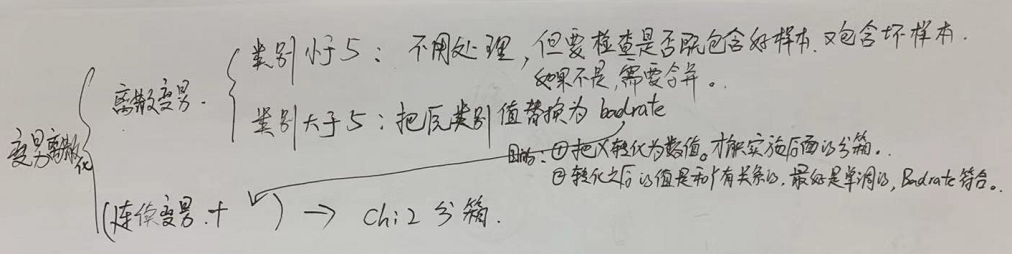

类别型变量:

(a)当取值较多时,先用bad rate编码,再用连续型分箱的方式进行分箱

(b)当取值较少时:

(b1)如果每种类别同时包含好坏样本,无需分箱

(b2)如果有类别只包含好坏样本的一种,需要合并

此处遇到的数据结构:类别型变量:类别种数>5类

类别种数<5类

其中又分为:单类别中包含好坏样本

单类别中只包含好样本或者坏样本

连续型变量。

步骤:

(1)处理类别数小于5的类别型变量,对某一类别中不包含好样本或者坏样本时进行合并,对于包含的不需要合并。

(2)处理类别数大于5的类别型变量,用bad rate进行编码,放入连续型变量里。

(3)对连续型变量进行分箱(一般是chi2分箱),包括(2)中的变量。

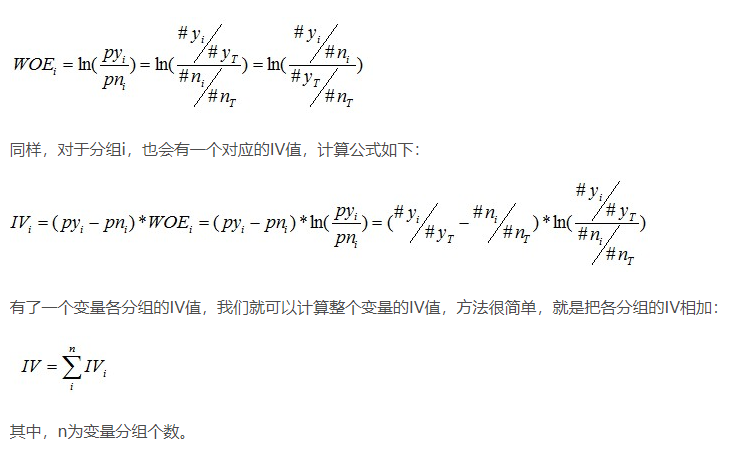

5.WOE编码、计算IV

上步处理完之后都是类别变量([0,1],[1,9]....)了,是无法进行数学操作的,所以要先转化为数值。

转化为数值的方法有很多种,包括badrate编码、woe编码....

从badrate和woe的计算公式上可以看出,它们是相差一个常数项、常数倍,bad(i)/(bad(i)+good(i))、ln(bad(i)/good(i)*good/bad)

那为什么最后不用badrate,而用woe呢?

两点:

(1)方便计算iv值对变量筛选,这个是小的原因。

(2)主要是因为woe和p/(1-p)有表达上的一致性,进而和log(p/(1-p))有一致性。

这篇文章讲的就是这一点: https://zhuanlan.zhihu.com/p/30026040

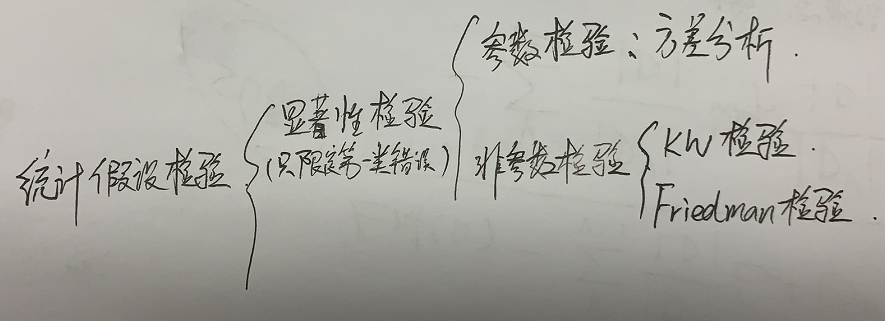

6.单变量分析和多变量分析,均基于WOE编码后的值。

(1)选择IV高于0.01的变量

(2)比较两两线性相关性。如果相关系数的绝对值高于阈值,剔除IV较低的一个。热力图。

(3)多变量相关性,VIF

7.逻辑回归模型。

要求:

(1)变量显著(p值)

要求最终进入模型的变量都显著,即p值都小于0.1或0.05或0.01

https://www.cnblogs.com/kimsimple/p/7819102.html

(2)符号为负

8.尝试加一下正则(之前和盾交流,在做评分卡时基本上不用正则),

或者用树模型进行变量的选择,

或者用树模型建模结果作为一个变量,放到LR中作为一个自变量。

9.转化为评分

10.模型验证

训练样本上的ks、roc

测试样本上的ks、roc

训练集和测试集的得分分布

通过率、召回率、坏账率

11.模型监控

模型ks监控

变量、模型psi监控

逾期监控

突破阈值后对风控修改

二.GBDT算法

1.数据预处理,包括

(1)数据清洗

(2)格式转换

(3)缺失值填补

2.变量衍生/特征工程

对于类别型变量,需要onehot(独热)编码,再训练GBDT模型

3.将独热编码和数值型变量放在一起进行模型训练、调参

posted on 2019-09-03 10:42 静静的白桦林_andy 阅读(1214) 评论(0) 编辑 收藏 举报