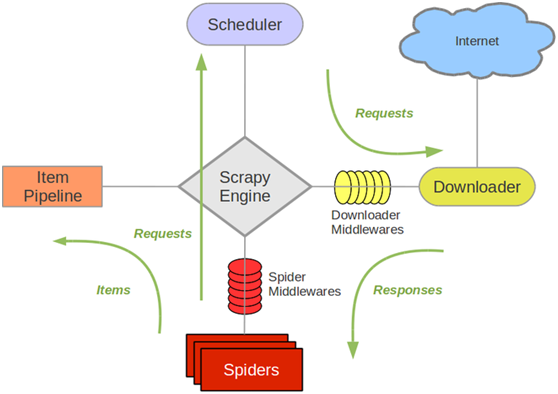

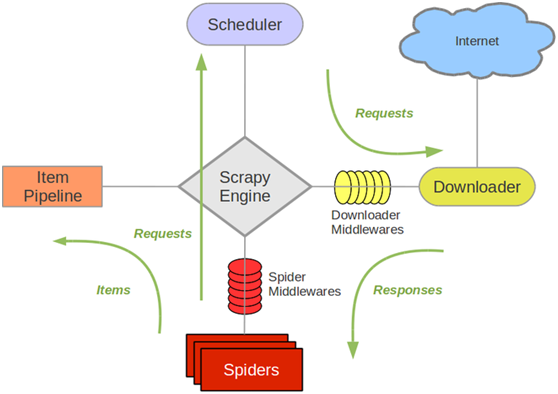

scrapy是目前python使用的最广泛的爬虫框架

架构图如下

解释:

Scrapy Engine(引擎): 负责Spider、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等。

Scheduler(调度器): 它负责接受引擎发送过来的Request请求,并按照一定的方式进行整理排列,入队,当引擎需要时,交还给引擎。

Downloader(下载器):负责下载Scrapy Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Scrapy Engine(引擎),由引擎交给Spider来处理,

Spider(爬虫):它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器),

Item Pipeline(管道):它负责处理Spider中获取到的Item,并进行进行后期处理(详细分析、过滤、存储等)的地方.

Downloader

Middlewares(下载中间件):你可以当作是一个可以自定义扩展下载功能的组件。Spider Middlewares(Spider中间件):你可以理解为是一个可以自定扩展和操作引擎和Spider中间通信的功能组件(比如进入Spider的Responses;和从Spider出去的Requests

一。安装

pip install Twisted.whl

pip install Scrapy

Twisted的版本要与安装的python对应,https://jingyan.baidu.com/article/1709ad8027be404634c4f0e8.html

二。代码

本实例采用xpaths解析页面数据

按住shift-右键-在此处打开命令窗口

输入 scrapy startproject qiushibaike 创建项目

输入 scrapy genspider qiushibaike 创建爬虫

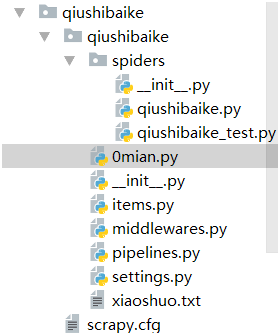

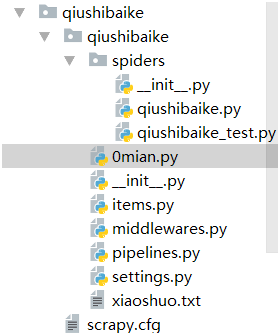

1>结构

2>qiushibaike.py爬虫文件

|

import scrapy

from scrapy.linkextractors import LinkExtractor

from scrapy.spiders.crawl import Rule, CrawlSpider

class BaiduSpider(CrawlSpider):

name = 'qiushibaike'

allowed_domains

= ['qiushibaike.com']

start_urls = ['https://www.qiushibaike.com/text/']#启始页面

#

rules=

(

Rule(LinkExtractor(restrict_xpaths=r'//a[@class="contentHerf"]'),callback='parse_item',follow=True),

Rule(LinkExtractor(restrict_xpaths=r'//ul[@class="pagination"]/li/a'),follow=True)

)

def

parse_item(self, response):

title=response.xpath('//h1[@class="article-title"]/text()').extract_first().strip() #标题

time=response.xpath('

//span[@class="stats-time"]/text()').extract_first().strip()

#发布时间

content=response.xpath('//div[@class="content"]/text()').extract_first().replace(' ','\n') #内容

score=response.xpath('//i[@class="number"]/text()').extract_first().strip() #好笑数

yield({"title":title,"content":content,"time":time,"score":score});

|

3>pipelines.py 数据管道

class QiushibaikePipeline:

def open_spider(self,spider):#启动爬虫中调用

self.f=open("xiaoshuo.txt","w",encoding='utf-8')

def process_item(self, item, spider):

info=item.get("title")+"\n"+ item.get("time")+" 好笑数"+item.get("score")+"\n"+ item.get("content")+'\n'

self.f.write(info+"\n")

self.f.flush()

def close_spider(self,spider):#关闭爬虫中调用

self.f.close()

|

4>settings.py

开启ZhonghengPipeline

ITEM_PIPELINES = {

'qiushibaike.pipelines.QiushibaikePipeline': 300,

}

|

5>0main.py运行

|

from scrapy.cmdline import execute

execute('scrapy crawl qiushibaike'.split())

|

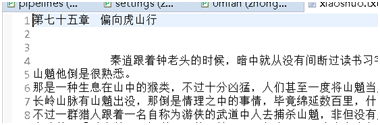

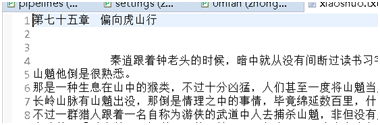

6>结果:

生成xiaohua.txt,里面有下载的笑话文字

浙公网安备 33010602011771号

浙公网安备 33010602011771号