Wide Resnet

参考

论文地址

https://blog.csdn.net/wspba/article/details/72229177

https://blog.csdn.net/bea_tree/article/details/51865100?depth_1-utm_source=distribute.pc_relevant.none-task-blog-BlogCommendFromBaidu-5&utm_source=distribute.pc_relevant.none-task-blog-BlogCommendFro

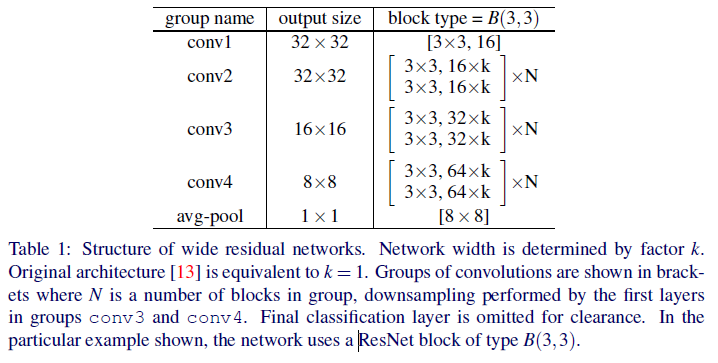

为了提高模型的表现,深度网络可以扩展到上千层,但是每个百分点的提升使得深度加倍,导致模型异常庞大,难以训练。论文在Resnet网络的基础上提出了wide residual networks,减小网络的深度,增大网络的宽度(即通道数)。实验表明,WRN的效果优于Resnet。Resnet确实可以使得深层网络训练变得可行,但也带来了一个问题:许多残差块并未学习到有效的信息,只是identical mapping。

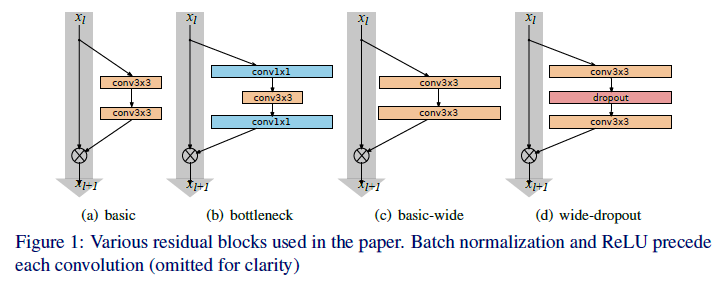

Wide residual network

- basic: resnet网络结构-1

- bottleneck: resnet网络结构-2

- basic-wide: 在resnet网络结构-1上增加宽度(论文采用的结构B(3,3))

- wide-dropout: 在resnet网络结构-2上增加宽度(WRN会带来更多的参数,所以需要dropout正则化)

WRN-n-k表明网络共n层,宽度系数为k