Meta-Learning, A Survey

一、概述

通常在机器学习里,我们需要用大量的数据来训练一个模型;当场景发生改变时,模型就需要重新训练。这显然提升了成本,而人类学习方式与此不同,一个小孩子在学习动物的过程中,学习了很多动物的名称,当某次给他看一些没有见过的动物时,他总能很快的将新动物和别的动物区分开。Meta learning就是如此,它希望使得模型可以提取一种“学会学习”的能力,使其可以在获取已有“知识”的基础上快速学习新的任务。例如:

让一个猫咪图片分类器,迅速具有分类其他物体的能力。

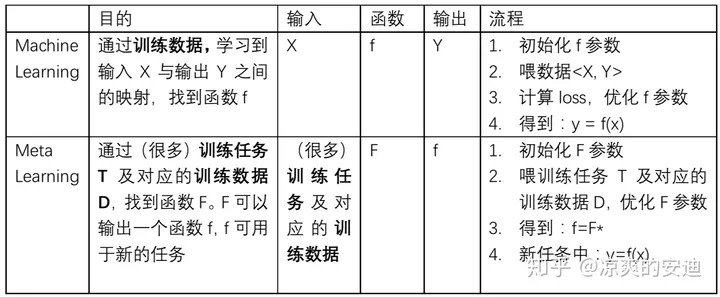

二、机器学习 V.S. 元学习

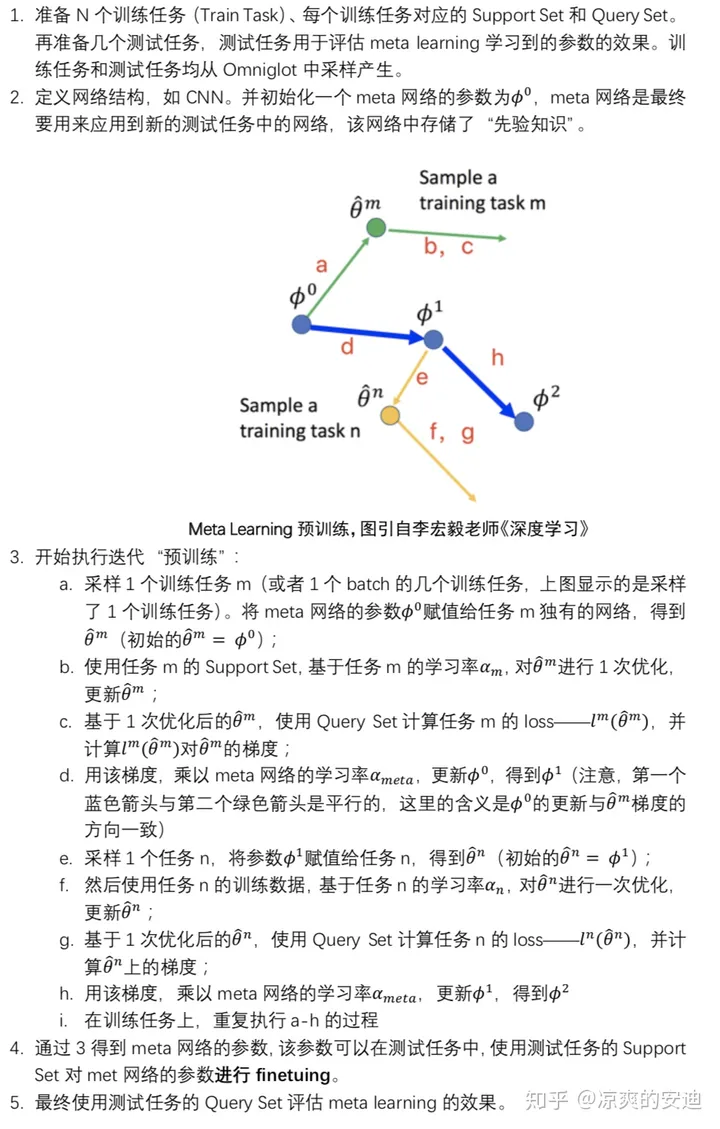

三、 Meta Learning实施过程 -- 以MAML模型为例

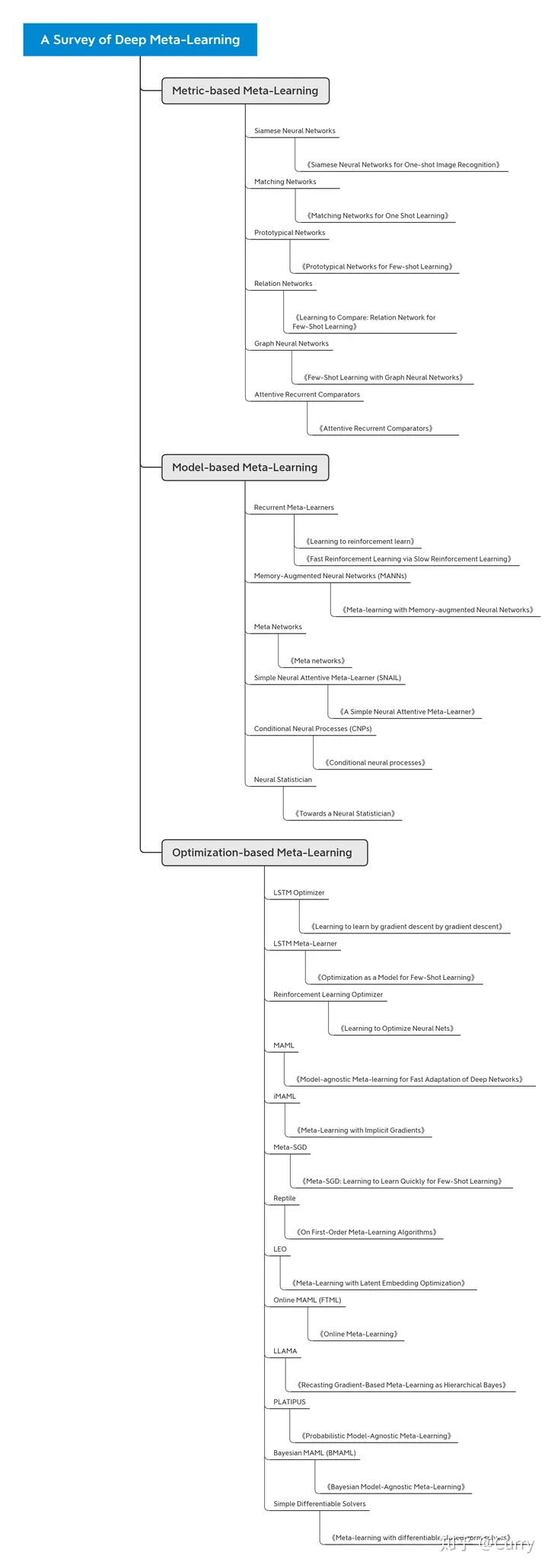

四、分类

-

基于度量的元学习

- 训练模型不需要针对测试任务进行调整

- 当测试与训练任务距离远时,效果不好

- 当测试与训练任务距离远时,效果不好

-

基于模型的元学习

- 由于其系统内部动力学的灵活性,相比大多数基于度量的元学习有更广泛适用性

- 在很多监督任务上表现不如度量学习

- 当数据量增大时,效果变差

- 任务间距离大时,效果不如基于优化的元学习方法

-

基于优化的元学习

- 与基于模型的元学习相比,它们可以在任务分布更广泛的情况获得较优性能

- 基于优化的技术需为每个任务优化base learner,导致计算成本昂贵

五、 论文汇总

浙公网安备 33010602011771号

浙公网安备 33010602011771号