Meta Learning概述

Meta Learning概述(一)

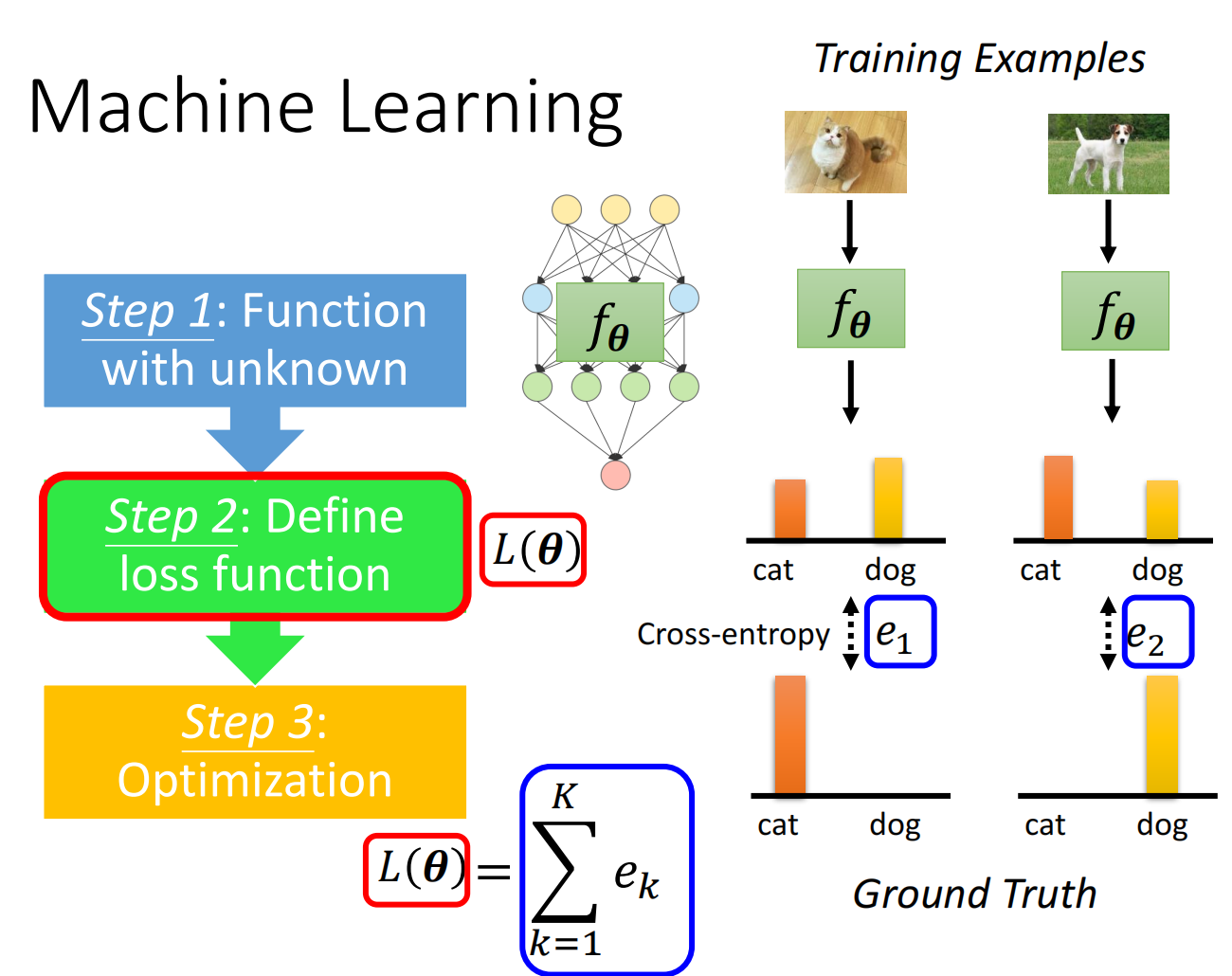

回顾Machine Learning

- 定义一个function(神经网络等),该function上有很多参数,参数统一定义为θ,对于一个猫狗分类器来说,当猫狗的图片经过f(θ)时,函数会输出一个猫或狗的结果

- 定义一个Loss function,L(θ)

- 使用优化器,找到最优参数\(θ^*\),使得L(θ)最小

什么是Meta Learning

Step1:定义一个F,该F是为了学习一个function,对于猫狗分类器来说,当猫狗的图片经过f(θ)时,使得F(f(θ))可以正确预测猫狗类别。其中Φ被定义为learnable components。

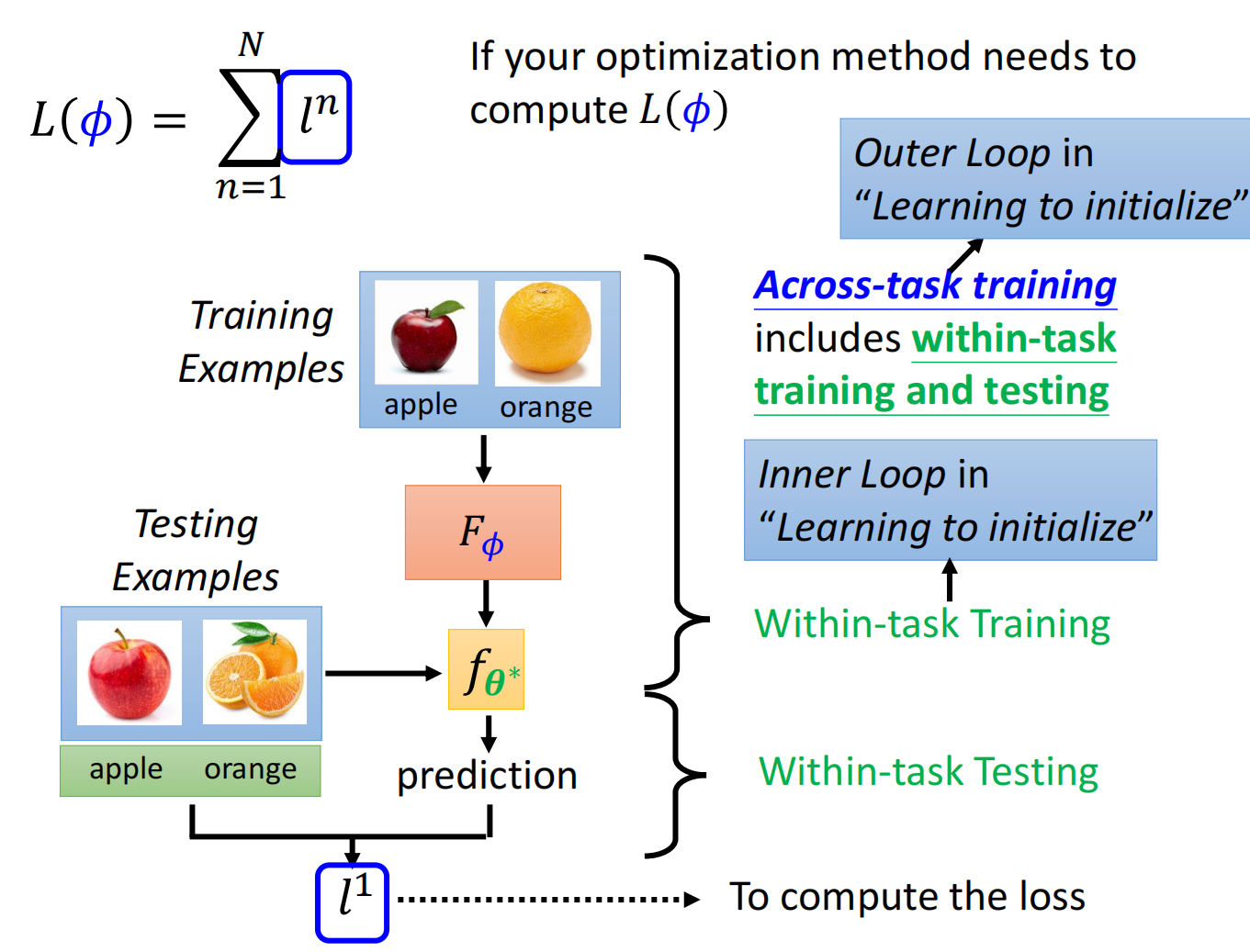

Step2:定义一个Loss function。在Meta Learning中,训练任务被分为了很多Task,每个Task中包含N-Way K-Shot的Support Set和Query Set,在每一轮的迭代中,一个Episode要学习到Support Set中的特征,同时用Query Set做验证来计算损失。每个Task会有一个损失,它们的和就是Loss function

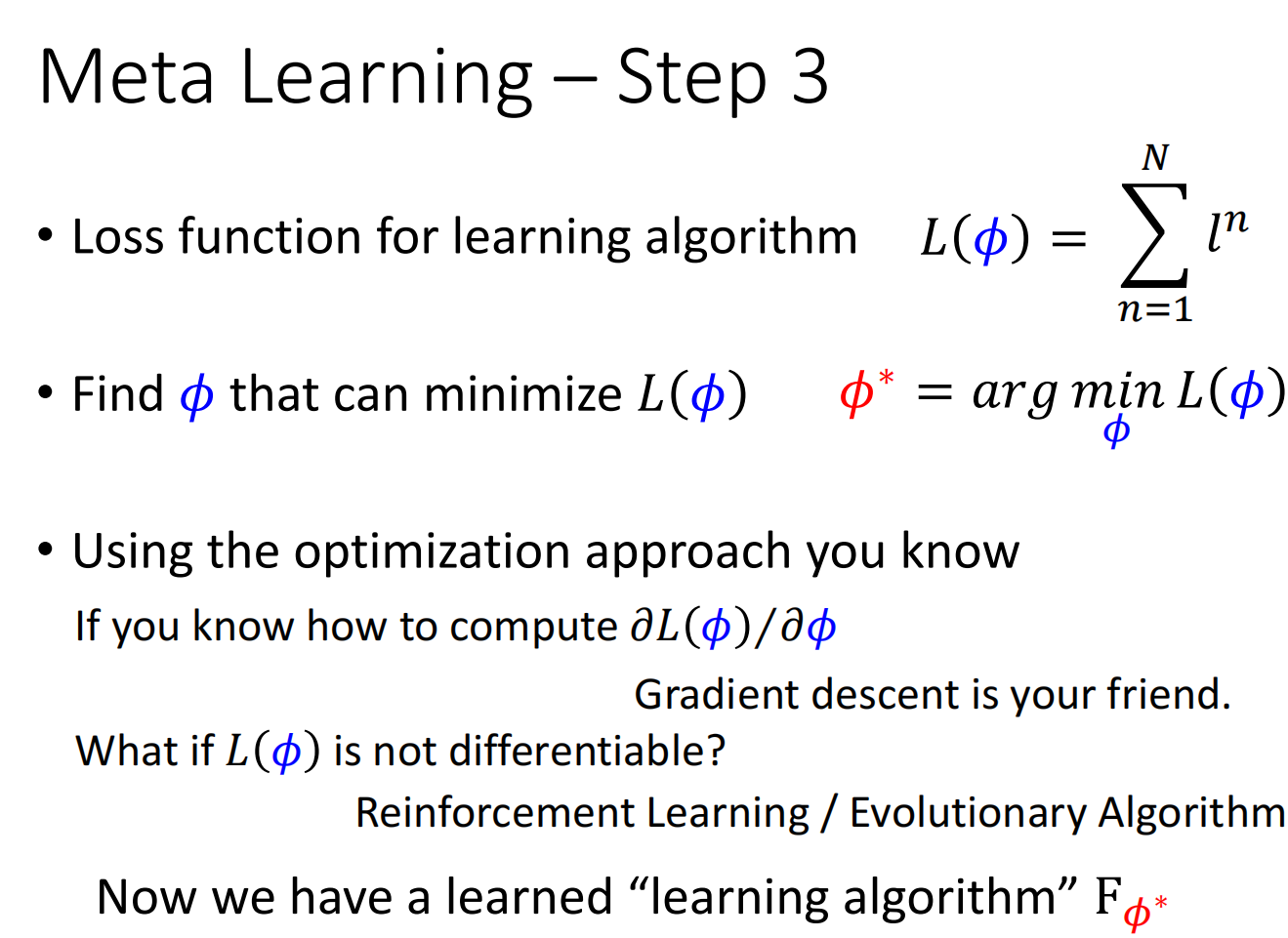

Step3:使用一些方优化法找到Φ使得整个Loss function最小。

总结

-

meta learning是为了学到一个function,学习一个学习算法。

-

meta learning的训练过程中,用

across-task training代表meta learning的整个训练过程,其包含一个Episode中的两个within-task(train和test)。如下图所示:

浙公网安备 33010602011771号

浙公网安备 33010602011771号