13.深度学习-卷积

1.简述人工智能、机器学习和深度学习三者的联系与区别。

①人工智能 人工智能是计算机科学的一个分支,它企图了解智能的实质,并生产出一种新的能以 人类智能相似的方式做出反应的智能机器,该领域的研究包括语音识别、图像识别、 机器人、自然语言处理、智能搜索和专家系统等。人工智能可以对人的意识、思维的 信息过程的模拟。人工智能不是人的智能,但能像人那样思考、也有可能超过人的智 能。人工智能是目的,是结果

②机器学习 机器学习可以理解为机器从已知的经验数据(样本)中,通过某种特定的方法(算 法),自己去寻找提炼(训练/学习)出一些规律(模型);提炼出的规律就可以用 来判断一些未知的事情(预测)。它是一种实现人工智能的方法。

③深度学习 深度学习的思想,来源于人脑的启发,但绝不是人脑的模拟。深度学习本来并不是一 种独立的学习方法,其本身也会用到有监督和无监督的学习方法来训练深度神经网 络。它使得机器学习实现众多应用,拓展了人工智能的领域范畴,给人工智能能以璀 璨未来

2. 全连接神经网络与卷积神经网络的联系与区别。

全连接神经网络和卷积神经网络都是通过一层一层的节点组织起来的。卷积神经网络 中的每一个节点就是一个神经元。在全连接神经网络中,每相邻两层之间的节点都有 边相连,于是会将每一层的全连接层中的节点组织成一列,这样方便显示连接结构。 而对于卷积神经网络,相邻两层之间只有部分节点相连,为了展示每一层神经元的维 度,一般会将每一层卷积层的节点组织成一个三维矩阵。 除了结构相似,卷积神经网 络的输入输出以及训练的流程和全连接神经网络也基本一致,以图像分类为列,卷积 神经网络的输入层就是图像的原始图像,而输出层中的每一个节点代表了不同类别的 可信度。这和全连接神经网络的输入输出是一致的。类似的,全连接神经网络的损失 函数以及参数的优化过程也都适用于卷积神经网络。因此,全连接神经网络和卷积神 经网络的唯一区别就是神经网络相邻两层的连接方式。

3.理解卷积计算。

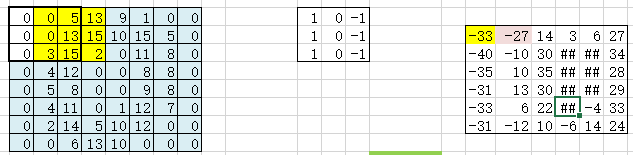

以digit0为例,进行手工演算。

from sklearn.datasets import load_digits #小数据集8*8

digits = load_digits()

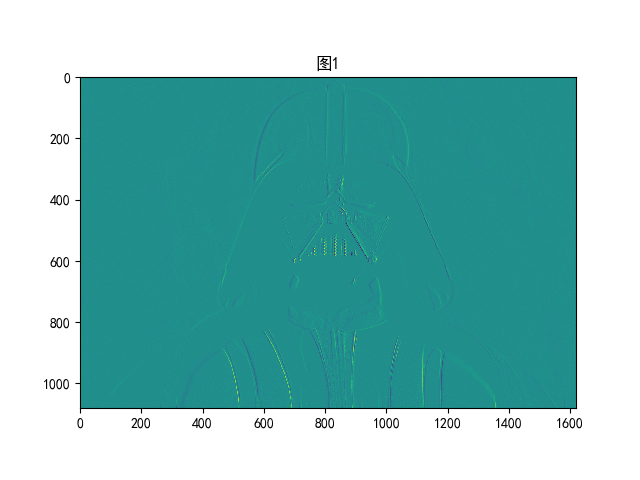

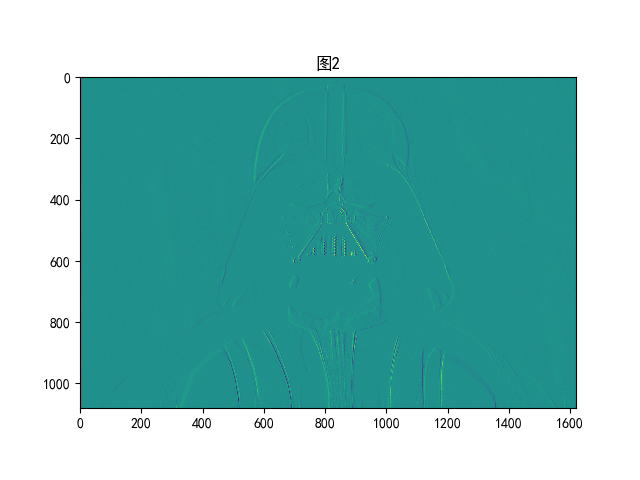

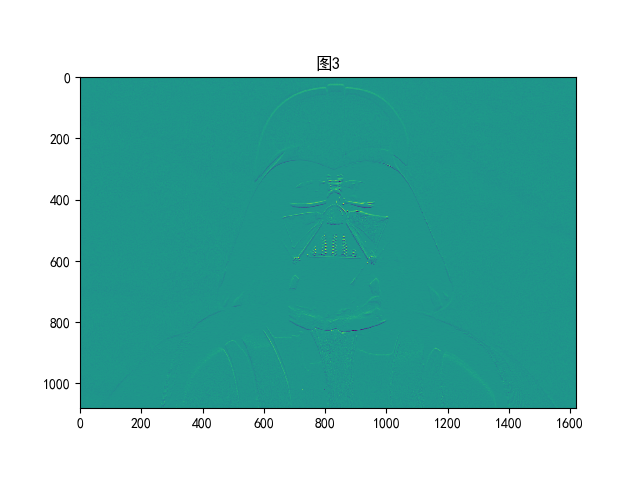

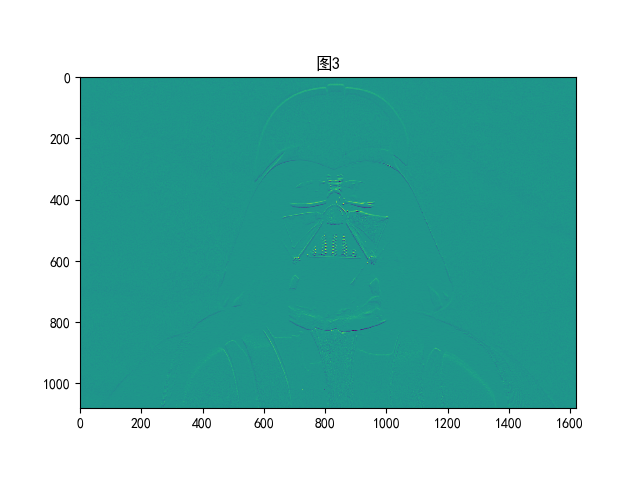

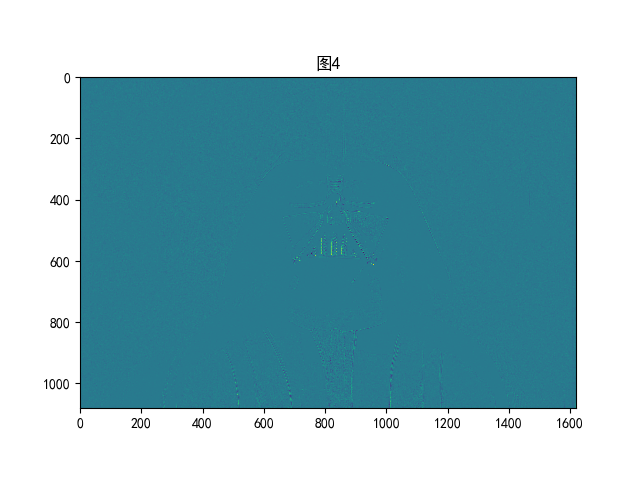

4.理解卷积如何提取图像特征。

读取一个图像;

以下矩阵为卷积核进行卷积操作;

显示卷积之后的图像,观察提取到什么特征。

| 1 | 0 | -1 |

| 1 | 0 | -1 |

| 1 | 0 | -1 |

| 1 | 1 | 1 |

| 0 | 0 | 0 |

| -1 | -1 | -1 |

| -1 | -1 | -1 |

| -1 | 8 | -1 |

| -1 | -1 | -1 |

卷积API

scipy.signal.convolve2d

tf.keras.layers.Conv2D

from PIL import Image from scipy.signal import convolve2d import numpy as np import matplotlib.pyplot as plt from pylab import mpl mpl.rcParams['font.sans-serif'] = ['SimHei'] image = Image.open(r"./aa.jpg") p = image.convert("L") k = np.array([[-1, 0, 1], [-2, 0, 2], [-1, 0, 1]]) k1 = np.array([[1, 0, -1], [1, 0, -1], [1, 0, -1]]) k2 = np.array([[1, 1, 1], [0, 0, 0], [-1, -1, -1]]) k3 = np.array([[-1, -1, -1], [-1, 8, -1], [-1, -1, -1]]) pg0 = convolve2d(p, k, boundary='symm', mode='same') pg1 = convolve2d(p, k1, boundary='symm', mode='same') pg2 = convolve2d(p, k2, boundary='symm', mode='same') pg3 = convolve2d(p, k3, boundary='symm', mode='same') plt.imshow(p) plt.title("原图") plt.show() plt.imshow(pg0) plt.title("图1") plt.show() plt.imshow(pg1) plt.title("图2") plt.show() plt.imshow(pg2) plt.title("图3") plt.show() plt.imshow(pg3) plt.title("图4") plt.show()

5. 安装Tensorflow,keras

浙公网安备 33010602011771号

浙公网安备 33010602011771号