Python解析超大的json数据(GB级别)

使用Python解析各种格式的数据都很方便,比如json、txt、xml、csv等。用于处理简单的数据完全足够用了,而且代码简单易懂。

前段时间我遇到一个问题,如何解析超大的json文件呢?刚开始天真的我在使用json.load直接加载json文件,然而内存报错却给了我当头一棒,json.load它是直接将数据加载到内存中然后解析出来的,这说明什么呢?当你的json文件过于庞大的时候,你的电脑内存装不下你的json文件,这时候就相当尴尬了,加载不了,解析不了!!

怎么办呢?我赶紧上网查阅资料,网上大部份资料都是基于分块的思路解决超大数据文件的解析的,比如read函数可以一块一块加载,像这样read(1024)每次读取1024字节,总能将数据读取完的。或者是readline函数,每次读取一行,这个函数的读取方式特别适合txt、csv文件。然而这样的函数对于json格式的数据就完全不适用了,因为json格式的文件是有严格的结构的。你不可能一块一块的或者一行一行的读取,噢不对,你可以这样读取,但是你这样读取出来的数据是完全没有意义的,因为无法解析,你无法获得你想要的数据。

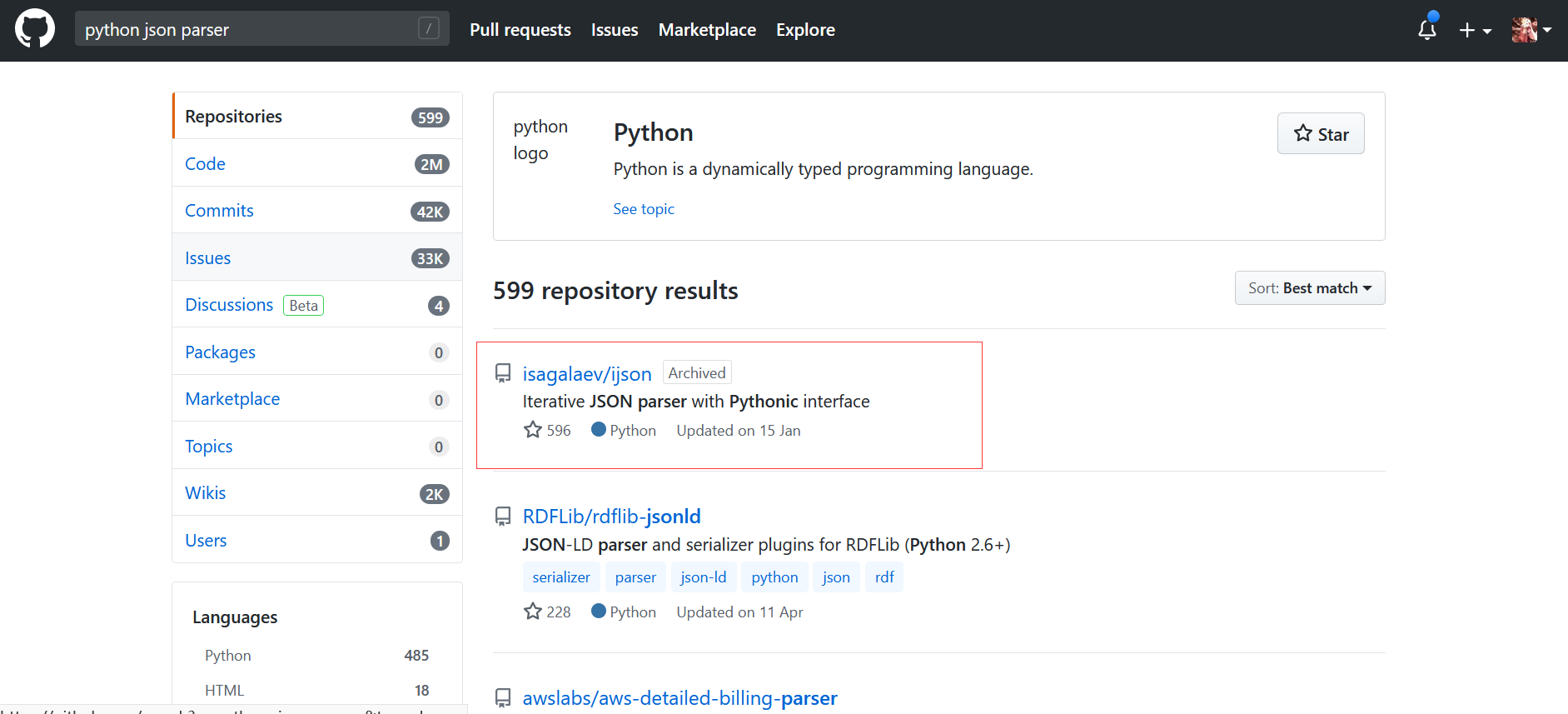

块读取的方式不行,那该怎么办呢,流式读取呗,这时候我想起了万能的GitHub,上去Github搜索python json parser。看看我发现了什么!!!

啊,太棒了,光看简介基于python的迭代的json解析器,我感觉我的问题可能要被解决掉了。

果不其然,ijson完美的解决了我的问题,它抽取了json文件的特征形成了一个生成器的东西,下面举一个实例。

{

"earth": {

"europe": [

{

"name": "Paris",

"type": "city",

"info": "aaa"

},

{

"name": "Thames",

"type": "river",

"info": "sss"

},

{

"name": "yyy",

"type": "city",

"info": "aaa"

},

{

"name": "eee",

"type": "river",

"info": "sss"

}

],

"america": [

{

"name": "Texas",

"type": "state",

"info": "jjj"

}

]

}

}

这是一个简单的json文件,用它来演示json的效果。

import ijson

with open('test.json', 'r', encoding='utf-8') as f:

objects = ijson.items(f, 'earth.europe.item')

#这个objects在这里就是相当于一个生成器,可以调用next函数取它的下一个值

while True:

try:

print(objects.__next__())

except StopIteration as e:

print("数据读取完成")

break

很好,接下来看一下效果如何。

{'name': 'Paris', 'type': 'city', 'info': 'aaa'}

{'name': 'Thames', 'type': 'river', 'info': 'sss'}

{'name': 'yyy', 'type': 'city', 'info': 'aaa'}

{'name': 'eee', 'type': 'river', 'info': 'sss'}

数据读取完成

是不是很棒呢?

这样不会出现内存撑爆了的错误,因为它类似于生成器的方式流式读取json数据,熟悉生成器的朋友应该就很清楚了。

如果想要加速读取解析json文件,可以加上threading多线程模块。这里就不做演示了。

另外附上ijson模块的文档地址:

浙公网安备 33010602011771号

浙公网安备 33010602011771号