神经网络与卷积神经网络的区别

神经网络即指人工神经网络,或称作连接模型,它是一种模仿动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。神经网络用到的算法是向量乘法,采用符号函数及其各种逼近。并行、容错、可以硬件实现以及自我学习特性,是神经网络的几个基本优点,也是神经网络计算方法与传统方法的区别所在。

深度学习的概念源于人工神经网络,含多隐层的多层感知器就是一种深度学习结构。深度学习通过组合低层特征形成更加抽象的高层表示属性类别或特征,以发现数据的分布式特征表示。基于深信度网提出非监督贪心逐层训练算法,为解决深层结构相关的优化难题带来希望,随后提出多层自动编码器深层结构。

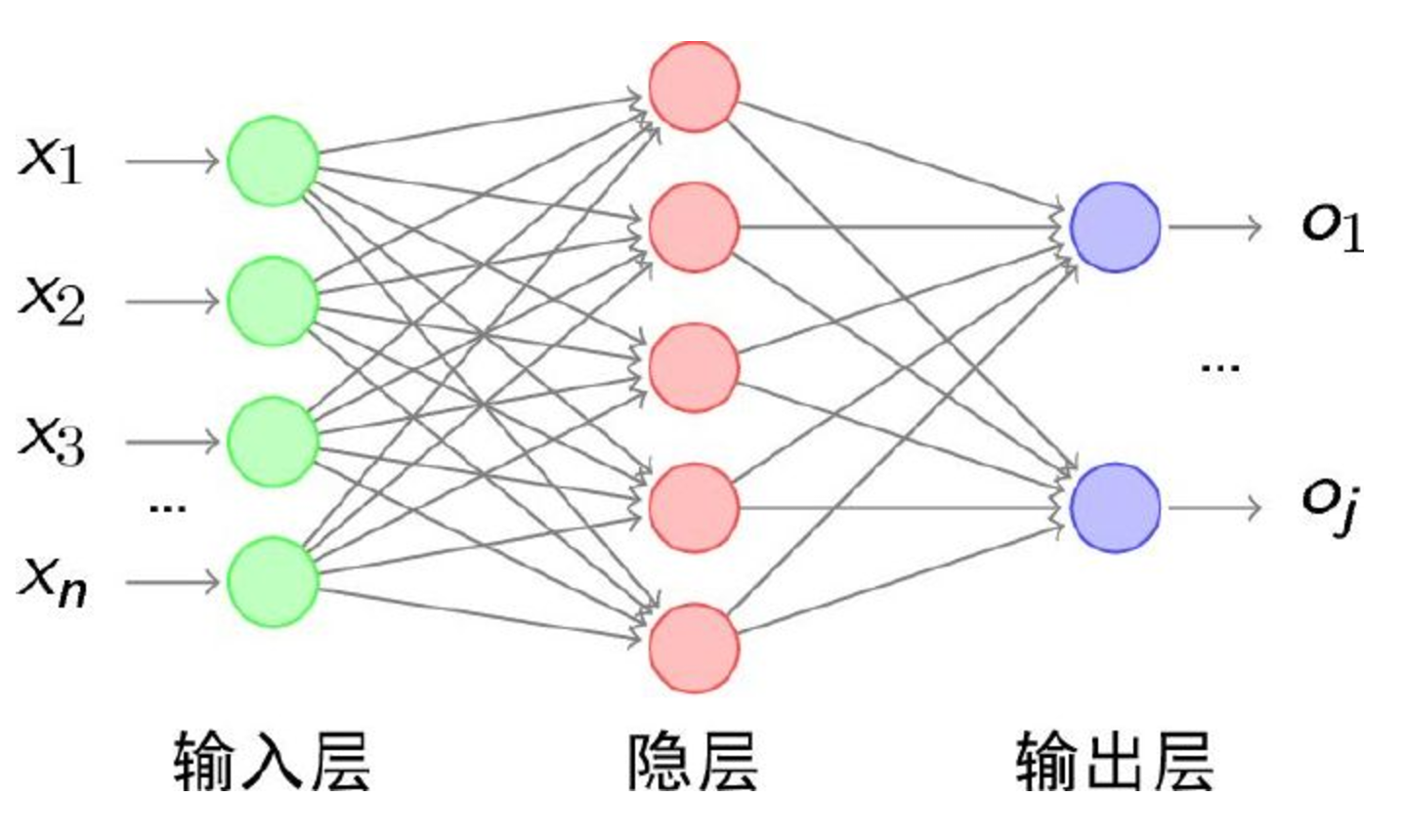

传统意义上的多层神经网络只有输入层、隐藏层、输出层,其中隐藏层的层数根据需要而定,没有明确的理论推导来说明到底多少层合适,多层神经网络做的步骤是:特征映射到值,特征是人工挑选。

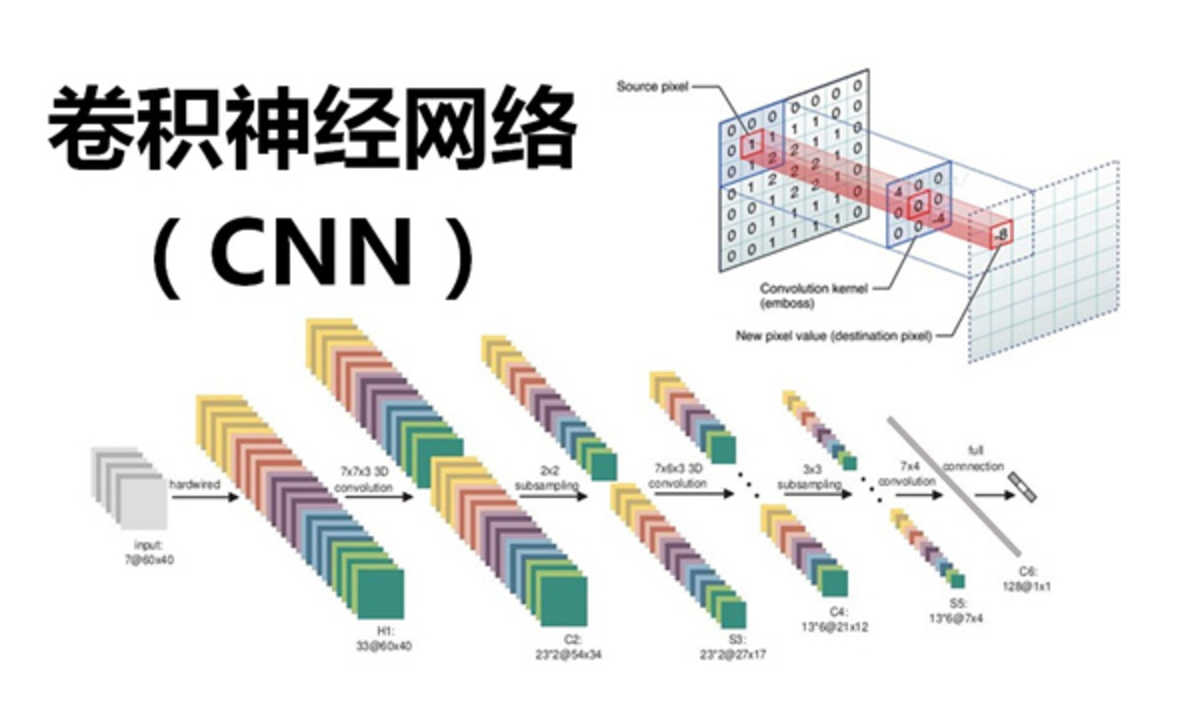

从广义上说深度学习的网络结构也是多层神经网络的一种。深度学习中最著名的卷积神经网络是由Lecun等人提出的,是第一个真正多层结构学习算法,它利用空间相对关系减少参数数目以提高训练性能。在原来多层神经网络的基础上,加入了特征学习部分,这部分是模仿人脑对信号处理上的分级的。具体操作就是在原来的全连接的层前面加入了部分连接的卷积层与降维层,而且加入的是一个层级:输入层-卷积层-降维层-卷积层-降维层- ....-隐藏层-输出层。深度学习做的步骤是:信号->特征->值,特征是由网络自己选择。

浙公网安备 33010602011771号

浙公网安备 33010602011771号