一、模板虚拟机环境准备

1、创建模板虚拟机

使用 VMWare 安装模板虚拟机, IP 地址 192.168.10.100、 主机名称 hadoop100、内存 4G、硬盘 50G(根据自己笔记本修改)

2、hadoop100 虚拟机配置要求如下(本文 Linux 系统全部以 CentOS-7.5-x86-1804 为例)

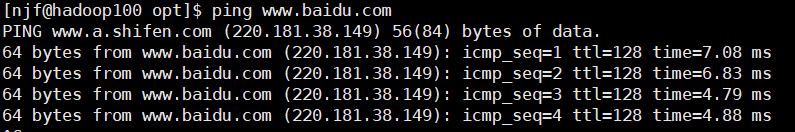

(1)使用 yum 安装需要虚拟机可以正常上网, yum 安装前可以先测试下虚拟机联网情况

(2)安装 epel-release

注: Extra Packages for Enterprise Linux 是为“红帽系”的操作系统提供额外的软件包,适用于 RHEL、 CentOS 和 Scientific Linux。相当于是一个软件仓库, 大多数 rpm 包在官方repository 中是找不到的)

yum install -y epel-release

(3)注意: 如果 Linux 安装的是最小系统版,还需要安装如下工具;如果安装的是 Linux 桌面标准版,不需要执行如下操作

net-tool:工具包集合,包含 ifconfig 等命令

yum install -y net-tools

vim:编辑器

yum install -y vim

3、关闭防火墙,关闭防火墙开机自启

systemctl stop firewalld

systemctl disable firewalld.service

注意:在企业开发时,通常单个服务器的防火墙时关闭的。公司整体对外会设置非常安全的防火墙

4、创建 用户,并修改 用户的密码

[root@hadoop100 ~]# useradd njf

[root@hadoop100 ~]# passwd njf

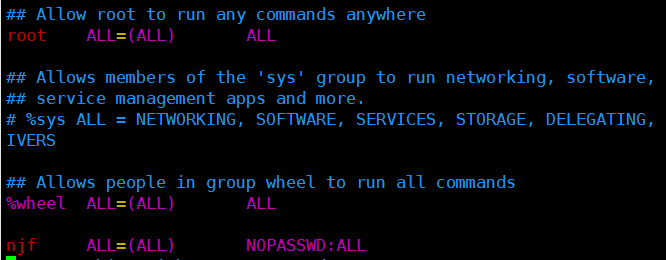

5、配置 njf 用户具有 root 权限,方便后期加 sudo 执行 root 权限的命令

vim /etc/sudoers

修改/etc/sudoers 文件,在%wheel 这行下面添加一行,如下所示:

注意: njf 这一行不要直接放到 root 行下面,因为所有用户都属于 wheel 组,你先配置了 njf 具有免密功能,但是程序执行到%wheel 行时, 该功能又被覆盖回需要密码。所以 njf 要放到%wheel 这行下面。

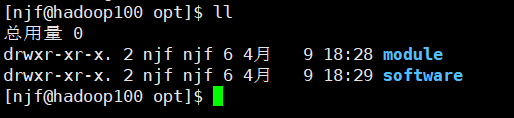

6、在/opt 目录下创建文件夹,并修改所属主和所属组

(1)在/opt 目录下创建 module、 software 文件夹

[root@hadoop100 ~]# mkdir /opt/module

[root@hadoop100 ~]# mkdir /opt/software

(2)修改 module、 software 文件夹的所有者和所属组均为 njf 用户

[root@hadoop100 ~]# chown njf:njf /opt/module /opt/software

(3)查看 module、 software 文件夹的所有者和所属组

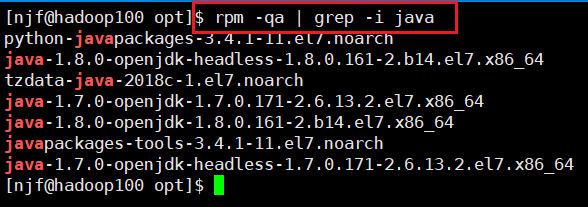

7、卸载虚拟机自带的 JDK

注意:如果你的虚拟机是最小化安装不需要执行这一步。 查看已经安装的 JDK:

使用命令卸载:

rpm -qa | grep -i java | xargs -n1 rpm -e --nodeps

说明:

rpm -qa: 查询所安装的所有 rpm 软件包

grep -i:忽略大小写

xargs -n1:表示每次只传递一个参数

rpm -e –nodeps:强制卸载软件

8、使用 reboot 重启虚拟机

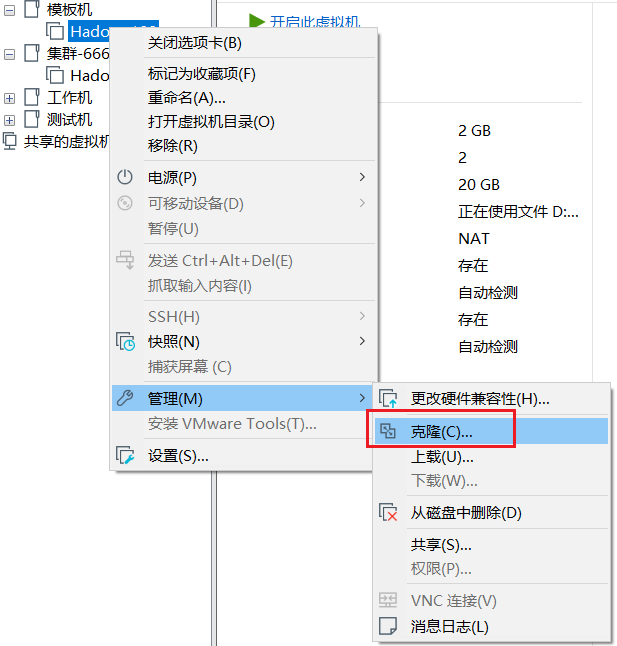

二、克隆虚拟机

1、克隆虚拟机

利用模板机 hadoop100,克隆三台虚拟机: hadoop102 hadoop103 hadoop104

注意:克隆时,要先关闭 Hadoop100

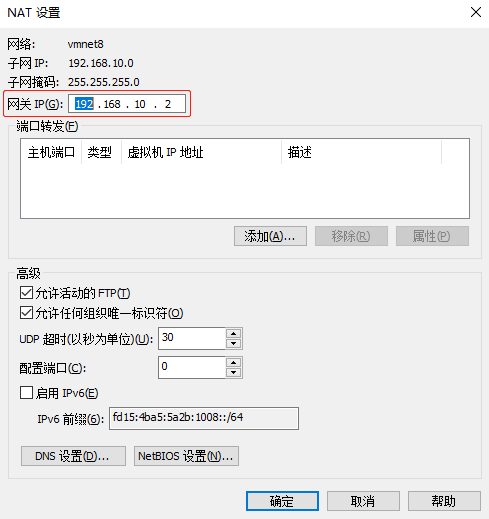

2、修改克隆机 IP,以下以 hadoop102 举例说明

(1)修改克隆虚拟机的静态 IP

主要修改如下几项:

BOOTPROTO=static

IPADDR=192.168.10.102

GATEWAY=192.168.10.2

DNS1=192.168.10.2

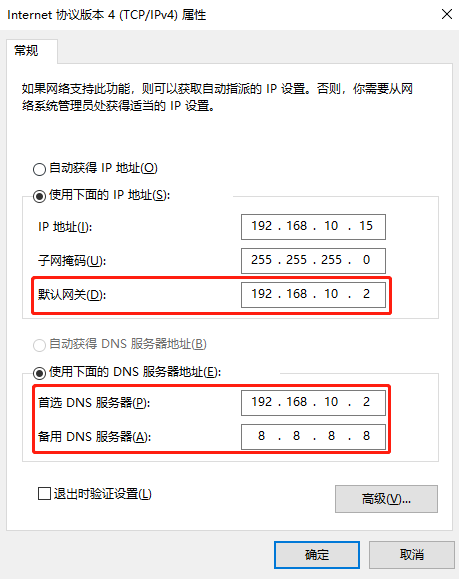

(2)查看 Linux 虚拟机的虚拟网络编辑器,编辑->虚拟网络编辑器->VMnet8

(3)查看 Windows 系统适配器 VMware Network Adapter VMnet8 的 IP 地址

(4)保证 Linux 系统 ifcfg-ens33 文件中 IP 地址、虚拟网络编辑器地址和 Windows 系统 VM8 网络 IP 地址相同。

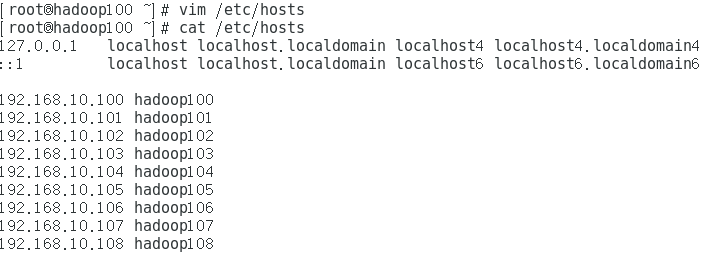

3、修改克隆机主机名,以下以 hadoop102 举例说明

(1) 修改主机名称

(2)配置 Linux 克隆机主机名称映射 hosts 文件, 打开/etc/hosts

4、使用 reboot 重启克隆机 Hadoop102

5、修改 windows 的主机映射文件(hosts 文件)

(1) 如果操作系统是 window7,可以直接修改

① 进入 C:\Windows\System32\drivers\etc 路径

② 打开 hosts 文件并添加如下内容,然后保存

192.168.10.100 hadoop100

192.168.10.101 hadoop101

192.168.10.102 hadoop102

192.168.10.103 hadoop103

192.168.10.104 hadoop104

192.168.10.105 hadoop105

192.168.10.106 hadoop106

192.168.10.107 hadoop107

192.168.10.108 hadoop108

(2)如果操作系统是 window10,先拷贝出来,修改保存以后,再覆盖即可

① 进入 C:\Windows\System32\drivers\etc 路径

② 拷贝 hosts 文件到桌面

③ 打开桌面 hosts 文件并添加如下内容

192.168.10.100 hadoop100

192.168.10.101 hadoop101

192.168.10.102 hadoop102

192.168.10.103 hadoop103

192.168.10.104 hadoop104

192.168.10.105 hadoop105

192.168.10.106 hadoop106

192.168.10.107 hadoop107

192.168.10.108 hadoop108

④ 将桌面 hosts 文件覆盖 C:\Windows\System32\drivers\etc 路径 hosts 文件

三、在 Hadoop102 安装 JDK

1、卸载现有 JDK

注意:安装 JDK 前,一定确保提前删除了虚拟机自带的 JDK。

详细步骤可以参照上面的卸载JDK步骤

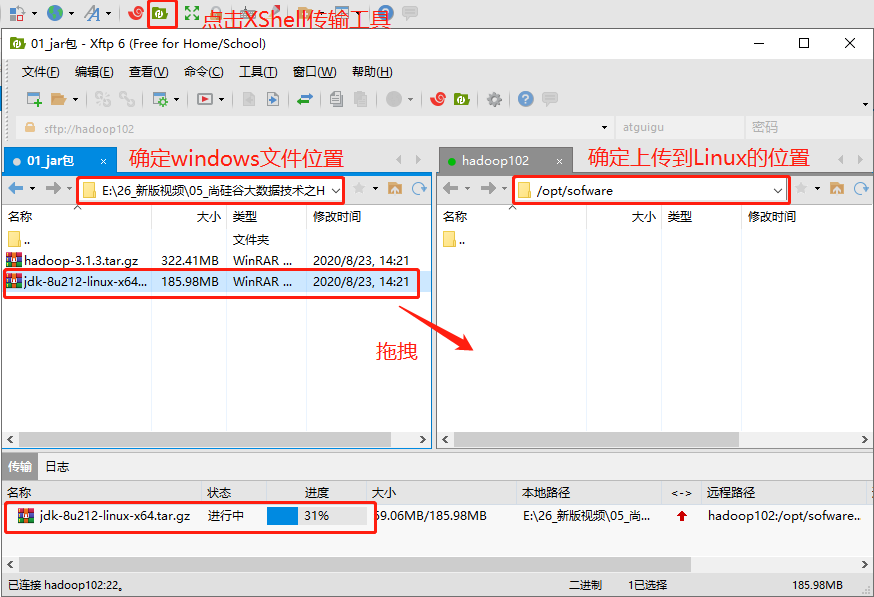

2、用 XShell 传输工具将 JDK 导入到 opt 目录下面的 software 文件夹下面

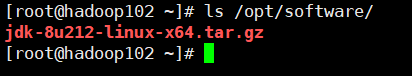

3、在 Linux 系统下的 opt 目录中查看软件包是否导入成功

4、解压 JDK 到/opt/module 目录下

tar -zxvf jdk-8u212-linux-x64.tar.gz -C /opt/module/

5、配置 JDK 环境变量

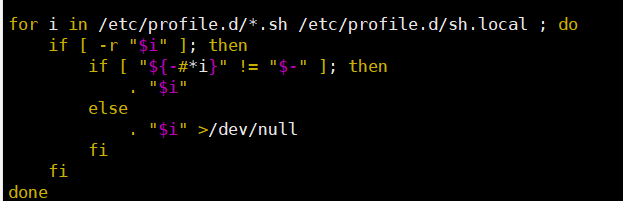

原来的话,我们都是在 /etc/profile 配置环境,但是里面有一段脚本:  会遍历 /etc/profile.d/ 目录下的所有 *.sh,然后添加到环境变量里面。

会遍历 /etc/profile.d/ 目录下的所有 *.sh,然后添加到环境变量里面。

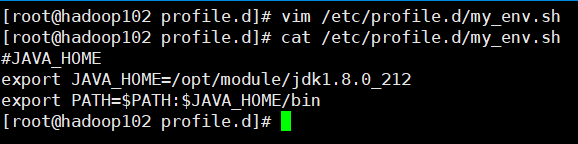

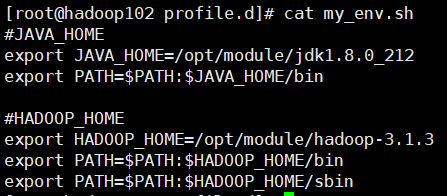

(1)新建/etc/profile.d/my_env.sh 文件,并配置 JAVA_HOME

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_212

export PATH=$PATH:$JAVA_HOME/bin

(2)保存后退出,刷新一下 /etc/profile,让新的环境变量生效

source /etc/profile

6、测试 JDK 是否安装成功

使用 java、javac、java -version 命令来测试 Java 是否安装成功

注意:重启(如果 java -version 可以用就不用重启)

四、在 Hadoop102 安装 Hadoop

Hadoop 下载地址: https://archive.apache.org/dist/hadoop/common/hadoop-3.1.3/

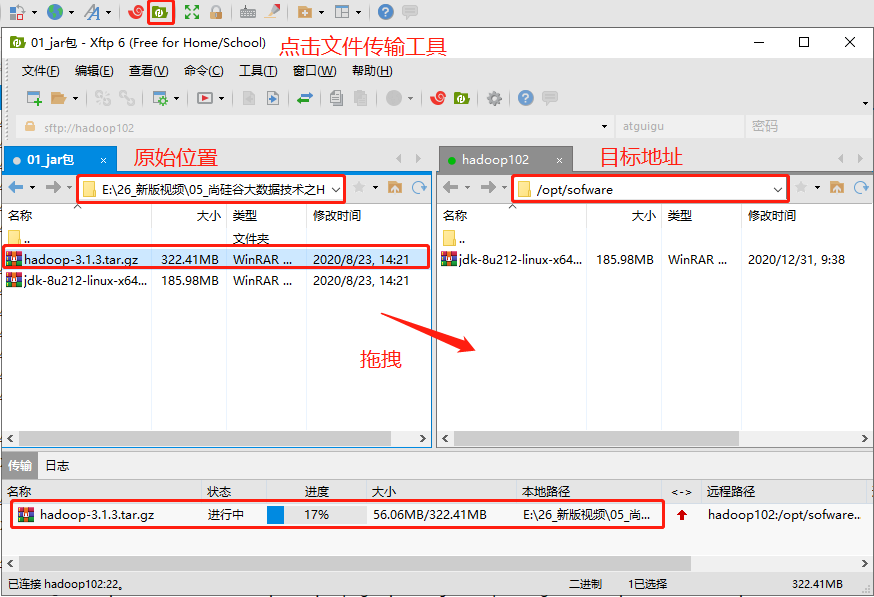

1、用 XShell 文件传输工具将 hadoop-3.1.3.tar.gz 导入到 opt 目录下面的 software 文件夹下面

2、进入到 Hadoop 安装包路径下

cd /opt/software/

3、解压安装文件到/opt/module 下面

tar -zxvf hadoop-3.1.3.tar.gz -C /opt/module/

4、查看是否解压成功

ls /opt/module/

5、将 Hadoop 添加到环境变量

(1)获取 Hadoop 安装路径

(2)打开 /etc/profile.d/my_env.sh 文件

(3)在 my_env.sh 文件末尾添加如下内容:(shift+g)

#HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-3.1.3

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

(4)保存并退出,让修改后的文件生效

source /etc/profile

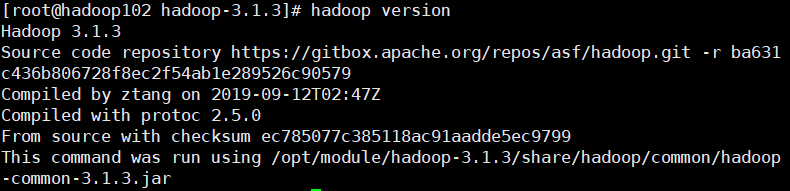

6、测试是否安装成功

7、重启(如果 Hadoop 命令不能用再重启虚拟机)

五、Hadoop 目录结构

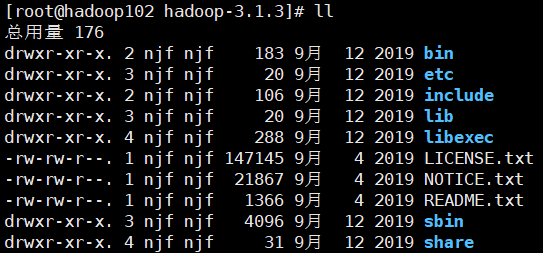

(1)查看 Hadoop 目录结构

(2)重要目录

- bin 目录:存放对 Hadoop 相关服务(hdfs, yarn, mapred)进行操作的脚本

- etc 目录: Hadoop 的配置文件目录,存放 Hadoop 的配置文件

- lib 目录:存放 Hadoop 的本地库(对数据进行压缩解压缩功能)

- sbin 目录:存放启动或停止 Hadoop 相关服务的脚本

- share 目录:存放 Hadoop 的依赖 jar 包、 文档、 和官方案例

浙公网安备 33010602011771号

浙公网安备 33010602011771号