深度学习的数学(笔记)

深度学习的数学

人工智能历史

第1代 20 世纪 50~60 年代 逻辑为主 智力游戏等

第2代 20 世纪 80 年代 知识为主 机器人、机器翻译

第3代 2010 年至今 数据为主 模式识别、语音识别

20 世纪的“人教导机器”类型的人工智能,现在仍然活跃在各种领域。在 20 世纪后期,对于这样的问题,人们找到了简单的解决方法,那就是神经网络以及由其发展而来的深度学习。如前所述,具体来说就是由人提供数据,然后由神经网络自己进行学习。

神经网络结构

-

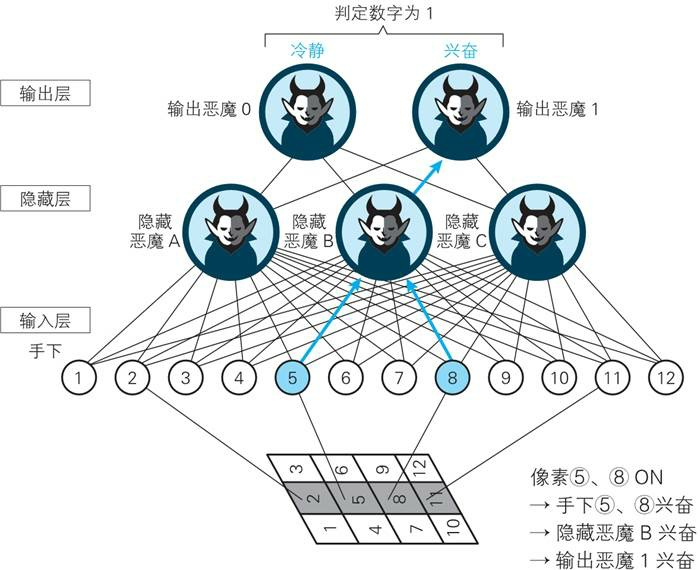

恶魔之间的“交情”表示权重

12个像素为三大恶魔的手下A,B,C ; A,B,C分别对不同手下中意(权重),不同手下兴奋会导致不同恶魔兴奋。

-

恶魔的心的偏置

在这个恶魔组织中,下层的兴奋度会或多或少地传递到上层。但是,除了具有亲密关系的各层之间传递的兴奋度信息以外,还遗漏了少量信息,就是“噪声”。如果这些噪声迷住了恶魔的心,就会导致无法正确地传递兴奋度信息。因此,这就需要减少噪声的功能。对于恶魔组织的情形,我们就将这个功能称为“心的偏置”吧!具体来说,将偏置放在恶魔的心中,以忽略少量的噪声。这个“心的偏置”是各个恶魔固有的值(也就是个性)。

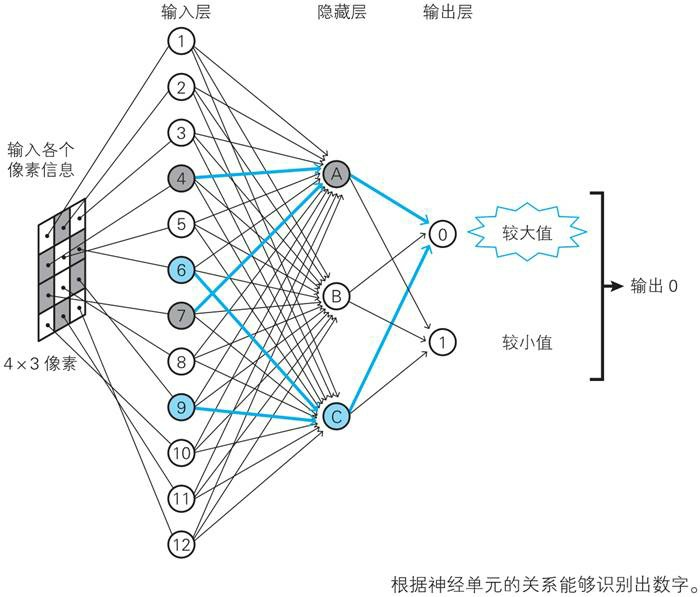

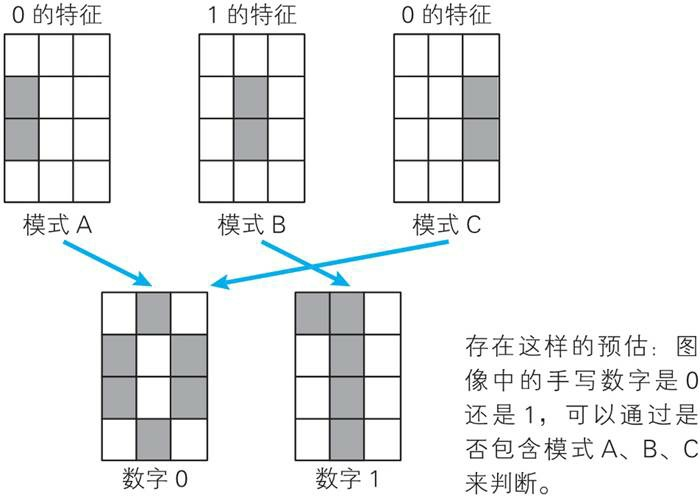

结构分析

输出层的输出恶魔的人数是 2 人。根据现有的经验,在用计算机进行计算时,对于两个字的识别,使用两个神经单元的神经网络结构比较简单,识别也容易进行。住在隐藏层的隐藏恶魔的人数是 3 人。为什么是 3 人呢?如本节开头所讲的那样,这是由于存在某种预估,如下图所示。根据该图可以预估数字 0 包含了图中的模式 A 和 C,数字 1 包含了模式 B。因此,只要准备好对上图的模式 A、B、C 做出反应的神经单元,就能够判断图像中的数字是 0 还是 1。这 3 个神经单元正是隐藏恶魔 A、B、C 的本来面目。

请想象一下生物看东西时的情形。可以认为,输入层神经单元相当于视细胞,隐藏层神经单元相当于视神经细胞,输出层神经单元相当于负责判断的大脑神经细胞群。需要注意的是,神经网络的权重是允许出现负数的,但在用生物学进行类比时不会出现负数,也难以将负数作为神经传递物质的量。可以看出,神经网络从生物那里得到启发,又飞跃到了与生物世界不同的另一个世界。

奇点(singularity)被用来表示人工智能超过人类智能的时间点。据预测是 2045 年,也有不少人预测这个时间点会更早到来。

卷积神经网络

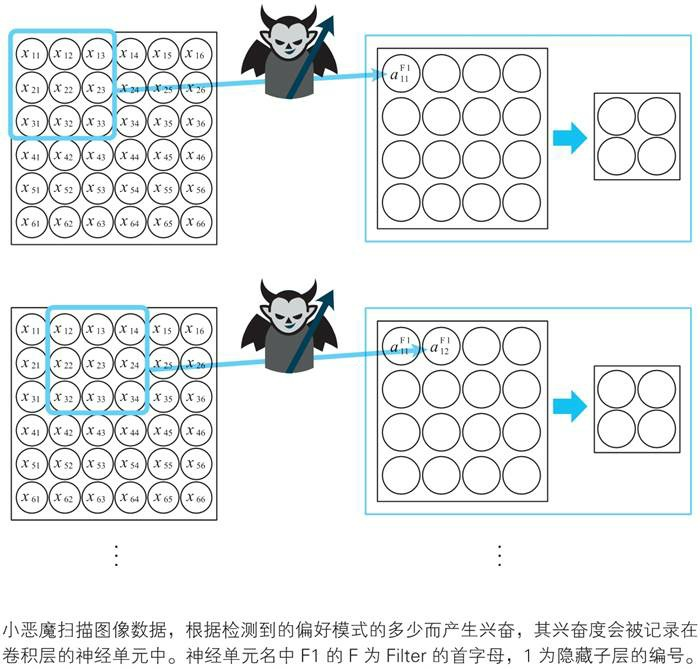

卷积比喻为小恶魔,本节登场的恶魔与之前的恶魔性格稍微有点不同。虽然他们的共同点都是具有自己偏好的模式,但是相比第 3 章登场的恶魔坐着一动不动,这里的恶魔是活跃的,他们会积极地从图像中找出偏好的模式,我们称之为小恶魔。活跃的小恶魔积极地扫描图像,检查图像中是否含有自己偏好的模式。如果图像中含有较多偏好的模式,小恶魔就很兴奋,反之就不兴奋。

通过池化进行信息压缩,需要进行信息压缩操作,然后将压缩结果放进池化层的神经单元中。本书中我们使用最有名的信息压缩方法最大池化 (max pooling)。