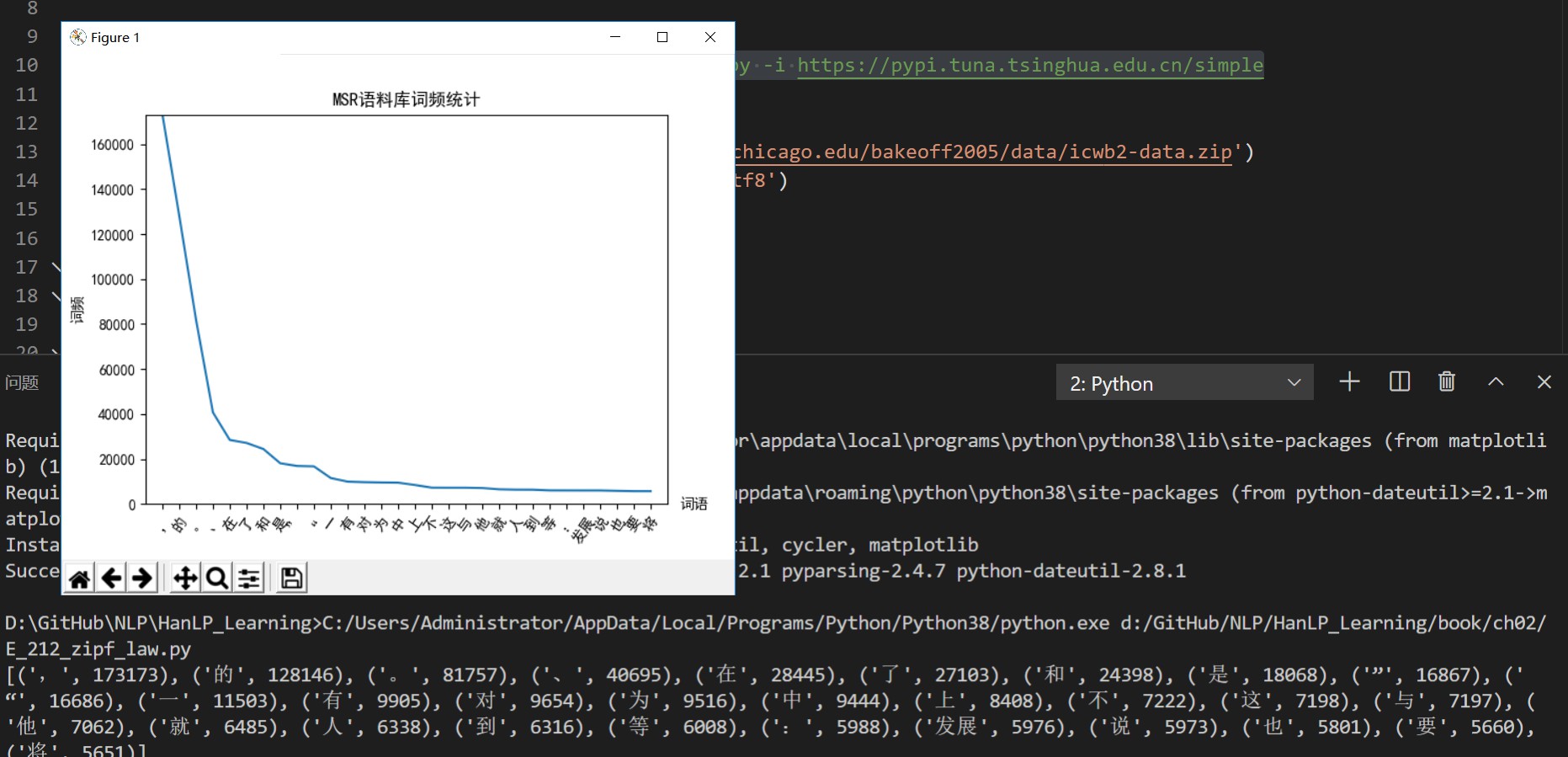

IntroductionToNLP - ch02 - 2.1.2 词的性质—齐夫定律

icwb2-data 数据集:

由北京大学、香港城市大学、台湾 CKIP, Academia Sinica 及中国微软研究所联合发布的数据集,用以进行中文分词模型的训练。

其中 AS 和 CityU 为繁体中文数据集,PK 和 MSR 为简体中文数据集。

http://sighan.cs.uchicago.edu/bakeoff2005/data/icwb2-data.zip

程序运行,自动下载失败,自己去下载一下。icwb2-data.zip - 50.2MB,还是会需要一点时间的。

这个期间,可学习下“齐夫定律”。http://www.cyzuo.cn/index.php/archives/21/

中文分词:指的是将一段文本拆分为一系列单词的过程。

下载完毕,拷贝到:C:\Users\Administrator\AppData\Local\Programs\Python\Python38\Lib\site-packages\pyhanlp\static\data\test

UnicodeDecodeError: 'gbk' codec can't decode byte 0x9c in position 2: illegal multibyte sequence

看样子是编码问题~

open(msr)

改为:

open(msr,'r', encoding='UTF-8')

问题解决

ModuleNotFoundError: No module named 'matplotlib'

ModuleNotFoundError: No module named 'matplotlib'

缺少东西,安装一下

python -m pip install matplotlib 超级慢,不好用!

pip3 install matplotlib -i https://pypi.tuna.tsinghua.edu.cn/simple

下面这个好用~

ok,总算看到结果了。

有源代码,一路也是有坑,边走边总结。

浙公网安备 33010602011771号

浙公网安备 33010602011771号