[重读经典论文] MobileViT

参考博客:MobileViT模型简介

参考视频:15.1 MobileViT网络讲解

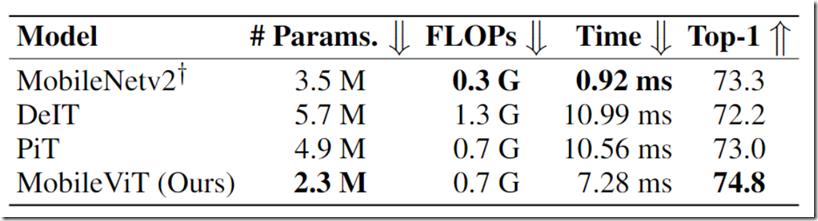

MobileViT结构上是一个混合模型,CNN+Transformer,比主流的轻量化ViT网络和轻量化CNN网络参数量少,精度高,缺点是推理速度慢,下图可以看到,推理时间是MobileNetV2的8倍。

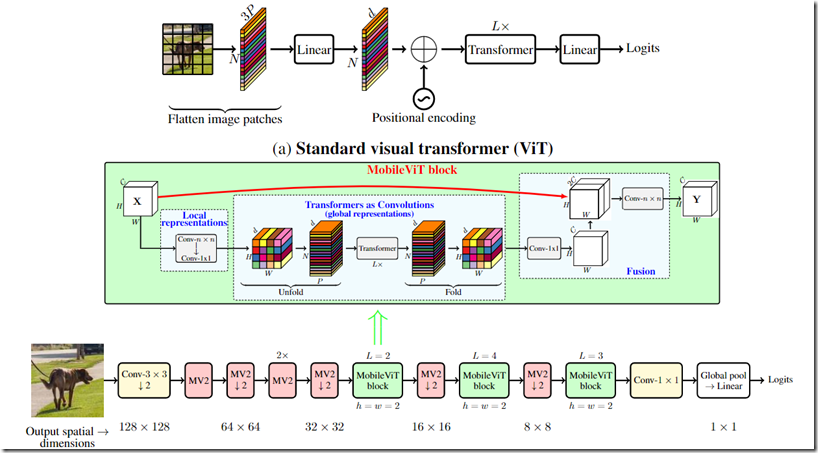

网络结构:

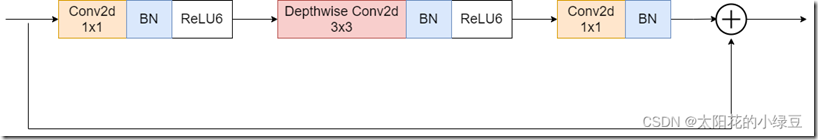

其中MV2为MobileNetV2的逆残差结构:

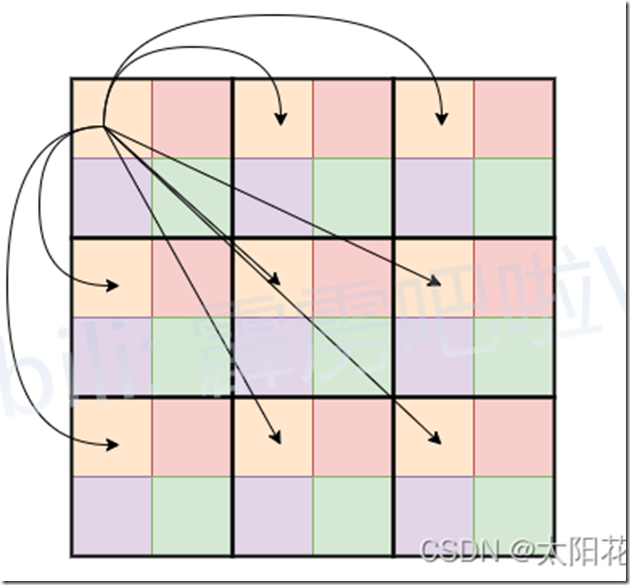

MobileViT结构是主要的创新,Unfold过程,其实就是对局部特征进行分组形成序列,再输入Transformer模块进行self-attention操作:

如上图所示,就是把feature map分成若干n*n的patch,然后将每个patch中相同位置(图中相同颜色)的特征形成一个个序列,再进行self-attention操作。

最后再将输出的序列进行unfold,也就是将每个序列相同位置的特征恢复到相应的位置。

本文版权归作者(https://www.cnblogs.com/harrymore/)和博客园共有,欢迎转载,但未经作者同意必须保留此段声明,且在文章页面明显位置给出原文链接,如有问题, 可邮件(harrymore@126.com)咨询.

浙公网安备 33010602011771号

浙公网安备 33010602011771号