机器学习小白入门①

- 机器学习常用的理论分类:

- 传统的监督学习

- 深度学习

- 强化学习

- 建议按照上面列出的顺序作为学习路线

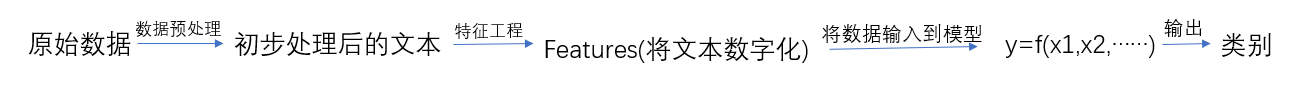

- 文本分类:

PS:其中特征工程尤为重要,特征决定了机器学习的上限,而机器学习只是在逼近这个上限

- 字组成词,词才具有意义;而中文分词将句子拆分为一个个的词;

- 监督学习:

- 提高模型性能方法:①数据预处理 从本源出发②特征工程 the key③机器学习算法 就像找对象,适合最重要④模型集成

- anaconda官网下载地址 https://www.anaconda.com/download/

对数几率回归又名逻辑回归,名曰回归,实为分类,主要用于二分类问题(即输出只有两个类别)

- 线性模型(超通俗版最小二乘法https://blog.csdn.net/bitcarmanlee/article/details/51589143 对数几率回归https://blog.csdn.net/zjuPeco/article/details/77165974 )

- 误差符合正态分布,则误差的均值为0

- 从数学角度的处理来说,数学处理过程上绝对值比平方和要 复杂得多的多的多。

- 噪声数据,通俗点讲就是没啥屁用还碍事的数据。度娘的定义如是说,指数据中存在着错误或异常(偏离期望值)的数据,会对数据的分析造成干扰。负面影响eg:噪声干扰过大,引起过拟合问题,即记住了噪音特征,却忽略了正常的输入输出关系。

- 过拟合:学习器把训练样本自身的一些特点当做了所有潜在样本都会具有的一般性质,导致泛化性能下降。

- 欠拟合:对训练样本的一般性质都未学习好。

- 在概念角度上,最小二乘法等价于噪声为高斯分布的极大似然值(MLE Maximum Likelihood Estimate)

- 误差:学习器的实际预测输出与样本的真实输出之间的差异。

- 训练误差(又称经验误差):学习器在训练集上的误差。

- 泛化误差:在新样本上的误差。

- 向量不特意声明的话默认是列向量。

- 对于正题小陌(云里雾里)看完西瓜书之后,刷的视频,赶脚还不错 https://www.bilibili.com/video/av31989606?from=search&seid=1598298853277782473

- 算法如同对象,无关优劣,适合最重要。各大算法对眼的应用场景:

#持续更新ing