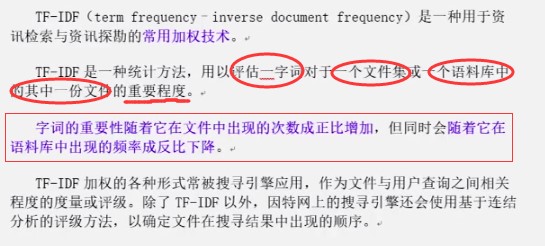

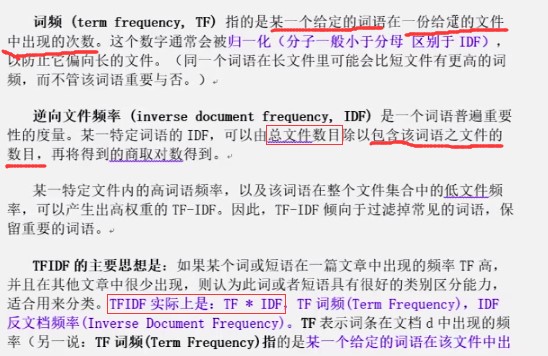

TF-IDF

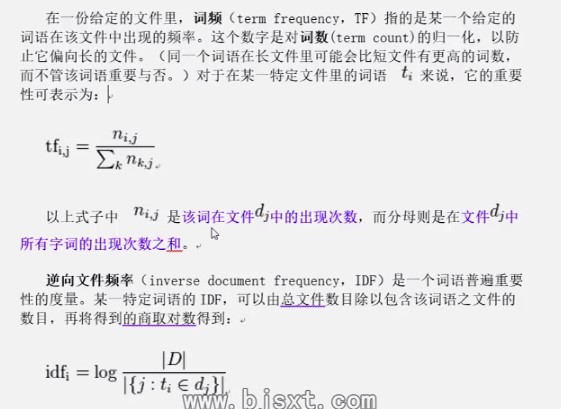

1. 概念

2. 原理

3. java代码实现思路

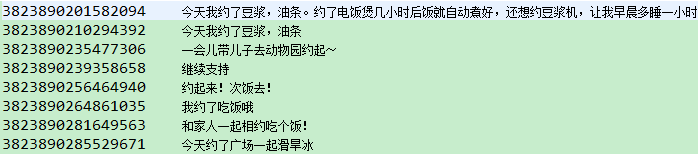

数据集:

三个MapReduce

第一个MapReduce:(利用ik分词器,将一篇博文,也就是一条记录中的content进行词的拆分)

第一个MapReduce最终运行的结果:

1. 得到数据集中微博的总数;

2. 得到每个词在当前所属微博的TF值

Mapper端:key:LongWritable(偏移量) value:3823890314914825 今天天气晴好,姐妹们约起,一起去逛街。

步骤一:拆分读取(按照'\t'), 得到id, content

步骤二:利用ik分词器对内容进行分词(今天,天气,姐妹),遍历分词结果,对分词结果中的每一个 词输出(w_id, 1)

步骤三:当对内容进行遍历完成之后,记录当前这一条微博,输出(count,1)

第一个MR自定义分区:extends HashPartitioner<Text, IntWritable>,重写getPartition

默认的分区规则:key.hash()%reduce的个数

这里对key的值进行判断,如果key.equals("count"),交给最后一个reduce,否则,交给reduceCount-1

Reducer端:第一种--key:w_id value:{1,1,1} 第二种--key:count value{1,1,1.....}

步骤一:将经过shuffle过程后的数据,进行整合(key相同的值为一组,对迭代器中的值进行遍历)

步骤二:将reduce后的结果进行写出,context.write(key, new IntWritable(sum))

!注意

因为这里在FirstJob中设置了Reduce的个数 (job.setNumReduceTasks(4)),所以最后会有 四个文件输出,而key=count又指定了Reduce,所以key:count value{1,1,1.....}在最后一个文 件,key:w_id value:{1,1,1}在前三个文件

第二个MapReduce: 从第一个MapReduce输出的结果中读取,作为本次的输入

第二个MapReduce最终运行的结果:

1. 得到每一个词在数据集中多少条微博中出现过,即DF值

Mapper端:key:LongWritable(偏移量) value:今天_3823890314914825 2

步骤一:获取当前mapper task的数据片段(split),根据FlieSplit的所属文件名进行判断,保证不是最后一个文 件(因为最后一个文件的内容是count 1075)

步骤二:这时mapper端输入的value值是今天_3823890314914825 2

对数据处理,按照“\t”切割,再按照“_”切割,输出context.write(今天,1)//注意这里将要统计的是包含今天的文件总数,所以不关注微博id

Reducer端:key:w value:{1,1,1} 数据样例:key=今天,value={1,1,1,1,1} //每一个1表示数据集中有一条微博包含今天这个词

步骤一:将经过shuffle过程后的数据,进行整合(key相同的值为一组,对迭代器中的值进行遍历)

步骤二:将reduce后的结果进行写出,context.write(key, new IntWritable(sum))

经过第二个MapReduce操作后,就获得了每一个词的df(document frequency)值

第三个MapReduce: 目的-->计算TF*IDF值

第三个MapReduce最终运行的结果:

1. 得到每一条微博中,每个词的TF-IDF值

结果样例:{3823890314914825 今天:2.78834 逛街:3.98071 姐妹:1.98712}

技巧:

第一个MapReduce输出的第四个文件(count 1075),计算每一个单词的TF-IDF值都需要用到,所以将这个文件在job运 行时加载到内存中以提高运行效率

第二个MapReduce输出的文件-->每一个单词在数据集中多少条微博出现过,即df值(今天 5),因为它里面包括常用的词 汇,不同于数据集,并不是很大也可以加载到内存,提高程序的执行效率

// 把微博总数加载到内存job.addCacheFile(newPath("/user/tfidf/output/weibo1/part-r-00003").toUri());// 把df加载到内存job.addCacheFile(newPath("/user/tfidf/output/weibo2/part-r-00000").toUri());

Mapper端:key:LongWritable(偏移量) value:今天_3823890314914825 2

步骤一:在正式执行map方法之前先执行setup(Context context)方法

目的:将加载到内存中的微博总数,以及DF值,封装到Map对象中(cmap,df),便于map的操作

步骤二:开始执行map操作,因为mapper端的输入是第一次MapReduce的输出,所以还需要进行判断,是否 是最后一个文件(count,1075)

对数据处理,按照“\t”切割,得到tf值-->v[1]=2,同时将v[0]按照“_”切割,得到单词(今 天)和微博id(3823890314914825)

从cmap中获取“count”,从df中获取该单词的df值,在根据该单词的tf值,计算该单词的TF*IDF值

double s = tf * Math.log(cmap.get("count") / df.get(w));

步骤三:将数据输出,key=微博的id,value=(w:tf*idf值)

Reducer端:key=微博的id, value=(w:tf*idf值)

数据样例:key=3823890314914825,value={今天:2.89101, 逛街:3.08092}

步骤一:将经过shuffle过程后的数据,进行整合(key相同的值为一组,对迭代器中的值进行遍历,定义StringBuffer,对迭代器中每一个单词以及对应的TF*IDF值拼接)

步骤二:将reduce后的结果进行写出,context.write(key, new Text(sb.toString()))

4. 商家如何做到精准营销?

经过以上过程,我们拿到的最终数据是3823890314914825 {今天:2.89101, 逛街:3.08092},即每一条微博中每个词的TF*IDF值

比如韩国料理要推送大骨汤,这时候只需要对数据集中的每一条微博中的每一个词对应的TFIDF值做一个降序,然后取前3位,

对整个数据集中的数据遍历,凡是TF*IDF值前三位包含大骨汤的,就是商家要推送的对象