2021-2022年寒假学习进度20

今天完成spark基础实验五

一、实验目的

(1)通过实验掌握Spark SQL 的基本编程方法;

(2) 熟悉RDD 到DataFrame 的转化方法;

(3) 熟悉利用Spark SQL 管理来自不同数据源的数据。

二、实验平台

操作系统: Ubuntu16.04 Spark 版本:2.1.0

数据库:MySQL

三、实验内容和要求

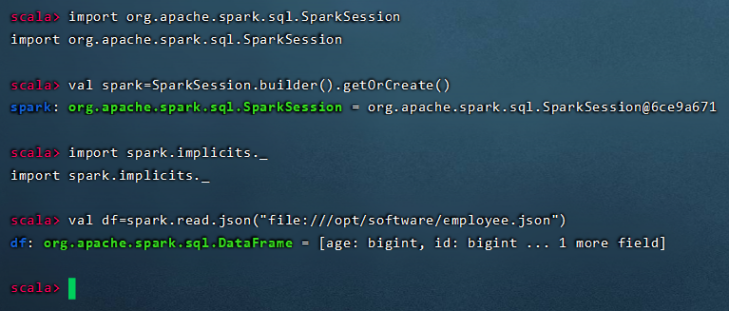

1. Spark SQL 基本操作

将下列JSON 格式数据复制到 Linux 系统中,并保存命名为 employee.json。

为 employee.json 创建DataFrame,并写出 Scala 语句完成下列操作:

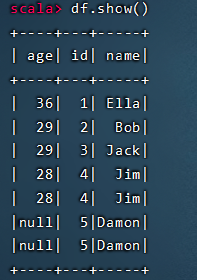

(1) 查询所有数据;

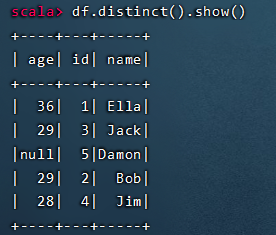

(2) 查询所有数据,并去除重复的数据;

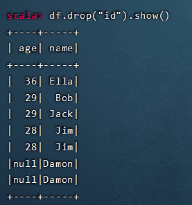

(3) 查询所有数据,打印时去除 id 字段;

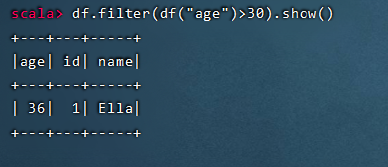

(4) 筛选出 age>30 的记录;

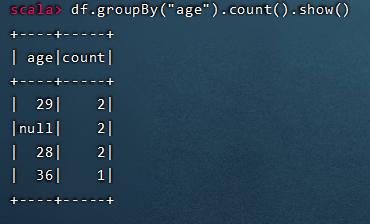

(5) 将数据按 age 分组;

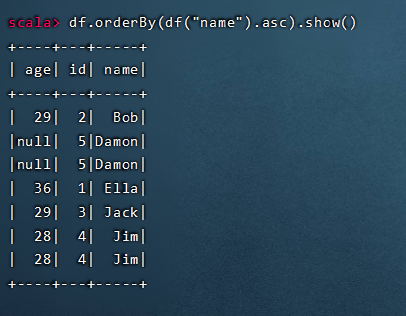

(6) 将数据按 name 升序排列;

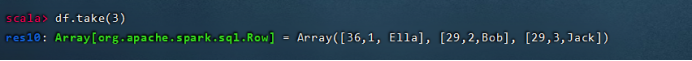

(7) 取出前 3 行数据;

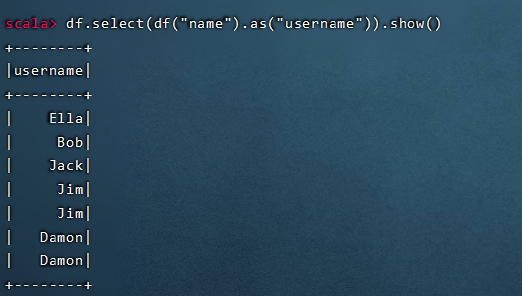

(8) 查询所有记录的 name 列,并为其取别名为 username;

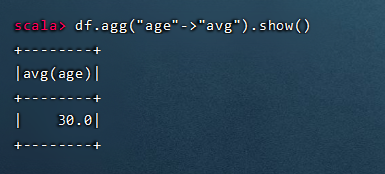

(9) 查询年龄 age 的平均值;

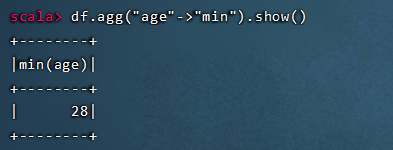

(10) 查询年龄 age 的最小值。

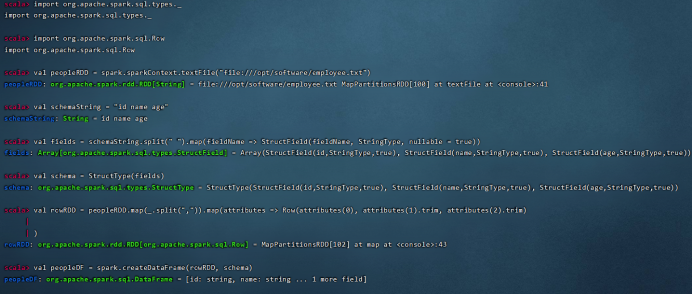

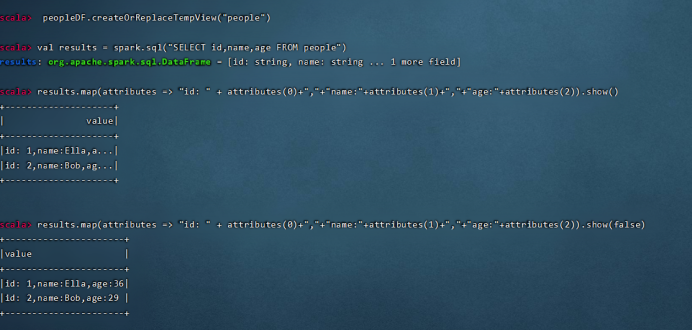

2. 编程实现将 RDD 转换为 DataFrame

源文件内容如下(包含 id,name,age):

请将数据复制保存到 Linux 系统中,命名为 employee.txt,实现从 RDD 转换得到

DataFrame,并按“id:1,name:Ella,age:36”的格式打印出 DataFrame 的所有数据。请写出程序代码。

源码:

|

import org.apache.spark.sql.types._ import org.apache.spark.sql.Row val peopleRDD = spark.sparkContext.textFile("file:///opt/software/employee.txt") val schemaString = "id name age" val fields = schemaString.split(" ").map(fieldName => StructField(fieldName, StringType, nullable = true)) val schema = StructType(fields) val rowRDD = peopleRDD.map(_.split(",")).map(attributes => Row(attributes(0), attributes(1).trim, attributes(2).trim)) val peopleDF = spark.createDataFrame(rowRDD, schema) peopleDF.createOrReplaceTempView("people") val results = spark.sql("SELECT id,name,age FROM people") results.map(attributes => "id: " + attributes(0)+","+"name:"+attributes(1)+","+"age:"+attributes(2)).show(false) |

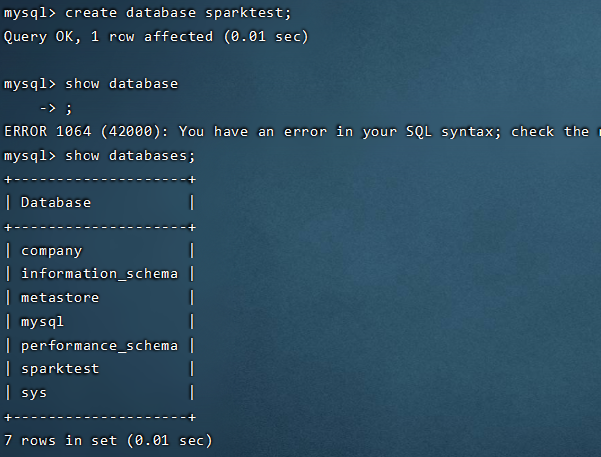

3. 编程实现利用 DataFrame 读写 MySQL 的数据

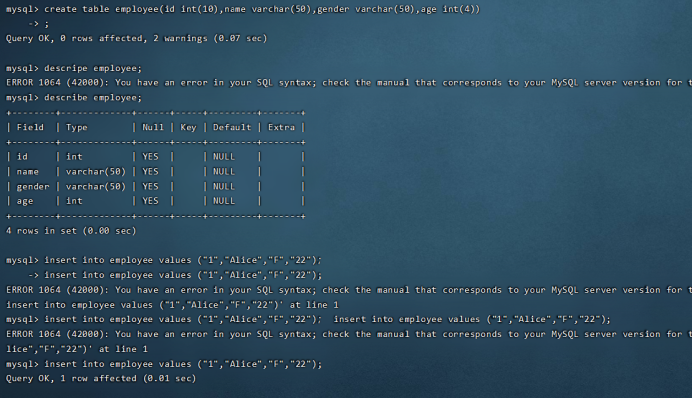

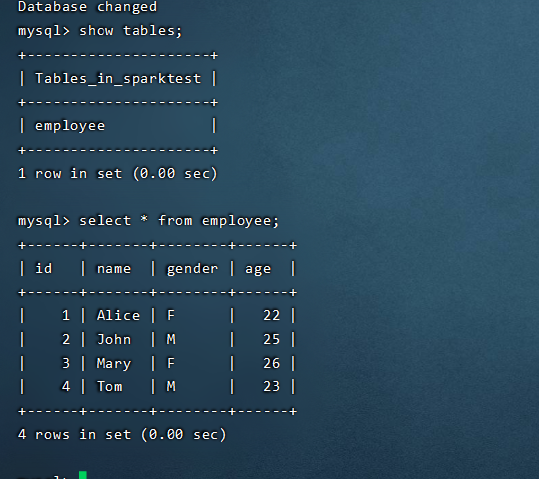

(1) 在 MySQL 数据库中新建数据库 sparktest,再创建表 employee,包含如表 6-2 所示的两行数据。

表 6-2 employee 表原有数据

|

id |

name |

gender |

Age |

|

1 |

Alice |

F |

22 |

|

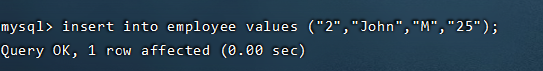

2 |

John |

M |

25 |

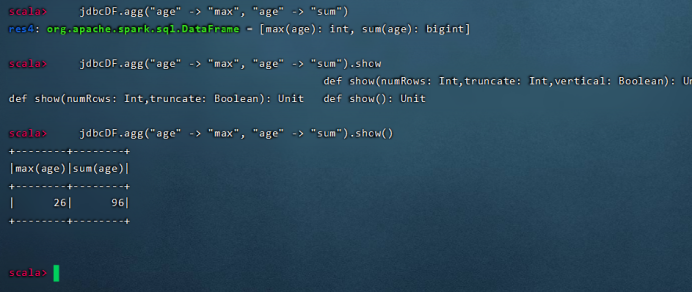

(2) 配置 Spark 通过 JDBC 连接数据库MySQL,编程实现利用DataFrame 插入如表 6-3 所示的两行数据到MySQL 中,最后打印出 age 的最大值和 age 的总和。

表 6-3 employee 表新增数据

|

id |

name |

gender |

age |

|

|

3 |

Mary |

F |

26 |

|

|

4 |

Tom |

M |

23 |

|

|

package spark.core.exper05 |

||||

浙公网安备 33010602011771号

浙公网安备 33010602011771号