大数据专栏 - 基础1 Hadoop安装配置

Hadoop安装配置

环境

1, JDK8 --> 位置: /opt/jdk8

2, Hadoop2.10: --> 位置: /opt/bigdata/hadoop210

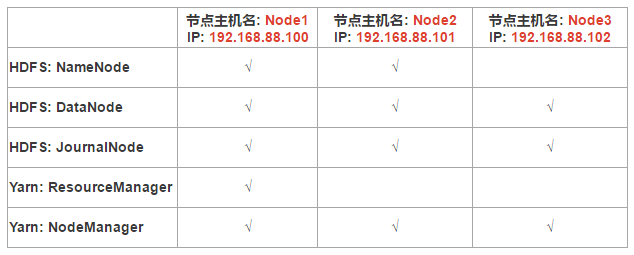

3, CentOS 7虚拟机试验集群规划

一,安装步骤

1, 解压缩

cd /opt/bigdata

tar -zxvf hadoop-2.10.1.tar.gz

mv ./hadoop-2.10.1 hadoop210

2, 配置

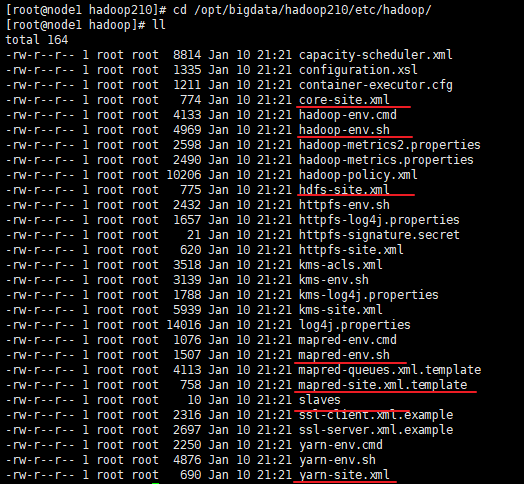

cd /opt/bigdata/hadoop210/etc/hadoop/

2.1 修改hadoop-env.sh

[root@node1 hadoop27]# echo $JAVA_HOME

/opt/jdk8

vim hadoop-env.sh

export JAVA_HOME=/opt/jdk8

2.2 修改core-site.xml

[root@node1 hadoop210]# pwd

/opt/bigdata/hadoop210

[root@node1 hadoop210]# mkdir hadoopDatas

[root@node1 hadoop210]# cd /opt/bigdata/hadoop210/etc/hadoop/

[root@node1 hadoop210]# vim core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://node1:8020</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/bigdata/hadoop210/hadoopDatas/tempDatas</value>

</property>

<!-- 缓冲区大小,实际工作中根据服务器性能动态调整 -->

<property>

<name>io.file.buffer.size</name>

<value>4096</value>

</property>

<!-- 开启hdfs的垃圾桶机制,删除掉的数据可以从垃圾桶中回收,单位分钟 -->

<property>

<name>fs.trash.interval</name>

<value>10080</value>

</property>

</configuration>

2.3 修改hdfs-site.xml

[root@node1 hadoop]# cd /opt/bigdata/hadoop210/etc/hadoop/

[root@node1 hadoop]# vi hdfs-site.xml

<configuration>

<property>

<name>dfs.namenode.secondary.http-address</name>

<value>node1:50090</value>

</property>

<property>

<name>dfs.namenode.http-address</name>

<value>node1:50070</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:///opt/bigdata/hadoop210/hadoopDatas/namenodeDatas</value>

</property>

<!-- 定义dataNode数据存储的节点位置,实际工作中,一般先确定磁盘的挂载目录,然后多个目录用,进行分割 -->

<property>

<name>dfs.datanode.data.dir</name>

<value>file:///opt/bigdata/hadoop210/hadoopDatas/datanodeDatas</value>

</property>

<property>

<name>dfs.namenode.edits.dir</name>

<value>file:///opt/bigdata/hadoop210/hadoopDatas/nn/edits</value>

</property>

<property>

<name>dfs.namenode.checkpoint.dir</name>

<value>file:///opt/bigdata/hadoop210/hadoopDatas/snn/name</value>

</property>

<property>

<name>dfs.namenode.checkpoint.edits.dir</name>

<value>file:///opt/bigdata/hadoop210/hadoopDatas/dfs/snn/edits</value>

</property>

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<property>

<name>dfs.permissions</name>

<value>false</value>

</property>

<property>

<name>dfs.blocksize</name>

<value>134217728</value>

</property>

</configuration>

2.4 修改yarn-site.xml

[root@node1 hadoop]# vi yarn-site.xml

<configuration>

<property>

<name>yarn.resourcemanager.hostname</name>

<value>node1</value>

</property>

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<property>

<name>yarn.log-aggregation.retain-seconds</name>

<value>604800</value>

</property>

<property>

<name>yarn.nodemanager.resource.memory-mb</name>

<value>20480</value>

</property>

<property>

<name>yarn.scheduler.minimum-allocation-mb</name>

<value>2048</value>

</property>

<property>

<name>yarn.nodemanager.vmem-pmem-ratio</name>

<value>2.1</value>

</property>

</configuration>

2.5 修改mapred-env.sh

[root@node1 hadoop]# vi mapred-env.sh

export JAVA_HOME=/opt/jdk8

2.6 修改mapred-site.xml

[root@node1 hadoop]# mv mapred-site.xml.template ./mapred-site.xml

[root@node1 hadoop]# vi mapred-site.xml

<configuration>

<property>

<name>mapreduce.job.ubertask.enable</name>

<value>true</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>node1:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>node1:19888</value>

</property>

</configuration>

2.7 修改slaves

[root@node1 hadoop]# vi slaves

node1

node2

node3

2.8 配置Hadoop环境变量

[root@node1 hadoop]# vi /etc/profile

export HADOOP_HOME=/opt/bigdata/hadoop210

export PATH=:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$FINDBUGS_HOME/bin:$MAVEN_HOME/bin:$JAVA_HOME/bin:$PATH

[root@node1 hadoop]# source /etc/profile

2.9 分发安装包

[root@node1 hadoop210]# cd /opt/bigdata/hadoop210/

[root@node1 hadoop210]# scp -r hadoop210 node2:$PWD

[root@node1 hadoop210]# scp -r hadoop210 node3:$PWD

[root@node1 hadoop210]# scp /etc/profile node2:/etc/

[root@node1 hadoop210]# scp /etc/profile node3:/etc/

分别在node2,node3节点机器执行以下命令: 刷新加载/etc/profile

source /etc/profile

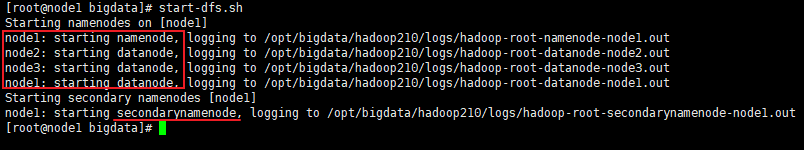

3, 启动集群

前提: 3台机器上安装好了zookeeper, 并启动

zkServer.sh start

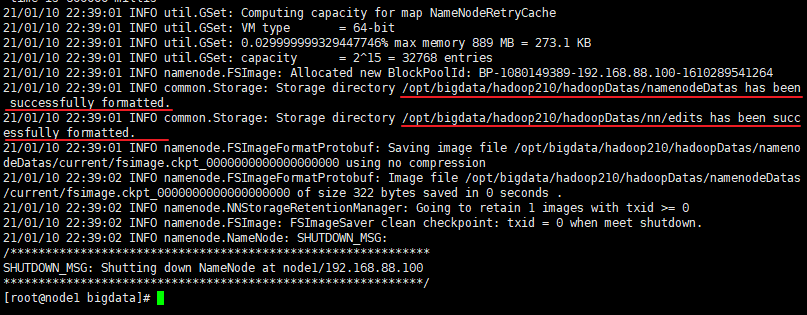

要启动 Hadoop 集群,需要启动 HDFS 和 YARN 两个模块。 注意: 首次启动 HDFS 时,必须对其进行格式化操作。 本质上是一些清理和 准备工作,因为此时的 HDFS 在物理上还是不存在的。

在node1节点机器执行以下命令

[root@node1 bigdata]# hdfs namenode -format

[root@node1 bigdata]# start-dfs.sh

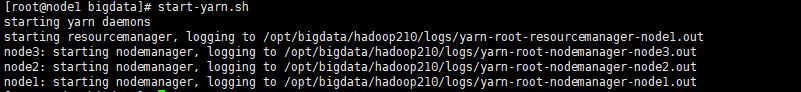

[root@node1 bigdata]# start-yarn.sh

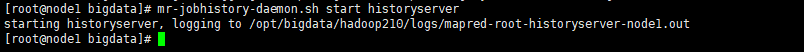

[root@node1 bigdata]# mr-jobhistory-daemon.sh start historyserver

启动完成之后, 可以通过jsp查看

欢迎读者留言板留下您的技术见解, 一起讨论, 共同提高, 小马哥随时看到回复.

浙公网安备 33010602011771号

浙公网安备 33010602011771号