关于sqoop增量导入oracle的数据到HDFS的出现的错误总结

今天在将公司的oracle的数据抽取到hive当中,根据时间字段做增量插入,然后合并采用按照id唯一主键的方式进行合并操作。

下面的代码是增量导入的操作shell脚本

#!/bin/bash datenow=$(date -d 'last day' -I) databases=("FRONTBANK") sqoop import \ --connect jdbc:oracle:thin:自己的数据库ip:1521:zdxdb \ --username frontbank \ --password sdff23s \ --table FRONTBANK.INCREAT_TABLE \ --fields-terminated-by "\t" \ --incremental lastmodified \ #这个配置项是对导入的数据做插入和更新操作 --check-column MODIFY_TIME \ #这个配置项是按照数据表中的某个字段定位要读取的数据的位置 --last-value ${datenow} \ #这个配置项是加载最后一个导入数据到现在这段时间新增的数据,然后进行导入操作 --merge-key ID \ #这个配置项是对导入进来的数据进行合并的操作,这里是采用唯一主键的方式对数据进行合并操作 --hive-drop-import-delims \ -m 1 \ --target-dir /user/gxg/increment

在导入数据的过程中遇到的问题如下:

第一次在shell脚本当中执行的时候,出现了下面的问题

ERROR tool.ImportTool: Import failed: java.io.IOException: Could not load jar /tmp/sqoop-root/compile/42f2af520ed13e2dc948a98222d69466/FRONTBANK.INCREAT_TABLE.jar into JVM. (Could not find class FRONTBANK.INCREAT_TABLE.)

at org.apache.sqoop.util.ClassLoaderStack.addJarFile(ClassLoaderStack.java:92)

at com.cloudera.sqoop.util.ClassLoaderStack.addJarFile(ClassLoaderStack.java:36)

at org.apache.sqoop.tool.ImportTool.loadJars(ImportTool.java:120)

at org.apache.sqoop.tool.ImportTool.lastModifiedMerge(ImportTool.java:456)

at org.apache.sqoop.tool.ImportTool.importTable(ImportTool.java:522)

at org.apache.sqoop.tool.ImportTool.run(ImportTool.java:621)

at org.apache.sqoop.Sqoop.run(Sqoop.java:147)

at org.apache.hadoop.util.ToolRunner.run(ToolRunner.java:70)

at org.apache.sqoop.Sqoop.runSqoop(Sqoop.java:183)

at org.apache.sqoop.Sqoop.runTool(Sqoop.java:234)

at org.apache.sqoop.Sqoop.runTool(Sqoop.java:243)

at org.apache.sqoop.Sqoop.main(Sqoop.java:252)

Caused by: java.lang.ClassNotFoundException: FRONTBANK.INCREAT_TABLE

at java.net.URLClassLoader$1.run(URLClassLoader.java:366)

at java.net.URLClassLoader$1.run(URLClassLoader.java:355)

at java.security.AccessController.doPrivileged(Native Method)

at java.net.URLClassLoader.findClass(URLClassLoader.java:354)

at java.lang.ClassLoader.loadClass(ClassLoader.java:425)

at java.net.FactoryURLClassLoader.loadClass(URLClassLoader.java:789)

at java.lang.ClassLoader.loadClass(ClassLoader.java:358)

at java.lang.Class.forName0(Native Method)

at java.lang.Class.forName(Class.java:270)

at org.apache.sqoop.util.ClassLoaderStack.addJarFile(ClassLoaderStack.java:88)

这里显示在merger的时候找不到类,而且没这个jar包,但是在启动日志中明明有加载这个包和这个类的操作。然后找资料说采用codegen的方式。但是各种报错。

然后在想是不是数据包不共享造成的,于是我将脚本部署在oozie的工作流调度当中。居然可以可以运行,这个问题的原因应该是上传的包在本地,然而其他的机器加载不到这个包所以类不存在了。

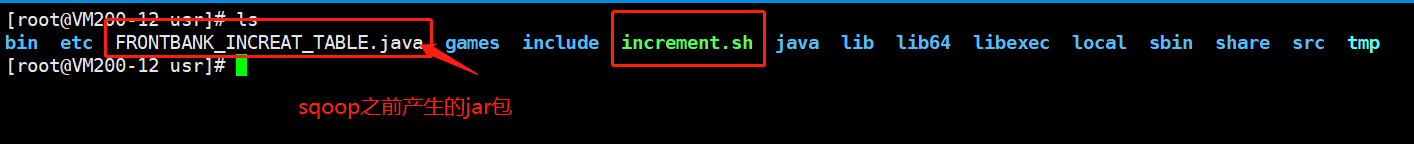

说到这里多提一句,在我们提交sqooop脚本的时候,会在本地产生一个jar包

当我们在集群上执行sqoop脚本的的时候,相当于数据目录共享。所以不存在数据加载不到的问题。

第二个问题:

2019-01-08 17:03:35,929 INFO [IPC Server handler 2 on 37215] org.apache.hadoop.mapred.TaskAttemptListenerImpl: Diagnostics report from attempt_1546053074766_0184_m_000001_0:

Error: java.io.IOException: Cannot join values on null key. Did you specify a key column that exists? at org.apache.sqoop.mapreduce.MergeMapperBase.processRecord(MergeMapperBase.java:79) at org.apache.sqoop.mapreduce.MergeTextMapper.map(MergeTextMapper.java:58) at org.apache.sqoop.mapreduce.MergeTextMapper.map(MergeTextMapper.java:34) at org.apache.hadoop.mapreduce.Mapper.run(Mapper.java:145) at org.apache.hadoop.mapred.MapTask.runNewMapper(MapTask.java:793) at org.apache.hadoop.mapred.MapTask.run(MapTask.java:341) at org.apache.hadoop.mapred.YarnChild$2.run(YarnChild.java:164) at java.security.AccessController.doPrivileged(Native Method) at javax.security.auth.Subject.doAs(Subject.java:415) at org.apache.hadoop.security.UserGroupInformation.doAs(UserGroupInformation.java:1917) at org.apache.hadoop.mapred.YarnChild.main(YarnChild.java:158)

出现这个问题的主要原因有两点

(1)你设置合并的字段不是主键的形式,一定要设置成为主键

(2)第二点注意大小写的问题。我的问题就是我的主键的字段是大写的ID,我写成了这样 --merge-key id \

下面总结一下对于sqoop增量导入的总结:

在整个的sqooop导入操作中需要注意两个东西,第一个就是我们的需要准备一个更新的字段(时间日期字段),第二个就是合并的字段负责更新数据的更新操作。其他的应该就没有问题了

这里补充一点,我们只能定义数据目录,不能直接将数据导入到hive当中否则会报下面的错:

--incremental lastmodified option for hive imports is not supported. Please remove the parameter --incremental lastmodified.

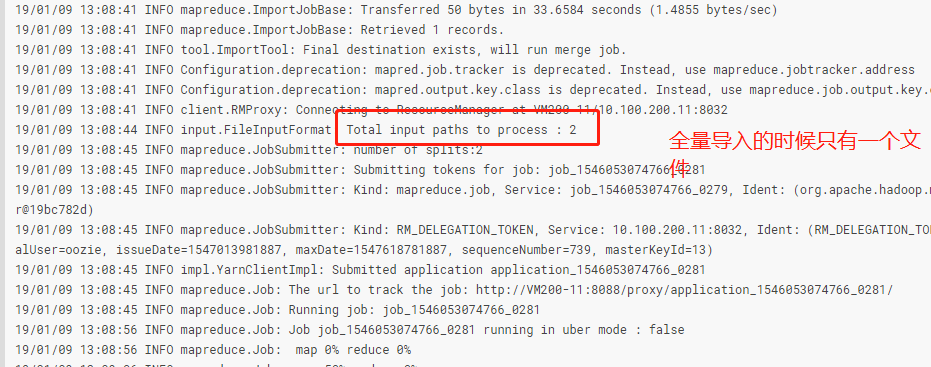

这里需要补充另外一点,在我们增量导入的时候是分两步走的

(1)将新增的数据导入进来 (这里可以指定导入的map数,也就是指定的并行读)

(2)合并新导入的数据和之前的数据,这个过程有一点需要注意,我们在第一次全量导入数据的时候,指定的map数也就是最终形成的文件数。在合并的时候,他启动的map的数量是文件数目的n+1个

浙公网安备 33010602011771号

浙公网安备 33010602011771号