【NeurIPS2022】Cross Aggregation Transformer for Image Restoration

【NeurIPS2022】Cross Aggregation Transformer for Image Restoration

研究动机:当前方法 Transformer 方法把图像分成8x8的小块处理,the square window lacks inter-window interaction, leading to the slow increase of the receptive field。同时,the channel-wise attention mechanism may lose some spatial information。影响了 Transformer 方法在图像修复里的应用。

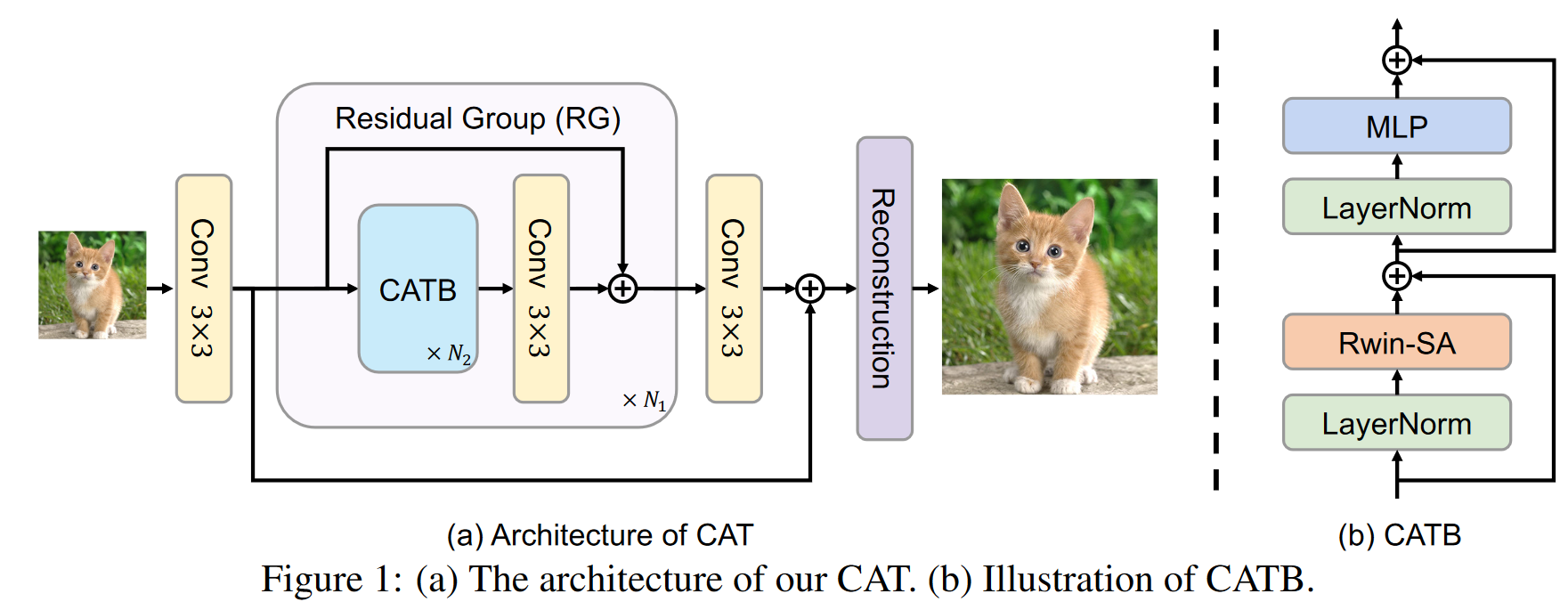

为此,作者提出了 Cross Aggregation Transformer,架构如下图所示,主干网络为RCAN(超分辨率中用的非常多的网络),中间是多个 CAT block 的堆叠。CAT block 的核心是作者提出的注意力机制:Rectangle-Window Self-Attention(Rwin-SA)。

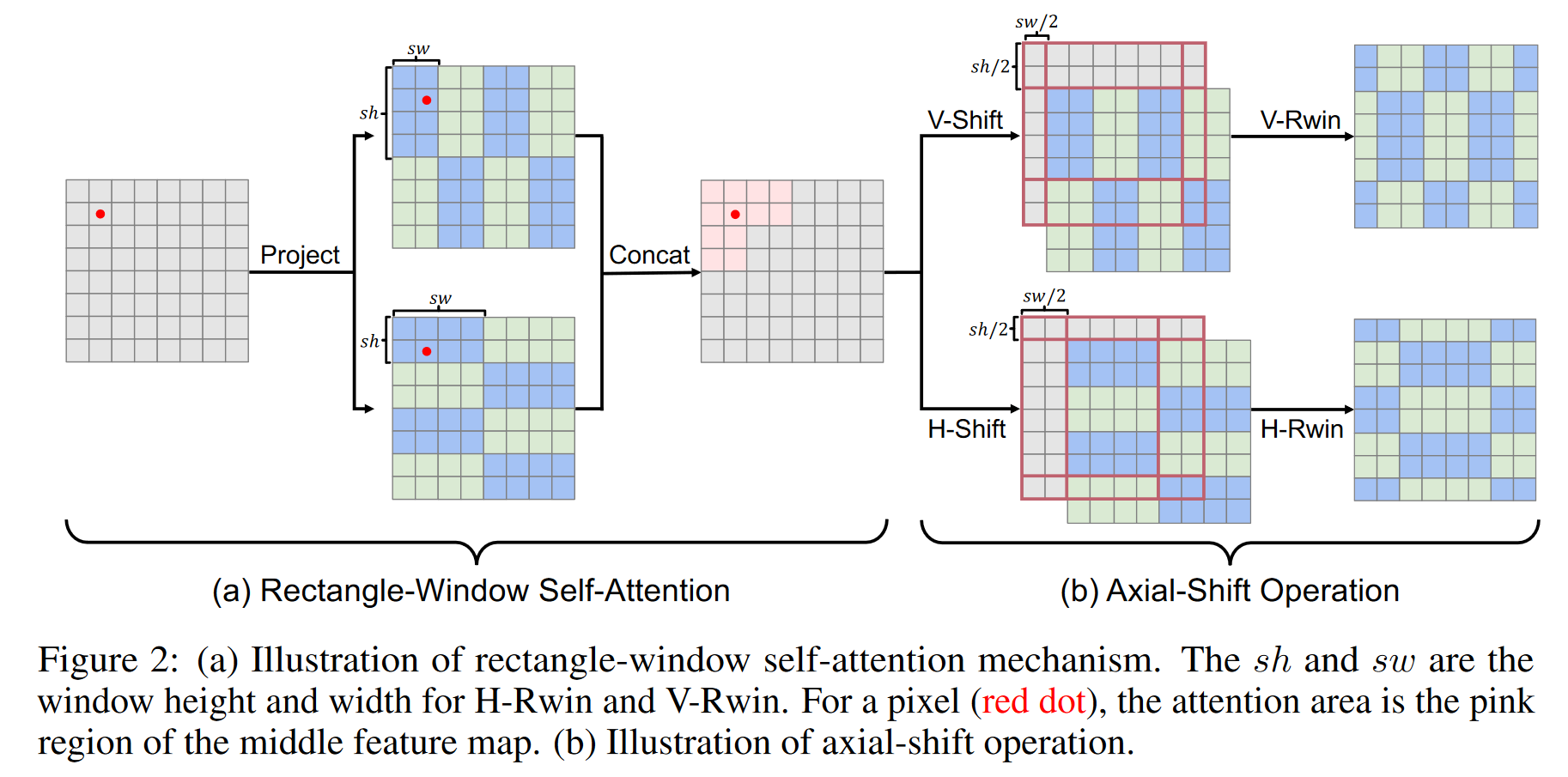

1、 Rectangle-Window Self-Attention

Rwin-SA如下图所示,使用的是矩形的窗口,而不是正方形的窗口。窗口的宽度和高度分别为 sw 和 sh。此外,还使用 axis-shift 实现窗口间信息的交互。

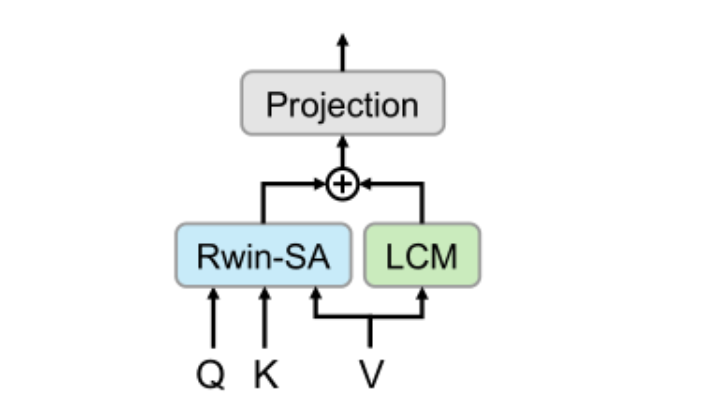

2、Locality Complementary Module

作者在计算注意力时,添加了一个独立的卷积运算,称为 Locality complementary module,如下图所示,其实就是在V上加了一个卷积,attention 的结果和 卷积融合。

浙公网安备 33010602011771号

浙公网安备 33010602011771号