[原创]利用爬虫技术获取网页数据,以及想要的指定数据

最近在公司做个系统,由于要获取网页的一些数据,以及一些网页的数据,所以就写的一个公用的HttpUtils.下面是针对乌云网我写的一个例子。

一、首先是获取指定路径下的网页内容。

public static String httpGet(String urlStr, Map<String, String> params) throws Exception {

StringBuilder sb = new StringBuilder();

if (null != params && params.size() > 0) {

sb.append("?");

Entry<String, String> en;

for (Iterator<Entry<String, String>> ir = params.entrySet().iterator(); ir.hasNext();) {

en = ir.next();

sb.append(en.getKey() + "=" + URLEncoder.encode(en.getValue(),"utf-8") + (ir.hasNext() ? "&" : ""));

}

}

URL url = new URL(urlStr + sb);

HttpURLConnection conn = (HttpURLConnection) url.openConnection();

conn.setConnectTimeout(5000);

conn.setReadTimeout(5000);

conn.setRequestMethod("GET");

if (conn.getResponseCode() != 200)

throw new Exception("请求异常状态值:" + conn.getResponseCode());

BufferedInputStream bis = new BufferedInputStream(conn.getInputStream());

Reader reader = new InputStreamReader(bis,"gbk");

char[] buffer = new char[2048];

int len = 0;

CharArrayWriter caw = new CharArrayWriter();

while ((len = reader.read(buffer)) > -1)

caw.write(buffer, 0, len);

reader.close();

bis.close();

conn.disconnect();

//System.out.println(caw);

return caw.toString();

}

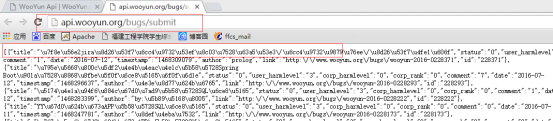

浏览器询问结果:

代码询问结果与上面一致:

二、通过指定url获取,网页部分想要的数据。

对于这个方法,要导入Jsoup包,这个可以自己在网上下载。

Document doc = null;

try {

doc = Jsoup.connect("http://www.wooyun.org//bugs//wooyun-2016-0225856").userAgent("Mozilla/5.0 (Windows NT 10.0; Trident/7.0; rv:11.0) like Gecko").timeout(30000).get();

} catch (IOException e) {

e.printStackTrace();

}

for(Iterator<Element> ir = doc.select("h3").iterator();ir.hasNext();){

System.out.println(ir.next().text());

}

对于那个select选择器,根据条件来选择,doc.select("h3").iterator(),对于Jsoup有以下规则:

jsoup 是一款基于Java 的HTML解析器,可直接解析某个URL地址或HTML文本内容。它提供了一套非常省力的API,可通过DOM,CSS以及类似于jQuery的操作方法来取出和操作数据。

jsoup的强大在于它对文档元素的检索,Select方法将返回一个Elements集合,并提供一组方法来抽取和处理结果,要掌握Jsoup首先要熟悉它的选择器语法。

1、Selector选择器基本语法

- tagname: 通过标签查找元素,比如:a

- ns|tag: 通过标签在命名空间查找元素,比如:可以用 fb|name 语法来查找 <fb:name> 元素

- #id: 通过ID查找元素,比如:#logo

- .class: 通过class名称查找元素,比如:.masthead

- [attribute]: 利用属性查找元素,比如:[href]

- [^attr]: 利用属性名前缀来查找元素,比如:可以用[^data-] 来查找带有HTML5 Dataset属性的元素

- [attr=value]: 利用属性值来查找元素,比如:[width=500]

- [attr^=value], [attr$=value], [attr*=value]: 利用匹配属性值开头、结尾或包含属性值来查找元素,比如:[href*=/path/]

- [attr~=regex]: 利用属性值匹配正则表达式来查找元素,比如: img[src~=(?i)\.(png|jpe?g)]

- *: 这个符号将匹配所有元素

2、Selector选择器组合使用语法

- el#id: 元素+ID,比如: div#logo

- el.class: 元素+class,比如: div.masthead

- el[attr]: 元素+class,比如: a[href]

- 任意组合,比如:a[href].highlight

- ancestor child: 查找某个元素下子元素,比如:可以用.body p 查找在”body”元素下的所有 p元素

- parent > child: 查找某个父元素下的直接子元素,比如:可以用div.content > p 查找 p 元素,也可以用body > * 查找body标签下所有直接子元素

- siblingA + siblingB: 查找在A元素之前第一个同级元素B,比如:div.head + div

- siblingA ~ siblingX: 查找A元素之前的同级X元素,比如:h1 ~ p

- el, el, el:多个选择器组合,查找匹配任一选择器的唯一元素,例如:div.masthead, div.logo

3、Selector伪选择器语法

- :lt(n): 查找哪些元素的同级索引值(它的位置在DOM树中是相对于它的父节点)小于n,比如:td:lt(3) 表示小于三列的元素

- :gt(n):查找哪些元素的同级索引值大于n,比如: div p:gt(2)表示哪些div中有包含2个以上的p元素

- :eq(n): 查找哪些元素的同级索引值与n相等,比如:form input:eq(1)表示包含一个input标签的Form元素

- :has(seletor): 查找匹配选择器包含元素的元素,比如:div:has(p)表示哪些div包含了p元素

- :not(selector): 查找与选择器不匹配的元素,比如: div:not(.logo) 表示不包含 class="logo" 元素的所有 div 列表

- :contains(text): 查找包含给定文本的元素,搜索不区分大不写,比如: p:contains(jsoup)

- :containsOwn(text): 查找直接包含给定文本的元素

- :matches(regex): 查找哪些元素的文本匹配指定的正则表达式,比如:div:matches((?i)login)

- :matchesOwn(regex): 查找自身包含文本匹配指定正则表达式的元素

注意:上述伪选择器索引是从0开始的,也就是说第一个元素索引值为0,第二个元素index为1等。

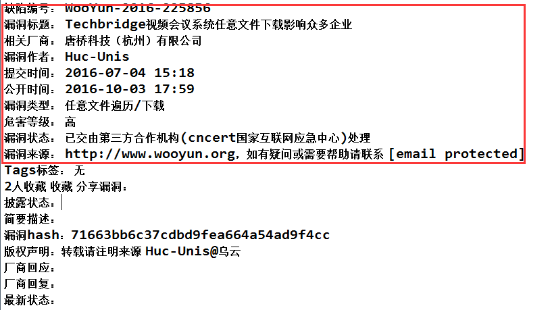

浏览器访问:

代码访问:

源代码HttpUtils.java:

package com.ffcs.lsoc.bug.utils;

import java.io.BufferedInputStream;

import java.io.CharArrayWriter;

import java.io.InputStreamReader;

import java.io.Reader;

import java.net.HttpURLConnection;

import java.net.URL;

import java.net.URLEncoder;

import java.util.Iterator;

import java.util.Map;

import java.util.Map.Entry;

import org.jsoup.nodes.Document;

import org.jsoup.nodes.Element;

/**

* 抓取网页工具类

* @author g-gaojp

* @date 2016-7-10

*/

public class HttpUtils {

/**

* 获取网页数据

* @param urlStr 访问地址

* @param params 参数

* @param charset 字符编码

* @return

* @throws Exception

*/

public static String httpGet(String urlStr, Map<String, String> params,String charset) throws Exception {

StringBuilder sb = new StringBuilder();

if (null != params && params.size() > 0) {

sb.append("?");

Entry<String, String> en;

for (Iterator<Entry<String, String>> ir = params.entrySet().iterator(); ir.hasNext();) {

en = ir.next();

sb.append(en.getKey() + "=" + URLEncoder.encode(en.getValue(),"utf-8") + (ir.hasNext() ? "&" : ""));

}

}

URL url = new URL(urlStr + sb);

HttpURLConnection conn = (HttpURLConnection) url.openConnection();

conn.setConnectTimeout(5000);

conn.setReadTimeout(5000);

conn.setRequestMethod("GET");

if (conn.getResponseCode() != 200){

throw new Exception("请求异常状态值:" + conn.getResponseCode());

}

BufferedInputStream bis = new BufferedInputStream(conn.getInputStream());

Reader reader = new InputStreamReader(bis,charset);

char[] buffer = new char[2048];

int len = 0;

CharArrayWriter caw = new CharArrayWriter();

while ((len = reader.read(buffer)) > -1)

caw.write(buffer, 0, len);

reader.close();

bis.close();

conn.disconnect();

return caw.toString();

}

/**

* 获取网页数据

* @param urlStr 访问地址

* @param params 参数

* @return

* @throws Exception

*/

public static String httpGet(String urlStr, Map<String, String> params) throws Exception {

StringBuilder sb = new StringBuilder();

if (null != params && params.size() > 0) {

sb.append("?");

Entry<String, String> en;

for (Iterator<Entry<String, String>> ir = params.entrySet().iterator(); ir.hasNext();) {

en = ir.next();

sb.append(en.getKey() + "=" + URLEncoder.encode(en.getValue(),"utf-8") + (ir.hasNext() ? "&" : ""));

}

}

URL url = new URL(urlStr + sb);

HttpURLConnection conn = (HttpURLConnection) url.openConnection();

conn.setConnectTimeout(5000);

conn.setReadTimeout(5000);

conn.setRequestMethod("GET");

if (conn.getResponseCode() != 200)

throw new Exception("请求异常状态值:" + conn.getResponseCode());

BufferedInputStream bis = new BufferedInputStream(conn.getInputStream());

Reader reader = new InputStreamReader(bis,"gbk");

char[] buffer = new char[2048];

int len = 0;

CharArrayWriter caw = new CharArrayWriter();

while ((len = reader.read(buffer)) > -1)

caw.write(buffer, 0, len);

reader.close();

bis.close();

conn.disconnect();

//System.out.println(caw);

return caw.toString();

}

/**

* 从获得的网页的document中获取指定条件的内容

* @param document

* @param condition 条件

* @return

*/

public static String catchInfomationFromDocument(Document document , String condition , int position){

if(document != null){

Iterator<Element> iterator = document.select(condition).iterator();

if(iterator.hasNext()){

String str = iterator.next().text();

return str.substring(position).trim();

}

}

return null;

}

/**

* 判断从获得的网页的document中<br/>

* 获取指定条件的内容是否存在

* @param document

* @param condition 条件

* @return

*/

public static boolean isExistInfomation(Document document , String condition){

if(document != null){

Iterator<Element> iterator = document.select(condition).iterator();

if(iterator.hasNext()){

return true;

}

}

return false;

}

}

浙公网安备 33010602011771号

浙公网安备 33010602011771号