13-垃圾邮件分类2

1.读取

file_path = r'C:\Users\86186\Desktop\大三下\机器学习\SMSSpamCollection' sms = open(file_path, 'r', encoding='utf-8') sms_data = [] sms_label = [] csv_reader = csv.reader(sms, delimiter='\t') for line in csv_reader: sms_label.append(line[0]) sms_data.append(preprocessing(line[1])) # 对每封邮件进行预处理 sms.close()

2.数据预处理

def get_wordnet_pos(treebank_tag): if treebank_tag.startswith('J'): # 形容词 return nltk.corpus.wordnet.ADJ elif treebank_tag.startswith('V'): # 动词 return nltk.corpus.wordnet.VERB elif treebank_tag.startswith('N'): # 名词 return nltk.corpus.wordnet.NOUN elif treebank_tag.startswith('R'): # 副词 return nltk.corpus.wordnet.ADV else: return nltk.corpus.wordnet.NOUN def preprocessing(text): tokens = [word for sent in nltk.sent_tokenize(text) for word in nltk.word_tokenize(sent)] # 分词 stops = stopwords.words('english') tokens = [token for token in tokens if token not in stops] # 去掉停用词 tokens = [token.lower() for token in tokens if len(token) >= 3] tag = nltk.pos_tag(tokens) # 标注词性 lemmatizer = WordNetLemmatizer() # 词性还原 tokens = [lemmatizer.lemmatize(token, pos=get_wordnet_pos(tag[i][1])) for i, token in enumerate(tokens)] # 词性还原 preprocessed_text = ''.join(tokens) return preprocessed_text

3.数据划分—训练集和测试集数据划分

from sklearn.model_selection import train_test_split

x_train,x_test, y_train, y_test = train_test_split(data, target, test_size=0.2, random_state=0, stratify=y_train)

x_train, x_test, y_train, y_test = train_test_split(sms_data, sms_label, test_size=0.2, stratify=sms_label) print('总集:', len(sms_label)) print('训练集:', len(x_train)) print('测试集:', len(y_test))

4.文本特征提取

sklearn.feature_extraction.text.CountVectorizer

sklearn.feature_extraction.text.TfidfVectorizer

from sklearn.feature_extraction.text import TfidfVectorizer

tfidf2 = TfidfVectorizer()

观察邮件与向量的关系

向量还原为邮件

tfidf2 = TfidfVectorizer() X_train = tfidf2.fit_transform(x_train) X_test = tfidf2.transform(x_test) print(X_train.toarray().shape) print(X_test.toarray().shape)

4.模型选择

from sklearn.naive_bayes import GaussianNB

from sklearn.naive_bayes import MultinomialNB

说明为什么选择这个模型?

选择的模型是多项式 因为单词出现的频率不适用高斯模型的正态分布。

mnb = MultinomialNB() mnb.fit(X_train, y_train) y_mnb = mnb.predict(X_test) print('预测结果:', y_mnb) print('实际结果:', y_test)

5.模型评价:混淆矩阵,分类报告

from sklearn.metrics import confusion_matrix

confusion_matrix = confusion_matrix(y_test, y_predict)

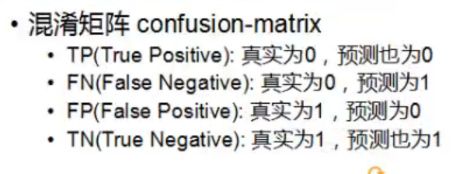

说明混淆矩阵的含义

from sklearn.metrics import classification_report

说明准确率、精确率、召回率、F值分别代表的意义

cm = confusion_matrix(y_test, y_mnb) print("混淆矩阵", cm) cr = classification_report(y_test, y_mnb) print("分类报告", cr) print("精确率", (cm[0][0]+cm[1]

混淆矩阵的含义:混淆矩阵是可视化工具,特别用于监督学习,在无监督学习中一般叫做匹配矩阵。在图像精度评价中,主要用于比较分类结果和实际测得值,可以把分类结果的精度显示在一个混淆矩阵里面。

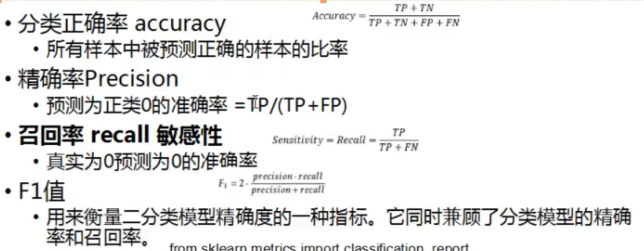

代码运行结果如图

6.比较与总结

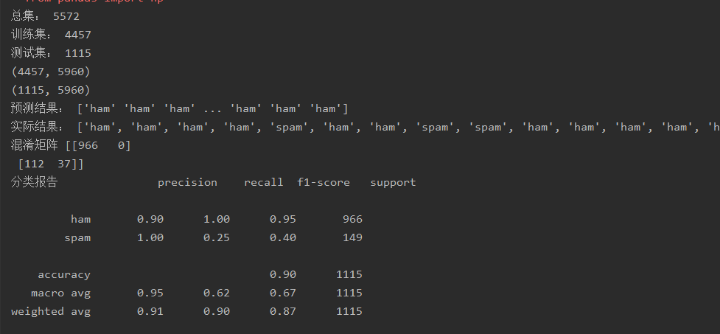

如果用CountVectorizer进行文本特征生成,与TfidfVectorizer相比,效果如何?

CountVectorizer:特征数值计算类,文本特征提取方法。

对于每一个训练文本,CountVectorizer会将文本中的词语转换为词频矩阵,它通过fit_transform函数计算各个词语在该训练文本出现的次数。

较为注重词出现的次数

而TfidfVectorizer可以把原始文本转化为tf-idf的特征矩阵,从而为后续的文本相似度计算

较为注重文本相似度的计算

如果用CountVectorizer进行文本特征生成,那么结果会差上许多

浙公网安备 33010602011771号

浙公网安备 33010602011771号