李宏毅meta learning笔记

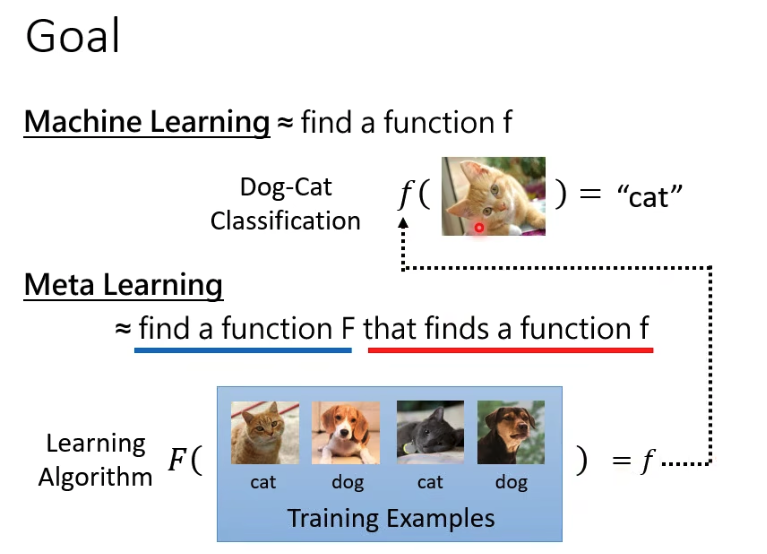

学习如何学习

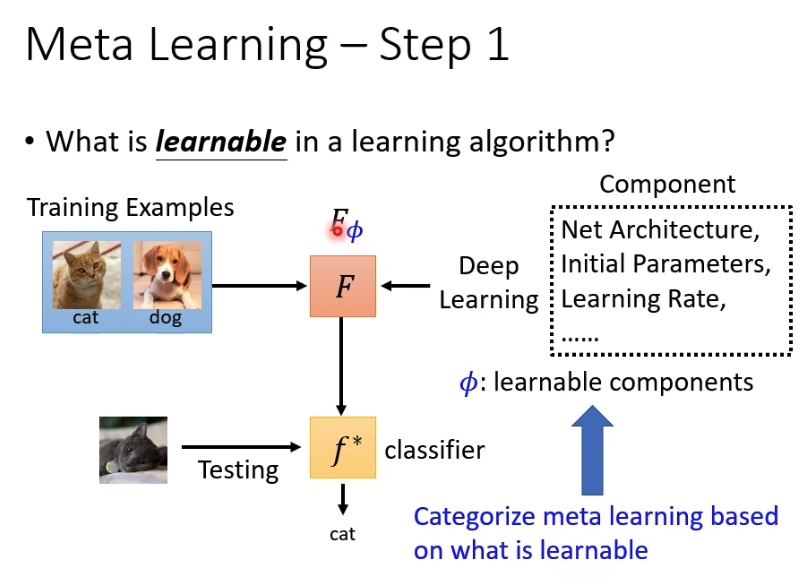

其实就是学习模型本身,模型的超参数

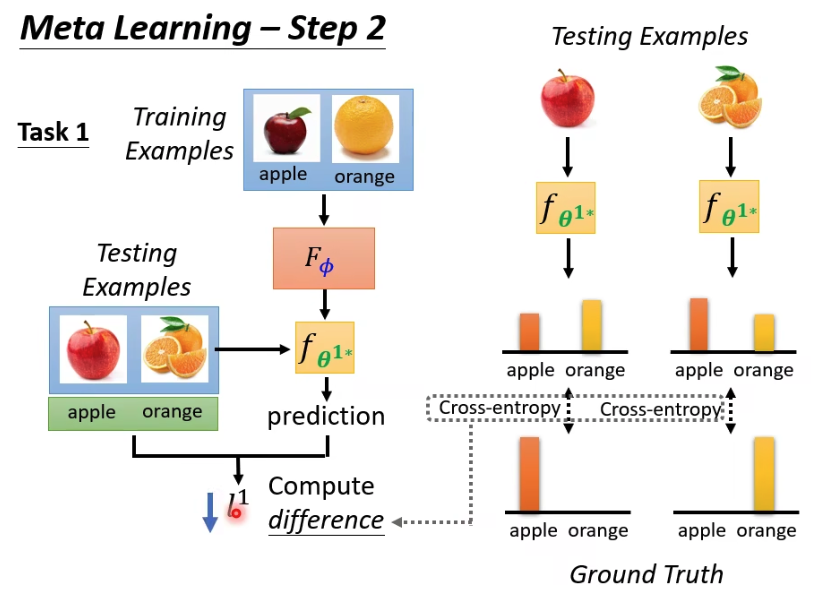

定义一个function,输入是一堆训练任务,输出是一个模型,这个和传统的机器学习没有本质不同

所以也是分成三步,

定义学什么,和相应的学习模型,meta learning本身也是有meta的。。。。。。

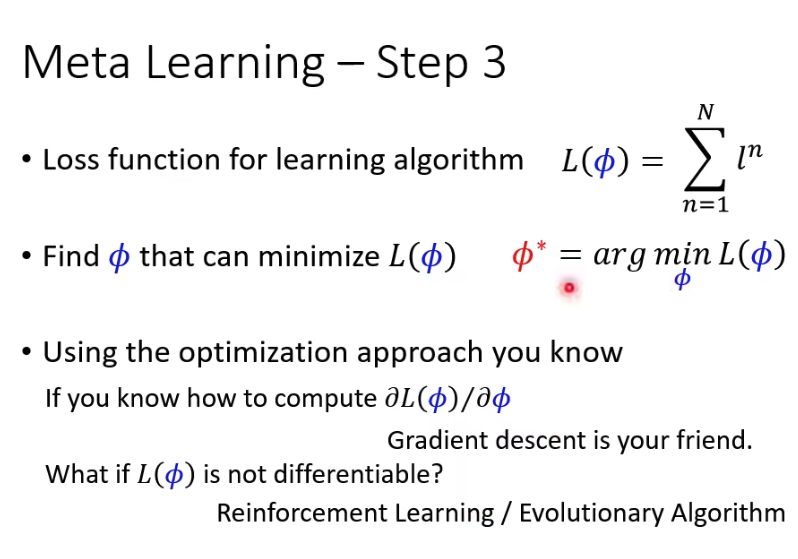

定义loss函数

用优化算法求解,但是这个Loss函数可能非法复杂,无法直接做gradient descent

所以这种情况,一般做法都是用,增强学习和进化算法

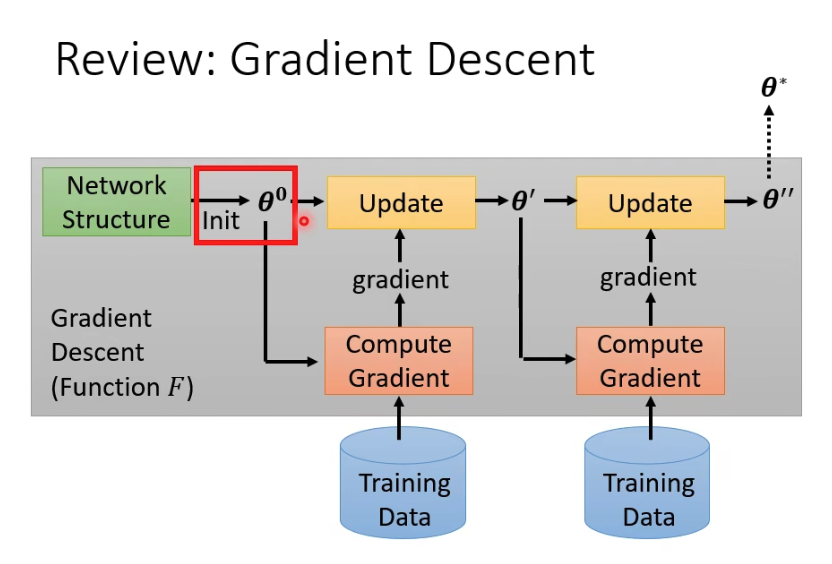

这里列出普通ML和Meta learning的差异

再看下实际的例子和相关的研究,

学习初始参数的,

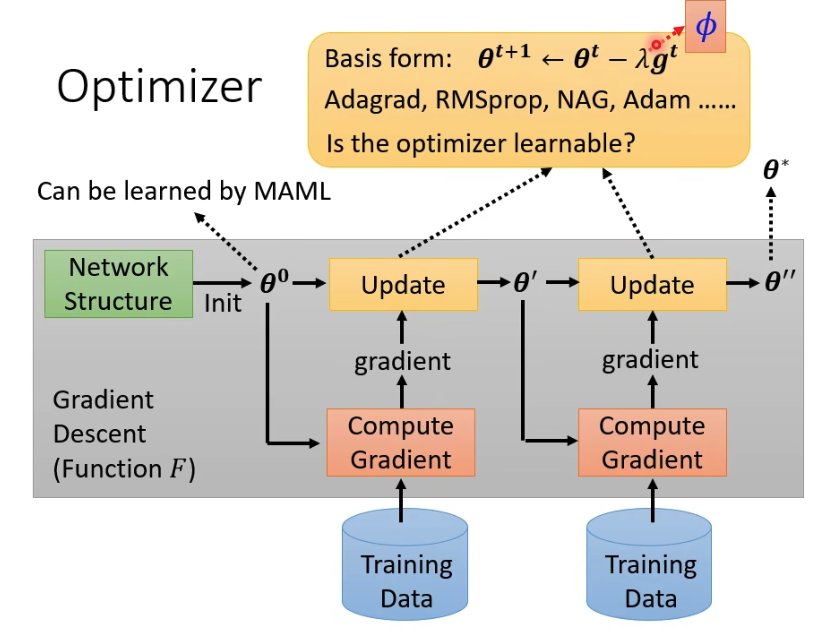

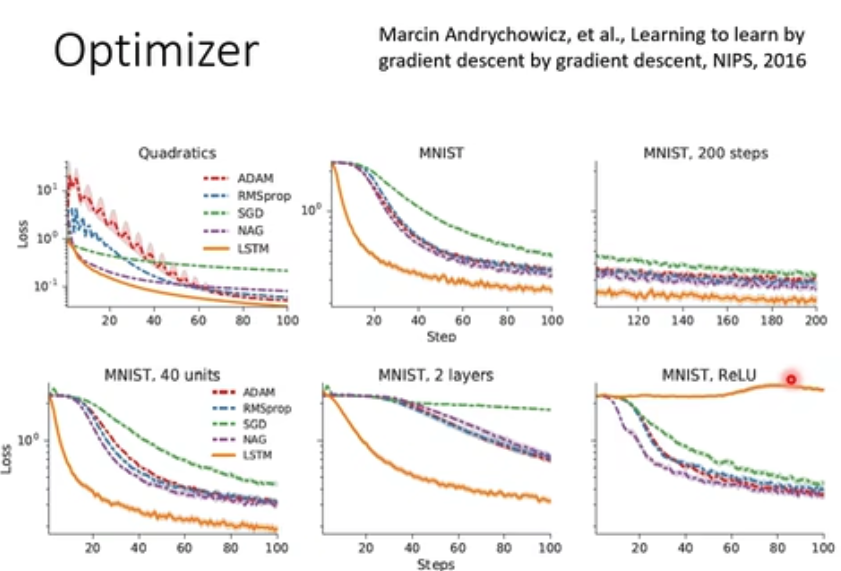

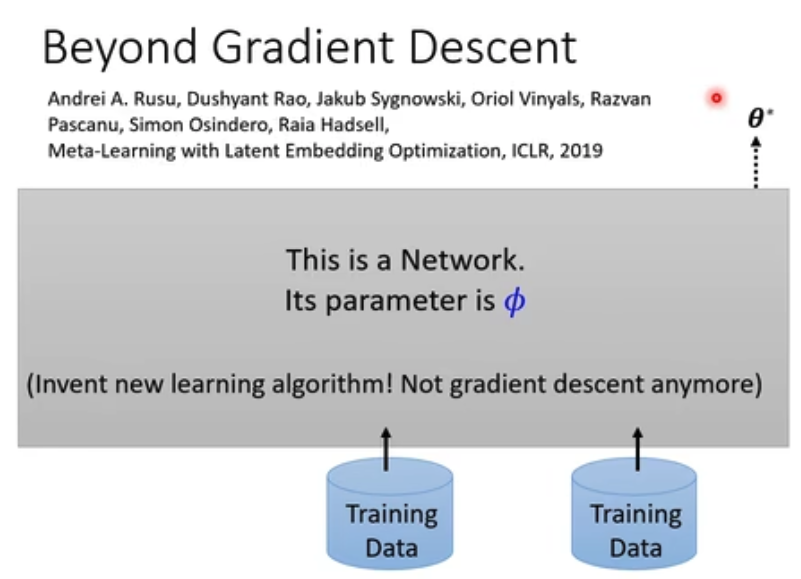

学习优化算法的

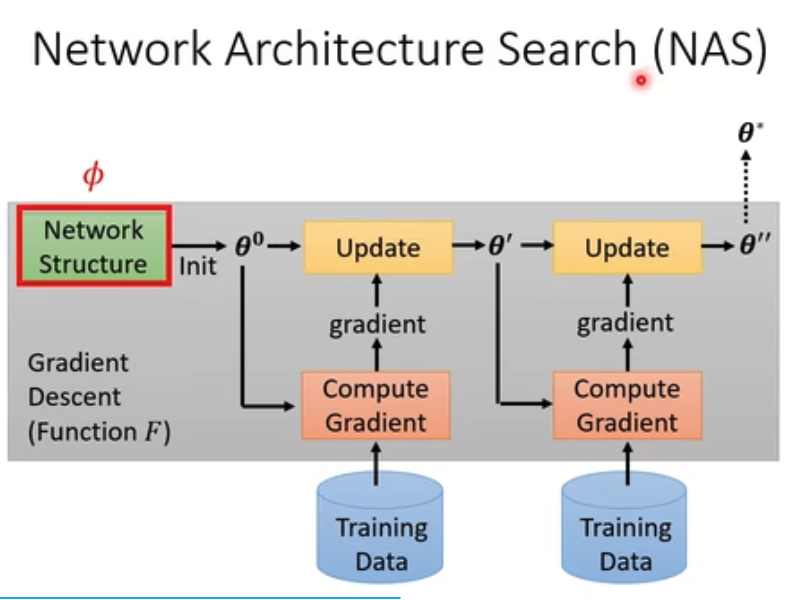

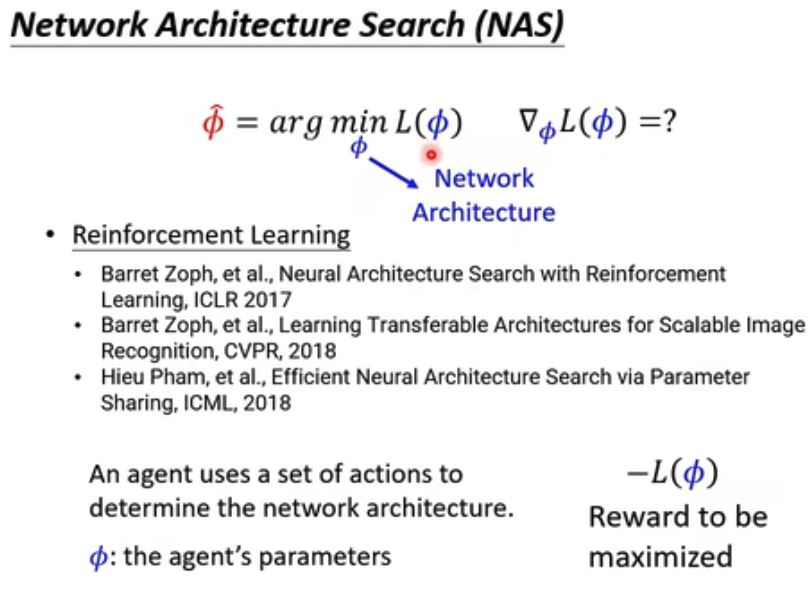

学习网络架构的

这里Loss函数比较复杂,无法直接gradient descent,所以研究都是用增强学习或进化学习

超出当前学习模型的边界,直接学习一个网络?

浙公网安备 33010602011771号

浙公网安备 33010602011771号