K-Means(K-均值)

聚类(Clustering)是无监督学习(unsupervisied learning),即不需要标签。

聚类是按照某个指标(如样本间的距离)把一个整个数据集分割成不同的类或簇(cluster),使类内元素的相似性尽可能大,类间元素的相似性尽可能地小。

简单来说,聚类使同一类的数据尽可能聚集到一起,不同类数据尽量分离。

聚类的一般步骤

数据准备:特征标准化(白化,whiting)

特征选择:特征降维,选择最有效的特征

特征提取:对选择的特征进行转换,提取出更有代表性的特征

聚类:基于特定的度量函数进行相似度度量,使同一类的数据尽可能聚集到一起,不同类数据尽量分离,得到各个簇的中心,以及每个元素的类标签

评估:分析聚类结果,如距离误差和(SSE)等

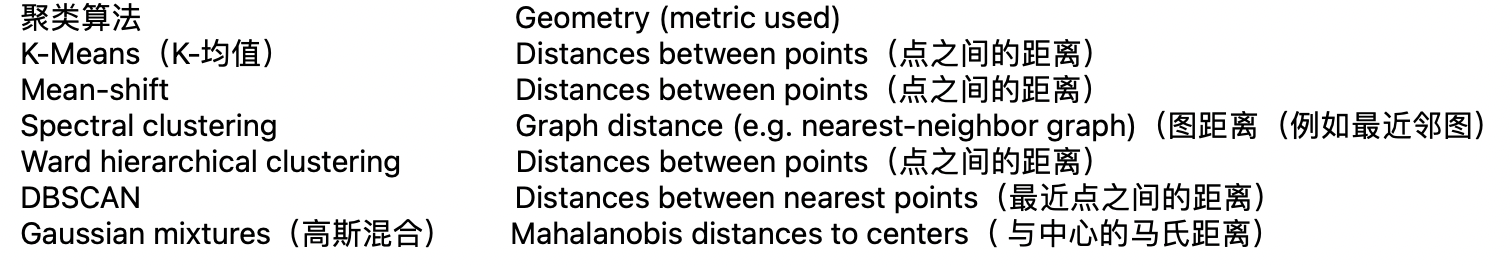

常用聚类算法有哪些、对应的度量函数分别是

聚类跟分类的本质区别

聚类是无监督,分类是有监督

----------------------------------------------

下面主要介绍一下K-Means算法:

所以 K-means 的算法步骤为:

- 选择初始化的 k 个样本作为初始聚类中心

;

- 针对数据集中每个样本

计算它到 k 个聚类中心的距离并将其分到距离最小的聚类中心所对应的类中;

- 针对每个类别

,重新计算它的聚类中心

(即属于该类的所有样本的质心);

- 重复上面 2 3 两步操作,直到达到某个中止条件(迭代次数、最小误差变化等)。

浙公网安备 33010602011771号

浙公网安备 33010602011771号