机器学习 作业2 机器学习相关数学基础

本周任务:

请确保熟悉并理解机器学习数学部分常用相关概念:

1.高等数学

1)函数

2)极限

3)导数

4)极值和最值

5)泰勒级数

6)梯度

7)梯度下降

2.线性代数

1)基本概念

2)行列式

3)矩阵

4)最小二乘法

5)向量的线性相关性

3.概率论

1)事件

2)排列组合

3)概率

4)贝叶斯定理

5)概率分布

6)期望和方差

7)参数估计

2.本周视频学习内容:https://www.bilibili.com/video/BV1Tb411H7uC?p=2

1)P2 概率论与贝叶斯先验

2)P3 矩阵和线性代数

机器学习是一门多领域交叉学科,涉及较多的数学知识,本节课知识之前都有学过,这次根据重点重新梳理一遍,一定要多加重视。通过观看视频,大家对课程的数学基础部分加深印象。

建议大家边看边做笔记,记录要点及所在时间点,以便有必要的时候回看。学习笔记也是作业的一部分。

3.作业要求:

1)贴上视频学习笔记,要求真实,不要抄袭,可以手写拍照。

1.概率论与贝叶斯先验(https://www.bilibili.com/video/BV1Tb411H7uC?p=2)

00:25 概率论与贝叶斯先验

01:17 统计数字的概率

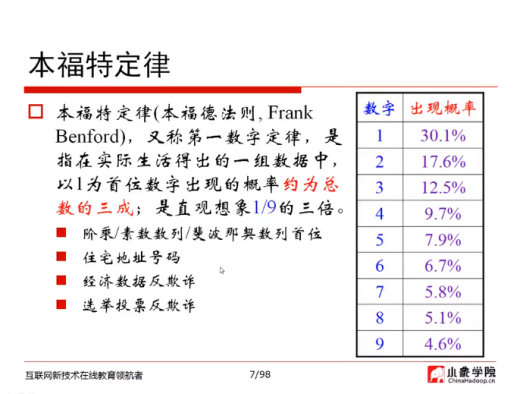

05:36 本福特定律

09:09 商品推荐

12:05 公路堵车概率模型

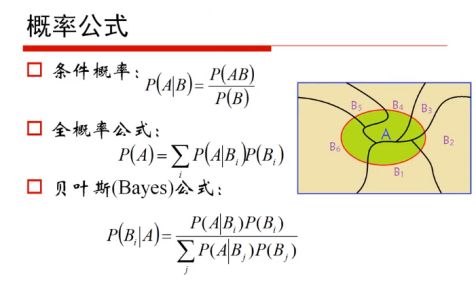

23:40 概率公式

28:12 贝叶斯公式的应用

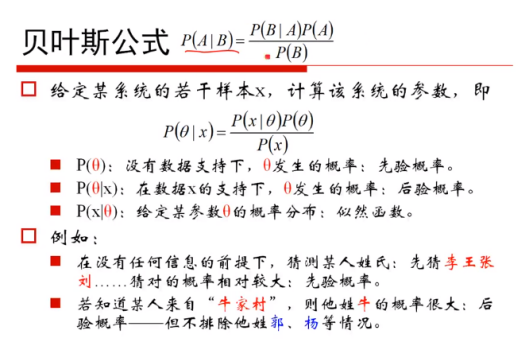

28:38 贝叶斯公式

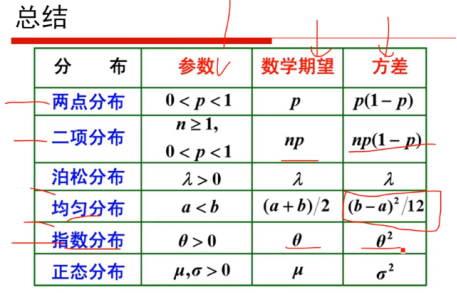

32:43 分布

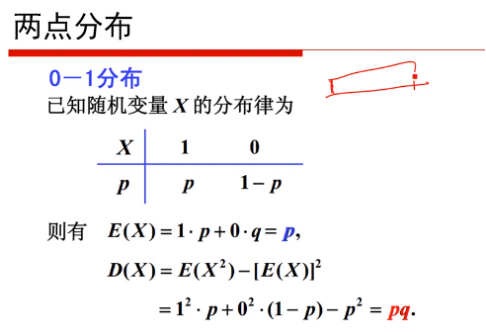

33:01 两点分布

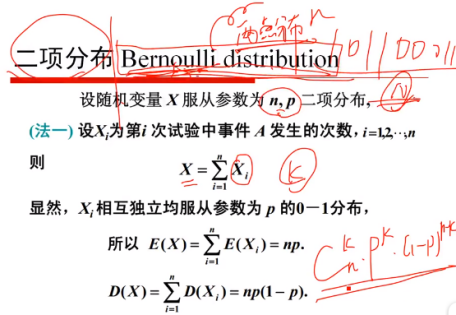

34:36 二项分布

43:12 考察Taylor展式

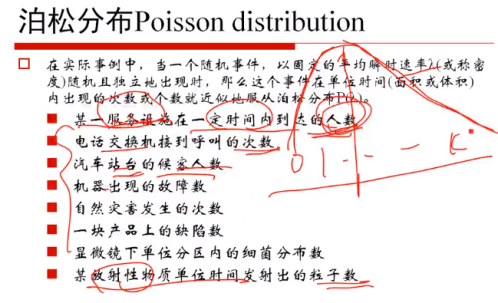

44:45 泊松分布

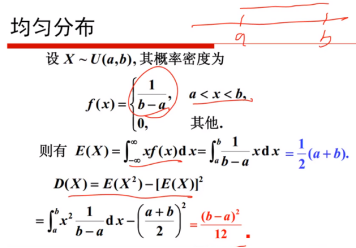

47:37 均匀分布

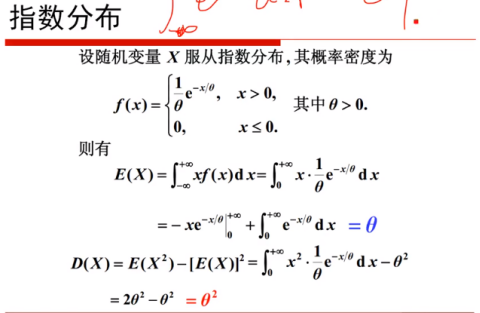

48:26 指数分布

50:25 指数分布的无记忆性

53:18 正态分布

54:26 二元正态分布

60:47 总结

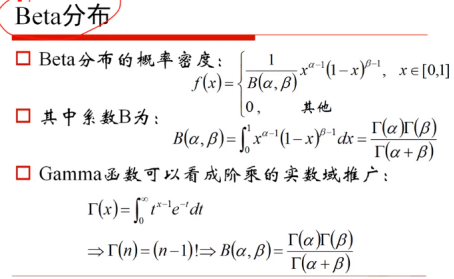

61:38 Beta分布

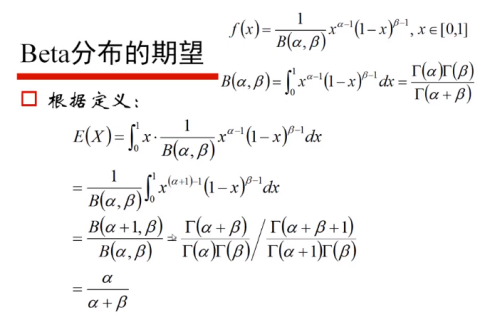

75:08 Beta分布的期望

82:26 指数族

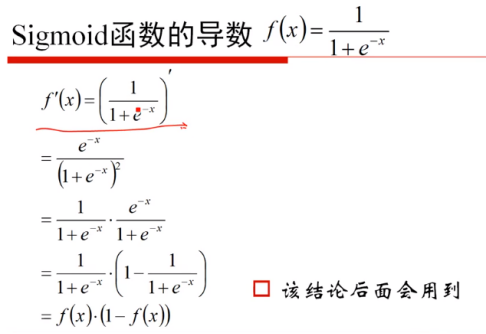

92:28 Sigmoid函数的导数

92:40 Gaussian也属于指数族分布

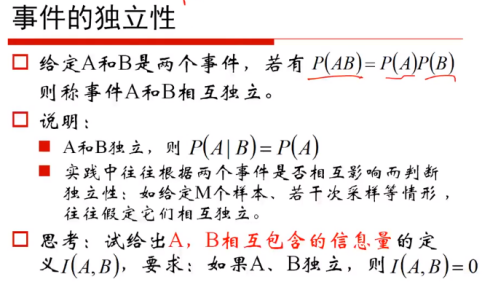

92:07 事件的独立性

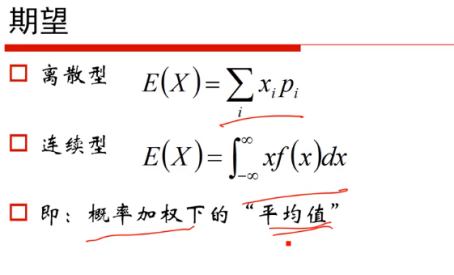

97:17 期望

99:14 计算期望

101:36 计算每一位的期望

101:45 总期望

103:00 集合Hash问题

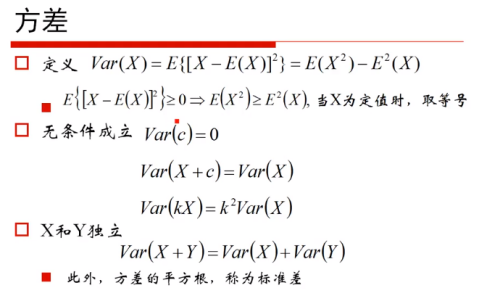

103:21 方差

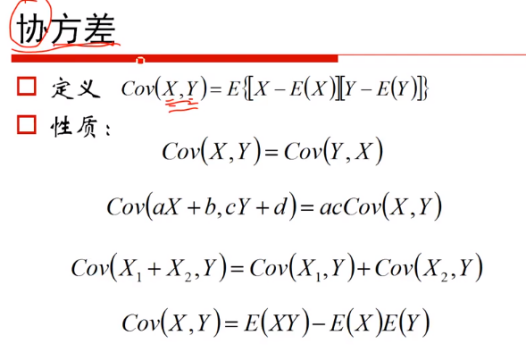

106:15 协方差

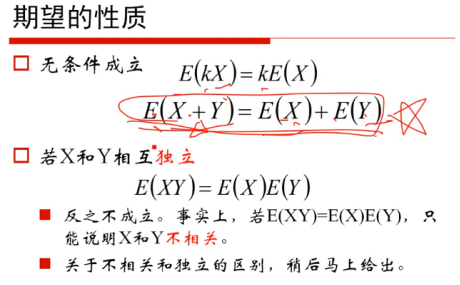

109:58 协方差和独立、不相关

110:04 协方差的意义

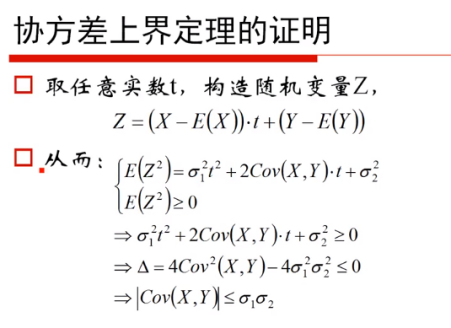

110:37 协方差的上界

115:22 协方差上界定理的证明

117:04 Pearson相关系数

126:26 协方差矩阵

137:32 切比雪夫不等式

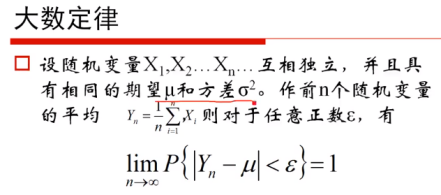

138:00 大数定理

143:00 伯努利定理

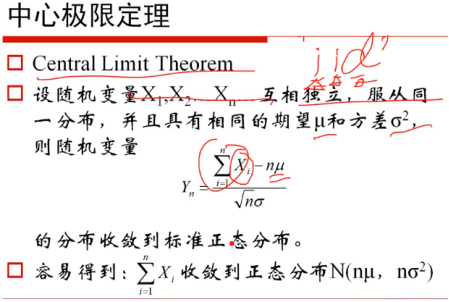

143:40 中心极限定理

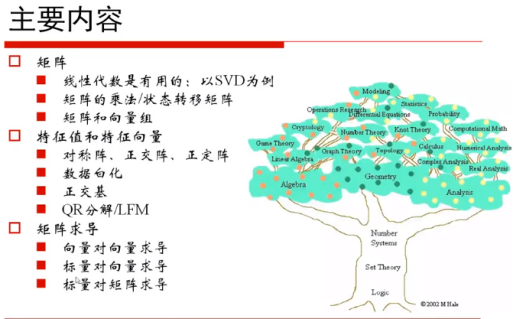

2.矩阵和线性代数(https://www.bilibili.com/video/BV1Tb411H7uC?p=3)

00:37 矩阵和线性代数

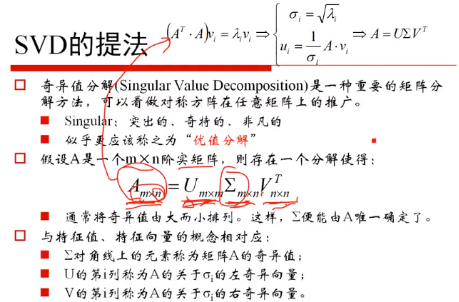

03:58 SVD的提法

15:58 线性代数

16:54 方阵的行列式

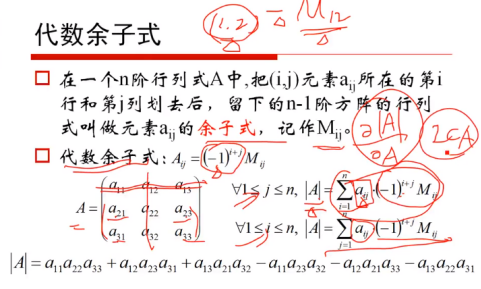

17:55 代数余子式

19:21 伴随矩阵

19:56 方阵的逆

20:16 范德蒙行列式

25:20 矩阵的乘法

25:54 矩阵模型

31:49 概率转移矩阵

37:35 平稳分布

41:21 矩阵和向量的乘法

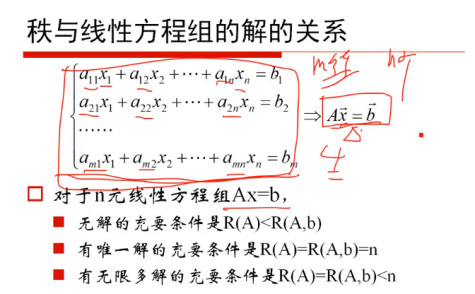

46:48 矩阵的秩

49:05 秩与线性方程组的解的关系

51:27 向量组等价

53:53 系数矩阵

56:33 正交阵

59:47 特征值和特征向量

64:04 不同特征值对应的特征向量

66:33 实对称阵不同特征值的特征向量正交

71:31 白化/漂白whitening

76:20 增加白化后的ICA效果

77:24 正定阵

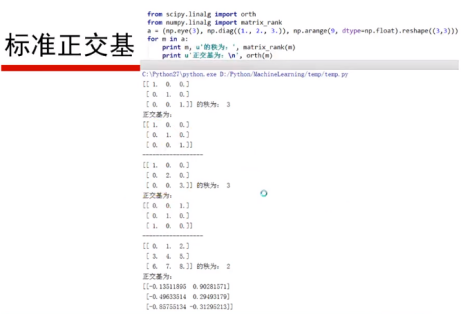

82:12 标准正交基

84:21 QR分解

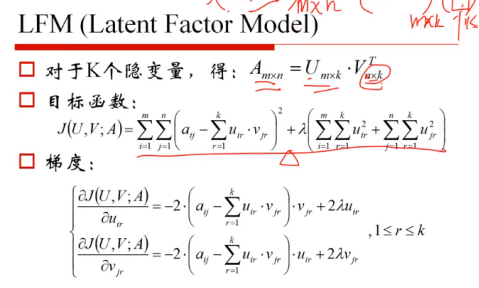

91:27 LFM(Latent Factor Model)

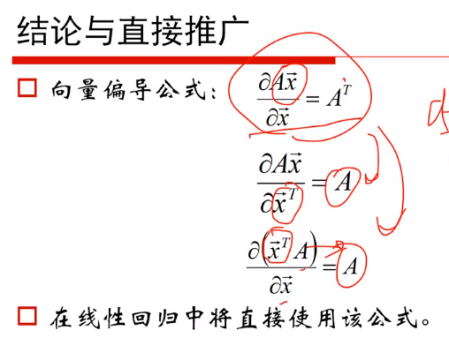

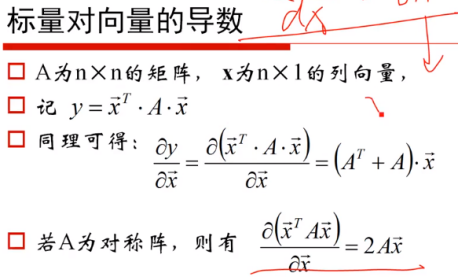

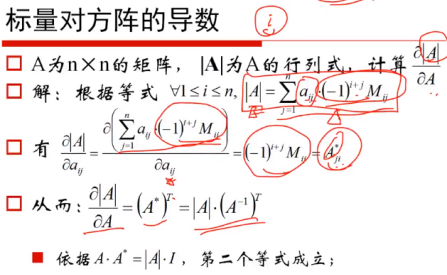

93:40 向量的导数

98:40 标量对向量的导数

101:21 标量对方阵的导数

2)用自己的话总结“梯度”,“梯度下降”和“贝叶斯定理”,可以word编辑,可做思维导图,可以手写拍照,要求言简意赅、排版整洁。

梯度:

梯度的本意是一个向量(矢量),表示某一函数在该点处的方向导数沿着该方向取得最大值,即函数在该点处沿着该方向(此梯度的方向)变化最快,变化率最大(为该梯度的模)。

梯度下降:

梯度下降是迭代法的一种,可以用于求解最小二乘问题(线性和非线性都可以)。在求解机器学习算法的模型参数,即无约束优化问题时,梯度下降(Gradient Descent)是最常采用的方法之一,另一种常用的方法是最小二乘法。在求解损失函数的最小值时,可以通过梯度下降法来一步步的迭代求解,得到最小化的损失函数和模型参数值。基本的梯度下降法发展了两种梯度下降方法,分别为随机梯度下降法和批量梯度下降法。

贝叶斯定理:

贝叶斯定理是关于随机是A和B的条件概率(或边缘概率)的一则定理。其中P(A|B)是在B发生的情况下A发生的可能性。

浙公网安备 33010602011771号

浙公网安备 33010602011771号