【Tesla】特斯拉Autopilot核心传感器解读之毫米波雷达篇

目前为止,特斯拉的Autopilot一共经历了三代硬件的更迭,分别是Autopilot1.0,2.0和2.5。按照目前特斯拉的公开信息,Autopilot3.0硬件将可能在今年底和自主研发的芯片一起推出。

如下图,特斯拉的主要传感器,此图来自特斯拉官网。

其中1为毫米波雷达:

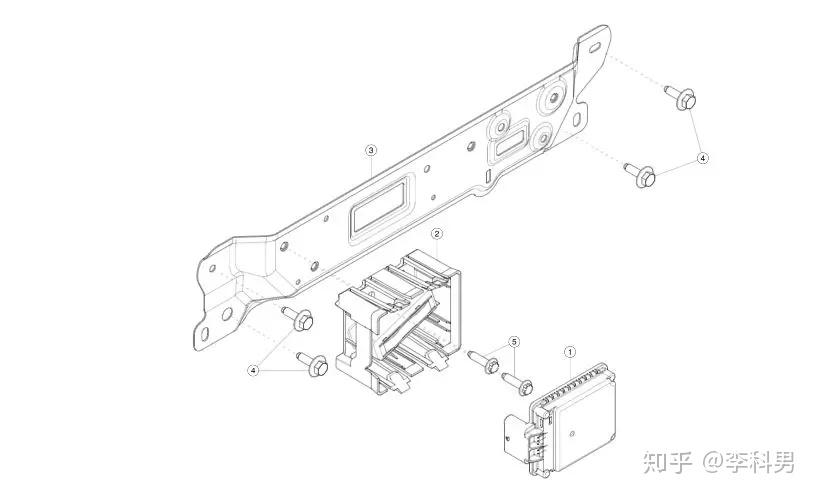

特斯拉Model S和Model X早期配备的Autopilot1.0和2.0版本硬件,搭载的是博世中程雷达传感器(MRR)。

其中,Model S的1.0版本雷达内置加热功能,而Model X开始从1.0到2.0版本都没有内置加热功能。博世雷达与ECU(即1.0的MobilEye EyeQ3芯片,2.0的英伟达px2的APE板)连接,使用一对canbus线路。

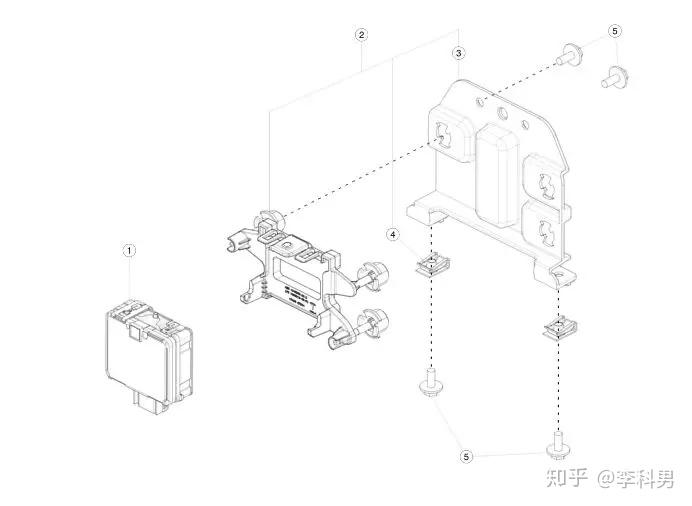

而从特斯拉Model 3开始,以及更新的ModelS/X Autopilot2.5版本(2017年8月后新车),配备的是大陆ARS4-B雷达传感器(官方命名:ARS410 CV),通过两对canbus线路与ECU相连。

上述两款雷达在参数上略有差异。大陆雷达速度测量更精确(+/- 0.1kph vs 博世+/- 0.11mps),探测距离略长(170米 vs 博世160米),重量稍轻(130克 vs 博世190克),功耗略低(4W vs 博世4.5 w)。

ARS4-B通过两个独立的扫描实现宽广的视野,从而可以支持远距功能,如自适应巡航系统、紧急制动辅助和前向碰撞预警。该传感器无需摄像头的辅助就能够探测静止目标。

该款雷达支持EuroNCAP (AEB城市/城际/行人) 以及CLEPA,AEBS(ECE阶段2);高于6.5° 目标分辨率以及0.2°探测精度;在水平和俯仰方向具备自动标定能力;测速精度: ± 0.1 km/h;自适应巡航ACC跟停式最高支持车速170km/h。

不过,为何当时特斯拉没有直接选择250m以上的远距离雷达,可能基于当时功能算法的匹配以及成本考量。在即将发布的Autopilot3.0硬件版本是否会采用新的雷达,我们拭目以待。

以博世的第四代远距离雷达传感器(远程雷达,LRR4)为例,集成了两块电子板,包括恩智浦和意法半导体的微控制器,以及博世的电源管理IC。

射频(RF)板采用基于混合PTFE / FR4基板的不对称结构,并安装有平面天线。其中,英飞凌77 GHz锗硅(SiGe)单片微波集成电路(MMIC)被用作高频发射器和接收器。

LRR4是单一静态多模雷达,具有六条固定波束,检测车辆的距离达到250米。中央的四条波束优化了高速度下对外围环境的探测性能。

其他性能包括:独立模式以仰角波束测量高度,能够分辨固定障碍物,从而对静止物体也能作出安全制动反应;带有自校准功能(水平);可选配透镜或雷达罩加热功能;可扩展系统具有多个传感器配置,包括融合传感器收集到的数据等。

从目前的一些车主反馈来看,因为芯片和算法的更换,有不少车主反馈Autopilot2.0上的雷达/视觉融合明显比1.0差,Autopilot1.0的精度仅为几厘米,而Autopilot2.0很容易出现+/-1m的误差。

与此同时,Autopilot1.0运行在将近5年前发布的Mobileye EyeQ3上,仍然比Autopilot2.0采用英伟达px2更好地处理许多情况。显然,彼时芯片的更换,对于特斯拉来说并没有做好充分的准备。

同时,近年来特斯拉连续遭遇的两次碰撞横向行驶的卡车,有业内人士认为,目前这套硬件和算法都没有对交叉路口的横向移动障碍物做特殊算法处理,除了雷达可能在1.0版本之后对此场景进行了一些改进(此外,此前搭载的MobilEye EyeQ3不支持两侧来车检测)。

对于毫米波雷达的使用,此前特斯拉官方在2016年9月发布了一篇专门针对毫米波雷达使用的博客文章:

虽然我们的软件版本V8.0有几十个小的改进,但最重要的升级是搭载了毫米波雷达。该雷达是2014年10月作为Autopilot硬件套件的一部分添加到所有特斯拉汽车上的,但只是作为主要相机和图像处理系统的辅助传感器。

经过仔细的考虑,我们现在认为它可以作为一个主要的控制传感器,而不需要相机确认视觉图像识别。这是一个非常重要且违反直觉的问题,因为这个世界在雷达上看起来很奇怪。

(这篇文章的发布时间恰恰在特斯拉首起Autopilot激活状态下的致命事故。2016年5月7日,一辆2015款Model S与一辆横穿的白色车身拖挂车发生碰撞。

“在明亮的天空下,Autopilot和司机都没有注意到挂车的白色部分,所以没有刹车,”特斯拉的博客文章说,“拖车高度高,加上它在道路上的位置,以及碰撞的极其罕见的情况,导致Model S直接从拖车下方通过并造成了事故。”)

毫米波雷达的波长很容易穿过雾、尘、雨和雪,但任何金属的东西看起来都像一面镜子。雷达可以看到人,但他们看起来是半透明的。由木头或彩绘塑料制成的东西,虽然对人来说是不透明的,但对雷达来说几乎和玻璃一样透明。

另一方面,任何盘形金属表面不仅具有反射性,而且将反射信号放大到实际尺寸的许多倍。(RCS)一个废弃的汽水罐在路上,它的凹底朝向你,看起来可能是一个巨大而危险的障碍物,但你肯定不想为了躲避它而猛踩刹车。

因此,使用雷达制动最大的问题是避免误报。如果你要撞到一个又大又结实的东西,猛踩刹车是至关重要的,但如果你只是要撞倒一个汽水罐,就不是这样了。有很多不必要的刹车事件,往好了说是非常恼人的,往坏了说是会造成伤害。

解决这个问题的第一部分是有一个更详细的点云。V8.0版本软件用相同的硬件解锁了对六倍多的雷达目标的访问,每个目标有更多的信息。

第二部分是将这些每十分之一秒发生一次的雷达快照组装成世界的3D“图片”。我们很难从一帧图像中分辨出物体是运动的还是静止的,也很难分辨出虚假的反射。通过将几个相邻的帧与车速和期望路径进行比较,汽车可以判断某物是否真实,并评估碰撞的可能性。

第三部分要困难得多。当汽车驶近位于路面隆起处或桥下的高架公路路标时,这通常看起来像是一个碰撞路线。GPS的导航数据和高度精度不足以判断车辆是否会从物体下方通过。等到车开得很近,路面坡度发生变化时,再刹车就太晚了。

这就是快速学习派上用场的地方。最初,车将不采取任何行动,除了记录路标、桥梁和其他固定物体的位置,根据雷达绘制地图。然后,Autopilot系统将自动比较何时刹车,并将其上传到特斯拉的数据库。

如果有几辆车安全地驶过一个给定的雷达目标,不管自动驾驶仪是开着还是关着,这个目标都会被添加到地理编码的白名单中。

当数据显示,虚假刹车事件将是罕见的,汽车将开始使用雷达系统数据进行温和刹车,即使相机没有注意到前方的物体。随着系统置信度的提高,当系统发生碰撞的概率接近99.99%时,制动力将逐渐增大到最大。

这可能并不总是完全防止碰撞,但碰撞速度将显著降低到不太可能对车内人员造成严重伤害的程度。

这样做的效果,再加上雷达能透过大部分的视觉模糊,就是即使在零能见度的情况下,汽车也应该几乎总是正确地踩刹车。

更进一步,特斯拉也可以“获取”前一辆车下方回来的雷达信号,使用雷达脉冲信号和光子飞行时间(ToF)来区分信号——甚至进行刹车,当尾随一辆对于视觉和雷达都是不透明的车。前面的车可能会在浓雾中撞上不明物体,但特斯拉不会。

此外,使用雷达回波控制前方两辆车,提高了对不可见的严重刹车事件的响应和反应时间。

不过,就在上周,特斯拉的一辆车又再次撞上了一辆横穿路口的白色半挂卡车,同样,特斯拉的车又一次直接从车底穿过造成事故。目前,还不确认事故的具体原因。

我们不清楚当时的各项Autopilot功能是否正常运转,感知系统是否有检测到障碍物,但很显然作为最后减缓碰撞的AEB系统并非万能。(实际量产车的AEB效果并非大家在测试场看到的那样完美,能够很精准在前方障碍物前刹住车。)

我们查看了Model 3的最新车主手册,关于自动紧急制动一项是这样说明的:倘若行驶车速为 (56 km/h) 或更快,在自动应急制动将行驶车速减慢 (50 km/h) 后,将释放制动器。比如,行驶车速为90 km/h时,自动紧急制动会实施制动;当车速降至40 km/h时,则会释放制动器。(所以,不要对AEB报以希望,尤其是L3级及以下自动辅助驾驶)

车主手册明确表示:仅当行驶速度大致介于10 km/h和150 km/h之间时,才能使用自动紧急制动。同时,自动紧急制动设计用来减轻冲击的严重程度,它不能用来避免碰撞。

只是减速不是紧急刹停

此文转自高工智能公众号。

浙公网安备 33010602011771号

浙公网安备 33010602011771号