WGAN

GAN--生成式对抗网络

1.GAN的思想

GAN模型由生成式模型和判别式模型组成:

- 生成模型G是一个生成输出的网络,它接收一个随机的噪声z,通过这个噪 声生成输出,记做G(z)

- 判别模型D是用来判别输入是不是“真实的”。它的输入参数是x,x代表输入,输出D(x)代表x为真实数据的概率,如果为1,就代表100%是真实的图片,而输出为0,就代表不可能是真实的数据

在训练过程中,生成网络G的目标就是尽量生成真实的数据去欺骗判别网络D。而D的目标就是尽量把G生成的数据和真实的数据分别开来。这样,G和D构成了一个动态的“博弈过程”

2.初始的GAN存在的问题

- 不收敛

- 难以训练

- 梯度消失的问题

- 模型崩溃

- 模型可控性差

WGAN--Earth Mover’s Distance

1.WGAN的思想

Earth Mover’s Distance 用一句话描述 EM 距离:将一个分布 P 通过搬运的方式变成另一个分布 Q 所需要的最少搬运代价。

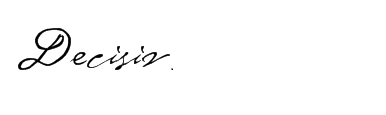

比如说我们有下面的两个分布,如何将 P 上的内容变成得到 Q 呢?下图展示了两种办法。移动的方法有很多种,如果每一种都表示了一种代价,那么显然有“好”方法,就会有“坏”方法。假设我们衡量移动方法好坏的总代价是“移动的数量”x“移动的距离”。那这两个移动的方案肯定是能分出优劣的。

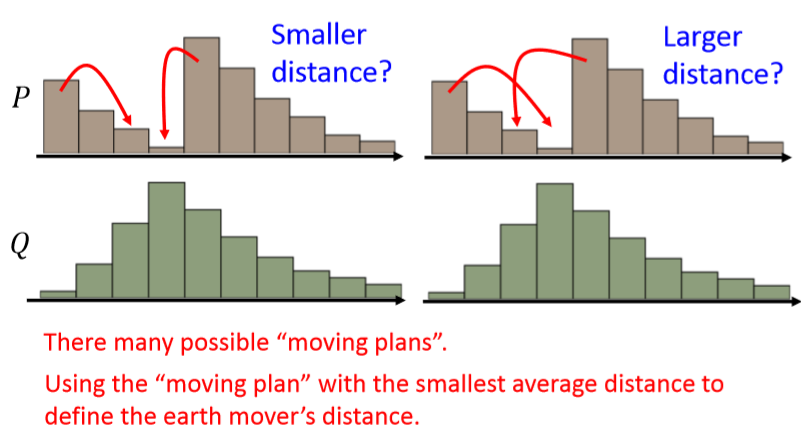

当我们用分布 Q 上不同颜色的色块对应分布 P 的相应位置,就可以将最好的移动方案画成下面这个样子:

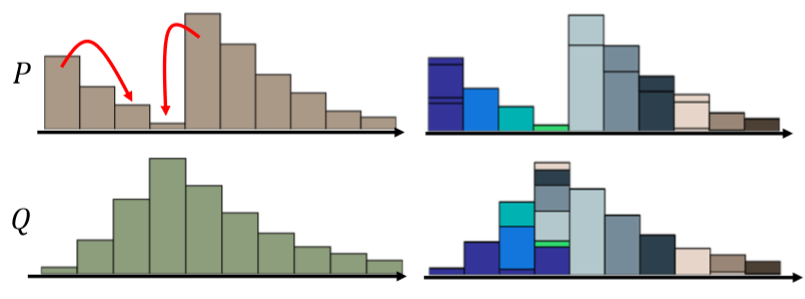

为了便于形式化定义,我们可以将这个变化画为一个矩阵:

对于每一个移动方案,都能有这样一个矩阵。矩阵的每一行表示分布 P 的一个特定位置。该行中的每一列表示需要将该行的内容移动到分布 Q 对应位置的数量。即矩阵中的一个元素(xp,xq)表示从 P(xp) 移动到 Q(xq) 的数量。

2.WGAN形势

其对偶问题:

要求函数f的导函数绝对值不超过K的条件下,对所有可能满足条件的f取到上式的上界,然后再除以K

进而,用该距离做GAN的LOSS函数,可得:

- 生成器loss函数:

- 判别器loss函数:

可以表示训练进程中,其数值越小,表示真实分布与生成分布的Wasserstein距离越小,GAN训练得越好

3.总结

EM距离相对KL散度与JS散度具有优越的平滑特性,理论上可以解决梯度消失问题。在此近似最优判别器下优化生成器使得Wasserstein距离缩小,就能有效拉近生成分布与真实分布。WGAN既解决了训练不稳定的问题,也提供了一个可靠的训练进程指标,而且该指标确实与生成样本的质量高度相关