TensorFlow(二):基本概念以及练习

一:基本概念

- 1、使用图(graphs)来表示计算任务

- 2、在被称之为会话(Session)的上下文(context)中执行图

- 3、使用tensor表示数据

- 4、通过变量(Variable)维护状态

- 5、使用feed和fetch可以为任意的操作赋值或者从其中获取数据

TensorFlow是一个编程系统,使用图(graphs)来表示计算任务,图(graphs)中的节点称之为op(operation),一个op获得0个或多个tensor,执行计算,产生0个或多个tensor。tensor看做是一个n维的数组或列表。图必须在会话(Session)里被启动。

二:TensorFlow结构

三:简单练习

1、热身前技巧:

a、首先在桌面创建一个专门用来存放TensorFlow代码的文件夹,以后把全部和TensorFlow相关的代码存放在该文件夹下。

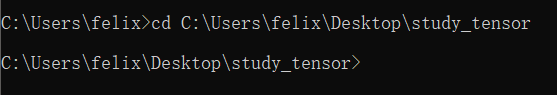

b、打开jupyter:首先打开系统终端(cmd):进入刚才创建的存放代码的文件夹(比如我的study_tensor)输入:cd C:\Users\felix\Desktop\study_tensor

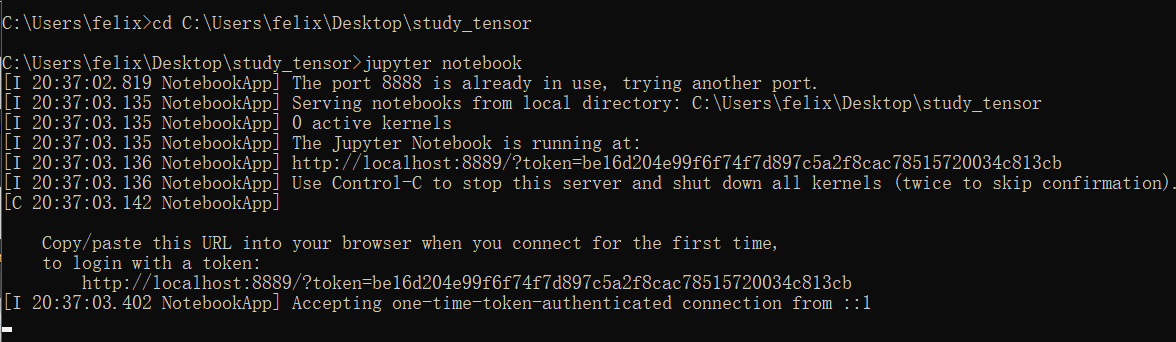

进入后输入jupyter notebook

会再浏览器中打开jupyter notebook的编辑环境。(这样打开的话,默认jupyter的工作环境就是刚才创建的文件夹了)

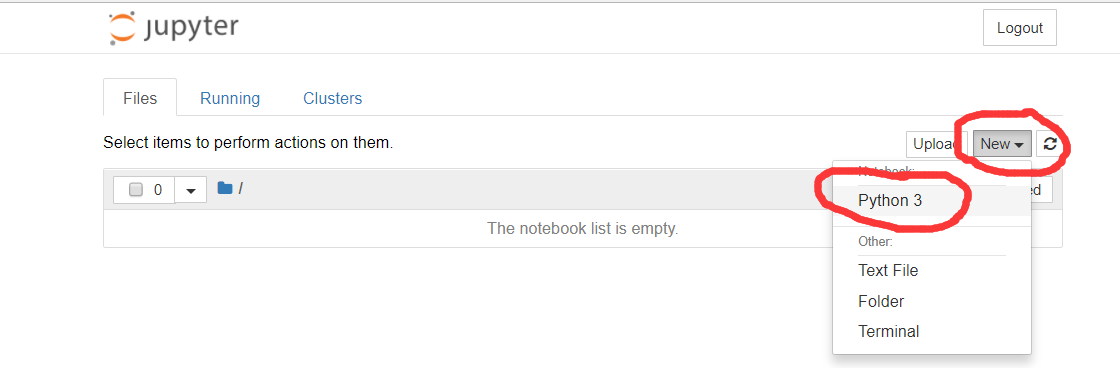

新建工作环境。

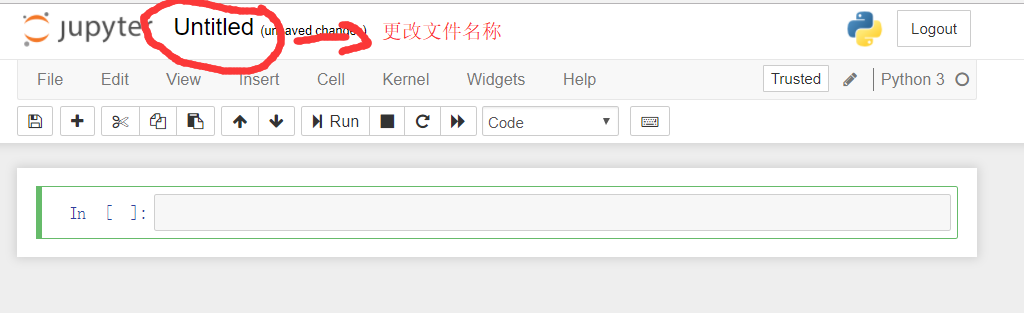

如下图表示成功进入工作环境:

2、切入正题,撸代码

shift+enter 执行代码

tab 代码提示

shift+tab 详情提示

a、创建图和启动图

import tensorflow as tf # 创建一个常量op m1=tf.constant([[3,3]]) # 创建一个常量op m2=tf.constant([[2],[3]]) # 创建一个矩阵乘法的op,把m1,m2传入 product=tf.matmul(m1,m2) print(product) #直接打印并没有执行 # 定义一个会话,自动默认图 sess=tf.Session() # 调用sess的run方法来执行矩阵乘法op # run(product)触发图中3个op result=sess.run(product) print(result) sess.close() # 关闭 # 将上一句简化 with tf.Session() as sess: # 调用sess的run方法来执行矩阵乘法op # run(product)触发图中3个op result=sess.run(product) print(result)

图中的每一个代码块都执行了。(按shift+enter执行)

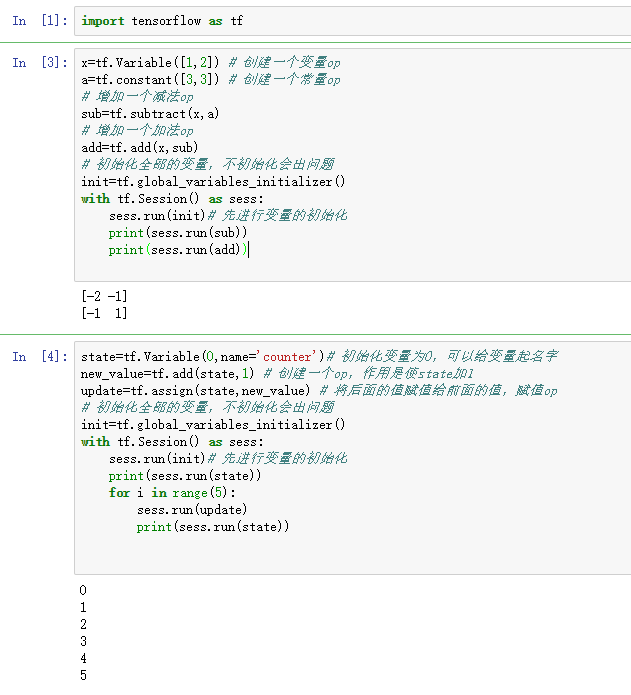

b、变量

import tensorflow as tf x=tf.Variable([1,2]) # 创建一个变量op a=tf.constant([3,3]) # 创建一个常量op # 增加一个减法op sub=tf.subtract(x,a) # 增加一个加法op add=tf.add(x,sub) # 初始化全部的变量,不初始化会出问题 init=tf.global_variables_initializer() with tf.Session() as sess: sess.run(init)# 先进行变量的初始化 print(sess.run(sub)) print(sess.run(add)) state=tf.Variable(0,name='counter')# 初始化变量为0,可以给变量起名字 new_value=tf.add(state,1) # 创建一个op,作用是使state加1 update=tf.assign(state,new_value) # 将后面的值赋值给前面的值,赋值op # 初始化全部的变量,不初始化会出问题 init=tf.global_variables_initializer() with tf.Session() as sess: sess.run(init)# 先进行变量的初始化 print(sess.run(state)) for i in range(5): sess.run(update) print(sess.run(state))

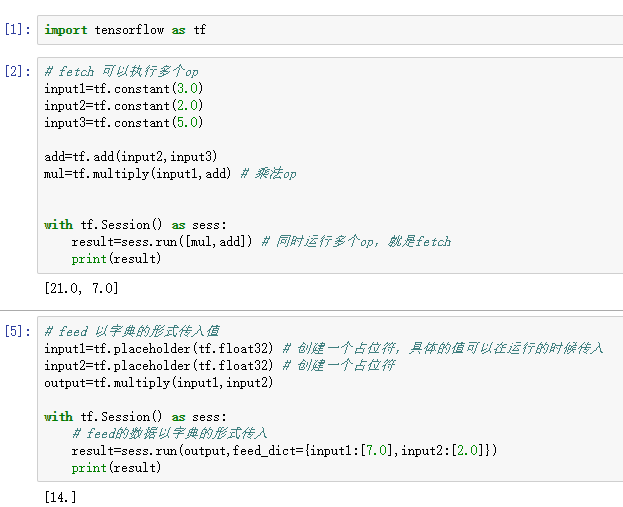

c、fetch和feed

import tensorflow as tf # fetch 可以执行多个op input1=tf.constant(3.0) input2=tf.constant(2.0) input3=tf.constant(5.0) add=tf.add(input2,input3) mul=tf.multiply(input1,add) # 乘法op with tf.Session() as sess: result=sess.run([mul,add]) # 同时运行多个op,就是fetch print(result) # feed 以字典的形式传入值 input1=tf.placeholder(tf.float32) # 创建一个占位符,具体的值可以在运行的时候传入 input2=tf.placeholder(tf.float32) # 创建一个占位符 output=tf.multiply(input1,input2) with tf.Session() as sess: # feed的数据以字典的形式传入 result=sess.run(output,feed_dict={input1:[7.0],input2:[2.0]}) print(result)

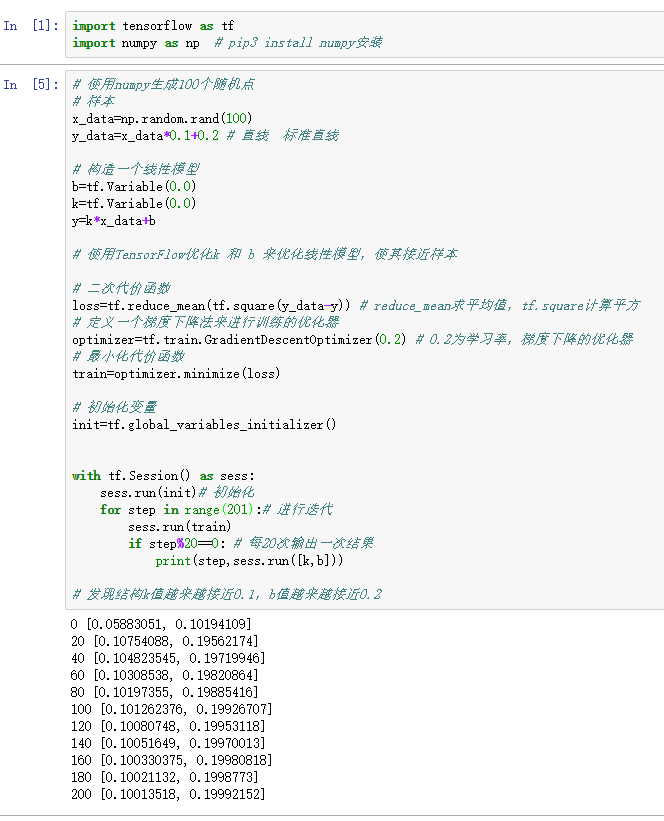

d、简单示例-优化线性模型,使模型接近样本

import tensorflow as tf import numpy as np # pip3 install numpy安装 # 使用numpy生成100个随机点 # 样本 x_data=np.random.rand(100) y_data=x_data*0.1+0.2 # 直线 标准直线 # 构造一个线性模型 b=tf.Variable(0.0) k=tf.Variable(0.0) y=k*x_data+b # 使用TensorFlow优化k 和 b 来优化线性模型,使其接近样本 # 二次代价函数 loss=tf.reduce_mean(tf.square(y_data-y)) # reduce_mean求平均值,tf.square计算平方 # 定义一个梯度下降法来进行训练的优化器 optimizer=tf.train.GradientDescentOptimizer(0.2) # 0.2为学习率,梯度下降的优化器 # 最小化代价函数 train=optimizer.minimize(loss) # 初始化变量 init=tf.global_variables_initializer() with tf.Session() as sess: sess.run(init)# 初始化 for step in range(201):# 进行迭代 sess.run(train) if step%20==0: # 每20次输出一次结果 print(step,sess.run([k,b])) # 发现结构k值越来越接近0.1,b值越来越接近0.2

浙公网安备 33010602011771号

浙公网安备 33010602011771号