记录用web scraper爬取裁判文书网的文书列表信息以及批量下载word文书

这个是一位网友在B站交流的一个问题,这里记录一下。

需求

2、需要抓取的信息

爬取文书列表内容,报告标题、文号、日期、摘要等等信息。

3、需要抓取多页,比如说前10页。

分析网站的情况

1、抓取的页面翻页的时候,url是不会变的。而在页面的源码当中又找不到内容,说明网页是通过异步加载的。

2、打开F12,就会弹出下面的暂停提示,阻止后续的查看。没事,点击右下角的取消断点,再运行即可。

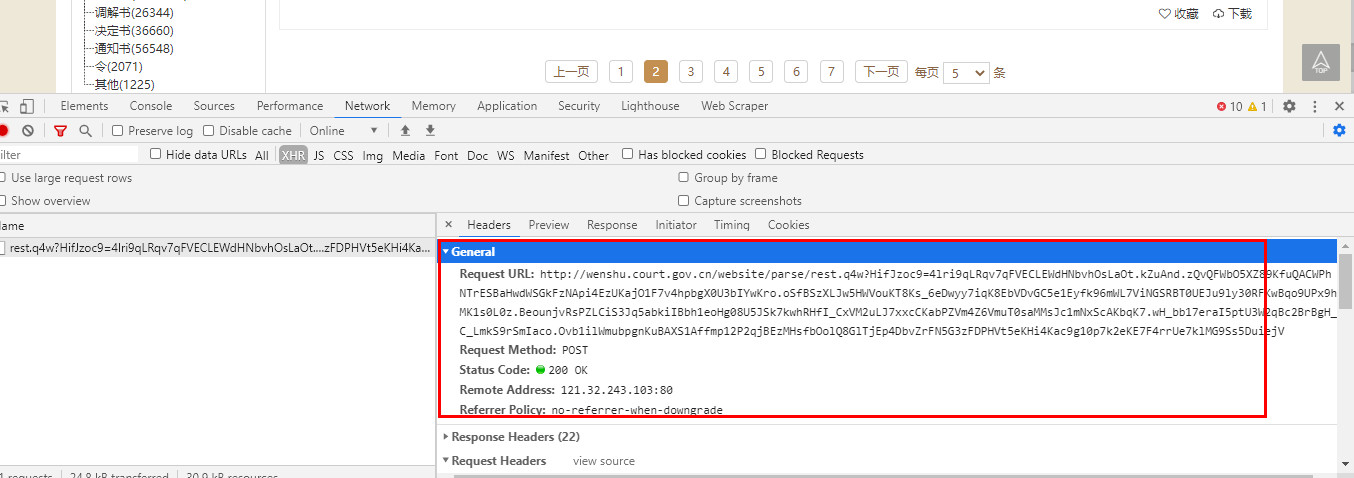

3、点击“network”,点击网页的第二页,查看请求的数据。

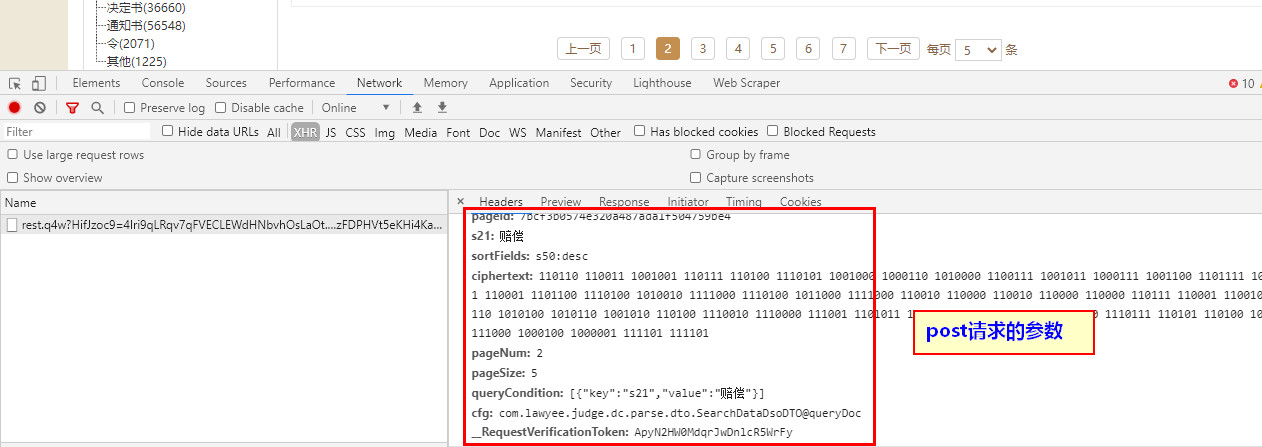

可以看到,是post请求,后面需要有一堆的参数

一般而言,通过这样请求之后,可以获取到真实的json文件,里面就包含了网页中文书的列表当中,然而这次却是不一样,请求得到的居然是加密的信息,还需要通过一定方式来进行解密才行。

到这里,已经可以感受到网页开发人员的“苦心”,反爬的措施可谓是非常的多。不过,我还是在网上找到了一篇网友关于用python解决这上面问题的办法和代码,有需要的时候可以参考一下。这里有些内容在自己的能力圈之外,就暂时不考虑了。

https://blog.csdn.net/Since_you/article/details/100566633

web scraper爬取

用python比较复杂的话,那么就考虑用web scraper来试试。

python爬取的效率当然高,但是反爬的太厉害了,大部分的网站都会对python进行一定的限制和爬取,这样写代码的成本就无形增加了很多。

web scraper则不用考虑这么多,只要浏览器里面能看到数据,就能够进行爬取。

回头看看网站的情况:一是url不变,二是数据不在网页源码当中。那么就考虑“动态加载进行翻页”的这种情况(参考教程:http://www.yhjbox.com/2020/03/5561/)。

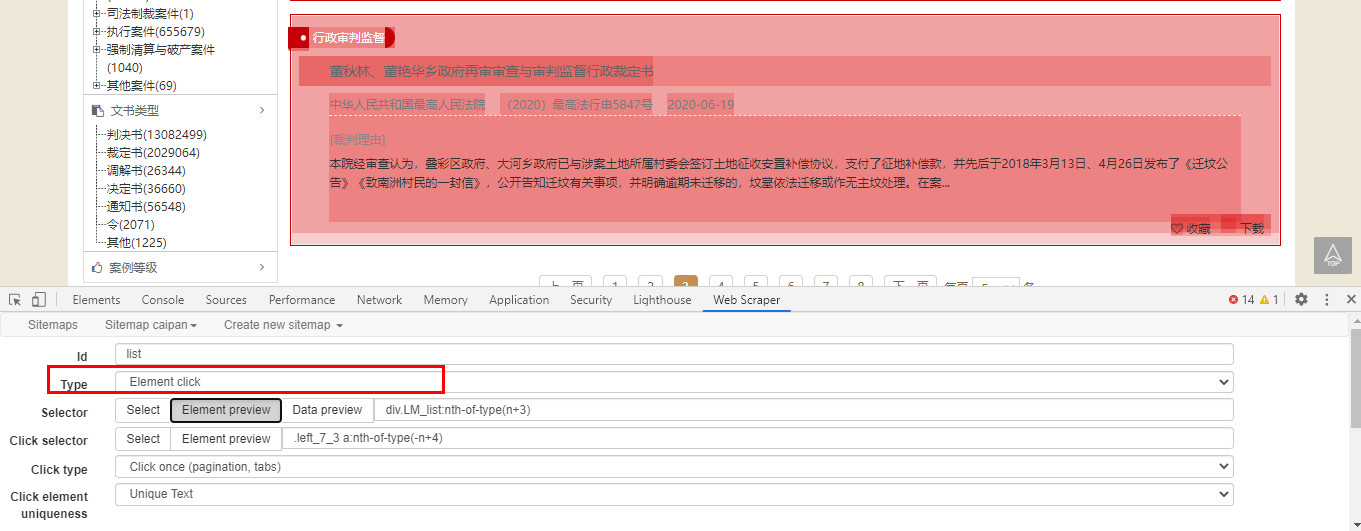

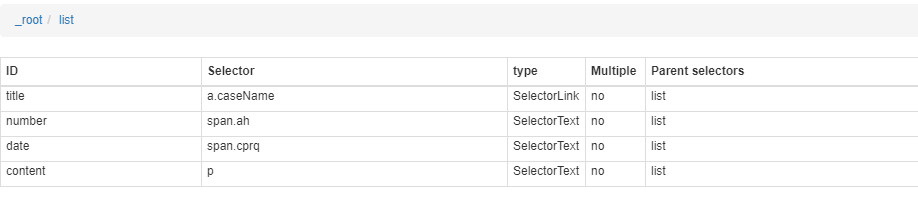

主要配置如图:

关键点就是"selector type"和"click selector"的配置

"selector type"(用于选择网页中的文书列表)选择"Element click"

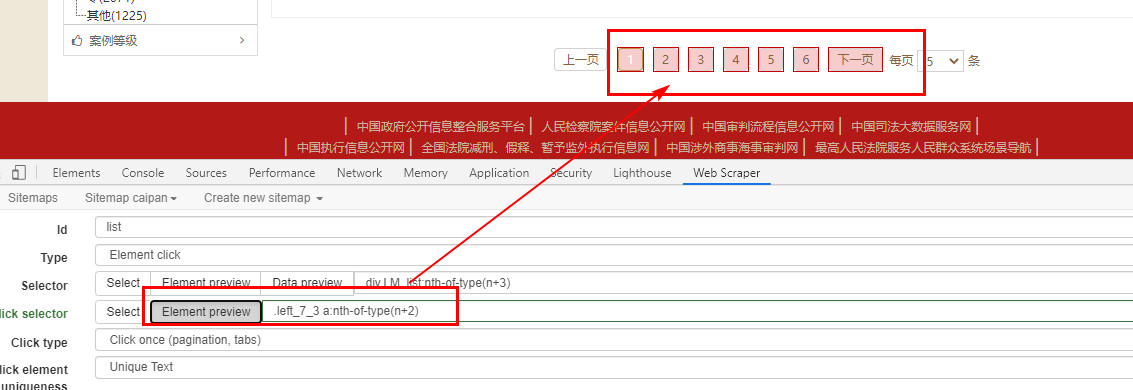

"click selector"(用于翻页)这里需要注意,一般如果是直接在网页点选的话,得到的css代码是这样的

.left_7_3 a:nth-of-type(n+2)

表示的意思就是从第二个翻页器(上一页为第一个,1为第二个)开始点击,一直到最后一个。

因为这个url有非常多的页,比如,如果希望只取前5页的话,可以如下更改:

.left_7_3 a:nth-of-type(-n+6)

n的取值是从0开始的。

然后再在这个选择器下面,配置标题、文号、日期、摘要的选择器。

最终的结构图就是这样的:

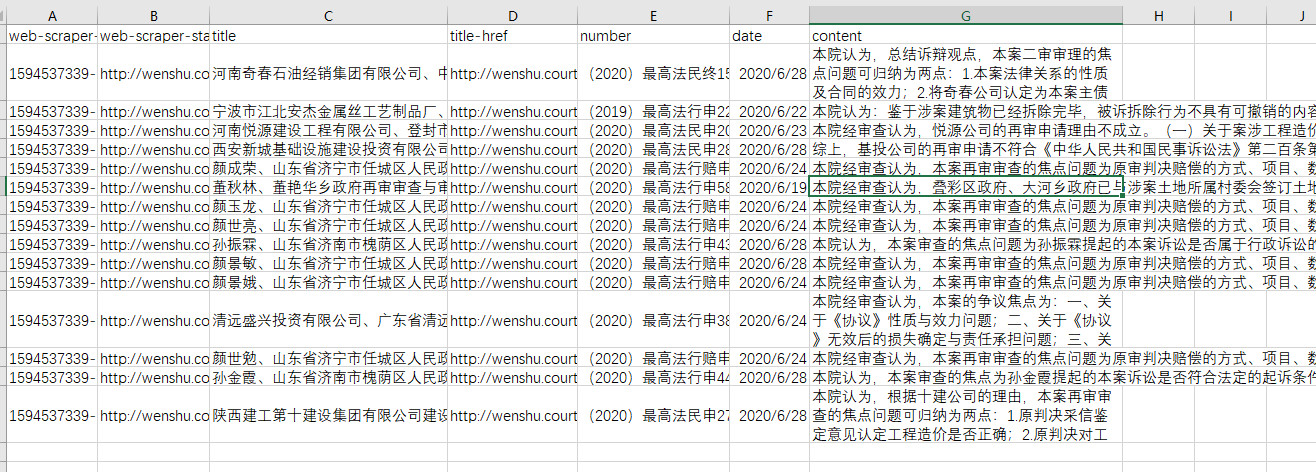

爬取的过程及结果就是这样的。

这个方法相对python而言,节省的时间可不止一点点,结果基本上一致。

这里把上面的web scraper的配置也分享一下:

{"_id":"caipan","startUrl":["http://wenshu.court.gov.cn/website/wenshu/181217BMTKHNT2W0/index.html?pageId=7bcf3b0574e320a487ada1f504759be4&s21=%E8%B5%94%E5%81%BF"],"selectors":[{"id":"list","type":"SelectorElementClick","parentSelectors":["_root"],"selector":"div.LM_list:nth-of-type(n+3)","multiple":true,"delay":0,"clickElementSelector":".left_7_3 a:nth-of-type(-n+4)","clickType":"clickOnce","discardInitialElements":"do-not-discard","clickElementUniquenessType":"uniqueText"},{"id":"title","type":"SelectorLink","parentSelectors":["list"],"selector":"a.caseName","multiple":false,"delay":0},{"id":"number","type":"SelectorText","parentSelectors":["list"],"selector":"span.ah","multiple":false,"regex":"","delay":0},{"id":"date","type":"SelectorText","parentSelectors":["list"],"selector":"span.cprq","multiple":false,"regex":"","delay":0},{"id":"content","type":"SelectorText","parentSelectors":["list"],"selector":"p","multiple":false,"regex":"","delay":0}]}

批量下载word文书

每个文书都提供有word下载的链接,但是实现批量下载还是有一点困难。

1、word的下载链接直接在按钮或者网页源码里面是提取不到的,是需要根据文书的url中的"docId"参数来构造的,即

“http://wenshu.court.gov.cn/down/one?” + docID地址

例如:

爬取到的文书的详细页地址为:

http://wenshu.court.gov.cn/website/wenshu/181107ANFZ0BXSK4/index.html?docId=f9ffb134f0cb4a2ab832abea01298704

那么下载地址就是:

http://wenshu.court.gov.cn/down/one?docId=f9ffb134f0cb4a2ab832abea01298704

2、有了这个地址之后,原本以为可以直接用迅雷、IDM等软件来批量下载,但是很显然,网站的开发人员限制了。经过不同方法的验证,发现目前只能是通过浏览器来挨个下载。(另外,可能可以通过python设置各种反爬的方法来实现批量下载的目的,但是工程量比较大,我没试验成功,理论上应该是可的。)

那么就用了最笨的方法,借助python来模拟鼠标键盘的操作,将url批量的输入到浏览器当中,实现批量下载。

下面是单次下载的代码,批量的话只需要读取web scraper爬取的文件,构造好url,通过一个循环,依次输入下载即可。

import time

import pyautogui

time.sleep(1)

url_position = (160, 50) #url位置

def input_id(x,y,url): #输入url的动作

pyautogui.moveTo(x, y, duration=0.2) #0.25表示完成移动的时间

pyautogui.click(button='left')

time.sleep(0.5)

pyautogui.typewrite(url,0.01)#输入字符,0.1表示输入每个字符间隔的时间

time.sleep(0.5)

pyautogui.press("enter")

url1 = "http://wenshu.court.gov.cn/down/one?docId=694b012a59e34ae19967abeb00d512dc"

input_id(url_position[0],url_position[1],url1)

小结:

1、python固然很强大,但是有时候用web scraper可以效率更高,节省更多的时间。

2、web scraper爬取url不变、异步加载的网页,关键是"selector type"和"click selector"的配置,可以参考教程:http://www.yhjbox.com/2020/03/5561/

3、python可以通过pyautogui库,来实现自动化操作任意鼠标、键盘的操作。