(目标检测)--- Faster RCNN算法理解

Faster RCNN

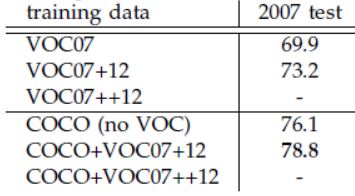

本文是继RCNN,Fast RCNN之后,目标检测界的领军人物Ross Girshick团队在2015年的又一力作。简单网络目标检测速度达到17fps,在PASCAL VOC上准确率为59.9%;复杂网络达到5fps,准确率78.8%。

思想发展历程

从RCNN,到Fast RCNN,再到本文的Faster RCNN,目标检测的四个基本步骤(候选区域生成,体征提取,分类,位置精修)逐渐被归一化到一个深度网络的框架内。所有的流程完全在GPU内完成,计算上没有重复,大大提高效率。

Faster RCNN可以看作:“区域生成网络 + Faster RCNN”的系统,用区域生成网络代替Fast RCNN中的Selective Rearch方法。

本文主要解决了系统的三个问题:

- 如何设计区域生成网络。

- 如何==训练=区域生成网络。

- 如何让区域生成网络和Fast RCNN共享特征提取网络

区域生成网络:结构

基本设想就是:在特征提取好的特征图上,对所有可能的候选框进行判别。由于后续还要进行位置精修,所以候选框实际比较稀疏。

Tip:什么是Relu?

分类层:cls_score

窗口回归层:bbox_pred

特征提取

原始特征提取(上图灰色方框)包含若干层conv+relu,直接套用ImageNet上常见的分类网络即可。本文试验了两种网络:5层的ZF,16层的VGG-16,具体结构不再赘述。

额外添加一个conv+relu层,输出5139256维特征(feature)。

候选区域(anchor)

特征可以看作是一个尺度为:的256通道图像,对于该图像上的每一个位置考虑出9个可能的候选窗口:三种面积分别为{}x三种比例{1:1,1:2,2:1}。这些候选窗口称为anchors。下图示出5139个anchor中心,以及9种anchor示例。

在整个faster RCNN算法中,有三种尺度。

原图尺度:原始输入的大小。不受任何限制,不影响性能。

归一化尺度:输入特征提取网络的大小,在测试时设置,源码中opts.test_scale=600。anchor在这个尺度上设定。这个参数和anchor的相对大小决定了想要检测的目标范围。

网络输入尺度:输入特征检测网络的大小,在训练时设置,源码中为224224。

窗口分类和位置精修

分类层(cls_score)输出每一个位置上,9个anchor属于前景和背景的概率;窗口回归层(bbox_pred)输出每一个位置上,9个anchor对应窗口应该平移缩放的参数。

对于每一个位置来说,分类层从256维特征中输出属于前景和背景的概率;窗口回归层从256维特征中输出4个平移缩放参数。

就局部来说,这两层是全连接网络;就全局来说,由于网络在所有位置(共51*39个)的参数相同,所以实际用尺寸为1×1的卷积网络实现。

区域生成网络:训练

样本

考察训练集中的每张图像:

a. 对每个标定的真值候选区域,与其重叠比例最大的anchor记为前景样本

b. 对a)剩余的anchor,如果其与某个标定重叠比例大于0.7,记为前景样本;如果其与任意一个标定的重叠比例都小于0.3,记为背景样本

c. 对a),b)剩余的anchor,弃去不用。

d. 跨越图像边界的anchor弃去不用

代价函数

同时最小化两种代价:

a. 分类误差

b. 前景样本的窗口位置偏差

具体参看fast RCNN中的“分类与位置调整”段落。

超参数

原始特征提取网络使用ImageNet的分类样本初始化,其余新增层随机初始化。

每个mini-batch包含从一张图像中提取的256个anchor,前景背景样本1:1.

前60K迭代,学习率0.001,后20K迭代,学习率0.0001。

momentum设置为0.9,weight decay设置为0.0005。[5]

共享特征

区域生成网络(RPN)和fast RCNN都需要一个原始特征提取网络(下图灰色方框)。这个网络使用ImageNet的分类库得到初始参数,但要如何精调参数,使其同时满足两方的需求呢?本文讲解了三种方法。

a. 从W0开始,训练RPN。用RPN提取训练集上的候选区域

b. 从W0开始,用候选区域训练Fast RCNN,参数记为W1

c. 从W1开始,训练RPN…

具体操作时,仅执行两次迭代,并在训练时冻结了部分层。论文中的实验使用此方法。

如Ross Girshick在ICCV 15年的讲座Training R-CNNs of various velocities中所述,采用此方法没有什么根本原因,主要是因为”实现问题,以及截稿日期“。

联合训练

直接在上图结构上进行训练,但在backward计算梯度时,要考虑OROI区域的变化的影响。

实验

除了开篇提到的基本性能外,还有一些值得注意的结论。

- 与Selective Search方法(黑)相比,当每张图生成的候选区域从2000减到300时,本文RPN方法(红蓝)的召回率(什么是准确率与召回率?)下降不大。说明RPN方法的目的性更明确。

- 使用更大的Microsoft COCO数据集进行训练,直接在PASCAL VOC上训练,准确率提升了6%,说明Faster RCNN迁移性良好,没有过拟合(如何防止Over fitting)。