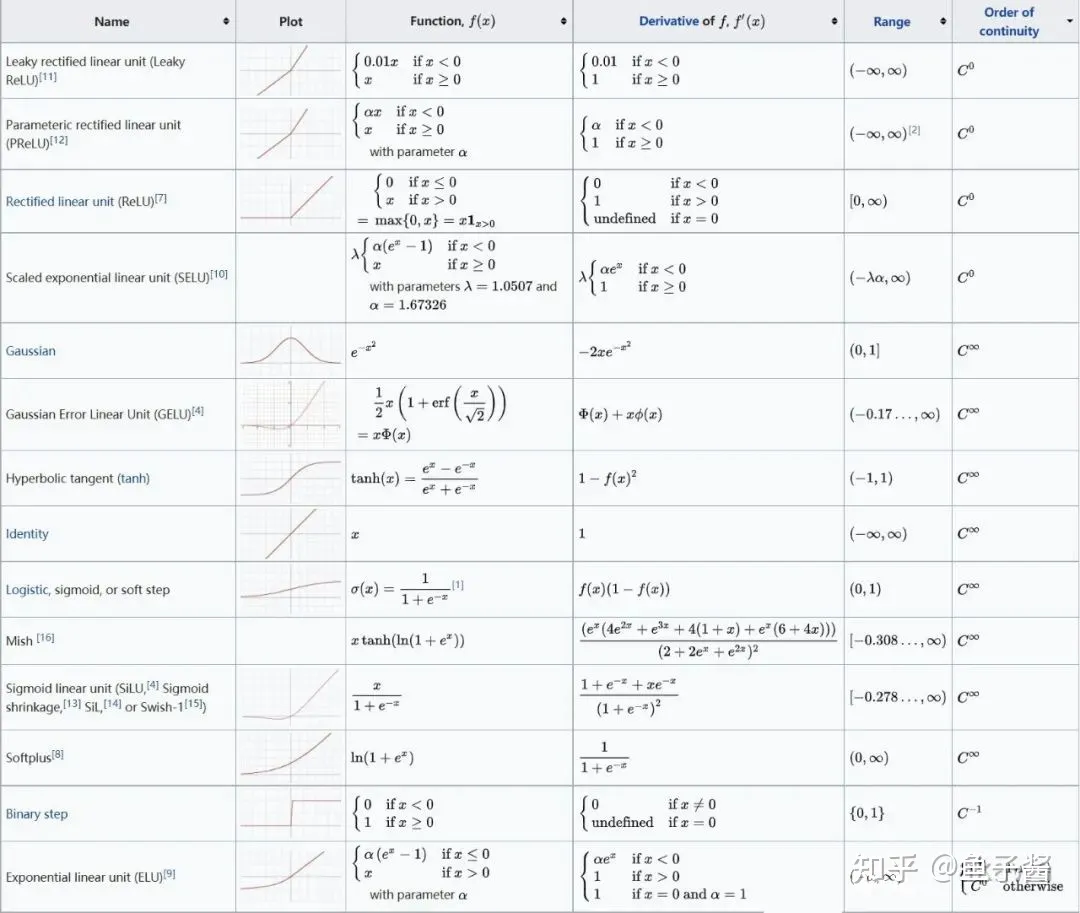

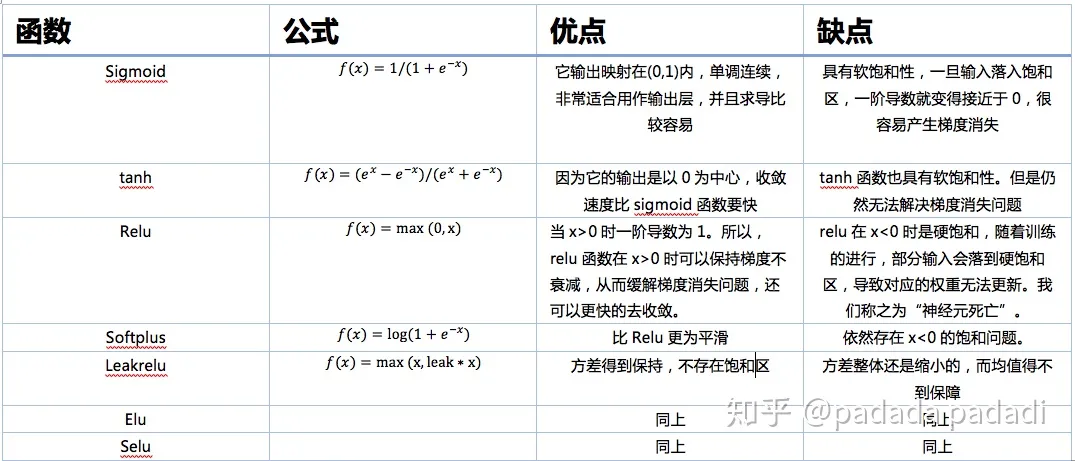

各种各样的激活函数(表格对比)

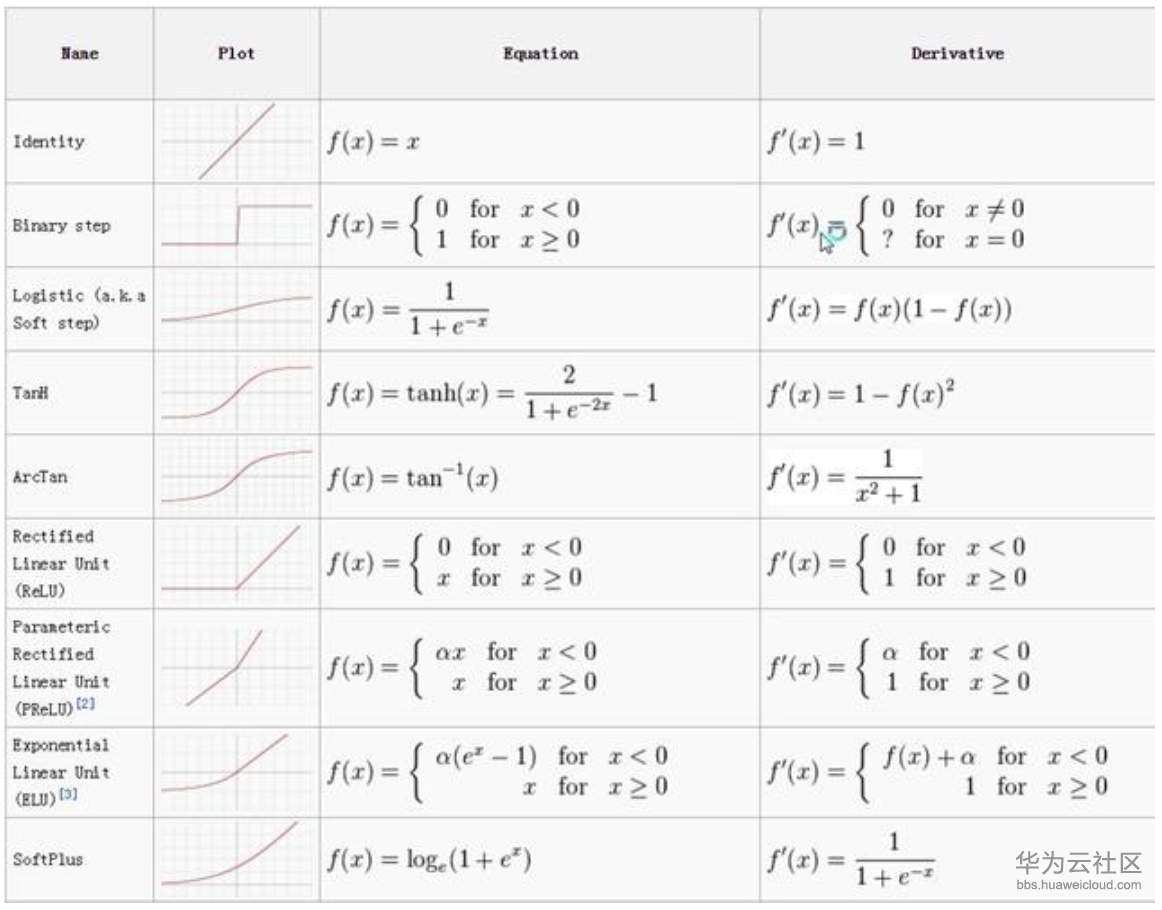

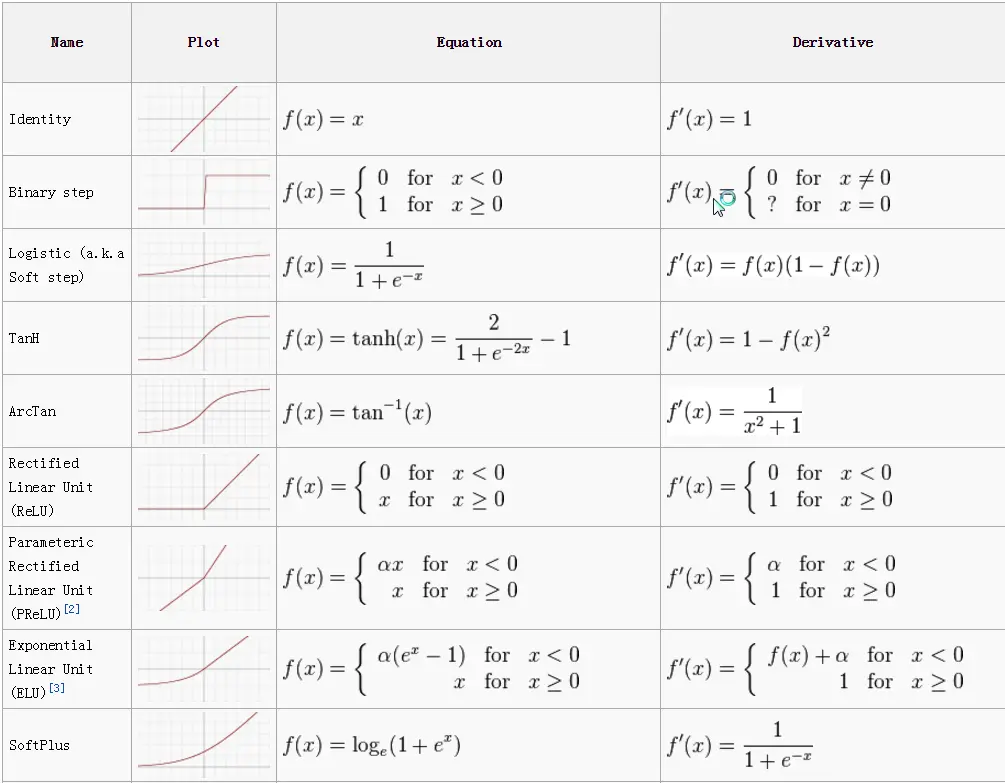

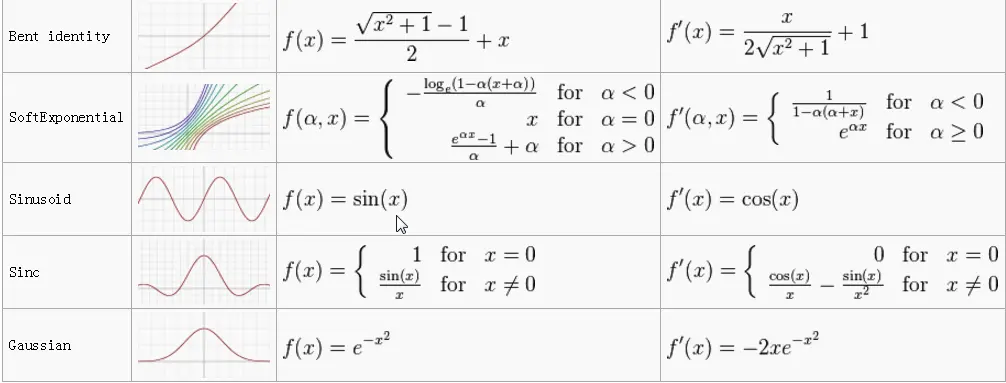

各种各样的激活函数(详细)

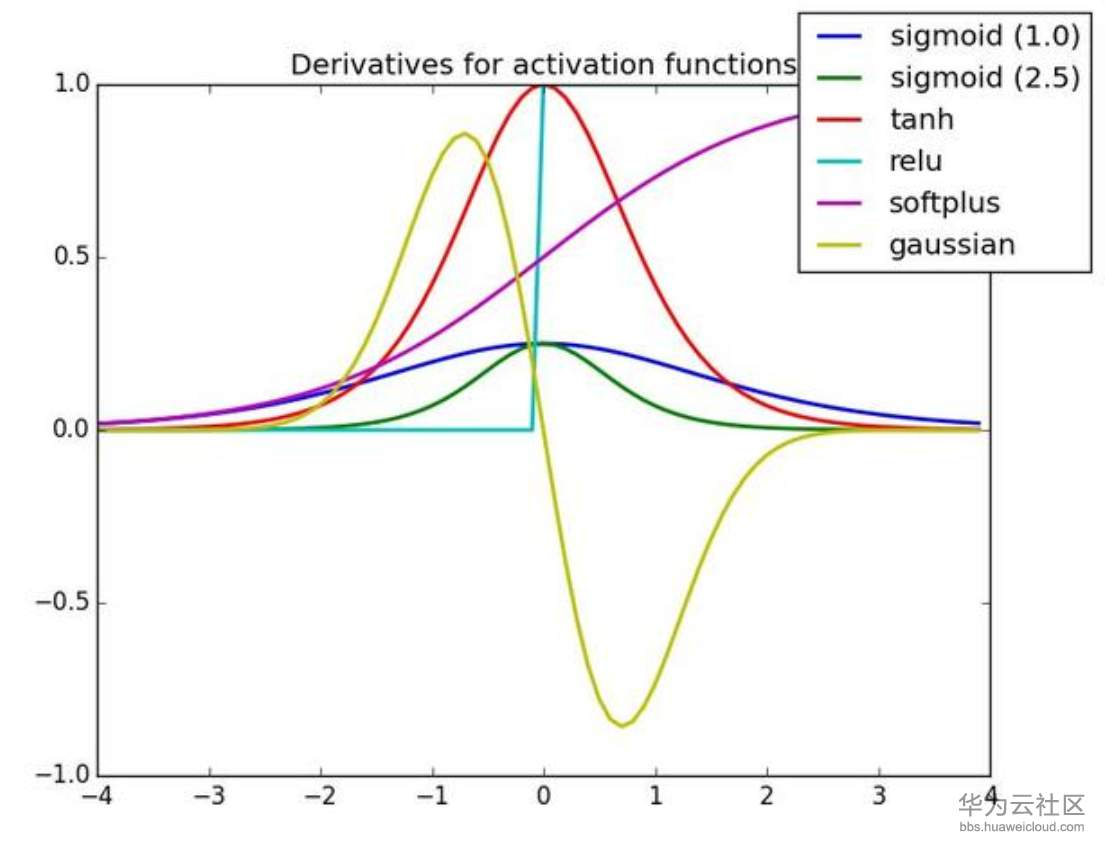

深入理解激活函数

各种各样的激活函数(表格对比)

如何选择激活函数?

一句话:“那么该用那种呢?”用ReLU非线性函数。注意设置好学习率,或许可以监控你的网络中死亡的神经元占的比例。如果单元死亡问题困扰你,就试试Leaky ReLU或者Maxout,不要再用sigmoid了。也可以试试tanh,但是其效果应该不如ReLU或者Maxout。

最后需要注意一点:在同一个网络中混合使用不同类型的神经元是非常少见的,虽然没有什么根本性问题来禁止这样做。

作者:郭少悲

链接:https://www.jianshu.com/p/6158d88a4512

来源:简书

著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。

激活函数

https://bbs.huaweicloud.com/blogs/102978

https://www.jianshu.com/p/6158d88a4512?utm_campaign=maleskine&utm_content=note&utm_medium=seo_notes&utm_source=recommendation

https://zhuanlan.zhihu.com/p/38935874

https://zhuanlan.zhihu.com/p/38935874

https://zhuanlan.zhihu.com/p/364620596

https://zhuanlan.zhihu.com/p/364620596

https://zhuanlan.zhihu.com/p/428617333

http://mt.sohu.com/20160128/n436193147.shtml

浙公网安备 33010602011771号

浙公网安备 33010602011771号